1

1

если еще подскажите,чего выебывается ssh я буду вообще рад. в rc.conf добавил sshd_enable="yes", в конфиге ssh махнул порт 22 на 2222. все. теперь он до днс какого-то хера доебывается, в родной локалке с местными ip. отстал я от жизни.

Vladislav

Vladislav

# sysrc -a | grep sshd

sshd_enable: YES

sshd_flags: -oPort=1022 -oCompression=yes -oPermitRootLogin=yes -oPasswordAuthentication=yes -oProtocol=2 -oUseDNS=no

1

1

если еще подскажите,чего выебывается ssh я буду вообще рад. в rc.conf добавил sshd_enable="yes", в конфиге ssh махнул порт 22 на 2222. все. теперь он до днс какого-то хера доебывается, в родной локалке с местными ip. отстал я от жизни.

Разобрался сам, сам дурак,сорри,что дернул. В ближайшую eth-розетку пихал то сервер,то комп. результат немного предсказуем, извините.

А вот куда фоточки делись -вопрос. но нерешаемый.

спасибо комманде этого канала,вы -молодцы.

1

1

рад,чтотлет 20 назад,смотря наизоопарк линуксячук,выбралифрю. с охуеннейшем хэндбуком и добрым сообществом. это помтавило меня на правильные рельсы.

теперь-то поыигу win/lin/freebsd, ну всюду что-то новенькое но осваивпется на раз.а нсли реально на одн раз -то можнотпросто в таких каналах спросить,сделать и забыть. эх, где мое irc... Дообра вам. и я чем смогу -помогу.

Georg🎞️🎥

Georg🎞️🎥

Подскажите, пул это ≠ файловая система?

Пул - это группа дисков-единомышленников, объединенных в рейд для хранения вам верности и торрентов )))

nikolay

nikolay

народ, еще раз задам вопрос - должен ли zvol помечать блоки как свободные после выполнения fstrim -av внутри виртуальной машины к которой этот самый zvol подключен как блочное устройство? другими словами освободится ли место на уровне zfs pool после выполнения указанной команды внутри VM?

nikolay

nikolay

[root@obj04 network-scripts]# fstrim -av

/import/objects2: 16.4 TiB (17985433317376 bytes) trimmed

/import/objects: 29.7 TiB (32590653698048 bytes) trimmed

/var/log: 7.3 GiB (7839670272 bytes) trimmed

/boot: 781.7 MiB (819613696 bytes) trimmed

/: 7.7 GiB (8200372224 bytes) trimmed

nikolay

nikolay

/import/objects: 29.7 TiB (32590653698048 bytes) trimmed - это zvol объемом 96 Тб. на уровне гостевой ос показывает что место освобождается (если я правильно понимаю вывод команды), на уровне zvol и zfs пула без изменений

Ivan

Ivan

народ, еще раз задам вопрос - должен ли zvol помечать блоки как свободные после выполнения fstrim -av внутри виртуальной машины к которой этот самый zvol подключен как блочное устройство? другими словами освободится ли место на уровне zfs pool после выполнения указанной команды внутри VM?

должен при соблюдении ряда условий

Ivan

Ivan

народ, еще раз задам вопрос - должен ли zvol помечать блоки как свободные после выполнения fstrim -av внутри виртуальной машины к которой этот самый zvol подключен как блочное устройство? другими словами освободится ли место на уровне zfs pool после выполнения указанной команды внутри VM?

покажи

zfs get refreservation pool/zvol

nikolay

nikolay

мм, точно zvol должен быть тонким? гугл вроде не выдает такого требования. discard как раз и нужен для того, чтобы освобождались блоки на толстых томах, на thin вольюме оно по умолчанию будет освобождаться если внутри ос это поддерживается

Ivan

Ivan

мм, точно zvol должен быть тонким? гугл вроде не выдает такого требования. discard как раз и нужен для того, чтобы освобождались блоки на толстых томах, на thin вольюме оно по умолчанию будет освобождаться если внутри ос это поддерживается

если zvol не тонкий, то место всегда будет занято под размер диска, емнип

George

George

nikolay

nikolay

покажи

zfs get refreservation pool/zvol

NAME PROPERTY VALUE SOURCE

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 reservation none default

nikolay

nikolay

reservation != refreservation

пардон, NAME PROPERTY VALUE SOURCE

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 refreservation none local

nikolay

nikolay

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 written 96.4T -

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 logicalused 84.2T -

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 logicalreferenced 84.2T

Ivan

Ivan

zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 96.4T 5.40T 96.4T -

а че у тебя за гипер ? может он не умеет в дискард ?

Ivan

Ivan

чет мне кажется что уже был вопрос такой у тебя, и порешили на том, что гипер фичу не поддерживает

nikolay

nikolay

а че у тебя за гипер ? может он не умеет в дискард ?

это обычный линукс, centos stream 8, виртуалка запущена через virt-install

nikolay

nikolay

virt-install -n test --network=bridge:br0 --ram 24048 --arch=x86_64 -vcpus=8 --cpu host --check-cpu --disk path=/dev/zvol/zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk0 --disk path=/dev/zvol/zones/3256b4bb-b33e-cb00-e152-c0e3e18b33b1-disk1 --graphics vnc,listen=IP --os-type linux --os-variant=rhel8.6 --boot hd,menu=on

nikolay

nikolay

чет мне кажется что уже был вопрос такой у тебя, и порешили на том, что гипер фичу не поддерживает

был, тогда это все крутилось на smartos, и драйвер virtio в нем не поддерживал discard. я снес смартос, поставил линукс

Ivan

Ivan

https://gist.github.com/aladuca/854b78585c2bba961386

вроде вот этого не хватает bus=scsi,discard=unmap

nikolay

nikolay

так.. вопрос наверное не по теме чата, но спрошу - можно изменить настройки у VM чтобы она не потеряла после ребута этот диск?

George

George

так.. вопрос наверное не по теме чата, но спрошу - можно изменить настройки у VM чтобы она не потеряла после ребута этот диск?

Вопрос скорее про поддержку гостевой ОС изменений

Ivan

Ivan

так.. вопрос наверное не по теме чата, но спрошу - можно изменить настройки у VM чтобы она не потеряла после ребута этот диск?

чего нет. но если гость - винда, то могут быть проблемы со стартом.

nikolay

nikolay

чего нет. но если гость - винда, то могут быть проблемы со стартом.

гость тоже линукс. этот zvol не бутовый диск, наверное можно только его переключить на scsi контроллер, а бутовый оставить как есть.. ок, примерно понятно куда копать, спасибо!

Ivan

Ivan

гость тоже линукс. этот zvol не бутовый диск, наверное можно только его переключить на scsi контроллер, а бутовый оставить как есть.. ок, примерно понятно куда копать, спасибо!

вродь как все линуксы новее центос 6 можно бутать без проблем при смене типа диска.

nikolay

nikolay

вродь как все линуксы новее центос 6 можно бутать без проблем при смене типа диска.

по твоей ссылке я вижу что можно задавать тип шины и диска для отдельного диска, это то, что нужно

Станислав

Станислав

Привет всем, я сейчас наверное задам глупый вопрос, сразу извиняюсь) но, имеем пул, на нем датасет, выставлено рекордсайз 1М, имеем другой пул, также с датасет с рекордсайз 1М, первый датасет это сингл диск, второй - рейд з2, так вот, почему при записи на сингл диск система работает с блоками, по размеру примерно равными 1МБ, а при записи на рейдз2 - примерно 200-256к? (он сделан на 8 дисках), параметр смотрю iostat'ом, который wareq-sz

Станислав

Станислав

это при простом копировании файлов с одного пула на другой, и примерно такое же поведение при чтении файлов с пулов, на единственном диске размер блока для чтения всегда равен 1МБ, читаю командой dd, с разным размером блоков, хоть 4к, хоть 128к, хоть 4М, размер запрашиваемого блока с физического диска одинаков (1МБ), а при чтении с массива raidz2, по 170к примерно

Ivan

Ivan

Станислав

Станислав

данные же размазываются по дискам

просто я считал, что если размер блока 1МБ, то соответственно на каждый отдельный физический диск размер записи будет равен 1МБ (собственно нечто подобное размеру блока на аппаратном рейд массиве)

George

George

просто я считал, что если размер блока 1МБ, то соответственно на каждый отдельный физический диск размер записи будет равен 1МБ (собственно нечто подобное размеру блока на аппаратном рейд массиве)

нет, recordsize это размер логического блока на уровне zfs

Станислав

Станислав

так-то получается примерно как есть - 1МБ рекордсайз, поделим на 6 дисков + 2 чётности, получаем примерно 128к (очень грубо)

Arseniy

Arseniy

Майкл Лукас в своих книгах рекомендует делать zfs поверх gpt

Как думаете, насколько это актуально на текущий момент?) Лукас вел речь про фряху

Стоит заморачиваться с GPT или нет? Есть какие то негативные стороны у обоих решений?

George

George

Как думаете, насколько это актуально на текущий момент?) Лукас вел речь про фряху

Стоит заморачиваться с GPT или нет? Есть какие то негативные стороны у обоих решений?

в плане заморачиваться? gpt нынче стандарт, mbr уже всё

Arseniy

Arseniy

в плане заморачиваться? gpt нынче стандарт, mbr уже всё

Я имею ввиду ставит на сырые диски, или сделать GPT-разметку

George

George

Я имею ввиду ставит на сырые диски, или сделать GPT-разметку

сейчас рекомендаций нет, как удобнее - так и стоит делать. Я люблю например для домашних нужно не сразу весь объём zfs отдавать, чтобы иметь возможность странные штуки делать

Arseniy

Arseniy

George

George

Подробнее можно?) Какие штуки?)

переливать пулы, делать рядом с миррорами страйпы под не важное, ставить эксперименты на реальных дисках

Arseniy

Arseniy

George

George

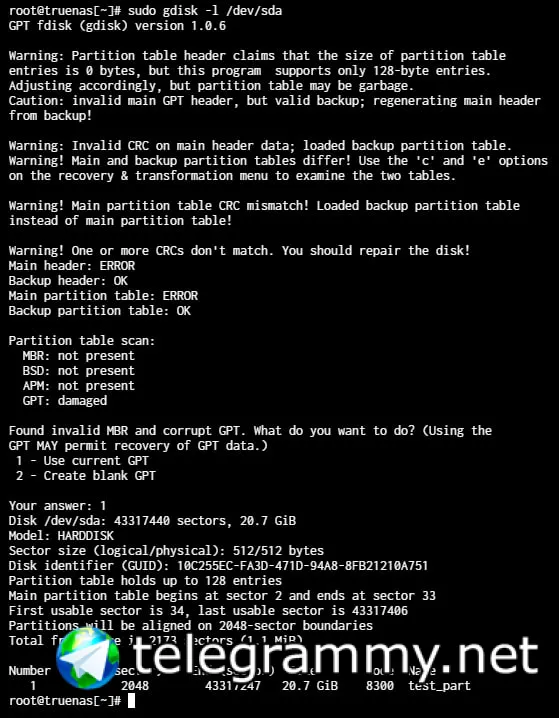

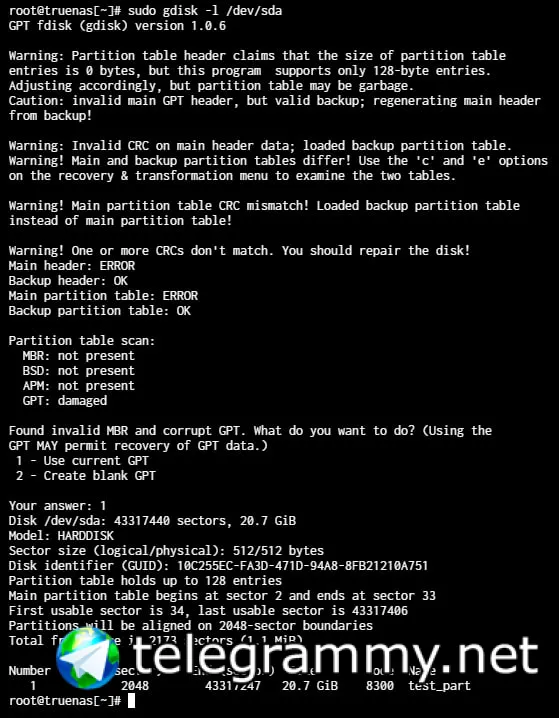

> Грузанулся в основной хост, создал пул через zpool create pool0 /dev/sda

именно /dev/sda? хз что пошло не так, но кажется это не норма)

Nikita

Nikita

> Грузанулся в основной хост, создал пул через zpool create pool0 /dev/sda

именно /dev/sda? хз что пошло не так, но кажется это не норма)

если я всё правильно понимаю, то zpool-у надо было /dev/sda1 подсовывать, например. а так похоже, что был отдан весь диск и zfs совершенно закономерно затерла главную таблицу в начале диска, а до резервной(она в конце диска) не успела добраться.

Alexander 🖨

Alexander 🖨

Возможно, главный плюс создания на разделе - это то, что если засунуть диск в систему, которая не знает про zfs, то она все равно увидит, что диск занят

Nikita

Nikita

George

George

Возможно, главный плюс создания на разделе - это то, что если засунуть диск в систему, которая не знает про zfs, то она все равно увидит, что диск занят

нет, zfs при подаче всего диска сам создаст gpt

Nikita

Nikita

(по крайней мере openzfs 2)

вот и я удивился) сановский таким не баловал, а у меня все пулы еще оттуда...

Arseniy

Arseniy

На /dev/sda0, наверное, надо было?

Его не существовало, я ж предварительно посмотрел. Только sda

star

star

central

central