root@pve:~# zpool status rpool

pool: rpool

state: ONLINE

scan: scrub repaired 0B in 2h3m with 0 errors on Sun Nov 20 18:58:01 2022

config:

NAME STATE READ WRITE CKSUM

rpool ONLINE 0 0 0

sdb2 ONLINE 0 0 0

sda ONLINE 0 0 0

нужно путь до девайса

zpool remove rpool /dev/sda

Если на оставшихся дисках есть место куда переписать данные, то они начнут копироваться, если нет - сразу скажет что не может

zpool status - ждешь когда данные скопируются, потом можешь с диском делать что хочешь

Владимир

Владимир

Можно и локально белать бекап:

zfs send ... | zfs receive ${dataset}

чего не снапшотом тогда? или в другой пул?

Andrey

Andrey

Коллеги, банальный вопрос. А можно том ZFS поверх рейда делать? вот рейдз точно знаю что нельзя. а одиночный пул?

Ivan

Ivan

Vladislav

Vladislav

Коллеги, банальный вопрос. А можно том ZFS поверх рейда делать? вот рейдз точно знаю что нельзя. а одиночный пул?

Нельзя, если вам нужна гарантия zfs о сохранности данных

Andrey

Andrey

ну тут забавный момент. Хочется репликацию в прокмоксе использовать, а ssd подключены к 9620i

Δαρθ

Δαρθ

Нельзя, если вам нужна гарантия zfs о сохранности данных

mdraid в лице raid0 и raid1 вроде такую гарантию не ломает?

Vladislav

Vladislav

mdraid в лице raid0 и raid1 вроде такую гарантию не ломает?

Не всегда, если контроллеры даже для 0 и 1 кэшируют данные

Ivan

Ivan

ну тут забавный момент. Хочется репликацию в прокмоксе использовать, а ssd подключены к 9620i

у него нет hba режима ?

Vladislav

Vladislav

ну тут забавный момент. Хочется репликацию в прокмоксе использовать, а ssd подключены к 9620i

Так он поддерживает jbod если мне не изменяет память

Alexander

Alexander

подскажите, делаю nas на контроллере SAS

планирую делать массив из 6-8 дисков

raidz2 будет нормальным выбором чтобы иметь защиту данных от потери при не очень выскоих затратах пространства?

Δαρθ

Δαρθ

Опции sync=always даже если ФС пишет без синка у него нет

эта опция fs, монтируй с mount -o sync

mdraid не фс а прокладка между блочными девайсами

Vladislav

Vladislav

Vladislav

Vladislav

ну синхронные записи же тоже он поддерживает

Он поддерживает их ровно также как и любой диск

Andrey

Andrey

ну тут забавный момент. Хочется репликацию в прокмоксе использовать, а ssd подключены к 9620i

Для контроллеров с кэшем судя по всему в zfs вот эта опция предусмотрена

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#zfs-nocacheflush

zfs_nocacheflush

ZFS uses barriers (volatile cache flush commands) to ensure data is committed to permanent media by devices. This ensures consistent on-media state for devices where caches are volatile (eg HDDs).

For devices with nonvolatile caches, the cache flush operation can be a no-op. However, in some RAID arrays, cache flushes can cause the entire cache to be flushed to the backing devices.

Aaer

Aaer

Ребят скажите пожалуйста. Если у меня пул есть, и я хочу эти ссд поменять.

Но по факту старые диски больше чем новые. 256 против 250гб.

То у меня естественно не получиться эти 2 диска добавить в тот миррор?

Я думал добавить к двум старым два новых, и затем старые убрать.

Отресайзить чуть чуть пул нельзя? Место свободное есть 40%.

Вот думаю как лучше сделать?

Или из этих двух новых создать новый пул и данные перекинуть со старого.

Дайте совет пожалуйста

Andrey

Andrey

Ребят скажите пожалуйста. Если у меня пул есть, и я хочу эти ссд поменять.

Но по факту старые диски больше чем новые. 256 против 250гб.

То у меня естественно не получиться эти 2 диска добавить в тот миррор?

Я думал добавить к двум старым два новых, и затем старые убрать.

Отресайзить чуть чуть пул нельзя? Место свободное есть 40%.

Вот думаю как лучше сделать?

Или из этих двух новых создать новый пул и данные перекинуть со старого.

Дайте совет пожалуйста

если с даунтаймом то создать рядом другой пул и сделат на него send

Δαρθ

Δαρθ

если с даунтаймом то создать рядом другой пул и сделат на него send

основной сенд причем можно делать без даунтайма. c даунтаймом только второй накопившийся за время первого

Aaer

Aaer

если с даунтаймом то создать рядом другой пул и сделат на него send

ну да, про это и подумал. Я просто чето совсем не подумал что будет нехватка места, так бы если больше проблемы бы не было. autoexpand помогбы бы да и все.

Aaer

Aaer

основной сенд причем можно делать без даунтайма. c даунтаймом только второй накопившийся за время первого

можно задать пару уточняющих вопросов.

1. Я создаю новый пул

2. На старом я делаю снапшот и через zfs send отправляю на новый пул?

3. Потом останавляваю старый пул и докидываю опять через zfs send "кусочек данных"?

Александр

Александр

можно задать пару уточняющих вопросов.

1. Я создаю новый пул

2. На старом я делаю снапшот и через zfs send отправляю на новый пул?

3. Потом останавляваю старый пул и докидываю опять через zfs send "кусочек данных"?

Да. В итоге, у тебя получается, что очередной инкрементальный send занимает секунды. То есть, все остановить - snapshot - send|receive - заменить пулы - все запустить = даунтайм в десятки секунд - единицы минут

Aaer

Aaer

Да. В итоге, у тебя получается, что очередной инкрементальный send занимает секунды. То есть, все остановить - snapshot - send|receive - заменить пулы - все запустить = даунтайм в десятки секунд - единицы минут

попробую сейчас, маловато опыта. Немного очкую.

Но стратегию вроде понял. спс

Александр

Александр

попробую сейчас, маловато опыта. Немного очкую.

Но стратегию вроде понял. спс

... очкую вот я, мне нужно заменить загрузочный диск, а как-то странно происходит загрузка с диска. Вечером нужно будет часов в 9 сесть и повозиться. Хорошо, что KVM есть. В другом месте аналогичное, но KVM нужно подключать руками персонала...

Aaer

Aaer

... очкую вот я, мне нужно заменить загрузочный диск, а как-то странно происходит загрузка с диска. Вечером нужно будет часов в 9 сесть и повозиться. Хорошо, что KVM есть. В другом месте аналогичное, но KVM нужно подключать руками персонала...

— Что, солдат, ссымся?

— Так точно, ссусь!

— Это, солдат, не беда. Такая сегодня экологическая обстановка. Все ссутся. Я ссусь. Даже главком пысается, бывает. Но по ситуации. Что же нам из-за этого, последний долг родине не отдавать? Твой позорный недуг мы в подвиг определим. Пошлем в десантники. Там ты ещё и сраться начнешь.

))

Александр

Александр

— Что, солдат, ссымся?

— Так точно, ссусь!

— Это, солдат, не беда. Такая сегодня экологическая обстановка. Все ссутся. Я ссусь. Даже главком пысается, бывает. Но по ситуации. Что же нам из-за этого, последний долг родине не отдавать? Твой позорный недуг мы в подвиг определим. Пошлем в десантники. Там ты ещё и сраться начнешь.

))

... незабываемо: в пятницу вечером ребать сервер, на котором висит доступ в интернет у сети банка...

Arseniy

Arseniy

Я давненько не писал. Как часто scrub запускать надо? Если если как бы все работает, то и не надо?)

Fedor

Fedor

... незабываемо: в пятницу вечером ребать сервер, на котором висит доступ в интернет у сети банка...

Хорошо б такие штуки резервировать

George

George

Я давненько не писал. Как часто scrub запускать надо? Если если как бы все работает, то и не надо?)

По вкусу, в дебиане по умолчанию раз в месяц емнип в дефолтных пакетах запускается

Александр

Александр

Arseniy

Arseniy

Если регулярно вычитывается или записывается весь объем данных - то ручной скраб не нужен

Не, у меня точно не тот вариант.раз в месяц, понял

Arseniy

Arseniy

Я ещё финально не поставил, так как серв на работе, а я тут заболел. Но в итоге ProxMox будет + ВМ Ubuntu. Остановился на этом варианте

George

George

Я ещё финально не поставил, так как серв на работе, а я тут заболел. Но в итоге ProxMox будет + ВМ Ubuntu. Остановился на этом варианте

Емнип в проксе из коробки будет systemd сервис как раз для запуска скраба раз в месяц

Arseniy

Arseniy

Понял, покурю.

Не очень дружественно в проксе все, на самом деле, если надо лишь один серв держать. Вот, пока ковыряю репликацию и снапшоты

В TrueNas в этом плане, конечно, как то все нагляднее

George

George

Привет. Можно ли под Debian уменьшить на лету ARC?

В бОльшую сторону - да, в меньшую он не запустит очистку кеша просто так, но выставить даст

Mikhail

Mikhail

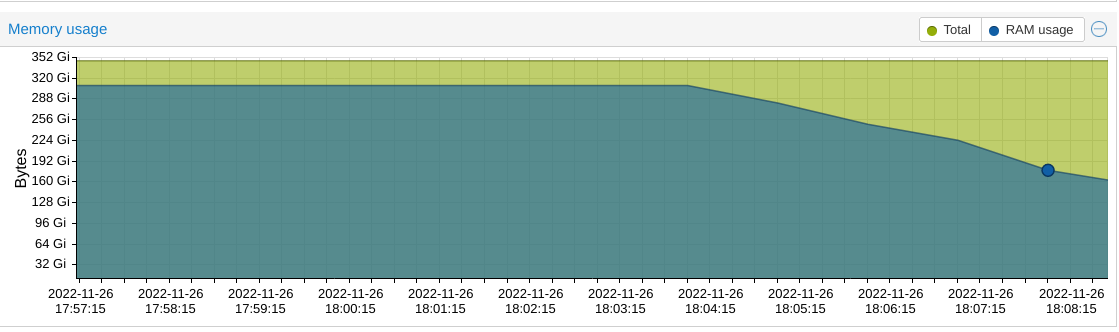

Просто не работало выставление при малых значениях. То есть нельзя просто сжать с 160GB до 2GB.

Александр

Александр

Mikhail

Mikhail

В бОльшую сторону - да, в меньшую он не запустит очистку кеша просто так, но выставить даст

Вроде даже запустил. уменьшил пока со 160 до 100

Mikhail

Mikhail

Mikhail

Mikhail

На что только не идут, чтобы у китайцев с алика оперативы не покупать 😤

Да просто по ошибки закинули на compute-ы ZFS пул, криво настроили (без лимита на ARC). Всё бы незаметно, да кто-то плодил виртуалок на этом пуле. Так то виртуалки по iscsi+ZFS преимущественно сидят.

Aaer

Aaer

Да. В итоге, у тебя получается, что очередной инкрементальный send занимает секунды. То есть, все остановить - snapshot - send|receive - заменить пулы - все запустить = даунтайм в десятки секунд - единицы минут

Спасибо за совет. Все прошло успешно.

Едиственное пришлось пул возвращать к исходному имени rpool так как в проксе к названию много чего прибито гвоздями.

Но грузанулся с другой системы с делал zpool export new_pool rpool и подкинул все назад. и все полетело. + 1 к опыту

Δαρθ

Δαρθ

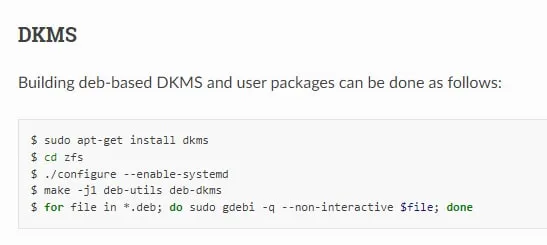

root@dimkam:~/zfs# ls *deb kmod-zfs-5.4.0-132-generic_2.1.6-1_amd64.deb kmod-zfs-devel_2.1.6-1_amd64.deb kmod-zfs-devel-5.4.0-132-generic_2.1.6-1_amd64.deb libnvpair3_2.1.6-1_amd64.deb libuutil3_2.1.6-1_amd64.deb libzfs5_2.1.6-1_amd64.deb libzfs5-devel_2.1.6-1_amd64.deb libzpool5_2.1.6-1_amd64.deb python3-pyzfs_2.1.6-1_amd64.deb zfs_2.1.6-1_amd64.deb zfs-dkms_2.1.6-1_amd64.deb zfs-dracut_2.1.6-1_amd64.deb zfs-initramfs_2.1.6-1_amd64.deb

zfs-test_2.1.6-1_amd64.deb

скомпилировалось вот. что из этого нужно ставить а что не очень?