у тебя 2 тб в страйпе. там и так не избыточности

4 mirror (2+2)

Вполне себе выход одного диска

Arseniy

Arseniy

Да из гуи и консоли можно собрать такую схему

Для этого надо сделать zvol на полученном страйпе 2+2? Или необязательно? Я не очень понимаю смысл zvol, если пул уже создан..

Vladislav

Vladislav

Для этого надо сделать zvol на полученном страйпе 2+2? Или необязательно? Я не очень понимаю смысл zvol, если пул уже создан..

https://www.truenas.com/community/threads/addin-to-stripe-pool-of-2-disks-the-mirror-with-1-disk.90400/

Artem

Artem

Всё равно это выглядит как - давайте всё сделаем очень "странным" образом, а потом начнём удивляться "а где данные"

Δαρθ

Δαρθ

Всё равно это выглядит как - давайте всё сделаем очень "странным" образом, а потом начнём удивляться "а где данные"

кстати а просто 2 диска в 1 вдеве -- это уже страйп?

Arseniy

Arseniy

Всё равно это выглядит как - давайте всё сделаем очень "странным" образом, а потом начнём удивляться "а где данные"

В боевом варианте я так делать не собираюсь. Как раз для эксперимента и надо.

Создам миррор из 10Гб + ( страйп 5+5 Гб) на ВМ. Далее запишу файл, отключу один из 5Гб, массив сменит статус, затем я изыму второй 5Гб, после чего подсуну "новый" на 10Гб. По логике, должен позволить заменить страйп 5+5 на один 10Гб для восстановления mirror

Сергей

Сергей

Все как у живых, на другом сервере пул видит при попытке импорта повисает и валит ошибки примерно такие же, бывает другие

Сергей

Сергей

Может, он смр?

конкретно этот-да. но у меня цмр 8тб умирал точно так-же. даже два одновременно. при свободном месте ~60%

Сергей

Сергей

Можно позаимствовать ?)

https://nascompares.com/answer/list-of-wd-cmr-and-smr-hard-drives-hdd/

я вот этим списком пользуюсь

George

George

https://aws.amazon.com/blogs/gametech/vela-games-cuts-game-build-times-by-60-using-infrastructure-on-aws/

aws внедрила ZFS для своих шар

Vladislav

Vladislav

https://aws.amazon.com/blogs/gametech/vela-games-cuts-game-build-times-by-60-using-infrastructure-on-aws/

aws внедрила ZFS для своих шар

"simple, high-performance shared storage using Amazon FSx for OpenZFS"

"high-performance"

Хм

George

George

"simple, high-performance shared storage using Amazon FSx for OpenZFS"

"high-performance"

Хм

для больших shared posix FS zfs на самом деле не плох

Arseniy

Arseniy

Можно сделать бэкап метаданных и/или актуального TXG штатными средствами? На диск, который не относится к пулу?

Грубо говоря, сделать скрипт, чтобы после успешного scrub контрольные данные бэкапились

Fedor

Fedor

Можно сделать бэкап метаданных и/или актуального TXG штатными средствами? На диск, который не относится к пулу?

Грубо говоря, сделать скрипт, чтобы после успешного scrub контрольные данные бэкапились

Метаданные не имеют смысла без данных.

По мере использования любой блок может быть перезаписан, и метаданные тут ничего не дадут, так как сами данные потеряли целостность.

Arseniy

Arseniy

Согласен. Мысль была следующая: имеем два HDD в mirror + надёжный SSD с большим ресурсом перезаписи. Спустя время, если вдруг случится так, что TXG1!=TXG2, можно будет восстановиться на точке, когда был успешно пройден SCRUB, приняв бэкап TXG (с SSD) за последний удачный

Georg🎞️🎥

Georg🎞️🎥

Согласен. Мысль была следующая: имеем два HDD в mirror + надёжный SSD с большим ресурсом перезаписи. Спустя время, если вдруг случится так, что TXG1!=TXG2, можно будет восстановиться на точке, когда был успешно пройден SCRUB, приняв бэкап TXG (с SSD) за последний удачный

Или просто бэкап на ещё один диск ))) 2 не 50 благо )))

George

George

Объем тогда больше потребуется

в zfs нет инструментов "восстановить txg" с внешних данных, как и механизма "забекапить txg". Да и смысла мало, у вас txg каждые 5 секунд создаются. Нормальные бекапы, инкрементальная отправка через zfs send и всё ок

Arseniy

Arseniy

Просто попалась интересная статейка, она конечно уже древняя, но тем не менее.

https://www.lissyara.su/articles/freebsd/file_system/zfs_recovery/

Вот и подумал, как можно было бы решить такую проблему)

George

George

Просто попалась интересная статейка, она конечно уже древняя, но тем не менее.

https://www.lissyara.su/articles/freebsd/file_system/zfs_recovery/

Вот и подумал, как можно было бы решить такую проблему)

- с 2011-02-04 прошло больше 10 лет, в openzfs много патчей завезли с тех пор, можно даже пул нынче без 1 vdev на чтение открыть, конечно же без данных того самого пула. Как и описанный вариант в статье - можно форсом сказать "ищи последнюю живую txg и стартуй с неё"

George

George

в общем когда сбой технический и его можно обойти - такое в код надо внедрять. Спеки формата на диске тоже есть, если что

Arseniy

Arseniy

- с 2011-02-04 прошло больше 10 лет, в openzfs много патчей завезли с тех пор, можно даже пул нынче без 1 vdev на чтение открыть, конечно же без данных того самого пула. Как и описанный вариант в статье - можно форсом сказать "ищи последнюю живую txg и стартуй с неё"

Да, с патчами понятно. Просто перед началом боевого использования, хочется понять, где можно обосраться) и соломки подстелить по-возможности)

Сейчас тренируюсь "на кошках" по порче информации и восстановлению, чтоб в случае ЧП и не рвать волосы)

George

George

Да, с патчами понятно. Просто перед началом боевого использования, хочется понять, где можно обосраться) и соломки подстелить по-возможности)

Сейчас тренируюсь "на кошках" по порче информации и восстановлению, чтоб в случае ЧП и не рвать волосы)

бекапы всему голова, да) и не просто бекапы, а сверенные по содержимому

Arseniy

Arseniy

бекапы всему голова, да) и не просто бекапы, а сверенные по содержимому

Я к построению nas пришел, чтоб было куда бэкапы делать) а вы мне предлагаете делать бэкапы бэкапов)

George

George

Я к построению nas пришел, чтоб было куда бэкапы делать) а вы мне предлагаете делать бэкапы бэкапов)

ну тогда рисков немного меньше)

Vladislav

Vladislav

Я к построению nas пришел, чтоб было куда бэкапы делать) а вы мне предлагаете делать бэкапы бэкапов)

Все яйца сложил в одну корзину.

Vladislav

Vladislav

Я к построению nas пришел, чтоб было куда бэкапы делать) а вы мне предлагаете делать бэкапы бэкапов)

Ставите TrueNAS и не ебёте мозг

George

George

Я к построению nas пришел, чтоб было куда бэкапы делать) а вы мне предлагаете делать бэкапы бэкапов)

тренировки это правильно, особенно когда на формат на диске при этом ещё смотрите

George

George

но жизнь обосрёт всегда в неожиданном месте. 99% проблем будет с оборудованием, с zfs вы вдруг узнаете явно что оно врет)

Arseniy

Arseniy

Немного не в тему, но больше не у кого спросить.

Вот я знаю классический СИ, а синтаксис bash для меня не удобен. Можно ли писать скрипты на СИ, вызывая из-под терминала? Например, есть hddtemp. Хочу вызвать ее, спросить температуру dev/sda и затем результат записать в файлик. Можно ли как то прикрутить в терминал командный интерпретатор СИ?

Немного поясню. Не писать отдельно программу, компилировать ее через gcc, а по аналогии с bash-скриптаии, прям в консоли

George

George

Dmitry

Dmitry

Мне кажется, что структура языка подразумевает компиляцию, поэтому построчная интерпретация и не реализована до сих пор.

Но могу и ошибаться, конечно.

Vladimir

Vladimir

Немного не в тему, но больше не у кого спросить.

Вот я знаю классический СИ, а синтаксис bash для меня не удобен. Можно ли писать скрипты на СИ, вызывая из-под терминала? Например, есть hddtemp. Хочу вызвать ее, спросить температуру dev/sda и затем результат записать в файлик. Можно ли как то прикрутить в терминал командный интерпретатор СИ?

Немного поясню. Не писать отдельно программу, компилировать ее через gcc, а по аналогии с bash-скриптаии, прям в консоли

Tinyc умеет на лету вроде компилировать и сразу выполнять https://en.m.wikipedia.org/wiki/Tiny_C_Compiler

Arseniy

Arseniy

Господа, кто может уделить 5 минут драгоценнейшего времени и ответить на откровенно простые вопросы, которые все же вызывают у меня проблемы?)

Теги вопросов: Linux, TrueNas, ZFS, docker, VM. В общий чат даже стыдно писать, засорять умы экспертов) если не затруднит - прошу откликнуться в личку)

Олег

Олег

?

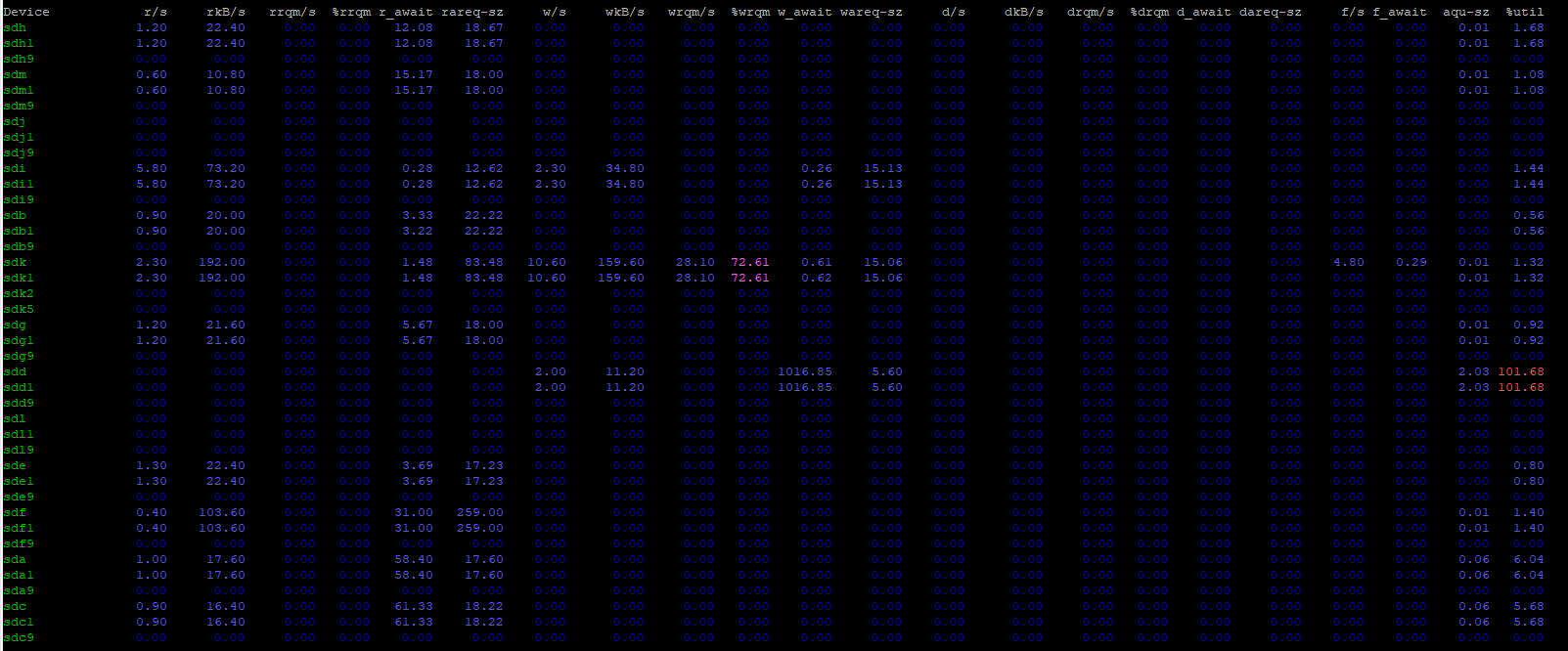

Ну тупо привык к одному синтаксису top, iostat, htop, а там половину не так и ключи имеют часто иное значение. Доходит до абсурдов чтобы получить показатели которые обычно занимает пару секунд ты проводишь с часок-два. Когда диагностика скорости не важна то это норм, а когда у тебя загруженная система то уже становится проблемой, неговоря о всяких sas3icru и других утилитах (простая подсветка диска). По сути нужно разобраться и внести в вики все диагностики и типичные доработки после того как с пару деньков поймешь что и как. Если perf, iostat, sar, sas3icru вам не играют значения то вполне модно обойтись и freenas (строго не скале, который по уровню багов и ограничений приближен к глубочайшей RC1 в лучшем случае)

Vladislav

Vladislav

Ну тупо привык к одному синтаксису top, iostat, htop, а там половину не так и ключи имеют часто иное значение. Доходит до абсурдов чтобы получить показатели которые обычно занимает пару секунд ты проводишь с часок-два. Когда диагностика скорости не важна то это норм, а когда у тебя загруженная система то уже становится проблемой, неговоря о всяких sas3icru и других утилитах (простая подсветка диска). По сути нужно разобраться и внести в вики все диагностики и типичные доработки после того как с пару деньков поймешь что и как. Если perf, iostat, sar, sas3icru вам не играют значения то вполне модно обойтись и freenas (строго не скале, который по уровню багов и ограничений приближен к глубочайшей RC1 в лучшем случае)

1) Человек использует ZoL для бэкапов

2) Если наебнулась основная система и бэкапы одновременно (потому что никто не проверял их сохранность), то тут не особо поможет траблушт

Arseniy

Arseniy

1) Человек использует ZoL для бэкапов

2) Если наебнулась основная система и бэкапы одновременно (потому что никто не проверял их сохранность), то тут не особо поможет траблушт

Сохранность бэкапов проверяется за счёт настраиваемого scrub. Что я не так планирую?)

Олег

Олег

1) Человек использует ZoL для бэкапов

2) Если наебнулась основная система и бэкапы одновременно (потому что никто не проверял их сохранность), то тут не особо поможет траблушт

1 Напрямую относится к задаче, как минимум скорость бекапа. Вы встречали что из-за одного вроде бы здорового диска массив работает на скорости 30% от своей скорости? iostat тут очень подходит как минимум (но тот вывод что в linux а не в Freenas), опять же пометка диска, опять же инструменты базовые тупо доступны не в том виде в котором ждешь

Vladislav

Vladislav

Сохранность бэкапов проверяется за счёт настраиваемого scrub. Что я не так планирую?)

Нет, сохранность бэкапов проверяется с помощью их восстановления

Vladislav

Vladislav

Нет, сохранность бэкапов проверяется с помощью их восстановления

В противном случае это бэкапы Шрёдингера

Vladislav

Vladislav

1 Напрямую относится к задаче, как минимум скорость бекапа. Вы встречали что из-за одного вроде бы здорового диска массив работает на скорости 30% от своей скорости? iostat тут очень подходит как минимум (но тот вывод что в linux а не в Freenas), опять же пометка диска, опять же инструменты базовые тупо доступны не в том виде в котором ждешь

TrueNAS имеет красивые графики в вебке для анализа

Arseniy

Arseniy

Эм. Я как то понимал себе это так: бэкап с системы сделан, заброшен на NAS. Он там лежит, ему там хорошо. Главное, чтобы данные не протухли. Проверять работоспособность бэкапа... Так можно начинать с момента, когда он был сделан)

Олег

Олег

Сохранность бэкапов проверяется за счёт настраиваемого scrub. Что я не так планирую?)

сохранность бекапов проверяется восстановлением тестовым переодически, а так же другие методы проверок, бекап программы их имеют. scrub это просто проверка что на диске лежит то что положено, просто сверка чексумм

Vladislav

Vladislav

Олег

Олег

График нагрузки на пул?

толку от загрузки на пул, первично загрузка диска, ОЗУ, процессора, и частенько контроллера

Arseniy

Arseniy

толку от загрузки на пул, первично загрузка диска, ОЗУ, процессора, и частенько контроллера

Разве криминально НЕ контролировать это в условиях сервака на 10 человек?) Раз в недельку чекать smart думал, и всё. Нагрузка на контроллер мне зачем? Я новичок, прошу не пинать сильно)

Олег

Олег

Разве криминально НЕ контролировать это в условиях сервака на 10 человек?) Раз в недельку чекать smart думал, и всё. Нагрузка на контроллер мне зачем? Я новичок, прошу не пинать сильно)

на 10 чел и синолоджи зайти может))) правда там скоростей нет как и диагностик почти совсем)))) Контролер при SSD становитсяя узким местом частенько, отсюда IT моде шьют и получают иногда 10 кратные раницы даже на гавненых samsung pro. Берете контроллер встроенный в мать шьете в IT который официально вроде не поддерживается, но вы шьете чип тот же 3408 и имеете разницу. вообще по скорости массивов можно очень много писать, начиная от типа подключения дисков

Олег

Олег

Разве криминально НЕ контролировать это в условиях сервака на 10 человек?) Раз в недельку чекать smart думал, и всё. Нагрузка на контроллер мне зачем? Я новичок, прошу не пинать сильно)

SMART часто врет, тот же Seagate почти сразу ошибок срет немеренно, но это не значит что он не работает или работает медленно

Олег

Олег

на 10 чел и синолоджи зайти может))) правда там скоростей нет как и диагностик почти совсем)))) Контролер при SSD становитсяя узким местом частенько, отсюда IT моде шьют и получают иногда 10 кратные раницы даже на гавненых samsung pro. Берете контроллер встроенный в мать шьете в IT который официально вроде не поддерживается, но вы шьете чип тот же 3408 и имеете разницу. вообще по скорости массивов можно очень много писать, начиная от типа подключения дисков

официально не поддерживается имеется ввиду что в BIOS матерях на сайте не выложено и ничего не сказано

Arseniy

Arseniy

У меня ssd лишь для ОС хоста. Остальное - hdd.

Вы меня искушаете TrueNas'ом, который очень понравился, если бы не одно но - отсутствие кастомизации. Непонятно что можно сделать и как. Встроенные утилиты диагностики, кроме smart, разве какие то там есть? Что то не нашел. Smb поднять можно только один. Пароль от пользователей задать может лишь админ из-под root'a... Начал щупать Линукс. Решил первую проблему: настроил работу кулера обдува в зависимости от температуры HDD - вот она, простота! К сожалению, пока туплю с ACL на Linux, хотя в TrueNas все готово в этом плане . Опять же, в Linux Я могу создать несколько smb/ftp под каждого пользователя, а не заниматься разграничением каталогов на общем ресурсе

P

Олег

Олег

У меня ssd лишь для ОС хоста. Остальное - hdd.

Вы меня искушаете TrueNas'ом, который очень понравился, если бы не одно но - отсутствие кастомизации. Непонятно что можно сделать и как. Встроенные утилиты диагностики, кроме smart, разве какие то там есть? Что то не нашел. Smb поднять можно только один. Пароль от пользователей задать может лишь админ из-под root'a... Начал щупать Линукс. Решил первую проблему: настроил работу кулера обдува в зависимости от температуры HDD - вот она, простота! К сожалению, пока туплю с ACL на Linux, хотя в TrueNas все готово в этом плане . Опять же, в Linux Я могу создать несколько smb/ftp под каждого пользователя, а не заниматься разграничением каталогов на общем ресурсе

P

при данном уровне знаний freenas ставьте и не парьтесь, все кастомизированно и красиво без лишних вопросов

Олег

Олег

По этой идеологии они и scale свой убили, в демках тот же insecurity nfs ставить можно, после обновления на релиз все к чертям слетело

Arseniy

Arseniy

Не могу я там настроить работу кулера, в зависимости от температуры HDD. Нет там такой возможности, система порезана

Олег

Олег

Не могу я там настроить работу кулера, в зависимости от температуры HDD. Нет там такой возможности, система порезана

не порезана а кастомизированна, многое не реализованно, простейшая пометка диска