Я за 6 два взял ))) а тут 4к один ))

ух блин. это круть

Georg🎞️🎥

Georg🎞️🎥

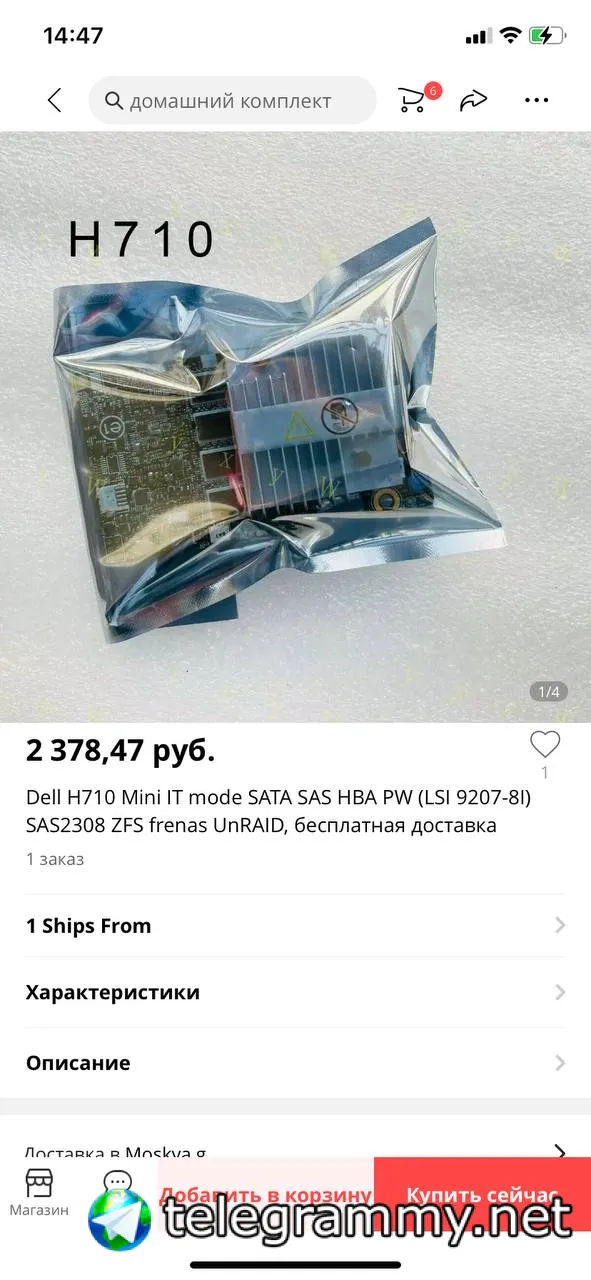

в мск уже по 4к камни, тушку правда 720xd советую

Да, 720xd взял на зип)) сейчас тестирую 👋👍👍

Oleg

Oleg

Всем спаибо за советы и идеи, проблема со скоростью решилась, к сожалению я не выяснил ни причины ни способ устранения, единственное что я сделал переинициализировал рейд.

Vladislav

Vladislav

Всем спаибо за советы и идеи, проблема со скоростью решилась, к сожалению я не выяснил ни причины ни способ устранения, единственное что я сделал переинициализировал рейд.

Диффы снапшотов системы позволят выяснить это софт или хард глюки.

Vladislav

Vladislav

Vladislav

Vladislav

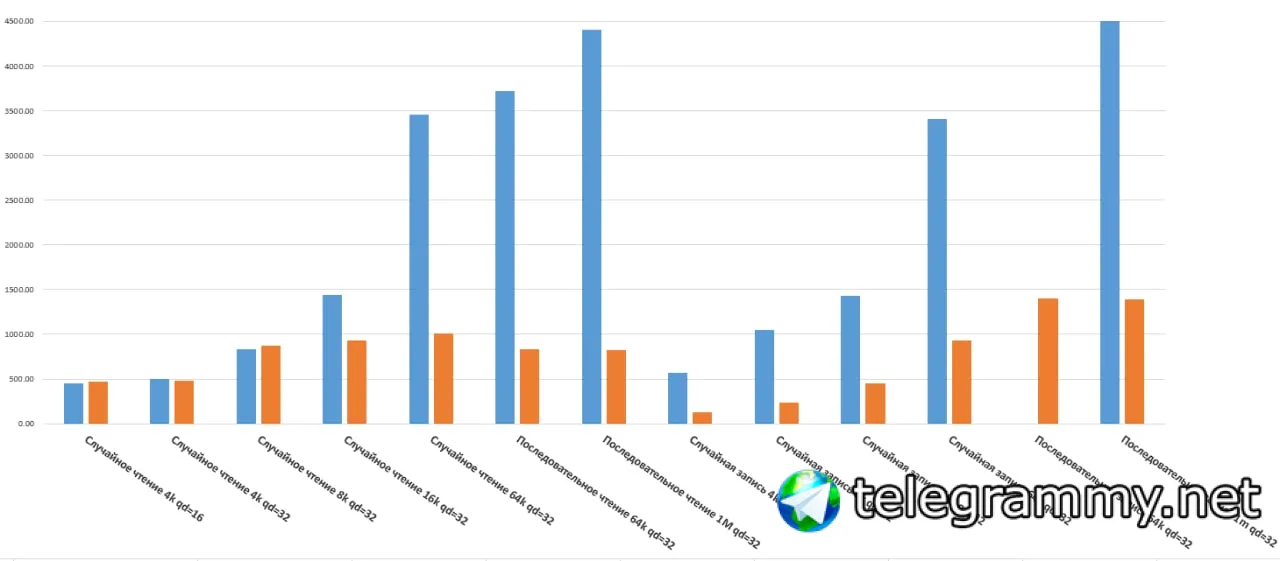

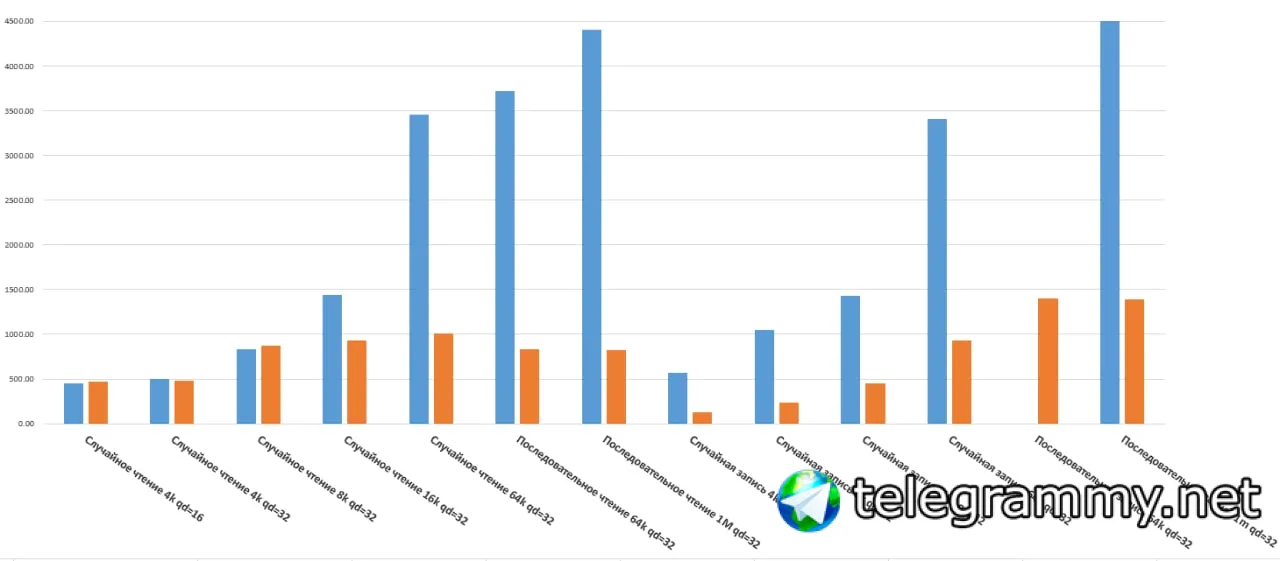

Zfs очевидно тяжелее mdadm. Но вообще совсем непонятен конфиг железа. Зеркало или как?

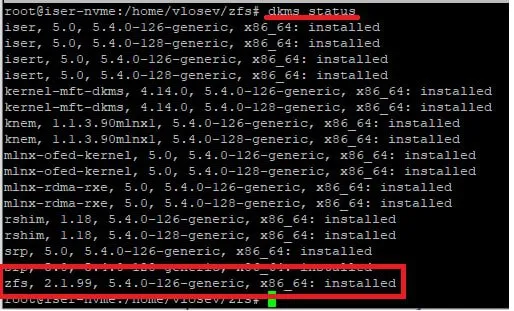

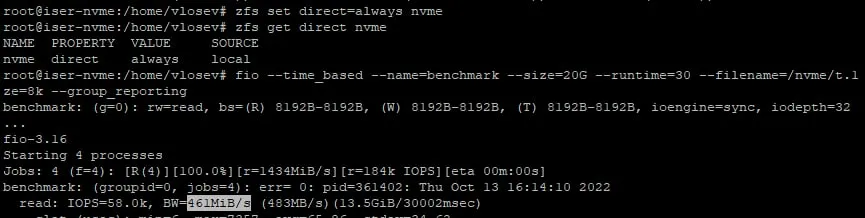

А это, сервер c ZFS:

supermicro X9DRI-f

Intel Xeon E5-2670v2 2.5GHz x2

224GB DDR3

M.2 pcie switch

U.2 pcie switch

-KINGSTON SKC2500M81000G

-KINGSTON SKC2500M81000G

-Samsung SSD 983 DCT M.2 960GB

-Samsung SSD 983 DCT M.2 960GB

-SAMSUNG MZVLB1T0HBLR-000L7

-SAMSUNG MZQL2960HCJR-00A07

И всё в raid0 (ака страйп), потому что рейд на nvme дисках имеет смысл собирать только для важных систем, а это лишь лаба с бэкапами раз в сутки

Pavel

Pavel

Сжатие

Толку никакого не будет от сжатия. Тем более не такой судя по всему обьем данных. Включай дедуплекацию. Оперативки много

Vladislav

Vladislav

И дедуп

когда у тебя 8 машин Active Directory от разных людей по 50ГБ каждая - и 3-4 Exchange сервера и один DAG кластер - это видится как неплохая идея для экономии места

Artem

Artem

Проще дисков докидать, если иначе никак. Zfs - не про скорость. Но каждый решает, как ему удобнее, и дешевле

Vladislav

Vladislav

Проще дисков докидать, если иначе никак. Zfs - не про скорость. Но каждый решает, как ему удобнее, и дешевле

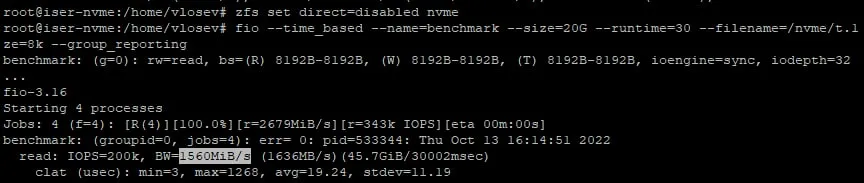

Не про скорость. До 3.0

И как только диски nvme будут стоять достаточно мало, чтобы можно было просто "докинуть их", это будет иметь смысл

Vladislav

Vladislav

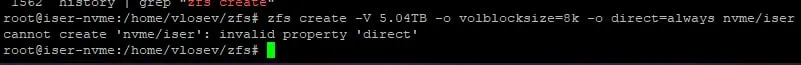

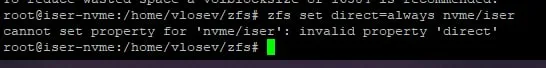

Ладно, я думал по фразе iSER, mdadm и zvolblock будет очевидно...

И то и другое как блочка выданы для хоста

Vladislav

Vladislav

И я не говорю, что поинт про чексуммы vs их отсутствие не валидный. И тем более не говорю, что ZFS должен быть "быстрее" чем raid0 mdadm

Ivan

Ivan

Ivan

Ivan

Потому что mdadm выдаёт мне нормальное блочное устройство

да, но на одну абстракцию меньше получается

Vladislav

Vladislav

иначе как-то совсем несопоставимо по фичам

lvo требует тонкое выделение, а тонкое выделение лишняя головная боль

Плюс, 2 основных вопроса на который несут ответы эти тесты

"Сколько % производительно до версии 3.0 Вы готовы пожертвовать ради фич ZFS?"

"Насколько 3.0 станет лучше для nvme дисков в реальности"

central

central

Vladislav

Vladislav

Уже раз сто было, тройку бы хоть тестил как менее заезженную

Я планировал это дополнить после официального релиза, чем насиловаться с внесением форка, который ломает автоматический билд

central

central

Я планировал это дополнить после официального релиза, чем насиловаться с внесением форка, который ломает автоматический билд

код фикс для нвме никто уже менять не будет, изменения в производительности от того что уже есть не ожидается

Vladislav

Vladislav

код фикс для нвме никто уже менять не будет, изменения в производительности от того что уже есть не ожидается

Фикса да, а вот для починки автоматического билда и прохождения тестов поменять что-то да придётся

Vladislav

Vladislav

код фикс для нвме никто уже менять не будет, изменения в производительности от того что уже есть не ожидается

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Vladislav

Безопасно ли удалить кучу снапшотов которые убунта зачемто сама делает на rpool?

Стоп, Вы же уже спрашивали

Egor

Egor

у кого есть убунта с зфс? - как там ненужные снапшоты удалить и не опасно ли?

Думаю как и везде:

zfs list -t snapshot -o name -S creation -H | grep/head/tail ... | xargs -n1 zfs destroy

Vladislav

Vladislav

у кого есть убунта с зфс? - как там ненужные снапшоты удалить и не опасно ли?

Как минимум я привёл ссылку почему они создаются. Если Вы знаете почему они создаются - Вы можете оценить опасность их удаления

Vladislav

Vladislav

Много их

Вам ведь ответили, что значит никто не знает

Но учитывая, что Вы спрашиваете в третий раз и в третий раз игнорируете ответы данные ранее - с Вашими знаниями - небезопасно.

Δαρθ

Δαρθ

у кого есть убунта с зфс? - как там ненужные снапшоты удалить и не опасно ли?

в смысле с рутом на зфс?

Vladislav

Vladislav

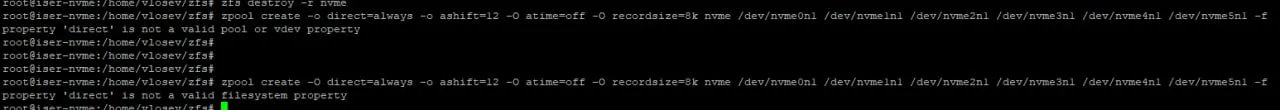

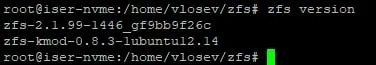

так он ещё в виде PR только, что вы пытаетесь с мастером сделать?

Я осознал проблему, я умудрился сделать configure на 2.1.6, а make уже после git fetch commit

George

George

Я осознал проблему, я умудрился сделать configure на 2.1.6, а make уже после git fetch commit

если не с нуля между ветками переключаетесь, то стоит делать полную очистку через тот же git clean

Vladislav

Vladislav

если не с нуля между ветками переключаетесь, то стоит делать полную очистку через тот же git clean

Да. Я уже выкачал репозиторий с нуля, так и осознал проблему

Vladislav

Vladislav

Да. Я уже выкачал репозиторий с нуля, так и осознал проблему

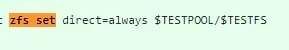

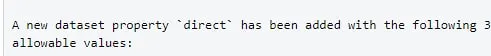

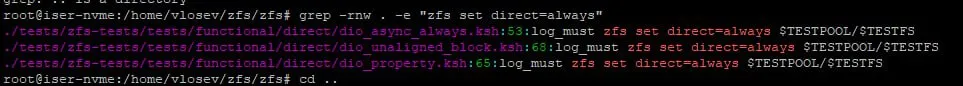

и тут я выяснил, что там ещё нет патча для volume, только для ФС

Georg🎞️🎥

Georg🎞️🎥

Скажите 👋плиз ))

Как заставить arc2 принудительно кэшировать линейное потоковое чтение ? Что то те Команды , что нагуглил - не включают :(((

Vladislav

Vladislav

код фикс для нвме никто уже менять не будет, изменения в производительности от того что уже есть не ожидается

Vladislav

Vladislav

konflicker

konflicker

Art

Art