А уже спрашивали не raidz ли под ним?

6 дисков в stripe

Экспериментальном путём - в моём случае dataset отожрал 0.16Т

(А zpool - 0.12Т)

Владимир

Владимир

Безопасно ли удалить кучу снапшотов которые убунта зачемто сама делает на rpool?

Само по себе ничего не делается

Vladislav

Vladislav

Безопасно ли удалить кучу снапшотов которые убунта зачемто сама делает на rpool?

Прочтите зачем это делается

https://arstechnica.com/gadgets/2020/03/ubuntu-20-04s-zsys-adds-zfs-snapshots-to-package-management/

Vladislav

Vladislav

когда планируется оф. поддержка 5.19 ?

а то ядро есть а официально зфс его не алё

В 3.0?

А если без рофлов - судя по динамике релизов на этой неделе

Δαρθ

Δαρθ

В 3.0?

А если без рофлов - судя по динамике релизов на этой неделе

да где угодно, лишь бы я смог в генте переползти на свежее ядро )

Ivan

Ivan

да где угодно, лишь бы я смог в генте переползти на свежее ядро )

чтож там за мегафичи такие, что нужно срочно новое ядро ?

Pavel

Pavel

Добрый день, у кого то есть опыт использования vdev для дедупликации? есть ли какая то кардинальная разница в производительности?

Алексей

Алексей

Pavel

Pavel

Опыт есть. Разница кардинально

ну а так в двух словах можете что то сказать ) просто протестировать не на чем, а в прод сразу пихать пока страшно

Алексей

Алексей

вы для чего используете?

использую под удалённый репозиторий veeam чтобы хранить почти вечно бэкапы

Алексей

Алексей

ну а так в двух словах можете что то сказать ) просто протестировать не на чем, а в прод сразу пихать пока страшно

в двух словах могу сказать что я в восторге

Pavel

Pavel

использую под удалённый репозиторий veeam чтобы хранить почти вечно бэкапы

хорошо дедуплицирует? просто на тесте прогнали несколько копий вима закинули уровень дедупликации не впечатлил, возможно что то не так делали.

Ivan

Ivan

использую под удалённый репозиторий veeam чтобы хранить почти вечно бэкапы

у них разве нет встроенной консолидации ?

Алексей

Алексей

просто так закидывать копии вима бесполезно, надо распаковывать данные и убрать шифрование вимовское

Roman

Roman

когда планируется оф. поддержка 5.19 ?

а то ядро есть а официально зфс его не алё

на 5.19 в федоре работает

Алексей

Алексей

ну и там еще можно поиграться с размером рекордсайз (храню в датасетах, а не в zvol) для дедупликации. тк как у меня железо можно сказать десктопное, я сделал размер 512k - так получается меньше меты и меньше блоков для дедупликации, соответственно нагрузка на дедуп/спешл железку падает, да и вообще 512к на будущее достаточно большой блок сильно скорость падать не будет при фрагментации

Алексей

Алексей

поэтому шифрование я сделал луксом, а сжатие зфсом

а шифрование зфс - это какая то богомерзкая ужасть, я честно хотел сделать зфсом, но по непонятной мне причине шифрование увеличивает количество затрачиваемых иопсов на блинах в 4 раза по сравнению с вариантом без шифрования

central

central

central

central

ну алгоритм шифрования не может шифровать произвольный обьем данных, он блоками шифрует, и вот может ли быть ситуация что размер блока у шифра не совпадет с размером блока у zfs

Алексей

Алексей

если мы говорим про шифрование зфс - то я не в курсе, думал это регулируется рекордсайзом только

central

central

Безопасно ли удалить кучу снапшотов которые убунта зачемто сама делает на rpool?

сколько их? максимум получите деградацию IO на время удаления

Δαρθ

Δαρθ

чтож там за мегафичи такие, что нужно срочно новое ядро ?

хз что за фичи, но например ntfs безбожно глючит в 5.15 и 5.18

Δαρθ

Δαρθ

Можно мастера забилдить

забилдить можно. но хочется искаропки. а искаропки оно там когда появляется релиз на openzfs

Egor

Egor

Привет всем.

Подскажите, если на 2 ВМ есть одинаковые пул и датасет, на 1й ВМ куча снапшотов а на 2й нет ни одного (данные близки, но различаются - копия веб-сервера, на первой он запущен, на второй - нет).

Вопрос: если я с первой ВМ передам снапшот на вторую, с опцией zfs recv -F, то правильно я понимаю что на второй ВМ датасет придёт в состояние как на первой на момент передачи этого снапшота?

Алексей

Алексей

Привет всем.

Подскажите, если на 2 ВМ есть одинаковые пул и датасет, на 1й ВМ куча снапшотов а на 2й нет ни одного (данные близки, но различаются - копия веб-сервера, на первой он запущен, на второй - нет).

Вопрос: если я с первой ВМ передам снапшот на вторую, с опцией zfs recv -F, то правильно я понимаю что на второй ВМ датасет придёт в состояние как на первой на момент передачи этого снапшота?

Мне кажется он либо просто перезапишет заново с нуля, либо откажется

Egor

Egor

точно не отказывается, значит надо понять, перезапысывает ли он полностью данные или только дельту передаёт

inqfen

inqfen

точно не отказывается, значит надо понять, перезапысывает ли он полностью данные или только дельту передаёт

zfs не оперирует тем “похожие данные” или нет

Art

Art

Надо синк на уровне файлов - lsyncd например

вариант, но тогда он вечно на нём и останется, пулы же так не придут в синхронное состояние

inqfen

inqfen

вариант, но тогда он вечно на нём и останется, пулы же так не придут в синхронное состояние

ну так у человека 2 разных машины и как я понимаю это active-backup серверы просто

inqfen

inqfen

так то синхронизированные датасеты нужны, для эффективной репликации данных

zfs не умеет именно синхронизироваться, только раз в n времени догонять состояние будешь

Юрий

Юрий

У меня на ZFS находятся диски виртуальных машин KVM, на каждом датасете 1-2 больших файла, которые меняются постоянно. Копировать целиком эти файлы не вариант. Синхронизация датасетов между хостами происходит в реальном времени ежесекундно.

Юрий

Юрий

При каком то серьезном сбое одной из железяк, могу запустить актуальные виртуалки на другой железке.

inqfen

inqfen

При каком то серьезном сбое одной из железяк, могу запустить актуальные виртуалки на другой железке.

Не актуальные и не верифицируемые фс

Юрий

Юрий

точно не отказывается, значит надо понять, перезапысывает ли он полностью данные или только дельту передаёт

Попробуй добавить к send и recv ключ -v. По крайней мере будет видно подробный отчет и количество передаваемых данных.

Maverick

Maverick

Коллеги. Подскажите пожалуйста, будет ли работать дедупликация на zfs с шифрованием... Или в этом мне кажетьсЯ нет смысла?

Vladislav

Vladislav

Andrey

Andrey

Коллеги. Подскажите пожалуйста, будет ли работать дедупликация на zfs с шифрованием... Или в этом мне кажетьсЯ нет смысла?

будет, но там есть вопрос к надежности шифрования

Andrey

Andrey

https://www.hiddmond.com/threads/luks-ecryptfs-ili-shifrovanie-zfs-vybiraem-sposob-zaschity-dannyx-v-linux.315/#post-480

Алексей

Алексей

Коллеги. Подскажите пожалуйста, будет ли работать дедупликация на zfs с шифрованием... Или в этом мне кажетьсЯ нет смысла?

будет. если шифрует зфс или фс а не бэкапилка

Sergey

Sergey

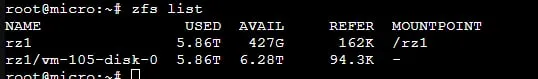

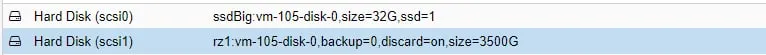

Всем доброго дня. Подскажите. Делаю массив raidz из 7 дисков 1,2тб. Создаю на нем диск ВМ(проксмокс). Только диск почему то отбирает почти все пространство зфс, хотя диск создаю на 3,5тб.

Fedor

Fedor