star

star

Тут есть ютаберы? Кто неть запилите пж подробное видео кто блть эти ваши raidz, и чем они лучше и надежнее обычного рейда?

Ivan

Ivan

Тут есть ютаберы? Кто неть запилите пж подробное видео кто блть эти ваши raidz, и чем они лучше и надежнее обычного рейда?

https://www.youtube.com/watch?v=-AnkHc7N0zM

Vladimir

Vladimir

ну это не сравнение как таковое , а просто вот вам новая система на новом железе и новой FS она супер быстрая

есть одна система с SATA девайсами - ежели интересно, Nvidia DGX-1, в неё воткнуты 4 штуки. А рядом стоит массив с 6ю NVMEe девайсами подключенный по Inifiniband , вопрос юзеров - можно данные хранить на NVME и гнать на DGX-1 по NFS или надо их сначала на локальный SATA SSD перегонять.

Алексей

Алексей

товарищи вопрос из разряда TL4G:

как лучше обращаться к scsi устройствам, через /dev/sgXX или есть другие варианты?

lsblk -o NAME,ROTA,TYPE -p | grep '1 disk' | awk '{print $1}'

Михаил

Михаил

есть одна система с SATA девайсами - ежели интересно, Nvidia DGX-1, в неё воткнуты 4 штуки. А рядом стоит массив с 6ю NVMEe девайсами подключенный по Inifiniband , вопрос юзеров - можно данные хранить на NVME и гнать на DGX-1 по NFS или надо их сначала на локальный SATA SSD перегонять.

если честно IB не юзал ниразу , вашпе ничего сказать не могу , но я так понимаю NFS для множественного доступа а как бекенд ZFS ?

Vladimir

Vladimir

если честно IB не юзал ниразу , вашпе ничего сказать не могу , но я так понимаю NFS для множественного доступа а как бекенд ZFS ?

Да, так и есть. Infiniband просто в режиме Ethernet 100Gb работает.

Михаил

Михаил

Смотря какой профиль нагрузки конечно, но у меня был успешный опыт лвм страйп + dmcache и iscsi к клиенту думаю в вашем случае кеш и скази не нужны , но лвм страйп мне понравился

ArcticFox

ArcticFox

Alex

Alex

Да, так и есть. Infiniband просто в режиме Ethernet 100Gb работает.

Есть ещё вариант NFS over ROCE (RDMA) вместо NFS IPoIB.

Vladimir

Vladimir

Есть ещё вариант NFS over ROCE (RDMA) вместо NFS IPoIB.

Пробовал, работает быстрее но не стабильно на нашем железе. Примерно раз в неделю kernel error, и все отваливается.

Shaker

Shaker

Alex

Alex

Vladimir

Vladimir

Дистриб какой ?

NVIDIA DGX Server OS , на основе Ubuntu 20.04., но пробовал на более старой версии. На второй машине тоже убунту. Но дело в фирмваре карточек - разные версии.

Vladimir

Vladimir

что за железо ?

клиент - Nvidia DGX-1, Mellanox ConnectX-4 VPI MCX455A-ECAT x4

сервер - SYS-2029U-TN24R4T, а вот Infiniband карточка там какая-то снятая уже с производства Supermicro, MT27700 Family ConnectX-4 и когда со всем этим делом игрался фирмверы совеременной для неё не было.

Animal

Animal

всем привет. мб я затупил )) простой пул состоящий из 2х фалов. если сделать экспорт пула а потом его импорт (по его имени) то выдает - хер, нет такого пула. попытка создать новый пул из этих же 2х файлов говорит "эти файлы уже являются частью пула ИМЯ, используй опцию -f" Ессно если использовать опцию то создастся чистый пул. Сабж - как импортировать такой пул взяд ? )) Спасибо

Ivan

Ivan

Animal

Animal

попробуй указать id пула

логично но "cannot import '554459960243577731': no such pool available"

George

George

всем привет. мб я затупил )) простой пул состоящий из 2х фалов. если сделать экспорт пула а потом его импорт (по его имени) то выдает - хер, нет такого пула. попытка создать новый пул из этих же 2х файлов говорит "эти файлы уже являются частью пула ИМЯ, используй опцию -f" Ессно если использовать опцию то создастся чистый пул. Сабж - как импортировать такой пул взяд ? )) Спасибо

-d /путь/до/директории/с/файлами нужно добавить

Станислав

Станислав

всем привет. мб я затупил )) простой пул состоящий из 2х фалов. если сделать экспорт пула а потом его импорт (по его имени) то выдает - хер, нет такого пула. попытка создать новый пул из этих же 2х файлов говорит "эти файлы уже являются частью пула ИМЯ, используй опцию -f" Ессно если использовать опцию то создастся чистый пул. Сабж - как импортировать такой пул взяд ? )) Спасибо

Когда импорт вызываешь только с названием пула, то утилита смотрит на диски и разделы, не содержат ли они меток ZFS. Т.е. не в другую ФС и, тем более, не проверяет все файлы. Это значит, что нужно указать, чтобы zpool искал эти метки в конкретных файлах

Δαρθ

Δαρθ

насколько бредово показывает du вот тут?

$ du -hd1 .

857K ./result

865K ./7z_best

913K ./zip

881K ./zip_best

889K ./7z

4.4M .

$ ls result/

$

$ zfs version

zfs-2.1.5-r5-gentoo

zfs-kmod-2.1.5-r1-gentoo

в директориях было ~14 тыщ файлов в каждой, некоторые хардлинки, такое видно после удаления всех файлов

Владимир

Владимир

или реально остаток-директория жрёт место зазря?

так ты посмотри содержимое директории что там кушает

Fedor

Fedor

Директория вполне может есть место, если в ней много файлов - на все файлы надо создать ссылки

А вот что происходит с ней после очистки - надо смотреть уже в реализации ФС

Dmitriy

Dmitriy

Коллеги, доброго вечера

никто не сталкивался с адаптацией ZIO для работы zfs на SSD с TLC/QLC NAND с небольшим SLC/DRAM кэшем

после заполнения SLC кэша, скорость vdev резко падает - растете латенси и очередь

возможно ли адаптировать планировщик под такой сценарий?

Art

Art

Коллеги, доброго вечера

никто не сталкивался с адаптацией ZIO для работы zfs на SSD с TLC/QLC NAND с небольшим SLC/DRAM кэшем

после заполнения SLC кэша, скорость vdev резко падает - растете латенси и очередь

возможно ли адаптировать планировщик под такой сценарий?

сомневаюсь, что такой недостаток железа можно как-то компенсировать... Если только добавить в пул жирный и быстрый ССД в качестве SLOG-девайса ?

А как именно вы пишете в пул, что возникает такая проблема? У вас запись 24/7 и на высокой скорости?

Dmitriy

Dmitriy

10гб принимают на нормальной скорости - потом задействуется медленный NAND - скорость резко падает, а система начинает сильно замирать

George

George

Коллеги, доброго вечера

никто не сталкивался с адаптацией ZIO для работы zfs на SSD с TLC/QLC NAND с небольшим SLC/DRAM кэшем

после заполнения SLC кэша, скорость vdev резко падает - растете латенси и очередь

возможно ли адаптировать планировщик под такой сценарий?

Только если txg реже закрывать, и то понимая последствия, в остальном никак запись не уменьшишь же фактическую

Dmitriy

Dmitriy

Только если txg реже закрывать, и то понимая последствия, в остальном никак запись не уменьшишь же фактическую

txg - это понятно

изменением zfs_vdev_aggregation_limit_non_rotating, zfs_dirty_data_sync_percent, zfs_delay_scale, zfs_vdev_async_write_max_active

добился при длительной последовательной записи iowait на пул в пределах 10-15%

Alexandr

Alexandr

Лучше выкинуть эти ссд, и поставить даже бу серверные, иначе это ни к чему хорошему не приведет

George

George

txg - это понятно

изменением zfs_vdev_aggregation_limit_non_rotating, zfs_dirty_data_sync_percent, zfs_delay_scale, zfs_vdev_async_write_max_active

добился при длительной последовательной записи iowait на пул в пределах 10-15%

Ну экономить на записи можно только на перезаписи тех же блоков плюс сбросом за раз батчем данных, что уже сделано. Можно чуть уменьшить иопсы через redundant_metadata. В общем то всё. Ну сжатие ещё)

Dmitriy

Dmitriy

Dmitriy

Dmitriy

Лучше выкинуть эти ссд, и поставить даже бу серверные, иначе это ни к чему хорошему не приведет

сценарий для сервера - в основном пачка вм с микросервисами

Alexandr

Alexandr

Неважно, этот ссд просто не предназначен для таких задач, я вам не рекомендую его в продакшене использовать

George

George

redundant_metadata это что?

См маны https://openzfs.github.io/openzfs-docs/search.html?q=Redundant_metadata&check_keywords=yes&area=default#

Dmitriy

Dmitriy

См маны https://openzfs.github.io/openzfs-docs/search.html?q=Redundant_metadata&check_keywords=yes&area=default#

так это на уровне датасета - не пула. попробую

Art

Art

10гб принимают на нормальной скорости - потом задействуется медленный NAND - скорость резко падает, а система начинает сильно замирать

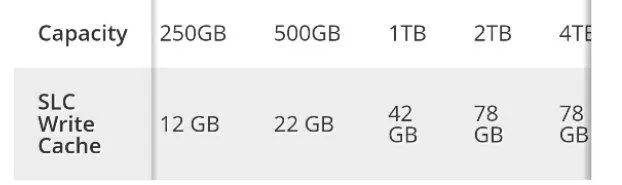

10 гб?? Что-то экстремально мало. Даже у 250 гб модели slc-кэш 12 гб

И это не говоря уже о такой штуке как псевдо-slc

А о какой нормальной скорости мы говорим, и как она падает после 10 гб записи?

Art

Art

Dmitriy

Dmitriy

Art

Art

видимо я был не внимателен - пока тестировал fio

тесты шли на 50ГБ файлах - скорее всего, выбрал весь кэш

Понял. Ну тут вопрос в общем насколько всё-таки дропается скорость после исчерпания slc-кэша?

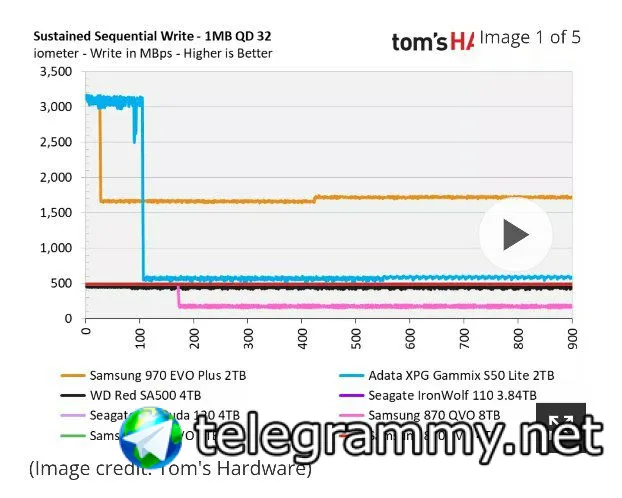

Я сейчас глянул тест 4ТБ-версии 870 EVO - диск держит 500 МБ в сек в течении 15 мин (не факт, что это предел, просто тест такой)

Если у вас меньше, то я бы подумал... не знаю даже на что) Надо локализовать проблему

Если есть свободный такой диск, то потестите его в фио без зфс, а прямо как девайс, то есть /dev/sdx

Art

Art

Vladislav

Vladislav

видимо я был не внимателен - пока тестировал fio

тесты шли на 50ГБ файлах - скорее всего, выбрал весь кэш

Если уж тестить обычные ssd - то обычно имеет смысл Full Write делать или по времени гонять

Vladislav

Vladislav