Евгений

Евгений

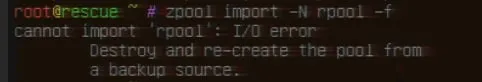

Всем привет, был ZFS mirror, удалил ез него 1 сбойный диск.

zpool status -v

стал показывать что в пуле 1 диск и слово Mirror исчезло.

заменил сбойный диск, запустил сервак и не может импортировать пул I/O error

что можно сделать?

Ivan

Ivan

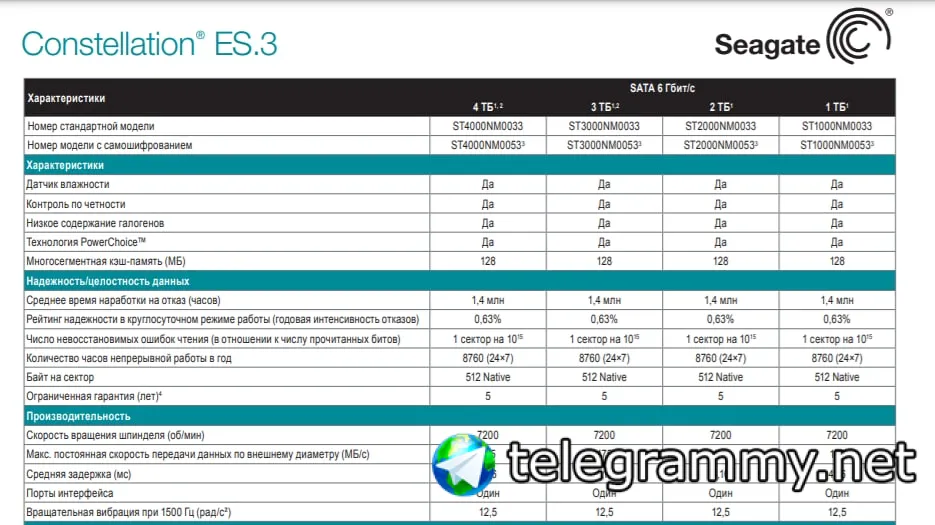

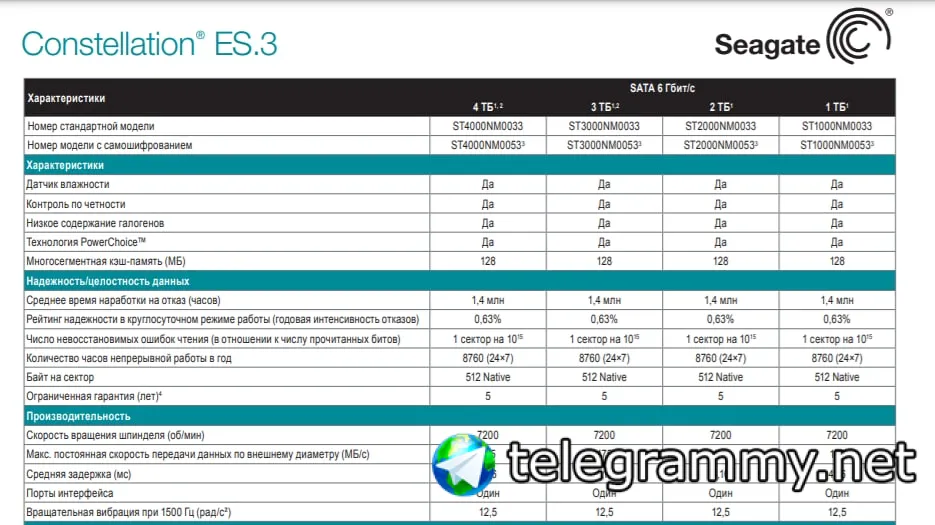

а мы именно спеки смотрели, на сайте

мб на самом деле винт оперирует блоками 4к, а 512 он кушает чтоб ретро-оси и ретро-железо поддерживать.

Евгений

Евгений

Art

Art

мб на самом деле винт оперирует блоками 4к, а 512 он кушает чтоб ретро-оси и ретро-железо поддерживать.

Ivan

Ivan

George

George

Art

Art

ты от ашифта 9 ничего не потерял, но судя по всему ничего не приобрёл. Возможно имеет смысл переделать на 12 всё-таки.

Раз @gmelikov это рекомендует и ты ещё не ввёл пул в оборот. Чтобы в будущем можно было менять диски в пуле свободно, не выискивая где взять 512n диски. А в остальном разницы нет.

George

George

ты от ашифта 9 ничего не потерял, но судя по всему ничего не приобрёл. Возможно имеет смысл переделать на 12 всё-таки.

Раз @gmelikov это рекомендует и ты ещё не ввёл пул в оборот. Чтобы в будущем можно было менять диски в пуле свободно, не выискивая где взять 512n диски. А в остальном разницы нет.

Проще всего понять реальность блока, запустивь fio на нём

George

George

zpool detach

не лучший путь замены диска, на будущее лучше добавлять новый диск рядом и делать replace

Art

Art

Проще всего понять реальность блока, запустивь fio на нём

о, а не подскажете как? Потому что ССД все врут и в спеках ничего не пишут

Евгений

Евгений

не лучший путь замены диска, на будущее лучше добавлять новый диск рядом и делать replace

так если это хостер, там нет третьего nvme слота

George

George

по io error надо смотреть жив ли диск и тд, есть вероятность что очень не повезло и он тоже умирает

George

George

так если это хостер, там нет третьего nvme слота

ну тогда разница небольшая, да, но detach не нужен всё равно. Можно ничего не делать и не найдённый диск реплейсить просто, можно offline сделать

George

George

о, а не подскажете как? Потому что ССД все врут и в спеках ничего не пишут

тесты fio с конкретным размером блока, смотреть есть ли просадка при записи 512B блоком

George

George

сейчас что можно сделать?

dd диска с данными на чистый?

dmesg на ошибки и смарт диска глянуть для начала

A1EF

A1EF

ну тогда разница небольшая, да, но detach не нужен всё равно. Можно ничего не делать и не найдённый диск реплейсить просто, можно offline сделать

Любопытно, а вообще от чего-то страхует offline? Обычно при замене диска всегда предварительно его оффлайню, но может это в этом вообще нет необходимости?

George

George

а можно как-то без импорта смотреть стату пула?

zpool import без аргументов покажет минимум сами пулы, не помню что ещё, ну и zdb изучать

George

George

Любопытно, а вообще от чего-то страхует offline? Обычно при замене диска всегда предварительно его оффлайню, но может это в этом вообще нет необходимости?

от лишних задержек, zfs не моментально посчитает что диска больше нет, а при offline можно этого полностью избежать

Евгений

Евгений

zpool import -N -f -FX -d /dev/disk/by-id/nvme-eui.0025388611b04275-part3 rpool

cannot import 'rpool': one or more devices is currently unavailable

LordMerlin

LordMerlin

Кстааааати. Вдогонку пока не заветрилось обсуждение планировщиков и кэшей.

В Проксмокс, на дисках которые лежат на ZFS лучше ставить кэширование "Default (no cache)" ?

Чтобы не было пирога из системного кэша и ARC

Владимир

Владимир

Ivan

Ivan

Кстааааати. Вдогонку пока не заветрилось обсуждение планировщиков и кэшей.

В Проксмокс, на дисках которые лежат на ZFS лучше ставить кэширование "Default (no cache)" ?

Чтобы не было пирога из системного кэша и ARC

оно вообще всегда лучше, кроме разве что ceph, где рекомендуют именно writeback.

LordMerlin

LordMerlin

Тоесть идеология такая, что даже если ЕХТ4, то все равно давать кэширование на откуп системе гостя, не хосту.

Ivan

Ivan

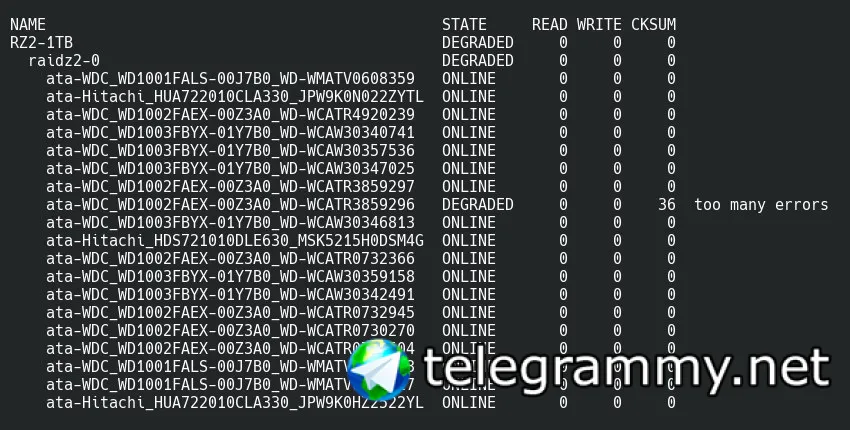

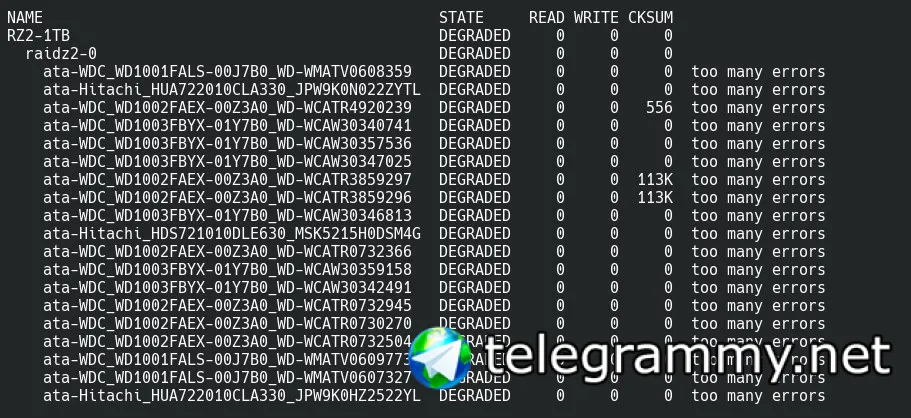

странно получается, что один диск затрагивает весь пул. есть полка на 36 дисков, два пула из древних дисков, подключено одним кабелем через один контроллер. один пул периодически складывается как домино, а второй живет нормально.

после перезагрузки сервера пул опять живой и хорошо проходит скраб.

Δαρθ

Δαρθ

после ребута и скраба ноль ошибок

ну если диски срут ошибками не сразу и инфа на них поначалу ок

Ivan

Ivan

кстати если ерроры по чексумам но не перманентные, не повод ли проверить кабеля к этим дискам?

т.е. остальные диски на полке подключены норм кабелями, а все без исключения диски этого пула подключены плохими ? )

Δαρθ

Δαρθ

т.е. остальные диски на полке подключены норм кабелями, а все без исключения диски этого пула подключены плохими ? )

почему все-то, ерроры по чексумам только на 3х

Ivan

Ivan

почему все-то, ерроры по чексумам только на 3х

если подождать, то ерроры появляются на абсолютно всех дисках

Δαρθ

Δαρθ

если подождать, то ерроры появляются на абсолютно всех дисках

тогда тот один кабель? или тупо железо

Ivan

Ivan

тогда тот один кабель? или тупо железо

по одному кабелю одному пулу плохо, а другому всегда норм

Δαρθ

Δαρθ

по одному кабелю одному пулу плохо, а другому всегда норм

по одному и тому же или просто по одному?

Ivan

Ivan

ну железо после кабеля еще, сата мукс там или кто?

и значит каким-то чудом накрылось именно железо как раз под одним пулом )

LordMerlin

LordMerlin

Кстати, если постоянно вываливается один диск, можно ли поменять с соседним местами, чтобы проверить, будет ли продолжаться и какой

Art

Art

стрим openzfs dev summit https://www.youtube.com/watch?v=3opWuc-M2hY

Хороший конспект по саммиту:

https://www.ixsystems.com/blog/openzfs-3-0-introduced-at-developer-summit/

Δαρθ

Δαρθ

Кстати, если постоянно вываливается один диск, можно ли поменять с соседним местами, чтобы проверить, будет ли продолжаться и какой

там вроде все потом вываливаются по чексум еррорам, как я понял

Fedor

Fedor

central

central

а можете меня ткнуть, почему процесс начинает грузить больше процессор, когда растет нагрузка на IO (zfs), процесс работает в виртуалке и обращается к данным по nfs?

Fedor

Fedor

nikolay

nikolay

столкнулся со странным issue, датасет, расшаренный по nfs, внутри примерно 180т файлов, файлы по 1 Гб. очень медленное удаление через find rm{} и очень медленный листинг каталога

nikolay

nikolay

про nfs шару упомянул на всякий случай. тут правда ситуация такая что очень старые версии как центоси 7.3, так и zfs 0.7.12

nikolay

nikolay

вижу набор тикетов по проблеме, но все они довольно старые. видимо надо обновиться в первую очередь

nikolay

nikolay

/home/ingener# zpool iostat -l 3

capacity operations bandwidth total_wait disk_wait syncq_wait asyncq_wait scrub

pool alloc free read write read write read write read write read write read write wait

---------- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- ----- -----

sorm3_1 166T 61,2T 91 3,14K 4,76M 343M 14ms 22ms 10ms 1ms 220us 2us 31ms 22ms 844us

sorm3_1 166T 61,2T 88 5,65K 5,38M 628M 1ms 8ms 1ms 1ms 2us 1us - 7ms -

sorm3_1 166T 61,2T 129 5,62K 8,08M 626M 961us 7ms 953us 989us 2us 1us - 7ms -

sorm3_1 166T 61,2T 102 5,60K 6,42M 641M 2ms 7ms 2ms 974us 1us 1us - 6ms -

sorm3_1 166T 61,2T 82 5,12K 4,85M 595M 3ms 9ms 3ms 1ms 1us 1us - 8ms -

sorm3_1 166T 61,2T 126 5,64K 7,87M 629M 1ms 5ms 1ms 921us 1us 1us - 4ms -

sorm3_1 166T 61,2T 127 5,51K 8,07M 607M 921us 3ms 919us 866us 2us 1us - 3ms -

sorm3_1 166T 61,2T 130 5,84K 8,08M 638M 1ms 6ms 1ms 970us 1us 1us - 5ms -

sorm3_1 166T 61,2T 90 5,71K 5,61M 651M 1ms 9ms 1ms 987us 1us 1us - 8ms -

sorm3_1 166T 61,2T 141 5,50K 8,79M 613M 1ms 8ms 1ms 980us 2us 1us - 7ms -

sorm3_1 166T 61,2T 84 6,11K 5,18M 699M 2ms 8ms 2ms 975us 3us 1us - 7ms -

sorm3_1 166T 61,2T 124 5,51K 7,66M 614M 1ms 8ms 1ms 990us 1us 1us - 8ms -

sorm3_1 166T 61,2T 90 5,14K 5,23M 593M 1ms 7ms 1ms 1ms 2us 1us - 6ms -

sorm3_1 166T 61,2T 138 5,66K 8,81M 634M 952us 6ms 952us 990us 2us 1us - 5ms -

sorm3_1 166T 61,2T 50 5,71K 2,78M 661M 4ms 7ms 4ms 932us 1us 1us - 6ms -

sorm3_1 166T 61,2T 98 5,48K 5,80M 624M 2ms 9ms 2ms 995us 2us 1us - 8ms -

Sergey

Sergey

Доброго времени суток

Хотим быструю mysql под базу zabbix (около 1.5тб данных)

Планируем пул из 3х mirror sas 10k

В целях усиления производительности на запись хотим добавить в эту конструкцию ssd

Что цеплять на ssd: LOG, SLOG, ZIL ?

Aleksei

Aleksei