George

George

George

George

не у любой ФС есть скраб, который "фиксит" данные.

миф, он не должен смочь вычитать "корректные" данные с копии и там тоже упасть

Andrew

Andrew

ну и мы говорим о моменте, когда на обычной ФС у нас уже фарш из крови и кишков)

ну это да, я говорю о случае, когда уже в достаточной мере всё плохо.

George

George

ну это да, я говорю о случае, когда уже в достаточной мере всё плохо.

ну вы просто учитывайте, что scrub перезапишет данные, только если он успешно считал целую копию и успешно её чексумму проверил

George

George

если одна из копий упала по чексумме, то и вторая упадёт, а если успешно считается - запишется та же верная копия

George

George

конечно, при записи корректные данные могут в ОЗУ успеть побиться, но тогда они и с чексуммой не должны совпасть

Ilya

Ilya

коллеги, кто что думает: ZFS без ECC хуже в плане ошибок и целостности, чем обычные ФС типа ext4 или xfs?

Нужно собрать мини-NAS, очень хочу ZFS туда, но память ECC вероятно вкорячить не получится, будет обычная. Данных будет 15-20 ТБ

Matt Ahrens говорит, что ECC не является обязательной:

https://arstechnica.com/civis/viewtopic.php?f=2&t=1235679&p=26303271#p26303271

Eugen

Eugen

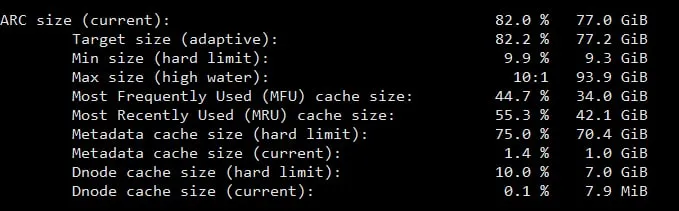

Народ, подскажите как повысить арк макс, а то пишу

echo "100795955200" > /sys/module/zfs/parameters/zfs_arc_max

echo "options zfs zfs_arc_max=100795955200" >> /etc/modprobe.d/zfs.conf

И толку ноль, так 62 гб из 120 только работает

Alexander

Alexander

разлюбить zfs после такого сложно)

А мне девупсеры втирали, что ZFS - г., чуть было не повелись на мою рекламу и чуть не начали использовать эту ZFS :(

Владимир

Владимир

Alexander

Alexander

хорошо что я тоже девопс и сам решаю что мне юзать)

Действительно хорошо, а меня побанили в т.ч. и за мое решение минимизировать использование systemD и предрасположенность к использованию необычных сетапов.

Владимир

Владимир

Alexander

Alexander

системд отличная штука

Даже боюсь обсуждать, и я ничего не имею против systemD в своих виртуалках и на чужих хостах.

Dima

Dima

Привет. Есть какие-то личные соображения против использования zstd сжатия на активном датасете? Сравнив lz4 vs zstd на моём типе данных (файлы тел писем eml мейл-сервера) compressratio lz4 1.19x vs zstd 1.53x (по факту через du -sh -15.2% vs -34.2% от исходного размера) - сильно подкупает выигрыш. Но за CPU cost есть опасения. И время на компрессию-декомпрессию. Может у кого есть уже success story.

Δαρθ

Δαρθ

Ivan

Ivan

поскажите, допустим есть у меня raid10 из 10 дисков, заполненный на 60%, добавляю еще 10 дисков к пулу (5 зеркальных vdev получается). какие подводные камни у такого сценария имеются ?

будет ли со временем нормально распределено пространство, будет ли производительность похожая на массив, созданный сразу из 20 дисков ?

Vladimir

Vladimir

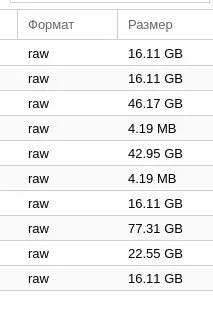

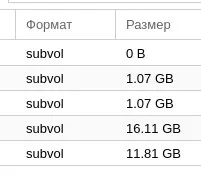

железяка - 2x16tb , на массиве данные для глубокого обучения , память с ECC , но вся память нужна для обработки данных а не для ARC

Δαρθ

Δαρθ

zfs с mirror против mdadm raid1+lvm - стоит связываться с zfs в таком варианте?

zfs даст защиту от битфлипов как минимум )

Vladislav

Vladislav

железяка - 2x16tb , на массиве данные для глубокого обучения , память с ECC , но вся память нужна для обработки данных а не для ARC

Начнем с того, что такие винты предназначены для хранения.

У них довольно маленькие показатели IOPS

Vladimir

Vladimir

Начнем с того, что такие винты предназначены для хранения.

У них довольно маленькие показатели IOPS

там в основном одна задача которая файлы много читает , а потом немного пишет.

Vladimir

Vladimir

Начнем с того, что такие винты предназначены для хранения.

У них довольно маленькие показатели IOPS

запустил тестик на 2x6Tb MDADM RAID-1 + LVM+EXT4

fio --name read_test --directory test --rw=read --size=10g --blocksize=1m --ioengine=libaio --iodepth=1 --numjobs=1 --direct=1 --runtime=600

read: IOPS=197, BW=198MiB/s (208MB/s)(10.0GiB/51735msec)

iops : min= 132, max= 220, avg=197.86, stdev=15.99, samples=103

сейчас винчестеры ST6000DM001 x2 , надо сделать апгрейд на 16Тб потому что места надо больше.

Δαρθ

Δαρθ

вопрос виртуальщикам: detect-zeros=unmap в qemu-kvm должен работать с zvol'ами? просто fstrim в госте работает ок (virtio-scsi), место занимаемое zvolом падает. а если пытаюсь в госте забить все нулями (пишу файл нулей на все своб. место) то zvol распухает обратно. что делаю не так?

Владимир

Владимир

вопрос виртуальщикам: detect-zeros=unmap в qemu-kvm должен работать с zvol'ами? просто fstrim в госте работает ок (virtio-scsi), место занимаемое zvolом падает. а если пытаюсь в госте забить все нулями (пишу файл нулей на все своб. место) то zvol распухает обратно. что делаю не так?

Может потому что вы записали файл который занял всё место?

Δαρθ

Δαρθ

Может потому что вы записали файл который занял всё место?

речь про настройку диска в virt-manager

detect-zeros=unmap

что казалось бы дллжно превращать записи блока нулей гостем в unmap для хостового файла/девайса

nikolay

nikolay

запустил тестик на 2x6Tb MDADM RAID-1 + LVM+EXT4

fio --name read_test --directory test --rw=read --size=10g --blocksize=1m --ioengine=libaio --iodepth=1 --numjobs=1 --direct=1 --runtime=600

read: IOPS=197, BW=198MiB/s (208MB/s)(10.0GiB/51735msec)

iops : min= 132, max= 220, avg=197.86, stdev=15.99, samples=103

сейчас винчестеры ST6000DM001 x2 , надо сделать апгрейд на 16Тб потому что места надо больше.

Запустите на zfs, если все чтение залетит в arc вы удивитесь результату, а оно должно туда залететь

Vladimir

Vladimir

шалом, а кто-нибудь эксплуатирует монгу на зфс? какие-то трики нужно применять дополнительно? какой рекомендуемый размер блока?

Vladimir

Vladimir

из очевидного прикрутил логбиас на зил и врубил арк2 кеш в дефолтном значении, вот думаю крутить ли что-нибудь еще

Ivan

Ivan

Vladimir

Vladimir

кстати, обратил внимание что prometheus node exporter на убунте 20.04 не отдает часть метрик zfs, например node_zfs_zpool_dataset_nread, обновил до 1.1.2 - метрики зфс не сыплются (( он же на убунте 18.04 и дебиане все показывает. лечил кто-нибудь?

Vladimir

Vladimir

кстати, обратил внимание что prometheus node exporter на убунте 20.04 не отдает часть метрик zfs, например node_zfs_zpool_dataset_nread, обновил до 1.1.2 - метрики зфс не сыплются (( он же на убунте 18.04 и дебиане все показывает. лечил кто-нибудь?

все метрики, где в лейбле есть датасет не собираются. я сам не копал пока, но если есть какой-то готовый ответ - буду рад

Δαρθ

Δαρθ

вопрос виртуальщикам: detect-zeros=unmap в qemu-kvm должен работать с zvol'ами? просто fstrim в госте работает ок (virtio-scsi), место занимаемое zvolом падает. а если пытаюсь в госте забить все нулями (пишу файл нулей на все своб. место) то zvol распухает обратно. что делаю не так?

Подниму вопрос снова. Если имедж делать ФАЙЛОМ на zfs, то zeros=unmap работает (пишу нули в виртуалке, размер тестового датасета не распухает).

То есть не работает только на девайсе (zvol). Вроде похоже на баг?

Ivan

Ivan

Подниму вопрос снова. Если имедж делать ФАЙЛОМ на zfs, то zeros=unmap работает (пишу нули в виртуалке, размер тестового датасета не распухает).

То есть не работает только на девайсе (zvol). Вроде похоже на баг?

могу предложить создать issue.

https://github.com/openzfs/zfs/issues

nikolay

nikolay

Подниму вопрос снова. Если имедж делать ФАЙЛОМ на zfs, то zeros=unmap работает (пишу нули в виртуалке, размер тестового датасета не распухает).

То есть не работает только на девайсе (zvol). Вроде похоже на баг?

Файл это файл, блочное устройство помечает записанный блок как используемый, не важно какого он обьема. Space reclamation на zvol работает же?

riv

riv

Подниму вопрос снова. Если имедж делать ФАЙЛОМ на zfs, то zeros=unmap работает (пишу нули в виртуалке, размер тестового датасета не распухает).

То есть не работает только на девайсе (zvol). Вроде похоже на баг?

Когда я тестировал на виртуальной машине без поддержи trim, у меня работало. Я использовал вообще IDE-виртуальную шину.

Vladimir

Vladimir

кстати, обратил внимание что prometheus node exporter на убунте 20.04 не отдает часть метрик zfs, например node_zfs_zpool_dataset_nread, обновил до 1.1.2 - метрики зфс не сыплются (( он же на убунте 18.04 и дебиане все показывает. лечил кто-нибудь?

из того что нашел - в 20 убунте нет файла /proc/spl/kstat/zfs/**/io (** имена датасетов)

Andrey

Andrey

из того что нашел - в 20 убунте нет файла /proc/spl/kstat/zfs/**/io (** имена датасетов)

Этого нет после версии 0.8, убунта тут не причем

Vladimir

Vladimir

Этого нет после версии 0.8, убунта тут не причем

zfs --version

zfs-2.0.4-0york2~18.04

zfs-kmod-2.0.4-0york2~18.04

тут всё окей

zfs --version

zfs-2.1.1-0york0~20.04

zfs-kmod-2.1.1-0york0~20.04

тут не окей

Andrey

Andrey

Просто в 18.04 по умолчанию версия 0.7.5, у меня после обновления до 2.1 (на 2.0 не проверял), так же попала статистика

Δαρθ

Δαρθ

Файл это файл, блочное устройство помечает записанный блок как используемый, не важно какого он обьема. Space reclamation на zvol работает же?

ну fstrim в госте работает же, уменьшает жор места zvolом

Δαρθ

Δαρθ

кстати выяснил чудесную вещь -- если включена компрессия (lz4) то запись нулей автоматически приводит к деаллокации соотв места в zvol

Δαρθ

Δαρθ

записал в 100гб zvol с компрессией сначалв рандом потом нули, нули записались оч быстоо и REFER стал 56к )

George

George

кстати выяснил чудесную вещь -- если включена компрессия (lz4) то запись нулей автоматически приводит к деаллокации соотв места в zvol

когда включена компрессия любая, то включается механизм проверки на нули и если блок состоит только из них, то он просто будет помечен пустым

George

George

а вот когда компрессия отключена, то данные вообще не пытаются анализировать и как есть всегда работают

Δαρθ

Δαρθ

когда включена компрессия любая, то включается механизм проверки на нули и если блок состоит только из них, то он просто будет помечен пустым

оч хорошая фича. теперь мне можно не париться насчет zeros=unmap в qemu )

Владимир

Владимир

Всем привет, не могу понять чем у меня забилось место в zfs, снапшоты проверил, там куча маркеров отсинкоида и несколько моих не тяжёлых снапшотов

central

central