Semyon 🌀

Semyon 🌀

Снова привет!)

подскажите пожалуйста как правильно добавить ещё один disk4 чтобы сделать stripe из двух зеркал?

root@mfsbsd:~ # zpool status -v

pool: zroot

state: ONLINE

status: Some supported features are not enabled on the pool. The pool can

still be used, but some features are unavailable.

action: Enable all features using 'zpool upgrade'. Once this is done,

the pool may no longer be accessible by software that does not support

the features. See zpool-features(5) for details.

scan: scrub repaired 0B in 02:12:19 with 0 errors on Wed Sep 1 00:04:31 2021

remove: Removal of vdev 2 copied 2.56M in 0h0m, completed on Tue Aug 31 21:57:46 2021

336 memory used for removed device mappings

config:

NAME STATE READ WRITE CKSUM

zroot ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

gpt/disk0 ONLINE 0 0 0

gpt/disk1 ONLINE 0 0 0

gpt/disk3 ONLINE 0 0 0

errors: No known data errors

Semyon 🌀

Semyon 🌀

А что будет надёжней кстати? RAID1 из 4 дисков или RAID1+0 зеркало из двух страйпов? скорость в принципе тут не особо важна, SSD тут тоже нет и HBA нет.

George

George

А что будет надёжней кстати? RAID1 из 4 дисков или RAID1+0 зеркало из двух страйпов? скорость в принципе тут не особо важна, SSD тут тоже нет и HBA нет.

> RAID1 из 4 дисков

конечно этот вариант, считайте худший случай - сколько ЛЮБЫХ дисков может вылететь до потери данных, тут 3, а в raid10 один

George

George

ок, попробую добавить команду на импорт

если что, генератор примерно так прописывается для пула

systemctl enable zfs-import@POOLNAME.service

nikolay

nikolay

если что, генератор примерно так прописывается для пула

systemctl enable zfs-import@POOLNAME.service

Гм. Не знал, спасибо! А в доке есть описание?

Semyon 🌀

Semyon 🌀

> RAID1 из 4 дисков

конечно этот вариант, считайте худший случай - сколько ЛЮБЫХ дисков может вылететь до потери данных, тут 3, а в raid10 один

> а в raid10 один

один из каждого зеркала ведь?

Semyon 🌀

Semyon 🌀

а никак скорость нельзя увеличить в resilvered?

scan: resilver in progress since Wed Sep 1 11:30:04 2021

565G scanned at 64.3M/s, 155G issued at 17.7M/s, 565G total

145G resilvered, 27.48% done, 06:35:37 to go

Semyon 🌀

Semyon 🌀

или это из-за медленного HDD так долго... в mdadm было что то типа raid.speed_limit_min, может тут тоже есть чем временно ускорить

Semyon 🌀

Semyon 🌀

<MM0500EANCR HPG3> at scbus0 target 0 lun 0 (pass0,ada0)

<MM0500EBKAE HPG3> at scbus1 target 0 lun 0 (pass1,ada1)

<MM0500EBKAE HPG2> at scbus3 target 0 lun 0 (pass2,ada2)

<WDC WD5000LPLX-00ZNTT0 01.01A01> at scbus4 target 0 lun 0 (pass3,ada3)

<WDC WD10JFCX-68N6GN0 82.00A82> at scbus5 target 0 lun 0 (pass4,ada4)

вот диски если что, первые три хорошие быстрые, но к сожалению пришлось менять их на WDC спустя время...

George

George

а никак скорость нельзя увеличить в resilvered?

scan: resilver in progress since Wed Sep 1 11:30:04 2021

565G scanned at 64.3M/s, 155G issued at 17.7M/s, 565G total

145G resilvered, 27.48% done, 06:35:37 to go

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#resilver можно тут почитать

Semyon 🌀

Semyon 🌀

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Module%20Parameters.html#resilver можно тут почитать

спасибо, только надо ещё и не навредить сейчас))

George

George

спасибо, только надо ещё и не навредить сейчас))

Ну ускориться можно только за счёт аффекта основной нагрузки

Semyon 🌀

Semyon 🌀

Ну ускориться можно только за счёт аффекта основной нагрузки

а сервер всё равно сейчас без нагрузки, он с LiveUSB загружен на msfbsd.

там пока вообще не нахожу похожих параметров, похоже это уже устаревший дистр судя по гитхаб

https://github.com/mmatuska/mfsbsd

хотя раньше советовали именно его под восстановления и траблшутинг)

George

George

а сервер всё равно сейчас без нагрузки, он с LiveUSB загружен на msfbsd.

там пока вообще не нахожу похожих параметров, похоже это уже устаревший дистр судя по гитхаб

https://github.com/mmatuska/mfsbsd

хотя раньше советовали именно его под восстановления и траблшутинг)

да, не самый свежий, многие параметры только в OpenZFS появились

Semyon 🌀

Semyon 🌀

что посоветуете в другой раз? тупо под каким нибудь debian 11 загрузиться и подгрузить zfs модулем для отладки? или ещё что то сейчас есть

George

George

что посоветуете в другой раз? тупо под каким нибудь debian 11 загрузиться и подгрузить zfs модулем для отладки? или ещё что то сейчас есть

Ну для рекавери стремиться за самым свежим тоже не стоит

Mikhail

Mikhail

да, не самый свежий, многие параметры только в OpenZFS появились

хм... там же 13.0, он уже на openzfs. Может быть не 2.1, но 2.1 только-только вышел.

Mikhail

Mikhail

"The ZFS implementation is now provided by OpenZFS. 9e5787d2284e (Sponsored by iXsystems)"

Mikhail

Mikhail

Semyon 🌀

Semyon 🌀

Пытаюсь в LiveUSB скопировать новы йzpool.cache в подмонтированный пул.

zpool import -o cachefile=/tmp/zpool.cache -o altroot=/mnt zroot

после этого в лог пишет

Sep 2 10:40:10 mfsbsd ZFS[6647]: failed to write zpool.cache, zpool=zroot

Semyon 🌀

Semyon 🌀

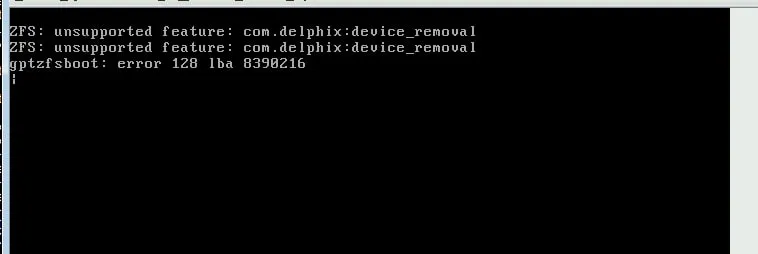

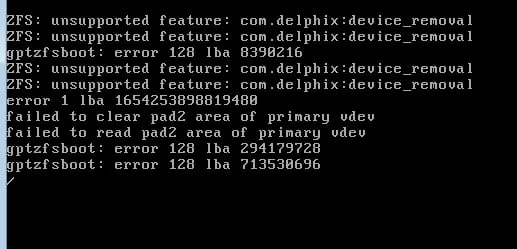

коллеги, помогите кто может пожалуйста) ничего не понимаю, вроде бы пул починил, засинкался. попробовал с него загрузиться — получил unsupported features и ошибки gpt, видимо из-за того, что zfs версия с LiveUSB новее была.

попробовал снова забутиться с флешки, теперь такое:

root@mfsbsd:~ # zpool import

pool: zroot

id: 5030191546092404654

state: ONLINE

status: Some supported features are not enabled on the pool.

action: The pool can be imported using its name or numeric identifier, though

some features will not be available without an explicit 'zpool upgrade'.

comment: RAID10

config:

zroot ONLINE

mirror-0 ONLINE

gpt/disk0 ONLINE

gpt/disk1 ONLINE

mirror-1 ONLINE

gpt/disk3 ONLINE

gpt/disk5 ONLINE

indirect-2 ONLINE

root@mfsbsd:~ # zpool status -v

no pools available

root@mfsbsd:~ # zpool status -v

no pools available

root@mfsbsd:~ # zpool import zroot

root@mfsbsd:~ # zpool status -v

internal error: failed to initialize ZFS library

Semyon 🌀

Semyon 🌀

я понимаю, что чинить пул надо было на той версии которой он соответствует, но что было под рукой под тем и загружался, и zpool upgrade ествественно не применял

Mikhail

Mikhail

Semyon 🌀

Semyon 🌀

тогда да. Между 11.4 и 13.0 большая разница.

у меня теперь ошибки zfs read сыпет когда загрузчик с mfsbsd начинает грузиться даже, там где бутлоадер

Semyon 🌀

Semyon 🌀

тогда да. Между 11.4 и 13.0 большая разница.

ну так мне только починку пула нужно было сделать, поэтому бутнулся с msfbsd

Mikhail

Mikhail

Semyon 🌀

Semyon 🌀

Ошибка летит потому что ты примоунтил пул. То есть перекрыл в VFS моунты

ну старый zpool.cache я успел сохранить, перед тем как новый скопировал когда пул засинкался, я не уверен был, возможно новый и не нужно было копировать, если я только диски чинил?

Mikhail

Mikhail

internal error: failed to initialize ZFS library

теперь модуль крашиться вообще

То есть у тебя в памяти теперь пытается подгрузиться libzfs от 11.4, а zfs бинарь от 13.0.

Бывает такое.

При import можно указать разные опции аля altroot / -R

George

George

Semyon 🌀

Semyon 🌀

не увидел в выводе про unsupported features.

> indirect-2

хм, а это что такое

сам пока не понял тоже

Semyon 🌀

Semyon 🌀

возможно остатки битого ada3, его пока физически не вытащили, хотя я ему уже давно сделал detach и пул починился.

Semyon 🌀

Semyon 🌀

так, вроде сделал импорт после ребута и загрузки опять с флешки под 13.0

root@mfsbsd:~ # zpool import -fR /mnt zroot

root@mfsbsd:~ # zpool status -v

pool: zroot

state: ONLINE

status: Some supported features are not enabled on the pool. The pool can

still be used, but some features are unavailable.

action: Enable all features using 'zpool upgrade'. Once this is done,

the pool may no longer be accessible by software that does not support

the features. See zpool-features(5) for details.

scan: resilvered 804G in 15:34:42 with 0 errors on Thu Sep 2 03:04:46 2021

remove: Removal of vdev 2 copied 2.56M in 0h0m, completed on Tue Aug 31 21:57:46 2021

336 memory used for removed device mappings

config:

NAME STATE READ WRITE CKSUM

zroot ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

gpt/disk0 ONLINE 0 0 0

gpt/disk1 ONLINE 0 0 0

mirror-1 ONLINE 0 0 0

gpt/disk3 ONLINE 0 0 0

gpt/disk5 ONLINE 0 0 0

errors: No known data errors

Semyon 🌀

Semyon 🌀

не увидел в выводе про unsupported features.

> indirect-2

хм, а это что такое

> не увидел в выводе про unsupported features.

при загрузке было с новым zpool.cache, ща попробую ещё раз со старым zpool.cache, если будет покажу.

Semyon 🌀

Semyon 🌀

Semyon 🌀

Semyon 🌀

а ты не делал zpool remove вдева?

я делал вчера вот по такой последовательности:

zpool import -fR /mnt zroot

zpool offline zroot /dev/gpt/disk4 # Первым делом удаляем сбойный диск из пула!!!!!!! (ada3 битый, метка просто disk4)

# Удаляем битый диск

zpool detach zroot /dev/gpt/disk4

# тут возможно запускаем zpool scrub zroot

# Делаем зеркало из двух страйпов (disk3 уже был в пуле, disk5 новый)

zpool attach zroot /dev/gpt/disk3 /dev/gpt/disk5

Semyon 🌀

Semyon 🌀

а ты не делал zpool remove вдева?

а, вообще похоже делал. я по ошибке сделал add сначала, и получился RAID1 из 4 vdev

# Если делаем add, получим RAID1 из 3-4 дисков.

# zpool add zroot /dev/gpt/disk5

# Поэтому если случайно сделали add, удаляем диск обратно

# zpool remove zroot /dev/gpt/disk5

George

George

значит делал remove, и потом уже переделал через attach

ну вот, если это был vdev, то теперь у тебя в пуле неподдерживаемый старым кодом feature

Semyon 🌀

Semyon 🌀

ну вот, если это был vdev, то теперь у тебя в пуле неподдерживаемый старым кодом feature

что делать не подскажите ?

George

George

либо обновлять код, либо пересоздавать пул, емнип от этой фичи просто так не избавиться (не смотрел отключается ли она при полной перезаписи данных с удаленного vdev)

Semyon 🌀

Semyon 🌀

ну вот, если это был vdev, то теперь у тебя в пуле неподдерживаемый старым кодом feature

ну так я же пул не апгрейдил. почему он мне его пихнул пул с неподдерживаемым старым кодом feature?

George

George

ну так я же пул не апгрейдил. почему он мне его пихнул пул с неподдерживаемым старым кодом feature?

https://openzfs.github.io/openzfs-docs/man/8/zpool-remove.8.html

Semyon 🌀

Semyon 🌀

The device_removal feature flag must be enabled to remove a top-level vdev, see zpool-features(7).

Semyon 🌀

Semyon 🌀

а ремув на vdev ставит флаг новый, т.к. не поддерживается это в старом коде

remove тогда ещё был unsupported получается?

Semyon 🌀

Semyon 🌀

> фичи просто так не избавиться (не смотрел отключается ли она при полной перезаписи данных с удаленного vdev)

если диску erase сделать?

George

George

> фичи просто так не избавиться (не смотрел отключается ли она при полной перезаписи данных с удаленного vdev)

если диску erase сделать?

диск тут не при чём, фича на уровне пула

George

George

и данные в пуле, надо смотреть по коду снимает ли он этот флаг если данные с удалённого vdev полностью перезаписаны