Василий

Василий

Это конечно хорошо, но проприетарщина ведь ? :(

У меня шапочка из фольги есть и всан выход в инет не имеет

Alexander

Alexander

У меня шапочка из фольги есть и всан выход в инет не имеет

Да тут много нюансов, включая его цену, он ведь наверно не бесплатный?

Василий

Василий

А что думаешь про другие варианты типа Linstor DRBD ?

Для всего этого надо отдельную машину, а всан делается с тех же серверов, которые и гипервизоры

Василий

Василий

А разве Linstor не запихать в виртуалку?

И следить чтобы оно не смигрировало разные вм с линстором на одну ноду?

Alexander

Alexander

И следить чтобы оно не смигрировало разные вм с линстором на одну ноду?

Дык поди можно пометить отдельные виртуалки, чтобы не мигрировали?

Alexander

Alexander

Всан, родное, дофига быстрое решение

Не спорю, наслаждайтесь, просто я зарекся от использования проприетарщины, пока будет такая возможность.

Василий

Василий

Не спорю, наслаждайтесь, просто я зарекся от использования проприетарщины, пока будет такая возможность.

Моя религия проще на это смотрит. Более того, вон тот же наш водафон, даже линух только редхат юзают, если что, есть кого е.. Ть

Alexander

Alexander

Чем поможет это в случае развалившейся зфс?

Часто она разваливается в SmartOS или ZOL 0.8.6 ?

Alexander

Alexander

У меня и нтфс никогда не умирала

Кстати тоже, но сомневаюсь, что NTFS бы выжил при известных помехах :)

Василий

Василий

Кстати тоже, но сомневаюсь, что NTFS бы выжил при известных помехах :)

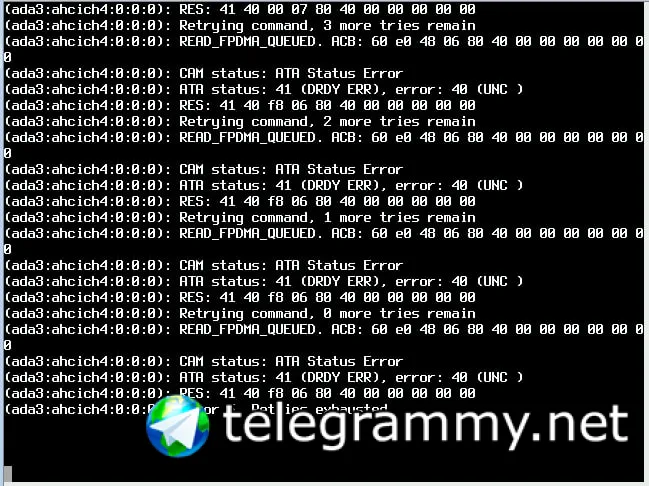

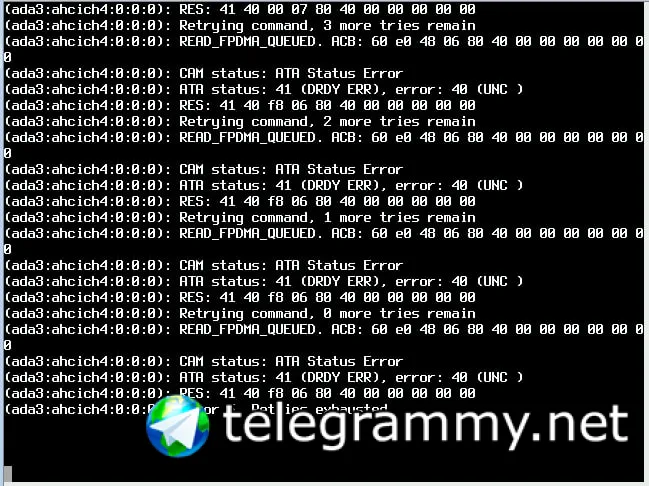

Так на кривом железе тебе повезло что на обеих копиях не было ошибок, а то и зфс бы помер

Alexander

Alexander

Так на кривом железе тебе повезло что на обеих копиях не было ошибок, а то и зфс бы помер

Не было у меня кривого железа.

Δαρθ

Δαρθ

да, только имена дисков задавай не через обычные буковки типа /dev/sda , а через айдишники, типа такого

/dev/disk/by-id/ata-TOSHIBA_MG07ACA12TE_60D0A028X85X

Так zfs пул будет вообще независим от того, как система обзовёт диски, и соотв его можно будет легко переносить между системами, авось пригодится

А ещё лучше даже так: сделай wipefs -a каждому диску. После чего, очищенные, они отобразятся в гуе Прокса, и ты сможешь создать пул там, так быстрее будет

айдишники не сами по себе берутся, их вроде initramfs делает

Alexander

Alexander

да, только имена дисков задавай не через обычные буковки типа /dev/sda , а через айдишники, типа такого

/dev/disk/by-id/ata-TOSHIBA_MG07ACA12TE_60D0A028X85X

Так zfs пул будет вообще независим от того, как система обзовёт диски, и соотв его можно будет легко переносить между системами, авось пригодится

А ещё лучше даже так: сделай wipefs -a каждому диску. После чего, очищенные, они отобразятся в гуе Прокса, и ты сможешь создать пул там, так быстрее будет

А какая разница как называется устройство в Linux?

Сергей

Сергей

соотвно если без нее — опять тыква :(

После первоначального создания пула на дисках запишется информация (метки) и пул можно будет импортировать по любым именам, zfs возьмёт из меток на самих дисках

Semyon 🌀

Semyon 🌀

Semyon 🌀

Semyon 🌀

Semyon 🌀

Semyon 🌀

Василий

Василий

#Вопрос Это законно держать два пула разных версий на одном хосте ?

Полиция выехала за вами, с другой стороны, вот принесли мне диск с пулом, у человека, например, солярис 10, так что ж, ему нельзя ко мне подключаться?

Nikolay

Nikolay

Semyon 🌀

Semyon 🌀

Хорошо, подскажите\напомните тогда ещё пожалуйста. с Live CD сейчас под MFSBSD если я добавлю новый диск в пул в зеркало, то нужно будет zpool.cache копировать в /boot/zfs/ ? подзабыл всё уже

Semyon 🌀

Semyon 🌀

раньше делал что то типа такого если были проблемы с кеш файлом или настройками пула.

zpool import -f -o cachefile=/tmp/zpool.cache -o altroot=/mnt zroot или zpool import -fR /mnt zroot

mount -t devfs devfs /mnt/dev

cp /tmp/zpool.cache /mnt/boot/zfs/zpool.cache

umount /mnt/dev

Semyon 🌀

Semyon 🌀

zpool split кто-нибудь делал?

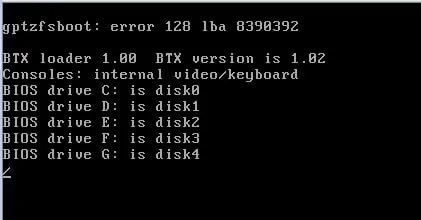

не могу никак победить ребилд рейда, из-за disk4 сильные фризы и никак не засинкается, а вытащить его offline\detach не даёт.

root@mfsbsd:~ # zpool status -v

pool: zroot

state: ONLINE

status: One or more devices is currently being resilvered. The pool will

continue to function, possibly in a degraded state.

action: Wait for the resilver to complete.

scan: resilver in progress since Tue Aug 31 17:38:14 2021

565G scanned at 200M/s, 71.3G issued at 25.2M/s, 566G total

847M resilvered, 12.61% done, 05:34:49 to go

config:

NAME STATE READ WRITE CKSUM

zroot ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

gpt/disk0 ONLINE 0 0 0

gpt/disk1 ONLINE 0 0 0

mirror-1 ONLINE 9 0 0

gpt/disk3 ONLINE 0 0 4 (resilvering)

gpt/disk4 ONLINE 365 0 342 (resilvering)

errors: No known data errors

root@mfsbsd:~ # zpool detach zroot gpt/disk4

nikolay

nikolay

столкнулся со странной ситуацией. переставили диски из одного сервера в другой (правда перед этим не сделали zpool export на старом сервере и не перенесли ssd, с которых выдавались партиции под slog, не было возможноси). на новом сервере делаю zpool import -d -aN /dev/disk/by-id, пул импортируется, удаляю slog vdev, удаляю на всякий случай zpool.cache файл. перезагружаюсь - пул не импортируется

nikolay

nikolay

все модули загружаются, systemctl показывает что zfs-import - loaded и active, строка в файле /lib/modules-load/zfs.conf раскомментирована

nikolay

nikolay

ок, снова импортирую пул, той же командой, снова перегружаюсь (при импорте создается новый zpool.cache файл) - система залипает на этапе попытки смонтировать пул (именно смонтировать, не импортировать). приходится перегружать в сингл моде, удалять zpool.cache файл - только после этого система грузится штатно, но без импорта пула.

nikolay

nikolay

копаюсь глубже - вижу что когда диски перенесли на новый сервер то они распознались там как mdadm устройства в виде raid0 каждый диск (соот-но партиции *1 и *9 распознались как партиции md*p1 и md*p9)

nikolay

nikolay

как такое может быть? руками их вроде никто не создавал, иначе потерли бы информацию о разметке zfs. или не потерли бы?

nikolay

nikolay

[root@localhost ]# zpool status

pool: pgsql

state: ONLINE

scan: resilvered 6.09T in 6 days 10:38:33 with 0 errors on Mon Aug 16 09:02:52 2021

config:

NAME STATE READ WRITE CKSUM

pgsql ONLINE 0 0 0

raidz2-0 ONLINE 0 0 0

md-uuid-af484d7d:6feb4422:c8085a9b:d15177e1 ONLINE 0 0 0

md-uuid-21b9cfe4:f24aa489:186bf875:54c1253f ONLINE 0 0 0

md-uuid-08ff89b4:65dab043:7bbe2d59:e98dac06 ONLINE 0 0 0

md-uuid-b94678fc:1642871d:c0563be3:eb7e3199 ONLINE 0 0 0

md-uuid-8a53f122:85272498:b450113e:4dc8bdc0 ONLINE 0 0 0

md-uuid-13e0b752:2f18e9df:f44770a1:b63f79af ONLINE 0 0 0

md-uuid-3f4298ed:6d9e8ac2:a36efb7b:6beda735 ONLINE 0 0 0

md-uuid-939b334e:c8cdc886:51365da1:bf409c7e ONLINE 0 0 0

md-uuid-cd6204c9:45ab6d21:92d4adf2:2a276cfa ONLINE 0 0 0

md-uuid-bf5bc63b:685c6014:77fc4932:dde27d26 ONLINE 0 0 0

raidz2-2 ONLINE 0 0 0

md-uuid-01fe0b07:9a792999:d99c0c70:06d9e9f0 ONLINE 0 0 0

md-uuid-e9b895d0:cf485cee:25dc9a9e:af529a24 ONLINE 0 0 0

md-uuid-b3792558:4cd8ce3e:2cdacb70:e8f42636 ONLINE 0 0 0

md-uuid-f6a6d38a:5661ae24:657232f2:b35c6ffa ONLINE 0 0 0

md-uuid-f61c20b7:43327a04:0f7903f1:e4511669 ONLINE 0 0 0

md-uuid-0a327ee8:5eed8bc8:2c777979:839e79ea ONLINE 0 0 0

md-uuid-baf74402:6097d581:04249bbc:ade4dbdc ONLINE 0 0 0

md-uuid-81b4b0f2:35f5a0a5:c7e3f14f:e611933e ONLINE 0 0 0

md-uuid-2442356e:8f520bcf:75607da2:64d18515 ONLINE 0 0 0

md-uuid-3091a9e2:fda4a6b6:e7f1b940:3eea6a1c ONLINE 0 0 0

nikolay

nikolay

[root@localhost ]# zpool status -L

pool: pgsql

state: ONLINE

scan: resilvered 6.09T in 6 days 10:38:33 with 0 errors on Mon Aug 16 09:02:52 2021

config:

NAME STATE READ WRITE CKSUM

pgsql ONLINE 0 0 0

raidz2-0 ONLINE 0 0 0

md122 ONLINE 0 0 0

md114 ONLINE 0 0 0

md126 ONLINE 0 0 0

md108 ONLINE 0 0 0

md109 ONLINE 0 0 0

md120 ONLINE 0 0 0

md111 ONLINE 0 0 0

md117 ONLINE 0 0 0

md116 ONLINE 0 0 0

md113 ONLINE 0 0 0

raidz2-2 ONLINE 0 0 0

md118 ONLINE 0 0 0

md124 ONLINE 0 0 0

md115 ONLINE 0 0 0

md123 ONLINE 0 0 0

md107 ONLINE 0 0 0

md112 ONLINE 0 0 0

md125 ONLINE 0 0 0

md121 ONLINE 0 0 0

md110 ONLINE 0 0 0

md119 ONLINE 0 0 0

nikolay

nikolay

на старом сервере диски пробрасывались через рейд-контроллер в режиме raid0 каждый отдельный диск.. и поверх zfs разметка

nikolay

nikolay

ок, снова импортирую пул, той же командой, снова перегружаюсь (при импорте создается новый zpool.cache файл) - система залипает на этапе попытки смонтировать пул (именно смонтировать, не импортировать). приходится перегружать в сингл моде, удалять zpool.cache файл - только после этого система грузится штатно, но без импорта пула.

вот тут неверно написал - все же идет попытка импорта пула из кэш файла, и система висит в ожидании завершения задачи, загрузка не продолжается..

nikolay

nikolay

попробовал указать zpool set cachefile=none - не помогает, система не импортирует пул при загрузке(

nikolay

nikolay

Sep 1 10:12:24 localhost systemd-modules-load[738]: Inserted module 'zfs'

Sep 1 10:12:24 localhost kernel: ZFS: Loaded module v2.0.5-1, ZFS pool version 5000, ZFS filesystem version 5

Sep 1 10:12:29 localhost systemd[1]: Reached target ZFS pool import target.

Sep 1 10:12:29 localhost systemd[1]: Starting Mount ZFS filesystems...

Sep 1 10:12:29 localhost systemd[1]: Started Mount ZFS filesystems.

Sep 1 10:12:30 localhost systemd[1]: Started ZFS Event Daemon (zed).

Sep 1 10:12:30 localhost systemd[1]: Starting ZFS file system shares...

Sep 1 10:12:30 localhost systemd[1]: Started ZFS file system shares.

Sep 1 10:12:30 localhost systemd[1]: Reached target ZFS startup target.

Sep 1 10:12:30 localhost zed[1681]: ZFS Event Daemon 2.0.5-1 (PID 1681)

George

George

вот тут неверно написал - все же идет попытка импорта пула из кэш файла, и система висит в ожидании завершения задачи, загрузка не продолжается..

А initramfs пересобирал с правильным cache?

nikolay

nikolay

А initramfs пересобирал с правильным cache?

гм.. во первых в системе до установки дисков из старого сервера никаких пулов не было. во вторых - а это надо делать? ни разу так не делал

nikolay

nikolay

А, это не рут и на маунте проблемы, тогда не то

не, проблемы как раз на импорте при загрузке ос. я выше ошибочно написал..

George

George

попробовал прописать в rc.local команды zpool import и zfs mount - тоже не работает..

А система загружается? Просто пул сам не импортируется?

nikolay

nikolay

А система загружается? Просто пул сам не импортируется?

да, загружается, если cachefile отсутствует

George

George

если пул не импортируется автоматически, но всё остальное ок - просто через этот генератор завести сервис с нужным именем пула

nikolay

nikolay

если пул не импортируется автоматически, но всё остальное ок - просто через этот генератор завести сервис с нужным именем пула

ок, попробую добавить команду на импорт

nikolay

nikolay

lrwxrwxrwx. 1 root root 9 Jun 22 00:20 /usr/lib/systemd/system/zfs-import.service -> /dev/null

nikolay

nikolay

ExecStart=/sbin/zpool import -d /dev/disk/by-id -aN -o cachefile=none, добавил -d /dev/disk/by-id