А можно хоть одну ссылку?

Ссылку на что?

nikolay

nikolay

А то я даже не могу представить, как должны тогда летать дисковые полки на 60 дисков и более

Вот это моя конфигурация))

Василий

Василий

nikolay

nikolay

Разница на 60 дисках при паттерне 4к, 50/50% random read/write , разница в 7 раз по iops в пользу zfs. Вот такие пироги..

Василий

Василий

Разница на 60 дисках при паттерне 4к, 50/50% random read/write , разница в 7 раз по iops в пользу zfs. Вот такие пироги..

учитывая что у контроллера кучу кеша, а у зфс нефига нет, вообще загадка

nikolay

nikolay

учитывая что у контроллера кучу кеша, а у зфс нефига нет, вообще загадка

Куча кэша???))) откуда))))

nikolay

nikolay

напрмер, у MSA2040 заявлена пропускная способность 80к иопс по контроллеру

Причём тут msa вообще)))))

Василий

Василий

"HPE Smart Array SR ControllersHPE’s new line of enterprise-class RAID controllers for Gen10 servers help maximize performance, data availability, and storage capacity. They deliver up to 1.6 million IOPS"

nikolay

nikolay

зы: __"любой аппаратный рейд"__

Я боюсь что нарушу вашу стройную картину мира - но в контроллерах msa нет как таковых аппаратных raid контроллеров))) как впрочем у большинства классических схд

nikolay

nikolay

И мса ни на одном количестве hdd не выдаст 80к iops при хоть сколько нибудь вменяемом времени отклика. Не надо верить маркетинговым даташитам, даже если там что то подобное написано

Василий

Василий

Я боюсь что нарушу вашу стройную картину мира - но в контроллерах msa нет как таковых аппаратных raid контроллеров))) как впрочем у большинства классических схд

я бось наруши вашу картину мира. но практически все рейды внутри софтовые. просто есть специальные чипы, которые умеют какие то рейдспецифические операции выполнять быстро

nikolay

nikolay

я бось наруши вашу картину мира. но практически все рейды внутри софтовые. просто есть специальные чипы, которые умеют какие то рейдспецифические операции выполнять быстро

Отлично, значит мы понимаем друг друга и не будем сравнивать тёплое с мягким)

Василий

Василий

Отлично, значит мы понимаем друг друга и не будем сравнивать тёплое с мягким)

и все таки, как вы подключили 60 дисков к зфс?

nikolay

nikolay

в смысле вы перешили лси в ит моде?

А, если про тест - то да. В проде у меня по два hba 9305 на сервер

nikolay

nikolay

в смысле вы перешили лси в ит моде?

Перешивать кстати не нужно, 9480 поддерживает режим jbod

nikolay

nikolay

Никому ничего не навязываю и не собираюсь доказывать. Но мне не нравится уровень негатива исходящий от вас в профильном чате.

Василий

Василий

Никому ничего не навязываю и не собираюсь доказывать. Но мне не нравится уровень негатива исходящий от вас в профильном чате.

негативный я) просто во всех профильных сайтах пишут, что зфс не быстр, но всегда находятся энтузиасты, у кого зфс рвет все и вся. вас теперь двое в этой группе

nikolay

nikolay

Пусть пишут, вы тоже написали. Отлично, дальше тему можно не развивать. Каждый остался при своём мнении

nikolay

nikolay

Ваш опыт кстати был полезен. Я например не знал что oracle zfs умеет удалять из пула любой vdev. Лично мне это было очень полезно

Василий

Василий

Ваш опыт кстати был полезен. Я например не знал что oracle zfs умеет удалять из пула любой vdev. Лично мне это было очень полезно

вот, я вам пруфы предоставил :) а вы мне зажали )

Василий

Василий

ну тест иопс и настройки контроллера. я понимаю, что ради пруфов, вы сейчас не будете пересобирать рейд, но вдруг у вас остались картинки с тех времен когда вы сравнивали

Василий

Василий

я "почти" верю в 14к (при теоретически возможных 12к, а учитывая что зфс еще и метаданные пишет, то часть иопсов еще на них уходит), но сильно не верю в 2к на довольно приличном контроллере который у вас

nikolay

nikolay

Скрины я не делал, зачем? Настроек у контроллера минималка ное количество, там сложно накосячить

Василий

Василий

опять же - 12к иопс на 60 дисках это при чистом стрипе. т.е. если у вас все же прод, и хотя бы рейд10, то там не больше 6к должно быть.

Василий

Василий

Вы удивитесь, но я сравнивал raid60 из 4 групп и zraid2 на пуле из 4-х вдев)

удивлюсь :) как можно получить иопс выше чем могут физически диски

Василий

Василий

Параллельная нагрузка, не надо считать в лоб)

та ладно? )))) окей, есть два диска, каждый максимум может выдать 200иопс. сделайте мне с двух дисков 500 :))))

nikolay

nikolay

Я предлагаю завершить наше увлекательное обсуждение. Мои коллеги вели себя аналогично пока не увидели тесты в живую. Вам я к сожалению продемонстрировать не смогу так как этого стенда давно нет

Василий

Василий

nikolay

nikolay

и можно модель, а то что то подозрение, что там все что можно кеши в нем включены

Локальные кэши на дисках я кстати отключаю перед сборкой пулов в проде

Василий

Василий

Как было в тесте - не вспомню

у вас нереально хорошие показатели для зфс. но приятно читать, что есть места, где зфс работает очень быстро

Δαρθ

Δαρθ

aes-cbc-plain в люксе.

цбц медленнее при зашифровке причем сильно. даже с aes-ni. лучше xts юзать.

Δαρθ

Δαρθ

а luks часом не xts? у zfs gcm. Может у вас разные типы шифрования?

а это почти не важно. одно от другого отличается грубо говоря колвом ксоров до и после самого aes. картинки есть в педивикии

Eugene

Eugene

Господа специалисты, а подскажите, как лучше шифрование организовать на raidz из 4-х дисков?

-каждый диск зашифровать, шифрованные тома объединить в raidz (тогда при сбое надо будет каждый диск сначала открыть, потом возвращать массив) ;

- на 4-х дисках сделать raidz, поверх сделать шифрованную ФС, тогда расшифровать нужно будет ФС на уже смонтированном массиве.

Василий

Василий

root@san:/tmp# zpool create -o encryption=on zzz /tmp/d1

property 'encryption' is not a valid pool property

root@san:/tmp# zfs set encryption=on zzz

cannot set property for 'zzz': 'encryption' is readonly

George

George

Ivan

Ivan

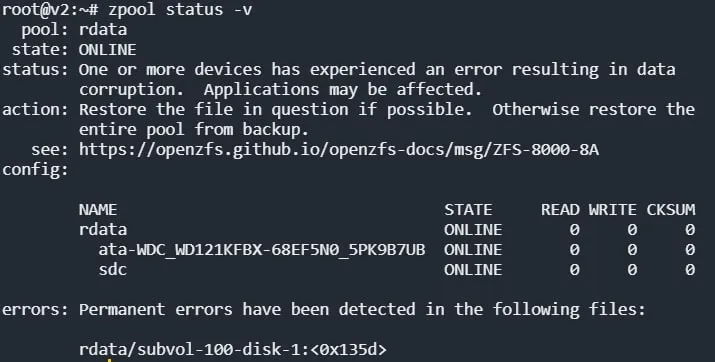

вот кстати чем плох zfs. если б он не указывал что есть потерянные данные, то и не заметил бы. а теперь неспокойно как-то 😃

bes

bes

вообще не хороший опыт пока что получается: pool создан 20 часов назад, запись на 60% утилизации дисков 60%/40% read/write и уже приехали

central

central