Все это будет приближенно

именно, ни дедуп ни компрессию невозможно заранее рассчитать. Так что если у вас переподписка по месту больше 1, то такие ситуации возможны

Константин

Константин

именно, ни дедуп ни компрессию невозможно заранее рассчитать. Так что если у вас переподписка по месту больше 1, то такие ситуации возможны

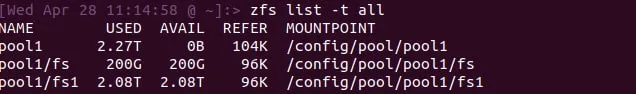

А что с данными и с доступом на запись по итогу будет ? Датасеты такой конфигурации будут разделять общее пространство пула ?

George

George

А что с данными и с доступом на запись по итогу будет ? Датасеты такой конфигурации будут разделять общее пространство пула ?

они всегда разделяют общее пространство, в zfs не резервируется фактическое пространство, резервирование работает только на уровне расчёта объёма свободного пространства, и то не на 100% точно

George

George

И в какой то момент не смогут записать тот гарантированный минимум который выделили?

ну если у вас переподписка больше 1, то да

Константин

Константин

резервируя на 100ГБ больше, чем есть на пуле, вы сами создаёте эту ситуацию

Но в одном случае zfs следит за этим и не даёт а в другом разрешает

Константин

Константин

George

George

(в общем то, дедуп и сжатие для того и нужны, чтобы смочь запихнуть в пул больше чем там есть :D )

Константин

Константин

(в общем то, дедуп и сжатие для того и нужны, чтобы смочь запихнуть в пул больше чем там есть :D )

Но в описанном мною случае по итогу никакого дедупа нет

George

George

Константин

Константин

George

George

Но на 9 пункте все удаляется

ну в пункте 6 вы уже зарезервировали больше чем есть на пуле

> 6 создаю вторую толстую фс на 600 гиг, zfs разрешило создать

George

George

в общем если видите проблему - можете обосновывать и предлагать решения, ссылку я выше кинул.

Но я другого решения не вижу, честно говоря, tradeoffs нынешнего решения понятны и удобны

Константин

Константин

почему?

Потому что в какой то момент зарезервированное место стало больше реального на пуле. И обращаясь к ману видно что происходит разногласие между описанием и реальной работой

George

George

Потому что в какой то момент зарезервированное место стало больше реального на пуле. И обращаясь к ману видно что происходит разногласие между описанием и реальной работой

я кстати нашёл тикет по этому поводу) https://github.com/openzfs/zfs/issues/10249

Константин

Константин

т.к. желающих менять не видно, можно доку обновить по резервированию, чтобы было очевидно

наверное стоило бы пометить взаимоотношения резервации и дедупликации

George

George

наверное стоило бы пометить взаимоотношения резервации и дедупликации

ага, contributions are welcome, если кто созреет

Владимир

Владимир

А почему в убунте программа «диски» пишет про zfs какуюто дичь?

так и пишет?, zfs какая-то дичь?)))

Andrey

Andrey

Вы бы листинг привели что-ли zpool list -v

А так м б это loop на какое-нибудь устройство

например, dd if=/dev/zero of=/tmp/tst.dd bs=1M count=100

mknod /dev/dich1 b 7 8

losetup /dev/dich1 /tmp/tst.dd

zpool create pool1 /dev/dich1

zpool list -v pool1

NAME SIZE ALLOC FREE CKPOINT EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

pool1 80M 110K 79,9M - - 3% 0% 1.00x ONLINE -

dich1 80M 110K 79,9M - - 3% 0,13% - ONLINE

Константин

Константин

т.к. желающих менять не видно, можно доку обновить по резервированию, чтобы было очевидно

В продолжение о дедупе. Ещё не могли бы пояснить механизм дедупликации в zfs.

Правильно ли я понимаю сама дедупликация происходит онлайн (т.е. дедуплицируются новые блоки после включения опции дедупа до ее отключения, старые блоки в режиме офлайн не дедуплицируются) и при этом она асинхронная (т.е. данные сначала записываются на диск, а потом уже происходит дедупликация через сравнение контрольных сумм, и получается что происходит разрастание до реальных размеров, после повторяющиеся блоки чистятся).

Так ли все работает и есть ли возможность как то менять асинхронный/синхронный режимы вручную ? Или вручную управлять онлайн/офлайн режимом, кроме как перезаписывать данные способом send/recv?

George

George

В продолжение о дедупе. Ещё не могли бы пояснить механизм дедупликации в zfs.

Правильно ли я понимаю сама дедупликация происходит онлайн (т.е. дедуплицируются новые блоки после включения опции дедупа до ее отключения, старые блоки в режиме офлайн не дедуплицируются) и при этом она асинхронная (т.е. данные сначала записываются на диск, а потом уже происходит дедупликация через сравнение контрольных сумм, и получается что происходит разрастание до реальных размеров, после повторяющиеся блоки чистятся).

Так ли все работает и есть ли возможность как то менять асинхронный/синхронный режимы вручную ? Или вручную управлять онлайн/офлайн режимом, кроме как перезаписывать данные способом send/recv?

Дедуп сейчас строго онлайн синхронный, в момент записи сравнивается хеш, и если уже есть - только в dedup table (ddt) на диске счётчик изменится

George

George

про дедуп можно еще сторону VDO от redhat посмотреть

у VDO накладные расходы на дедуп меньше

А вот вопрос, видел тесты где vdo хуже был по перформансу, буду рад что-то свежее глянуть если есть

Константин

Константин

Дедуп сейчас строго онлайн синхронный, в момент записи сравнивается хеш, и если уже есть - только в dedup table (ddt) на диске счётчик изменится

В теории я тоже везде такое описание читал.

Но вот странно на практике, при тестировании zvol расшаренного по iscsi протоколу заметил что свободное место на пуле уменьшается. Уменьшается практически на тот же размер что мы пишем на клиенте, а после уже начинает обратно освобождаться соизмеримо коэффициенту дедупа. Такое ощущение как будто дедуп происходит асинхронно в параллельном потоке

Evgenii

Evgenii

В теории я тоже везде такое описание читал.

Но вот странно на практике, при тестировании zvol расшаренного по iscsi протоколу заметил что свободное место на пуле уменьшается. Уменьшается практически на тот же размер что мы пишем на клиенте, а после уже начинает обратно освобождаться соизмеримо коэффициенту дедупа. Такое ощущение как будто дедуп происходит асинхронно в параллельном потоке

А ты изменял данные или только писал новые в тестах?

George

George

В теории я тоже везде такое описание читал.

Но вот странно на практике, при тестировании zvol расшаренного по iscsi протоколу заметил что свободное место на пуле уменьшается. Уменьшается практически на тот же размер что мы пишем на клиенте, а после уже начинает обратно освобождаться соизмеримо коэффициенту дедупа. Такое ощущение как будто дедуп происходит асинхронно в параллельном потоке

На уровне записи на диск дедуп точно синхронный, а вот в какой момент учёт свободного места отрабатывает это интересно

George

George

В теории я тоже везде такое описание читал.

Но вот странно на практике, при тестировании zvol расшаренного по iscsi протоколу заметил что свободное место на пуле уменьшается. Уменьшается практически на тот же размер что мы пишем на клиенте, а после уже начинает обратно освобождаться соизмеримо коэффициенту дедупа. Такое ощущение как будто дедуп происходит асинхронно в параллельном потоке

Не исключаю что до момента полной записи txg учёт места резервирует максимально требуемый объём

George

George

В теории я тоже везде такое описание читал.

Но вот странно на практике, при тестировании zvol расшаренного по iscsi протоколу заметил что свободное место на пуле уменьшается. Уменьшается практически на тот же размер что мы пишем на клиенте, а после уже начинает обратно освобождаться соизмеримо коэффициенту дедупа. Такое ощущение как будто дедуп происходит асинхронно в параллельном потоке

а, ну и синхронная или асинхронная запись до zfs долетает, мб в zil данные как есть попадают, не смотрел это место

nikolay

nikolay

Перечисленные выше команды как раз сбрасывают все данные из кэшей, в том числе из zil на диски

DOK ꧁꧂

DOK ꧁꧂

Видит каждый датасет как отдельный диск?

Zpool волбще не видит второго диска. Но через программу “disks” его видно и он отформатирован хз чем и примонтирован в /mnt/disk2. Захожу в эту папку, накидываю мусор и смотрю размер: размер не увеньшается. Зато у других дисков уменьшается. Такое впечатление что это фейковое монтирование

Semyon 🌀

Semyon 🌀

Прокс создаёт диски в хранилищах. Размер блока это свойство хранилища. Создайте несколько хранилищ с разными размерами блоков и тогда вы сможете создавать диски в каждом из хранилищ и эти диски получат разные размеры блоков. 8к наиболее оптимален для ВМ с тем же постгрессом. Для ВМ общего назначения можно сделать 16к. А лучше всего провести собственные тесты производительности дисков с разными размерами блоков.

это справедливо только если есть несколько пулов ? или можно в одном пуле разные стораджи делать с разными размерами volblocksize?

Ivan

Ivan

DOK ꧁꧂

DOK ꧁꧂

нет. еще вопросы будут ?

Нет, зачем дурачка спрашивать) Но ты ведь все равно сам с херней всюду лезешь)

Ilya

Ilya

Fedor

Fedor

Сергей

Сергей

Δαρθ

Δαρθ