Николай Орлов

Николай Орлов

вопрос немного не по теме, подскажите у кого есть опыт хочу прикрутить на сервере что то типа iscsi, штука очень прикольная, но есть ограничения по одновременному доступу с нескольких машин. В какую сторону можно посмотреть или samba наше все?

central

central

Ivan

Ivan

nikolay

nikolay

думал может есто что-то интереснее

вам экзотику или чтобы работало? самба штатное решение если нужно что-то с unix/linux на win отдать в виде общей файловой шары

Николай Орлов

Николай Орлов

Если Ч+З то только САМБА, а если ридонли то и iscsi ВЗЛЕТИТ

да взлетел уже, но есть сложности нет нет база падает

Ivan

Ivan

еще у zfs+samba есть очень удобная фича - поддержка shadow copy из снапшотов

https://github.com/zfsonlinux/zfs-auto-snapshot/wiki/Samba

Николай Орлов

Николай Орлов

на одной машине обновил допустим систему, вторая ничего не увидит пока не переконектишь

nikolay

nikolay

на одной машине обновил допустим систему, вторая ничего не увидит пока не переконектишь

если речь про запущенное приложение, то внезапно да, его надо перезапустить чтобы оно перечитало файлы) либо есть какая-нить внутренняя команда

nikolay

nikolay

да

если речь идет о том что приложение на клиенте не может подключиться к базе или отваливается в процессе работы, то надо смотреть что в логах на клиенте относительно smb шары. если есть ошибки указывающие на временную недоступность, то проверять настройки шары на сервере. также посмотреть логи на сервере и погуглить в плане настройки samba под файловые базы 1с и/или аналогичного приклада.

nikolay

nikolay

ну и сеть - могут быть проблемы с сетевой связанностью если шара становится временно недоступной на клиенте. но это обсуждать в чате по zfs не вижу смысла.

nikolay

nikolay

народ, подскажите в illymos команда zpool iostat с какого момента начала понимать ключи -l или -q ?

George

George

и, на удивление, предполагаемая схема выглядит рабочей и даже не дерьмом (группировка блоков в крупные объекты, локальные ARC для чтения и SLOG для синхронной записи)

Evgenii

Evgenii

а s3 умеет как блочное устройство подключаться? или в zfs хотят внедрить слой логики, которому это будет не нужно?

George

George

Evgenii

Evgenii

напрямую, иначе смысла нет

то есть они рассуждают на тему внедрения поддержки s3 в zfs, правильно?

George

George

то есть они рассуждают на тему внедрения поддержки s3 в zfs, правильно?

да, возможность использования s3 как персистентного хранилища для ZFS

George

George

большая группа транзакций?)

ага, размер одной transaction group (TXG) может быть весьма не маленьким

Evgenii

Evgenii

хотя s3 щас не только у Amazon, это уже промышленный стандарт. Они кстати судились из за того, что многие начали копировать их API, но проиграли

Roman

Roman

а s3 умеет как блочное устройство подключаться? или в zfs хотят внедрить слой логики, которому это будет не нужно?

Из коробки нет, по хорошему s3 же тупо через http работает

Но можно и через fuse прибить

nikolay

nikolay

да, возможность использования s3 как персистентного хранилища для ZFS

Так что поверх чего?) zfs поверх s3 получается?

riv

riv

ага, размер одной transaction group (TXG) может быть весьма не маленьким

Я сначала подумал "ну и дичь", но подумав ещё, неожиданно пришел к выводу, что это может и сработать. Но сработает только если будет ещё что-то, како-то ещё s3 с небольшим объемом объектов для записи метаданных, грубо говоря для special vdev

Константин

Константин

Всем привет. Помогите разобраться с поведением или это баг в zfs.

Есть пул на 1000 гигов.

На нем я не могу создать 2 толстых файловых системы zfs на 500 и 600 гигов (refreservation = 500 и 600 гигов соответственно). И это правильно.

НО

1 создаю толстую ФС на 500 гигов

2 включаю на ней дедупликацию

3 заливаю туда 200гиг, т.е. 20 одинаковых файлов по 10 гигов

4 наблюдаю картину что реально записалось чуть больше 10 гигов на пул и коэф дедупа 20

5 вижу что 190 гигов толстая фс вернула пулу , потому что у пула свойство available увеличилось примерно на столько.

6 создаю вторую толстую фс на 600 гиг, zfs разрешило создать

8 на пуле ещё 90 гиг свободных вижу

9 удаляю все данные с дедуплицированной толстой фс

10 я так понимаю она пытается себе назад 190 вернуть

11 вижу что те 90 свободных из пула исчезли , на пуле стало 0 , но откуда ещё 100 гигов удалось взять ????

12 результат следующий , что не получилось вначале сделать , удалось другим путём , у меня 2 Толстых фс 500 и 600 гигов соответственно на пуле в 1000 гигов. Вопрос откуда эти 100 гиг если их физически нет. Получается толстые фс которым предоставлено обязательное пространство делят между собой общее пространство пула ? Что будет с данными если забить и ту и ту фс полностью ? Они перетруться или zfs не даст записать ? Как сумма refreservation 2х датасетов больше чем размер пула ????

Можете пожалуйста объяснить такое поведение???

Eugen

Eugen

Всем привет. Помогите разобраться с поведением или это баг в zfs.

Есть пул на 1000 гигов.

На нем я не могу создать 2 толстых файловых системы zfs на 500 и 600 гигов (refreservation = 500 и 600 гигов соответственно). И это правильно.

НО

1 создаю толстую ФС на 500 гигов

2 включаю на ней дедупликацию

3 заливаю туда 200гиг, т.е. 20 одинаковых файлов по 10 гигов

4 наблюдаю картину что реально записалось чуть больше 10 гигов на пул и коэф дедупа 20

5 вижу что 190 гигов толстая фс вернула пулу , потому что у пула свойство available увеличилось примерно на столько.

6 создаю вторую толстую фс на 600 гиг, zfs разрешило создать

8 на пуле ещё 90 гиг свободных вижу

9 удаляю все данные с дедуплицированной толстой фс

10 я так понимаю она пытается себе назад 190 вернуть

11 вижу что те 90 свободных из пула исчезли , на пуле стало 0 , но откуда ещё 100 гигов удалось взять ????

12 результат следующий , что не получилось вначале сделать , удалось другим путём , у меня 2 Толстых фс 500 и 600 гигов соответственно на пуле в 1000 гигов. Вопрос откуда эти 100 гиг если их физически нет. Получается толстые фс которым предоставлено обязательное пространство делят между собой общее пространство пула ? Что будет с данными если забить и ту и ту фс полностью ? Они перетруться или zfs не даст записать ? Как сумма refreservation 2х датасетов больше чем размер пула ????

Можете пожалуйста объяснить такое поведение???

Рефрезервация это ограничение на запись данных на сколько я помню, то есть резервированный обьем для фс. Просто когда место закончится, то писать больше нельзя будет

Eugen

Eugen

Да, но пока место не использовпно физически то выделять можно, даже если у нескольких в сумме обьем больше чем диск

Eugen

Eugen

Как пример, есть фс с рефрезервацией 350гб, и в ней куча клонов фс с той же величиной, клонов и по 100 бывает, хотя диск всего то 4тб физически

George

George

George

George

Всем привет. Помогите разобраться с поведением или это баг в zfs.

Есть пул на 1000 гигов.

На нем я не могу создать 2 толстых файловых системы zfs на 500 и 600 гигов (refreservation = 500 и 600 гигов соответственно). И это правильно.

НО

1 создаю толстую ФС на 500 гигов

2 включаю на ней дедупликацию

3 заливаю туда 200гиг, т.е. 20 одинаковых файлов по 10 гигов

4 наблюдаю картину что реально записалось чуть больше 10 гигов на пул и коэф дедупа 20

5 вижу что 190 гигов толстая фс вернула пулу , потому что у пула свойство available увеличилось примерно на столько.

6 создаю вторую толстую фс на 600 гиг, zfs разрешило создать

8 на пуле ещё 90 гиг свободных вижу

9 удаляю все данные с дедуплицированной толстой фс

10 я так понимаю она пытается себе назад 190 вернуть

11 вижу что те 90 свободных из пула исчезли , на пуле стало 0 , но откуда ещё 100 гигов удалось взять ????

12 результат следующий , что не получилось вначале сделать , удалось другим путём , у меня 2 Толстых фс 500 и 600 гигов соответственно на пуле в 1000 гигов. Вопрос откуда эти 100 гиг если их физически нет. Получается толстые фс которым предоставлено обязательное пространство делят между собой общее пространство пула ? Что будет с данными если забить и ту и ту фс полностью ? Они перетруться или zfs не даст записать ? Как сумма refreservation 2х датасетов больше чем размер пула ????

Можете пожалуйста объяснить такое поведение???

а, у вас обычные датасеты. В общем то да, ЕМНИП резервирование для каждого датасета отдельно происходит, понятие свободного места - динамическое, с включённым дедупом и сжатием возможны такие ситуации, если не следить и рассчитывать "впритык" место.

Ну и понятие "толстая" фс в рамках zfs - это эфемерная вещь, она не более чем пытается зарезервировать заранее место.

Будет проверка жёстче по месту - многие будут выть "почему я снапшот создать не могу, место же есть".

George

George

так что кратко - включаете дедуп или сжатие - не пытайтесь резервировать больше чем есть по факту

Константин

Константин

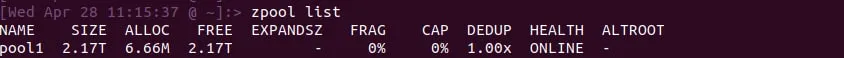

Покажите zfs list и команды которыми zvol создавали

Evgenii

Evgenii

Рефрезервация это ограничение на запись данных на сколько я помню, то есть резервированный обьем для фс. Просто когда место закончится, то писать больше нельзя будет

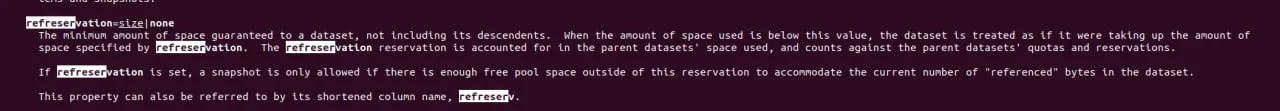

Нет, резервация, это именно резервация. Вы сразу занимаете все место. Ограничение - это квота

Константин

Константин

George

George

Нет, резервация, это именно резервация. Вы сразу занимаете все место. Ограничение - это квота

ну вот что такое "занимаете" ?)

George

George

вам либо шашечки, либо ехать, в ZFS свободное пространство резервируется виртуально, я выше описал уже

Константин

Константин

просто не резервируйте больше чем есть за счёт дедупа)

это легко сказать, но когда это все в работе и в динамике, высчитывать каждый раз в обратную сторону коэф дедупа умножить на данные, каким то образом исключить метаданные по дедупу. Совсем не гуд

Константин

Константин

Константин

Константин

если в лоб создать так нельзя , не позволяет zfs, потому что не хватает места:

size is greater than available space

но через дедуп и такие манипуляции с данными получается зарезервировать больше чем available

Может быть это все таки баг в чистом виде??? и поведение после будет непонятно: либо данные тупо перезапишутся и что то потрется , либо будет ограничение и перевод в какой то момент датасета в редонли и гарантированный минимум, описанный в мане, не является таким

LordMerlin

LordMerlin