Владимир

Владимир

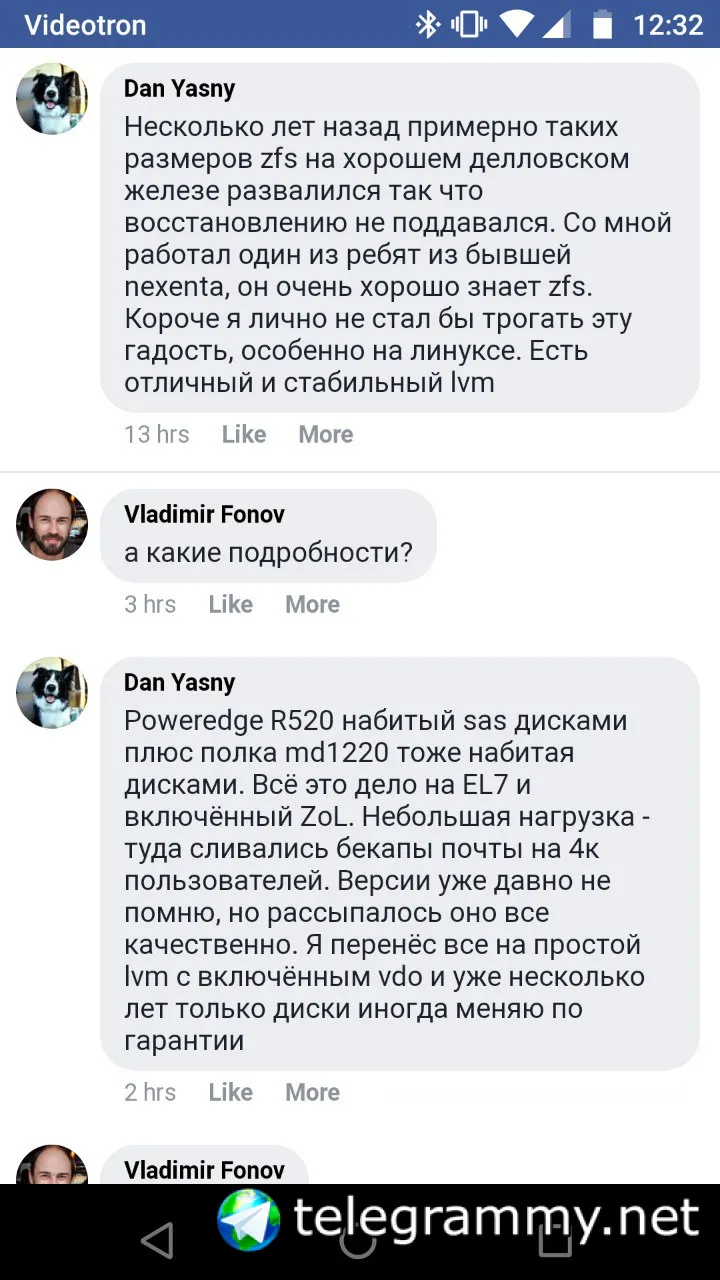

Несколько лет назад интересно сколько, с зфс же были проблемы на линукс, я правда тогда с зфс не работал

Ilya

Ilya

Где-то в параллельной вселенной у чьих-то корешей (работающих в Майкрософт) при сбое поломалось LVM/ext4 и теперь ни байта туда. Только S2D!

Владимир

Владимир

С малым опытом в лвм можно поломать лвм.

Дело не в бобине

ну на самом деле zfs пожирнее комбайн чем LVM, но в целом да, согласен

Konstantin

Konstantin

Владимир

Владимир

Ilya

Ilya

а баг то завели в трекер?

А потом окажется, что там special был на одном единственном диске и приехали.

Или при увеличении пула добавили vdev на 1 диск. Вариантов - мульён

Ivan

Ivan

извините за нубский вопрос, подскажите как попросить dpkg пересобрать zfs-dkms для определенного ядра, а не последнего ?

Ivan

Ivan

извините за нубский вопрос, подскажите как попросить dpkg пересобрать zfs-dkms для определенного ядра, а не последнего ?

ответ: dpkg-reconfigure ядра. это пересобирает и zfs модуль.

Владимир

Владимир

извините за нубский вопрос, подскажите как попросить dpkg пересобрать zfs-dkms для определенного ядра, а не последнего ?

Он пересобирает для всех ядер на сколько я знаю

Ivan

Ivan

так я уже сделал. просто когда зфс обновляется, то обновляется модуль только для последнего ядра в системе, а не для всех

Alexander

Alexander

Добрый вечер, пожалуйста, подскажите, стоит ли ждать еще полгода-год для повышения надежности ветки OpenZFS v2.0.x ?

Хотелось бы уже воспользоваться persistent L2ARC. Но как говорится и хочется и колется.

Больше всего опасаюсь если ZFS начнет опять отправлять глючные send | receive потоки как в версии 0.6.x. (hole burn или типа того).

Краш пула - не самое страшное, самое страшное остаться без бэкапов после этого.

George

George

George

George

Добрый вечер, пожалуйста, подскажите, стоит ли ждать еще полгода-год для повышения надежности ветки OpenZFS v2.0.x ?

Хотелось бы уже воспользоваться persistent L2ARC. Но как говорится и хочется и колется.

Больше всего опасаюсь если ZFS начнет опять отправлять глючные send | receive потоки как в версии 0.6.x. (hole burn или типа того).

Краш пула - не самое страшное, самое страшное остаться без бэкапов после этого.

Сколько ждать - на вкус, я минимум полгода для личных нужд ещё подожду точно. 0.8.6 точно уже отлежался достаточно😁

Eugen

Eugen

у меня тоже мало опыта

На зфс и всякие железные сервера на трунас выпускаются, были бы траблы регулярные, никто бы не использовал. Правда оно там на фряхе основано.

Alexander

Alexander

Сколько ждать - на вкус, я минимум полгода для личных нужд ещё подожду точно. 0.8.6 точно уже отлежался достаточно😁

А что там такого интересного в 0.8.6 по сравнению с 0.7.12? В 0.8 не планируется случайно persistent L2ARC?

George

George

А что там такого интересного в 0.8.6 по сравнению с 0.7.12? В 0.8 не планируется случайно persistent L2ARC?

Persistent l2arc не планируется бекпортить

George

George

А что там такого интересного в 0.8.6 по сравнению с 0.7.12? В 0.8 не планируется случайно persistent L2ARC?

Стоит changelogs смотреть чтобы не соврать, шифрование, трим, special alloc class минимум по функционалу, улучшение перформанса и фиксы багов

Alexander

Alexander

Стоит changelogs смотреть чтобы не соврать, шифрование, трим, special alloc class минимум по функционалу, улучшение перформанса и фиксы багов

Я к тому, что IMHO ZFS 2.0.last можно дождаться и на Debian v9 + ZFS v0.7.12 без апгрейда пока, потому что даже для ZFS v0.8.x нужен уже Debian 10 с бэкпортами.

А там уж сразу потом на ZFS 2.0.last

Это рабочая станция.

George

George

Alexander

Alexander

Почему-то при установке ZFS проявляется несовместимость с OpenRC, приходится править deb пакеты ZFS вручную, убирая эту несовместимость :(

George

George

Почему-то при установке ZFS проявляется несовместимость с OpenRC, приходится править deb пакеты ZFS вручную, убирая эту несовместимость :(

В дебиане адекватные сопровождающие у пакетов zfs, да и в апстрим если что помогу влить)

Alexander

Alexander

В дебиане адекватные сопровождающие у пакетов zfs, да и в апстрим если что помогу влить)

Ааа... кажется понял. Ведь в Debian наверно нет OpenRC? А Devuan для них как больная мазоль со своим OpenRC? Вот они и придумали life hack :(

Alexander

Alexander

Пул то импортируется нормально вручную? ZFS без разницы названия устройств, у ZFS свои метки на дисках, которые он ищет.

Evgenii

Evgenii

пул - это набор дисков, если есть лишние диски, можно сделать еще пулы и скопировать в них что нибудь

Alexander

Alexander

Зачем вам ZFS? Если действительно нужна и не устраивает скорость vs ext4, попробуйте ext4 over ZFS zvol.

Alexander

Alexander

Можно сделать клон всего датасета из его снэпшота, в клоне можно поудалять все лишнее, на оригинал это никак не повлияет.

Но с момента клонирования клон уже потеряет связь с оригиналом. Т.е. изменения оригинала не будут отражаться в клоне.

Alexander

Alexander

Для ZFS скорость дисков вообще неважна в режиме sync=none, важно только количество оперативки :)

Даже старый IDE диск 20 летней давности "уделает" по скорости работы любой суперсовременный Optan SSD на небольших объемах, пока данные копятся в оперативке.

Evgenii

Evgenii

Для ZFS скорость дисков вообще неважна в режиме sync=none, важно только количество оперативки :)

Даже старый IDE диск 20 летней давности "уделает" по скорости работы любой суперсовременный Optan SSD на небольших объемах, пока данные копятся в оперативке.

Линейная скорость все еще важна, но драматически уменьшается потребление IOPS

Alexander

Alexander

Линейная скорость все еще важна, но драматически уменьшается потребление IOPS

В режиме sync=none, то какая зависимость от линейной скорости на малых объемах транзакций?

Кроме того из-за фрагментации чисто линейной работы никогда не получится, будет хоть какой-то рандом в любом случае.

Evgenii

Evgenii

В режиме sync=none, то какая зависимость от линейной скорости на малых объемах транзакций?

Кроме того из-за фрагментации чисто линейной работы никогда не получится, будет хоть какой-то рандом в любом случае.

ну так система должна в любом случае успевать скидывать накопленный пакет транзакций в период окна между коммитами этих пакетов. Если не будет успевать, ничего хорошего не будет

Alexander

Alexander

ну так система должна в любом случае успевать скидывать накопленный пакет транзакций в период окна между коммитами этих пакетов. Если не будет успевать, ничего хорошего не будет

Коммит по sync?

Разве у приложения появится ожидание, пока есть доступная оперативка под незакомиченный в оперативке кэш?

Ну будет черепаший диск писать 5 минут, и что? Приложение продолжит работать, а ZFS будет обманывать приложение на каждый его sync, рапортовать, что все ОК (но на самом деле конечно нет, зато быстрооо).

Alexander

Alexander

все сложнее... она не 5 минут ждет чтобы скинуть - это слишком долго, щас найду

ZFS скидывает каждые 5 сек.

Но приложение IMHO не будет ждать этого скидывания данных на диск, ZFS его обманет и скажет заранее, что уже усе готово даже еще ДО записи в ZIL.

Я про режим sync=none.

Evgenii

Evgenii

вот тут встает вопрос, чтоб будет, если она за следующие 5 секунд не успела скинуть предыдущий пакет транзакций? группы тразакций начнут становиться в очередь? мне кажется в врятли...

Alexander

Alexander

Evgenii

Evgenii

Alexander

Alexander

Alexander

Alexander

Я и говорю, причина того, что ext4 не подходит, что вы уже заняли свой диск под завязку в другом формате?

George

George

вот тут встает вопрос, чтоб будет, если она за следующие 5 секунд не успела скинуть предыдущий пакет транзакций? группы тразакций начнут становиться в очередь? мне кажется в врятли...

количество txg в работе лимитируется, в конечном итоге да - если txg сбрасывается долго, то это может приводить к таким ожиданиям. Но эти моменты конфигурятся. Просто выкрутить txg_timeout и лимиты по dirty data без учёта производительности дисков на запись может как раз привести к iops=0 на время максимального тротлинга записи

Evgenii

Evgenii

Я писал про небольшие транзакции, например можно запустить виртуалку с чатиком.

Смотря на каких диска ты будешь это запускать.. Современные консьюмерские SSD настолько упороты, что когда заканчиваются ячейки сконфигурированные в SLC режиме, и начинается запись в QLC ячейки - наступает жопа. В этом режиме они медленнее старых HDD.

А SLC ячейки заканчиваются крайне быстро. Т.к. максимальное их количество может быть не больше 1\4 от оставшегося объема диска (это при условии что весь остаток диска в этом режиме, но тогда у него будет уменьшенная в 4 раза емкость. А если этот объем превышен, нужно будет еще успевать "расфигачивать" уже записанные в SLC режиме данные туда же, но уже в QLC режиме, иначе места просто не будет, хотя пользователь видит, что 60% диска еще свободно

Evgenii

Evgenii

У меня на днях появились первые в моей жизни сервера с Enterprise SSD, и это просто чудо какое то.

Даже SSD от Samsung рядом не стояли.

George

George

ну и плюс https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/ZFS%20Transaction%20Delay.html

Vladimir

Vladimir