𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

данные не терялись. но расскажите, как проверить ФС без отмонтирования?)

keep calm, данные в порядке

https://linux.die.net/man/8/fsck.xfs

George

George

keep calm, данные в порядке

https://linux.die.net/man/8/fsck.xfs

тут должно быть что-то серьёзное про ntfs

Ivan

Ivan

вот вы прикалываетесь а я как раз переехал винтом с торрентами с xfs на btrfs

главное swap на btrfs не делай, а то фс поломается

Matrix Operator

Matrix Operator

А че чат xfs называется?)

принято решение отказаться от разработки ZFS и вернуть все в XFS

Fedor

Fedor

новые страницы данных будут писаться с учётом нового объёма. как старые выйдут из обращения - так и заребалансится.

Ivan

Ivan

за счёт чего? за счет журнала (zil) или чисто на механизмах cow?

https://www.klennet.com/notes/2019-07-04-raid5-vs-raidz.aspx

edo1

edo1

под special любой долго живущий. Нагрузки там не запредельные. У меня в режиме бекапа примерно 1/4 iops падает на special и примерно так-же или ближе к 1/3 по объему перезаписываются данные на special от тех которые записываются на НЖМД.

А вот под dedup однозначно optane, там на zpool iostat получается, что на dedup vdev падает раз 10 больше по объему перезаписи, чем на основные устройства пула.

не знаю, у меня всё живёт на nvme, проблем не вижу

Δαρθ

Δαρθ

https://www.klennet.com/notes/2019-07-04-raid5-vs-raidz.aspx

ZFS works around write hole by embracing the complexity. It is not like RAIDZn does not have a write hole problem per se, because it does. However, once you add transactions, copy-on-write, and checksums on top of RAIDZ, the write hole goes away.

то есть чисто средствами cow достигается?

George

George

Мосжно в zfs сделать принудительный ребаланс данных после расширения?

руками перезаписью данных

Ivan

Ivan

ZFS works around write hole by embracing the complexity. It is not like RAIDZn does not have a write hole problem per se, because it does. However, once you add transactions, copy-on-write, and checksums on top of RAIDZ, the write hole goes away.

то есть чисто средствами cow достигается?

если верить тому что написано, то не чисто cow

riv

riv

ZFS works around write hole by embracing the complexity. It is not like RAIDZn does not have a write hole problem per se, because it does. However, once you add transactions, copy-on-write, and checksums on top of RAIDZ, the write hole goes away.

то есть чисто средствами cow достигается?

Что-то я не выкуриваю, что именно улучшается? И как это делается через чксуммы и CoW&

Fedor

Fedor

Судя по тому, что оригинальный зфс уступает место опензфс, и их различия стремительно накапливаются..

TokaToka

TokaToka

новые страницы данных будут писаться с учётом нового объёма. как старые выйдут из обращения - так и заребалансится.

Есть читы с zfs send/receive в рамках одного пула, при наличии места:

https://serverfault.com/questions/859216/how-to-re-balance-data-in-zfs-make-sure-the-data-is-spread-amongst-all-strip/859223#859223

TokaToka

TokaToka

Судя по тому, что оригинальный зфс уступает место опензфс, и их различия стремительно накапливаются..

Слоган «worlds last file system»не такой уж корректный, будут ещё))

George

George

Так так.. кто логотип сменил? Я не против, конечно.

Я, тут в основном про openzfs вот и подумал

Alexander

Alexander

Добрый день, пожалуйста, подскажите, как заменить идентификатор пула после клонирования файловой системы через dd?

central

central

Добрый день, пожалуйста, подскажите, как заменить идентификатор пула после клонирования файловой системы через dd?

Так нельзя так делать, или это только про btrfs?

Alexander

Alexander

Про btrfs не знаю, реплики ZFS работают нормально, если не менять ID пула, а менять только имя причем в пункте назначения репликации

Nick

Nick

А кто-нибудь знает, что с опцией про lazytime? Будет ли, или есть причина её не делать? Нашел открытый тикет, но там давно тишина - https://github.com/openzfs/zfs/issues/9843

Александр

Александр

Всем Добрый день. столкнулся с такой проблемой - не удается удалиться зеркало logs, zpool remove выполняется, ошибки нет, но зеркало не удаляется, я нашел несколько похожих проблем на github(например эту - https://github.com/openzfs/zfs/issues/6677), пара были достаточно свежие, но не увидел нигде пофиксили это или нет. кто нибудь знает пофиксили это в какой то версии? или может есть какие то лазейки что бы все-таки удалить зеркало? моя версия zfs 0.7.13

Николай

Николай

Парни подскажите, есть pool из 2 дисков в Raid1 (zpool).Используется под данные OWNCLOUD, хочу переехать на новый сервак и ввиду того что такое делаю впервые прошу помощи,как можно переместить этот zfs pool на новую машину?

central

central

central

central

а вообще у вас где то должен быть бекап, и можно было бы его перенести, заодно и протестите аварийные действия если raid навернется

Николай

Николай

а вообще у вас где то должен быть бекап, и можно было бы его перенести, заодно и протестите аварийные действия если raid навернется

Есть снапшоты самих данных используемых Owncloud, снимка пула нет.

riv

riv

Парни подскажите, есть pool из 2 дисков в Raid1 (zpool).Используется под данные OWNCLOUD, хочу переехать на новый сервак и ввиду того что такое делаю впервые прошу помощи,как можно переместить этот zfs pool на новую машину?

Выключить все процессы открывающие файлы на пуле, чтобы привести файлы в консистентное состояние.

export snap_name=backup-2021.04.07-20.00

export pool_name=my_zpool

# Делаем снимок пула со всеми файловыми системами

zfs snap -r ${pool_name}@${snap_name}

# смотрим сколько будет передано данных

zfs send -nvR ${pool_name}@${snap_name}

export send_size=1050GB

export new_noop_name=new_zfs_pool

# пересылаем данные на новый пул, с заменой данных на новом пуле

zfs send -R ${pool_name}@${snap_name} | pv —size ${send_size} —name "${pool_name}->${new_noop_name}" | zfs receive ${new_noop_name} -F

или на другую машину

export dest_host_ip=192.168.0.12

zfs send -R ${pool_name}@${snap_name} | pv —size ${send_size} —name "${pool_name}->${new_noop_name}" | ssh root@${dest_host_ip} "receive ${new_noop_name} -F"

riv

riv

Есть снапшоты самих данных используемых Owncloud, снимка пула нет.

Конечно нужно переносить не весь пул, а только датасет с данными, тогда моя инструкция не подходит.

riv

riv

Парни подскажите, есть pool из 2 дисков в Raid1 (zpool).Используется под данные OWNCLOUD, хочу переехать на новый сервак и ввиду того что такое делаю впервые прошу помощи,как можно переместить этот zfs pool на новую машину?

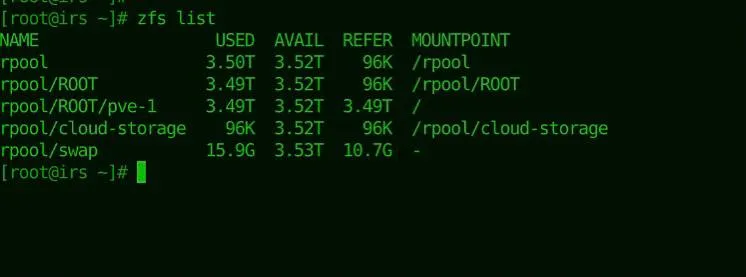

zfs list и zpool list в студию, желательно с пояснениями где чего.

Николай

Николай

zfs list и zpool list в студию, желательно с пояснениями где чего.

zpool list

NAME SIZE ALLOC FREE EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

rpool 7.25T 3.50T 3.75T - 27% 48% 1.00x ONLINE -

[root@irs ~]# zpool status

pool: rpool

state: ONLINE

scan: scrub repaired 0 in 1h56m with 0 errors on Sat Apr 16 22:57:12 2016

config:

NAME STATE READ WRITE CKSUM

rpool ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

sda2 ONLINE 0 0 0

sdb2 ONLINE 0 0 0

riv

riv

A1EF

A1EF

Vikentsi

Vikentsi

Владимир

Владимир

Eugen

Eugen

🆅🅺

🆅🅺