В Wallaby включили по умолчанию в https://github.com/openstack/oslo.messaging/commit/add5ab4ecec090efdb9864bc9385f871f2dd082a , но сама опция oslo_messaging_rabbit/heartbeat_in_pthread есть с Train, только помечена как экспериментальная.

Сами-то rabbitmq heartbeats в oslo.messaging всегда были, только из-под mod_wsgi или uwsgi они неправильно работали раньше.

Anonymous

Anonymous

Что-то очень много, со стороны клиента постоянно трейсы.

в общем я бы смотрел в сторону компонента, где отваливается коннект (если конечно коннекты не массово с разных компонентов отваливаются) и смотрел, чем в этот момент он был занят

Andrey

Andrey

Maksimus Ulibikus

Maksimus Ulibikus

Коллеги, пне могу разобраться с Neutron. Создаю инстанс, но он не получает IP, хотя DHCP Agent в статусе UP.

Maksimus Ulibikus

Maksimus Ulibikus

Сеть выбрал как Provider L2

*controller*

[root@controller ~]# cat /etc/sysconfig/network-scripts/ifcfg-ens192

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

BOOTPROTO=none

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

IPV6INIT=yes

IPV6_AUTOCONF=yes

IPV6_DEFROUTE=yes

IPV6_FAILURE_FATAL=no

IPV6_ADDR_GEN_MODE=stable-privacy

NAME=ens192

UUID=37bd1d48-d45d-4d47-ac01-884b09d7f563

DEVICE=ens192

ONBOOT=yes

IPADDR=192.168.10.194

PREFIX=24

IPV6_PRIVACY=no

GATEWAY=192.168.10.99

DNS1=8.8.8.8

[root@controller ~]# cat /etc/sysconfig/network-scripts/ifcfg-ens-224

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

BOOTPROTO=none

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

IPV6INIT=yes

IPV6_AUTOCONF=yes

IPV6_DEFROUTE=yes

IPV6_FAILURE_FATAL=no

IPV6_ADDR_GEN_MODE=stable-privacy

NAME=ens224

UUID=6a04020d-5679-31e0-8ac7-9f5ac75a6686

DEVICE=ens224

ONBOOT=yes

AUTOCONNECT_PRIORITY=-999

ens-224 настраивал точно как по документации для `controller https://docs.openstack.org/neutron/victoria/install/environment-networking-controller-rdo.html

*compute1*

[root@compute1 ~]# cat /etc/sysconfig/network-scripts/ifcfg-enp0s25

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

BOOTPROTO=none

DEFROUTE=yes

IPV4_FAILURE_FATAL=no

IPV6INIT=yes

IPV6_AUTOCONF=yes

IPV6_DEFROUTE=yes

IPV6_FAILURE_FATAL=no

IPV6_ADDR_GEN_MODE=stable-privacy

NAME=enp0s25

UUID=663881bd-14e5-4c1b-8f6e-9d546f03dc32

DEVICE=enp0s25

ONBOOT=yes

IPADDR=192.168.10.124

PREFIX=24

GATEWAY=192.168.10.99

DNS1=8.8.8.8

[root@compute1 ~]# cat /etc/sysconfig/network-scripts/ifcfg-enp3s0

TYPE=Ethernet

PROXY_METHOD=none

BROWSER_ONLY=no

IPV6INIT=yes

IPV6_AUTOCONF=yes

IPV6_DEFROUTE=yes

IPV6_FAILURE_FATAL=no

IPV6_ADDR_GEN_MODE=stable-privacy

NAME=enp3s0

UUID=1348bb5f-79e3-32bf-9455-b860e8953474

DEVICE=enp3s0

ONBOOT=yes

BOOTPROTO=none

AUTOCONNECT_PRIORITY=-999

На *controller*

[root@controller ~]# openstack network list

+--------------------------------------+----------+--------------------------------------+

| ID | Name | Subnets |

+--------------------------------------+----------+--------------------------------------+

| 8631559b-687c-4907-9e01-33207758f248 | provider | 79221fb2-cd00-44ff-b15b-5868dac481d1 |

+--------------------------------------+----------+--------------------------------------+

[root@controller ~]# openstack subnet list

+--------------------------------------+----------+--------------------------------------+------------------+

| ID | Name | Network | Subnet |

+--------------------------------------+----------+--------------------------------------+------------------+

| 79221fb2-cd00-44ff-b15b-5868dac481d1 | provider | 8631559b-687c-4907-9e01-33207758f248 | 100.100.224.0/24 |

+--------------------------------------+----------+--------------------------------------+------------------+

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

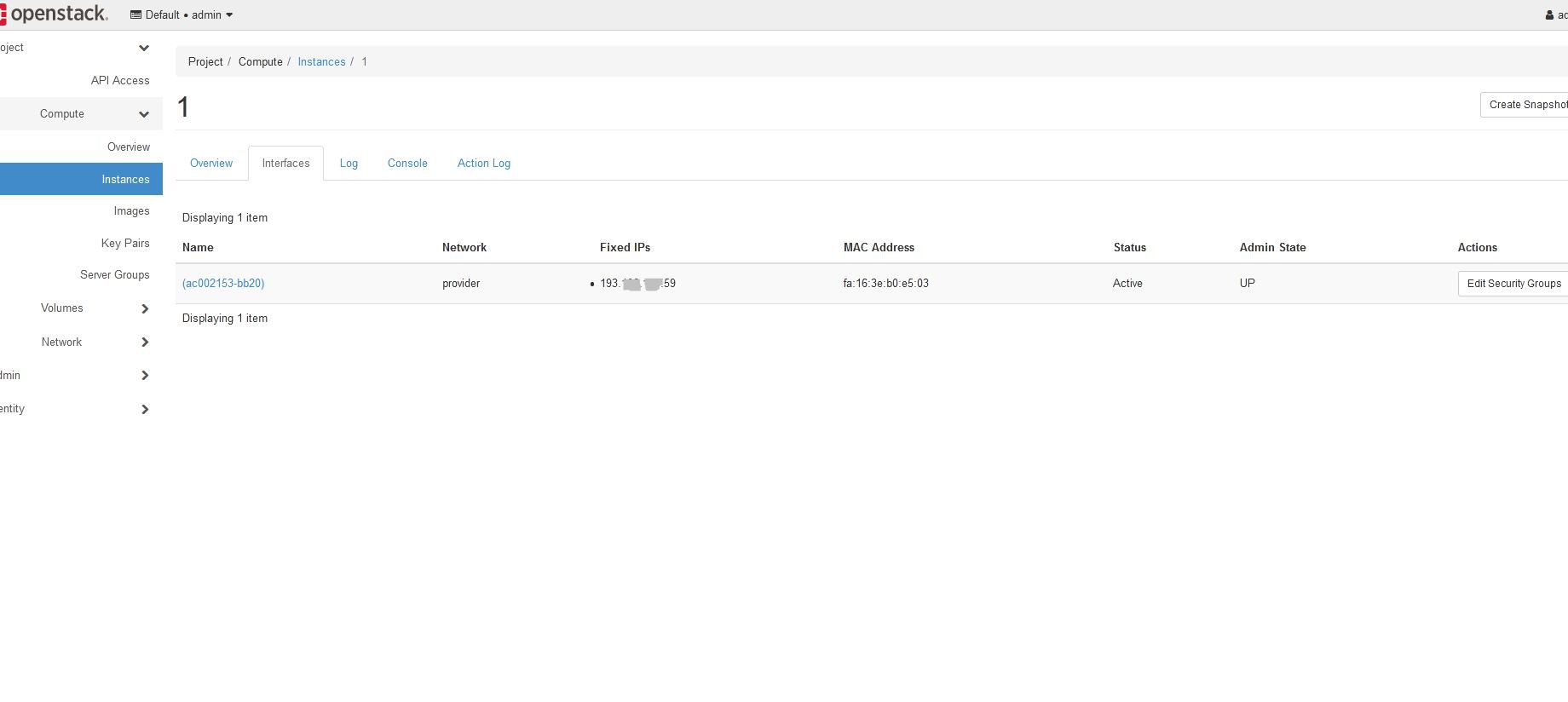

Откуда там взялся 193.x.x.59, если у вас эта сеть на картинках и в выхлопе команд не значится?

Извиняюсь. На картинке выдуманная сеть, чтобы не светить белые IP

Я и твой кот

Я и твой кот

Извиняюсь. На картинке выдуманная сеть, чтобы не светить белые IP

Так у вас dhcp включен в provider network?

Я и твой кот

Я и твой кот

Могу ошибаться, но для external network dhcp по умолчанию не включается. Считается, что вы сами руками адрес навесите.

Maksimus Ulibikus

Maksimus Ulibikus

Могу ошибаться, но для external network dhcp по умолчанию не включается. Считается, что вы сами руками адрес навесите.

Но почему тогда адрес из диапазона выделился инстансу?

Я и твой кот

Я и твой кот

Но почему тогда адрес из диапазона выделился инстансу?

Потому что пул есть, сеть есть. Адрес выделился из пула. В базе выделился.

Я и твой кот

Я и твой кот

DHCP включён.

Подампите трафик, посмотрите связность от dnsmasq до интерфейса инстанса.

Я и твой кот

Я и твой кот

inb4, опять из опенстека vmware делают – виртуалкам адреса из провайдерской сети раздают…

Maksimus Ulibikus

Maksimus Ulibikus

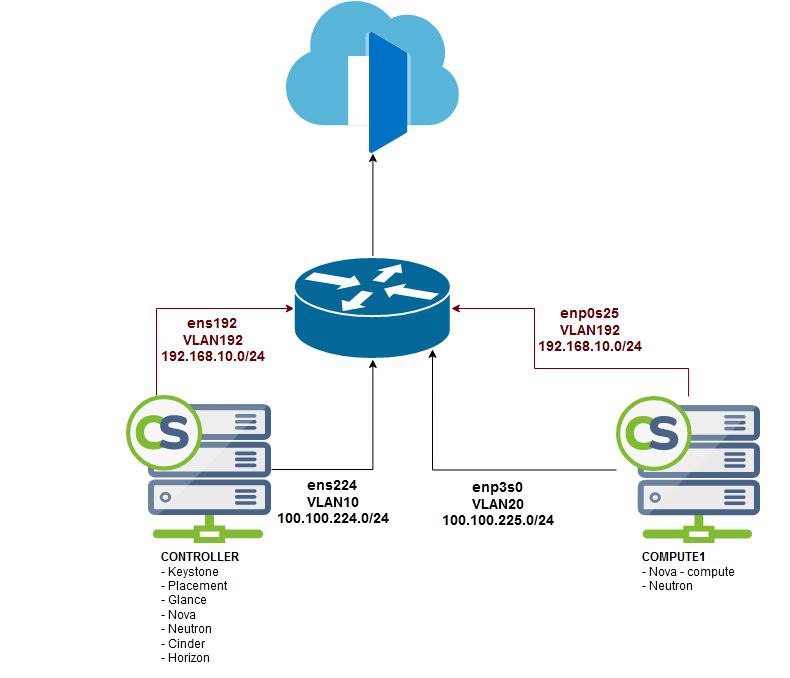

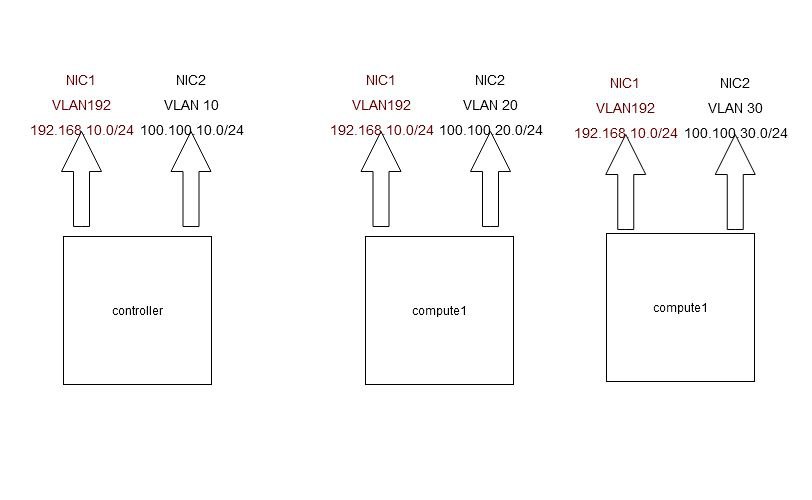

Обязательно ли, чтобы provider интерфейс был в одной сети на controller и compute?

В моём случае по рисунку на controller provider в одной сети, а на compute provider в другой сети.

Aleksey

Aleksey

Aleksey

Aleksey

Необходимо что бы мембер мог создавать флейворы и все)

смотри, у хорайзена есть своя пачка policy.json(yml) файлов, крутя там крутилками можно открыть нужные или не нужные разделы

Ask

Ask

Я и твой кот

Я и твой кот

Обязательно ли, чтобы provider интерфейс был в одной сети на controller и compute?

В моём случае по рисунку на controller provider в одной сети, а на compute provider в другой сети.

Обязательно в одном L2 домене. DHCP как-бы напрямую работает только в L2 домене.

Я и твой кот

Я и твой кот

Ilya

Ilya

Ilya

Ilya

Метаданные пробрасывают от каждой такой сети сами агенты - в них обычно есть правила, которые слушают по 169.254.169.254 и форвардят такие реквесты в нову, возможно, облагораживая дополнительными данными

J

J

Метаданные пробрасывают от каждой такой сети сами агенты - в них обычно есть правила, которые слушают по 169.254.169.254 и форвардят такие реквесты в нову, возможно, облагораживая дополнительными данными

Да, в документации так и написано, кстати. И даже нарисовано)

Ilya

Ilya

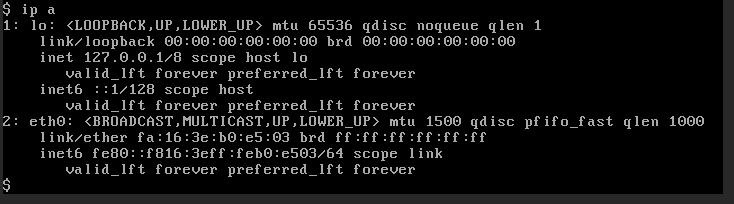

Если IP не прилетел на ВМ, значит между агентом и ВМ нет связности по L2 (если соответсвующая лиза в днсмаске в агентах присутствует). Как вариант - ВМке дали адрес в одной сети, а она поднялась на гипере с другой сетью, и ответ от агента не прилетел.

Ilya

Ilya

На на гипере на бридже, куда воткнулась ВМ смотрим, что это бридж от той ВМ и он настроен на правильный VLAN. Далее включаем tcpdump на гипере на этом бридже и в консоли ВМ делаем перезапрос лизы. Видим пакетик с реквестом ушел ? Если да, а ответа нет - надо идти в неймспейсы агента в нашей сети для ВМ и смотреть tcpdump там - пришел ли реквест туда...

Ilya

Ilya

Да, там на картинке у него МАРШРУТОРИЗАТОР вместо свича.

Да, но это может значить всё что угодно... Например, что на свиче созданы SVI шлюзов во всех сетях, которые спускаются на серверы

Andrey

Andrey

в общем я бы смотрел в сторону компонента, где отваливается коннект (если конечно коннекты не массово с разных компонентов отваливаются) и смотрел, чем в этот момент он был занят

Нашел в логах nova-conductor. Поправил во всех сервисах. Полегчало.

2021-08-16 14:04:26.517 21 WARNING oslo.messaging._drivers.pool [req-a90acb21-1d8e-43a6-ad99-920c93daf2a3 - - - - -] Connection pool limit exceeded: current size 30 surpasses max

configured rpc_conn_pool_size 30

Andrey

Andrey

конца ошибкам нету

Может кто сталкивался? Лог из nova-api

2021-08-17 08:17:06.096253 Timeout when reading response headers from daemon process 'nova-api': /var/lib/kolla/venv/bin/nova-api-wsgi

kolla (Victoria)

Maksimus Ulibikus

Maksimus Ulibikus

Не могу понять.

В этой доке по настройке linuxbridge https://docs.openstack.org/neutron/wallaby/admin/deploy-lb-provider.html написано In the dhcp_agent.ini file, configure the DHCP agent, но у меня в /etc/neutron нет файла dhcp_agent.ini.

Получается надо установить какой-то пакет?

Maksimus Ulibikus

Maksimus Ulibikus

Настраивал Neutron на compute ноде по этой документации и там вообще ни слова об этом https://docs.openstack.org/neutron/victoria/install/compute-install-rdo.html

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

Вы доки от разных версий зачем читаете? Читайте по своей версии.

Здесь тоже самое https://docs.openstack.org/neutron/victoria/admin/deploy-lb-provider.html

J

J

Здесь тоже самое https://docs.openstack.org/neutron/victoria/admin/deploy-lb-provider.html

Ну установи себе packstack где-нибудь и смотри на него в качестве образца: там тебе и конфиги все по местам будут разложены и в рабочем виде все. И играйся с ручной настройкой сколько хочешь посматривая на packstack.

Я и твой кот

Я и твой кот

Нет его

А как вы всё остальное ставили? В https://docs.openstack.org/neutron/victoria/install/controller-install-option1-ubuntu.html и https://docs.openstack.org/neutron/victoria/install/controller-install-option2-ubuntu.html dhcp-agent устанавливается, он есть.

J

J

А как вы всё остальное ставили? В https://docs.openstack.org/neutron/victoria/install/controller-install-option1-ubuntu.html и https://docs.openstack.org/neutron/victoria/install/controller-install-option2-ubuntu.html dhcp-agent устанавливается, он есть.

Ну так для центоси документация похуже поддерживается.

Maksimus Ulibikus

Maksimus Ulibikus

А как вы всё остальное ставили? В https://docs.openstack.org/neutron/victoria/install/controller-install-option1-ubuntu.html и https://docs.openstack.org/neutron/victoria/install/controller-install-option2-ubuntu.html dhcp-agent устанавливается, он есть.

Там о контроллере речь, а я о compute. В центоси тоже на контроллере ставятся эти агенты

Maksimus Ulibikus

Maksimus Ulibikus

И очередная проблема со вчерашнего дня.

Создал сеть, подсеть - все нормально. Удалил сеть и подсеть. Пробую снова создать и ...

Unable to create the network. No tenant network is available for allocation. Neutron server returns request_ids: ['req-0896dc86-8ec1-4882-b406-f54d826350ba']

Каким образом ему потребовался tenant network, если в режиме provider этого не надо?

Весь вечер гуглил по этой проблеме и ничего.

Есть хоть какие-нибудь соображения?

J

J

И очередная проблема со вчерашнего дня.

Создал сеть, подсеть - все нормально. Удалил сеть и подсеть. Пробую снова создать и ...

Unable to create the network. No tenant network is available for allocation. Neutron server returns request_ids: ['req-0896dc86-8ec1-4882-b406-f54d826350ba']

Каким образом ему потребовался tenant network, если в режиме provider этого не надо?

Весь вечер гуглил по этой проблеме и ничего.

Есть хоть какие-нибудь соображения?

А почему ты не хочешь devstack или packstack установить и посмотреть как всё работает в правильно настроенной конфигурации?

Maksimus Ulibikus

Maksimus Ulibikus

А почему ты не хочешь devstack или packstack установить и посмотреть как всё работает в правильно настроенной конфигурации?

Нет больше доступных серверов. Вот поэтому

J

J

Нет больше доступных серверов. Вот поэтому

Да хоть на своем компе личном, там особо много ресурсов не нужно.

J

J

Нет больше доступных серверов. Вот поэтому

Виртуалку у себя же создай и в ней делай. Разницы с физическим хостом никакой.

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

Команда какая?

Никакая )) То есть пробовал создать сеть в горизонте. В первый раз кстати из командной строки создал без ошибок.

Maksimus Ulibikus

Maksimus Ulibikus

Виртуалку у себя же создай и в ней делай. Разницы с физическим хостом никакой.

Попросил. Попробую туда контроллер

Я и твой кот

Я и твой кот

Никакая )) То есть пробовал создать сеть в горизонте. В первый раз кстати из командной строки создал без ошибок.

Из консоли создавайте, или админом в хорайзоне. Провайдеровскую внешнюю. Юзеры провайдерские внешние сетки по дефолту создавать не могут. Если бы вы попробовали - получили бы ошибку доступа. А по тексту ошибки всё выглядит так, словно вы пользовательскую сеть создать попытались.

Maksimus Ulibikus

Maksimus Ulibikus

Из консоли создавайте, или админом в хорайзоне. Провайдеровскую внешнюю. Юзеры провайдерские внешние сетки по дефолту создавать не могут. Если бы вы попробовали - получили бы ошибку доступа. А по тексту ошибки всё выглядит так, словно вы пользовательскую сеть создать попытались.

Хм... И варавду пытался пользовательскую 😁🤦🏼♂️

Илья | 😶☮️🐸

Илья | 😶☮️🐸

А у кого был опыт перехода с гибрида ovs + iptables на ovs?

есть что-то почитать по этой теме ?

Я и твой кот

Я и твой кот

Там кроме настроек neutron и ovs compute какие ещё камни словить можно?

Возможно, в базе что-то останется?

NS 🇷🇺

NS 🇷🇺

По идеи база там ни как не меняется

думаю меняется и для старых вм у тебя перестанут скорее всего сек группы работать

Vyacheslav

Vyacheslav

думаю меняется и для старых вм у тебя перестанут скорее всего сек группы работать

Ну это можно в тераформе прокатить будет, но пока я не понимаю с чего бы им менятся - в бд нет команд для iptables

Vladislav

Vladislav