В открытый доступ то выкладывают?

Нет, а после увольнения стирают память

Maksimus Ulibikus

Maksimus Ulibikus

Всем привет.

По Neutron вопрос.

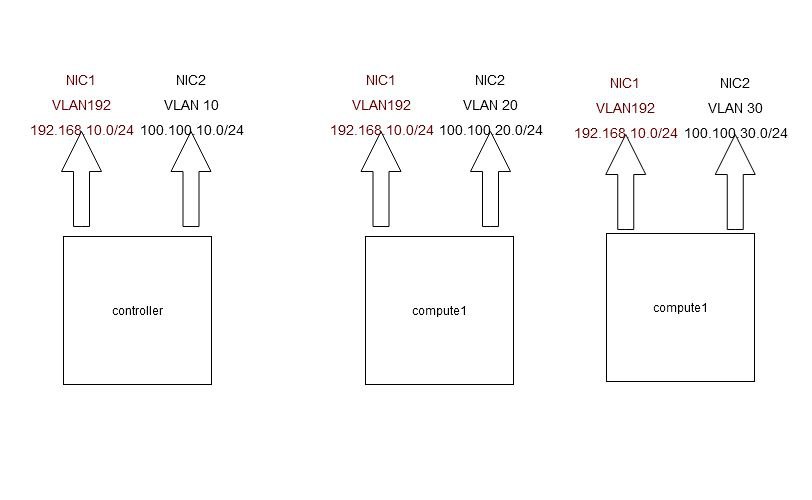

На controller интерфейс смотрит во внешнюю сеть 100.100.10.0/24

На compute1 интерфейс смотрит во внешнюю сеть 100.100.20.0/24

В документации написано, что на controller надо создать подсеть:

openstack subnet create --network provider \

--allocation-pool start=START_IP_ADDRESS,end=END_IP_ADDRESS \

--dns-nameserver DNS_RESOLVER --gateway PROVIDER_NETWORK_GATEWAY \

--subnet-range PROVIDER_NETWORK_CIDR provider

Но у меня ведь на ноде compute1 интерфейс смотрит совсем в другую сеть. Как тут быть?

Zloi

Zloi

Такс .... Ну с flavor боле менее понятно.

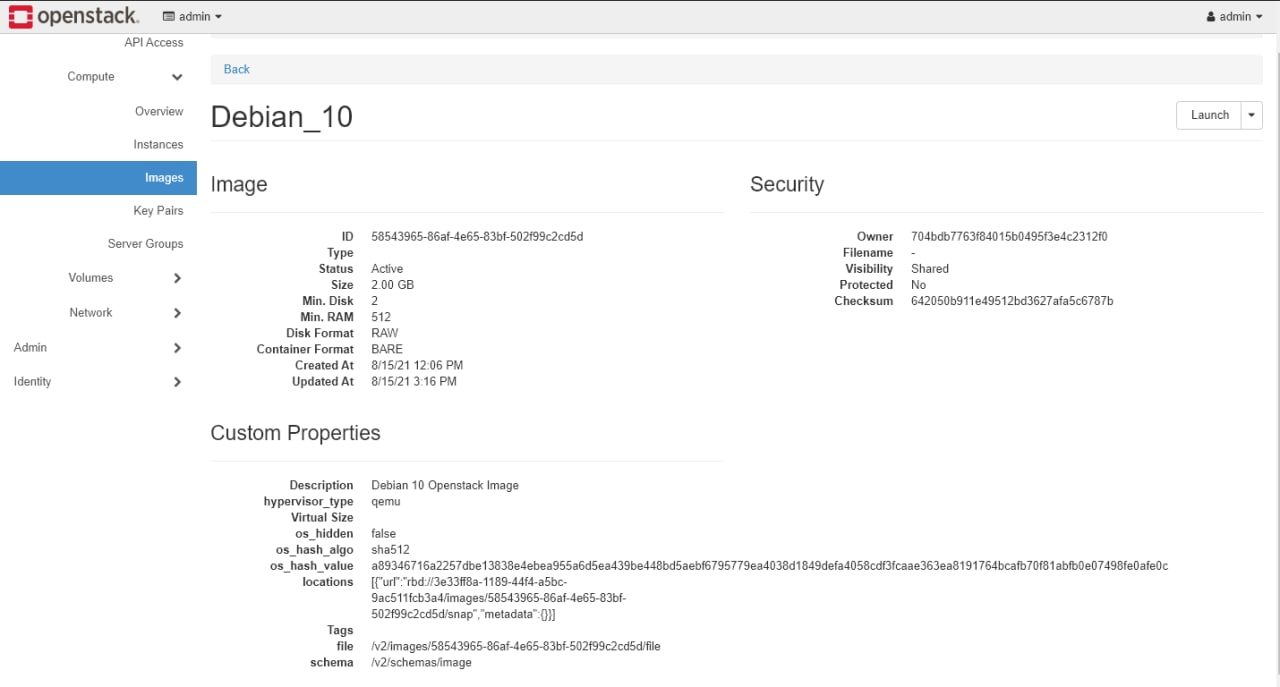

Попробовал создать шаблон ... для тренировки Debian.nano

Вот с такими параметрами

openstack flavor create --id 0 --vcpus 1 --ram 512M --disk 2Gb Debian.nano

Делал через web GUI

Получил ошибку

Ошибка: Failed to perform requested operation on instance "Debian_nano", the instance has an error status: Please try again later [Error: Exceeded maximum number of retries. Exceeded max scheduling attempts 3 for instance c7b1f1e1-ebbe-4d8a-97f9-6447d0ab51e6. Last exception: invalid argument: could not find capabilities for domaintype=kvm ].

Подскажите. В чем проблема? KVM на хоте загружен

lsmod | grep kvm

kvm_intel 217088 0

kvm 614400 1 kvm_intel

irqbypass 16384 1 kvm

Я и твой кот

Я и твой кот

Я и твой кот

Я и твой кот

Всем привет.

По Neutron вопрос.

На controller интерфейс смотрит во внешнюю сеть 100.100.10.0/24

На compute1 интерфейс смотрит во внешнюю сеть 100.100.20.0/24

В документации написано, что на controller надо создать подсеть:

openstack subnet create --network provider \

--allocation-pool start=START_IP_ADDRESS,end=END_IP_ADDRESS \

--dns-nameserver DNS_RESOLVER --gateway PROVIDER_NETWORK_GATEWAY \

--subnet-range PROVIDER_NETWORK_CIDR provider

Но у меня ведь на ноде compute1 интерфейс смотрит совсем в другую сеть. Как тут быть?

Эта сеть для чего? И ссылку на место в доке дайте, и картинку-дизайн с вашими контроллерами, компьютами, интерфейсами и сетями.

J

J

Такс .... Ну с flavor боле менее понятно.

Попробовал создать шаблон ... для тренировки Debian.nano

Вот с такими параметрами

openstack flavor create --id 0 --vcpus 1 --ram 512M --disk 2Gb Debian.nano

Делал через web GUI

Получил ошибку

Ошибка: Failed to perform requested operation on instance "Debian_nano", the instance has an error status: Please try again later [Error: Exceeded maximum number of retries. Exceeded max scheduling attempts 3 for instance c7b1f1e1-ebbe-4d8a-97f9-6447d0ab51e6. Last exception: invalid argument: could not find capabilities for domaintype=kvm ].

Подскажите. В чем проблема? KVM на хоте загружен

lsmod | grep kvm

kvm_intel 217088 0

kvm 614400 1 kvm_intel

irqbypass 16384 1 kvm

Нужно включить debug логирование.

На время пока вы разбираетесь с опенстеком или с какой-то сложной проблемой во всех сервисах нужно в конфигах писать debug=True.

И первое что нужно делать когда возникла проблема это не писать "Ребята, что мне делать, я новенький, помогите", а смотреть логи соответствующего сервиса и искать сообщения с уровнем ERROR или WARNING и смотреть что там около ни еще есть.

Чтобы удобнее было искать в опенстеке даже придумали request id по которому можно логи грепать.

J

J

Еще мне всегда очень помогает гуглить текст ошибки.

Например "Exceeded maximum number of retries. Exceeded max scheduling attempts".

И сразу после пары тычков ссылок в гугле становится понятно в каком направлении стоит поразбираться.

Maksimus Ulibikus

Maksimus Ulibikus

Эта сеть для чего? И ссылку на место в доке дайте, и картинку-дизайн с вашими контроллерами, компьютами, интерфейсами и сетями.

На compute ноде сеть для выдачи белых IP виртуалкам.

У нас куча нод, где крутятся виртуалки. Одни в VLAN-сети 100.100.10.0/24, другие в другой VLAN-сети 100.100.20.0/24, третьи в третьей и тд.

Ссылка на инсталляцию Neutron https://docs.openstack.org/neutron/victoria/install/install-rdo.html

Там дока на controller и compute.

Maksimus Ulibikus

Maksimus Ulibikus

Еще с одной проблемой столкнулся 🤦♂️

Настраиваю controller (keystone, glance, placement, nova, neutron, horizon) на другой ноде.

Под конец установил horizon, пробую залогиниться в дашборд, а не пускает, учетные данные неверны.

Пробую

[root@controller ~]# openstack user set --password-prompt admin

User Password:

Repeat User Password:

Unexpected exception for http://:5000/v3/users?: Invalid URL 'http://:5000/v3/users?': No host supplied

Это какой-то сюр. На прошлом контроллере у меня эта команда нормально отрабатывает, на этом нет. Почему вдруг URL стал битым?

[root@controller ~]# cat admin-openrc

export OS_PROJECT_DOMAIN_NAME=Default

export OS_USER_DOMAIN_NAME=Default

export OS_PROJECT_NAME=admin

export OS_USERNAME=admin

export OS_PASSWORD=qwerty

export OS_AUTH_URL=http://controller:5000/v3

export OS_IDENTITY_API_VERSION=3

export OS_IMAGE_API_VERSION=2

J

J

Maksimus Ulibikus

Maksimus Ulibikus

--debug

https://pastebin.com/tGSwmhnN

REQ: curl -g -i -X GET http://:5000/v3/auth/tokens

J

J

https://pastebin.com/tGSwmhnN

REQ: curl -g -i -X GET http://:5000/v3/auth/tokens

Ну вот и смотри где еще этот твой кривой url в debug выводе появляется.

Maksimus Ulibikus

Maksimus Ulibikus

Ну вот и смотри где еще этот твой кривой url в debug выводе появляется.

Он появляется только в момент ввода и повтора пароля

Maksimus Ulibikus

Maksimus Ulibikus

openstack endpoint list

Не хочет. Вообще любые запросы перестал делать. на выводе одинаковая ошибка с URL

[root@controller ~]# openstack endpoint list

Unexpected exception for http://:5000/v3/endpoints?: Invalid URL 'http://:5000/v3/endpoints?': No host supplied

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Сколько же вам платят, что вы даже в выходной день работаете… 500к+, наверное.

у самурая нет цели, только путь

Я и твой кот

Я и твой кот

Выходные дни оплачиваются в двойном размере. Допустим, им платят 400 000₽ в месяц за 20 рабочих дней. Значит, за оставшиеся 10 выходных дней они получают ещё 400 000₽ сверху. Итого их зарплата около 800 000 руб. в месяц.

J

J

Maksimus Ulibikus

Maksimus Ulibikus

С этим разобрались, но по прежнему не могу зайти в Horizon.

Он берет пароль из кейстона. У меня пароль на admin стоит как qwerty.

Попробовал на всякий случай обновить пароль командой openstack user set --password-prompt admin пароль обновил, но Horizon по прежнему не пускает.

Zloi

Zloi

Нужно включить debug логирование.

На время пока вы разбираетесь с опенстеком или с какой-то сложной проблемой во всех сервисах нужно в конфигах писать debug=True.

И первое что нужно делать когда возникла проблема это не писать "Ребята, что мне делать, я новенький, помогите", а смотреть логи соответствующего сервиса и искать сообщения с уровнем ERROR или WARNING и смотреть что там около ни еще есть.

Чтобы удобнее было искать в опенстеке даже придумали request id по которому можно логи грепать.

Всегда смотрю логи и если не знаю что и как пытаюсь погуглить и только потом спрашиваю..

Сюда написал потому что не нашел ответа в гугле, либо просто из за отсутствия опыта не знаю на что обратить внимание. Ну если Вам настолько тяжело ответить то можно было просто промолчать.

Лично у меня когда есть ответ на какой то вопрос или по крайней мере знаю в какую сторону посмотреть то делюсь а не вызываю токсичность.

Aleksey

Aleksey

Сколько же вам платят, что вы даже в выходной день работаете… 500к+, наверное.

А как же желание разобраться или технологии надо изучать только в рабочее время?

J

J

Zloi

Zloi

Ну вот и посмотри что в логе nova-scheduler)

docker logs nova_scheduler

+ sudo -E kolla_set_configs

INFO:main:Loading config file at /var/lib/kolla/config_files/config.json

INFO:main:Validating config file

INFO:main:Kolla config strategy set to: COPY_ALWAYS

INFO:main:Copying service configuration files

INFO:main:Copying /var/lib/kolla/config_files/nova.conf to /etc/nova/nova.conf

INFO:main:Setting permission for /etc/nova/nova.conf

INFO:main:Writing out command to execute

++ cat /run_command

+ CMD=nova-scheduler

+ ARGS=

+ sudo kolla_copy_cacerts

+ [[ ! -n '' ]]

+ . kolla_extend_start

++ [[ ! -d /var/log/kolla/nova ]]

++ mkdir -p /var/log/kolla/nova

+++ stat -c %a /var/log/kolla/nova

++ [[ 2755 != \7\5\5 ]]

++ chmod 755 /var/log/kolla/nova

++ . /usr/local/bin/kolla_nova_extend_start

+ echo 'Running command: '\''nova-scheduler'\'''

+ exec nova-scheduler

Running command: 'nova-scheduler'

greytiger

greytiger

И удобнее всё же грепать. Логи опенстека читать глазами надо хороший опыт иметь. У меня не получается, например

J

J

да

Вот, глянь для начала.

Пригодится не раз ведь.

https://docs.openstack.org/kolla-ansible/latest/user/troubleshooting.html

Zloi

Zloi

Вот, глянь для начала.

Пригодится не раз ведь.

https://docs.openstack.org/kolla-ansible/latest/user/troubleshooting.html

Это я с самого начала начал изучать

Zloi

Zloi

Мне одно не понятно... в nova.conf везде стоит использование qemu .. почему инстанс ругается на kvm &

J

J

Zloi

Zloi

И убери hypervisor_type из метаданных образа. У тебя что, планируются другие типы гипервизоров?

Нет не планируются.. Уберу.. Это попытка пофиксить ошибку с kvm

J

J

Может я не там ищу?

Не там.

Эта опция нужна для nova-compute и nova-api, поэтому в конфиг для scheduler не добавилась.

Zloi

Zloi

я пустил поиск

find / -name nova.conf

/etc/kolla/nova-scheduler/nova.conf

/etc/kolla/nova-novncproxy/nova.conf

/etc/kolla/nova-api/nova.conf

/etc/kolla/nova-conductor/nova.conf

/var/lib/docker/overlay2/8639e4871be0183f6e3b25ee8d2b09f9619abf8deb575102e3d67456437d0d57/merged/etc/nova/nova.conf

/var/lib/docker/overlay2/8639e4871be0183f6e3b25ee8d2b09f9619abf8deb575102e3d67456437d0d57/diff/etc/nova/nova.conf

/var/lib/docker/overlay2/47a8191ae62f71871f03022a5242eca6249703ab35573f64de399d4141ebc9af/merged/etc/nova/nova.conf

/var/lib/docker/overlay2/47a8191ae62f71871f03022a5242eca6249703ab35573f64de399d4141ebc9af/diff/etc/nova/nova.conf

/var/lib/docker/overlay2/40018ffa391582ef37400bfdda418433b73f4bb96a068e321415fe499f2f0d6e/merged/etc/nova/nova.conf

/var/lib/docker/overlay2/40018ffa391582ef37400bfdda418433b73f4bb96a068e321415fe499f2f0d6e/diff/etc/nova/nova.conf

/var/lib/docker/overlay2/baa2d86bd169b10745709c64a99848508d94015adf435f9c96ddee6020be1df9/merged/etc/nova/nova.conf

/var/lib/docker/overlay2/baa2d86bd169b10745709c64a99848508d94015adf435f9c96ddee6020be1df9/diff/etc/nova/nova.conf

Только такие конфиги находит

Zloi

Zloi

в /etc/kolla/nova-conductor/nova.conf есть упоминание о compute_driver = libvirt.LibvirtDriver и все .. про [libvirt] там тоже ничего не сказано

J

J

в /etc/kolla/nova-conductor/nova.conf есть упоминание о compute_driver = libvirt.LibvirtDriver и все .. про [libvirt] там тоже ничего не сказано

Ну забей пока.

compute только на самих гипервизорах есть и там тоже этой опции может не быть. По-умолчанию, у этой опции значение kvm.

J

J

Логи scheduler смотри.

Если внимательно почитешь, увидишь как он последовательно применяет фильтры при планировании сервера и поймешь на каком фильре у него не остается кандидатов на размещение виртуалки.

Zloi

Zloi

Логи scheduler смотри.

Если внимательно почитешь, увидишь как он последовательно применяет фильтры при планировании сервера и поймешь на каком фильре у него не остается кандидатов на размещение виртуалки.

Попытался опять запустить ... вывалил ошибку про kvm

Error: Failed to perform requested operation on instance "Debian", the instance has an error status: Please try again later [Error: Exceeded maximum number of retries. Exceeded max scheduling attempts 3 for instance 1a31a02e-9198-42bf-bd55-baf8b0992685. Last exception: invalid argument: could not find capabilities for domaintype=kvm ].

В логах толком ничего не увидел, либо не знаю на что обратить внимание

https://pastebin.com/UC4SbDs2

Zloi

Zloi

модуль загружен .. и виртуализация включена... это тестовый контур .. и когда его сдавали то при приемке все работало ... потом что т ослучилось и этот контур какое то время был выключен... теперь надо его запустить

Я и твой кот

Я и твой кот

$ lsmod | grep kvm

kvm_intel 217088 0

kvm 614400 1 kvm_intel

irqbypass 16384 1 kvm

Он точно на этой ноде запускает?

J

J

Попытался опять запустить ... вывалил ошибку про kvm

Error: Failed to perform requested operation on instance "Debian", the instance has an error status: Please try again later [Error: Exceeded maximum number of retries. Exceeded max scheduling attempts 3 for instance 1a31a02e-9198-42bf-bd55-baf8b0992685. Last exception: invalid argument: could not find capabilities for domaintype=kvm ].

В логах толком ничего не увидел, либо не знаю на что обратить внимание

https://pastebin.com/UC4SbDs2

Ну вот, значит, надо на compute (на самих гипервизорах) смотреть конфиг nova, проверять загружен ли там модуль kvm и все такое.

Zloi

Zloi

Всё на одном сервере у тебя?

нет .. на 6 серверах.. везде kvm загружен ... это первое что посмотрел

J

J

нет .. на 6 серверах.. везде kvm загружен ... это первое что посмотрел

invalid argument: could not find capabilities for domaintype=kvm

Значит что на последнем гипервизоре где пыталась запуститься виртуалка libvirt считает что система не умеет kvm. Вот и смотри и разбирайся с этим. Раз модуль загружен на всех гипервизорах, значит нужно смотреть включена ли поддержка аппаратной виртуализации. И конфиги новы там тоже проверить на всякий случай.

Zloi

Zloi

Ну вот что имею... на server6 где пытался запуститься инстанс имеем

lsmod | grep kvm

kvm_intel 217088 0

kvm 614400 1 kvm_intel

irqbypass 16384 1 kvm

Pavel

Pavel

Aleksandr

Aleksandr