Перезагружаю ноду, смотрю systemctl status rabbitmq-server.service, а там:

[root@controller ~]# systemctl status rabbitmq-server.service

● rabbitmq-server.service - RabbitMQ broker

Loaded: loaded (/usr/lib/systemd/system/rabbitmq-server.service; enabled; vendor preset: disabled)

Active: failed (Result: exit-code) since Mon 2021-08-09 14:40:57 MSK; 17s ago

Process: 1208 ExecStart=/usr/lib/rabbitmq/bin/rabbitmq-server (code=exited, status=1/FAILURE)

Main PID: 1208 (code=exited, status=1/FAILURE)

Aug 09 14:40:56 controller systemd[1]: Starting RabbitMQ broker...

Aug 09 14:40:57 controller rabbitmq-server[1208]: ERROR: epmd error for host controller: address (cannot connect to host/port)

Aug 09 14:40:57 controller systemd[1]: rabbitmq-server.service: Main process exited, code=exited, status=1/FAILURE

Aug 09 14:40:57 controller systemd[1]: rabbitmq-server.service: Failed with result 'exit-code'.

Aug 09 14:40:57 controller systemd[1]: Failed to start RabbitMQ broker.

При этом если выполню systemctl start rabbitmq-server.service, то сервис спокойной запускается.

Понимаю, что там написано epmd error for host controller: address (cannot connect to host/port), но хост и IP не менял.

В чём может быть причина?

systemctl cat rabbitmq-server

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

systemctl cat rabbitmq-server

[root@controller ~]# systemctl cat rabbitmq-server

# /usr/lib/systemd/system/rabbitmq-server.service

# systemd unit example

[Unit]

Description=RabbitMQ broker

After=network.target epmd@0.0.0.0.socket

Wants=network.target epmd@0.0.0.0.socket

[Service]

Type=notify

User=rabbitmq

Group=rabbitmq

NotifyAccess=all

TimeoutStartSec=3600

# Note:

# You *may* wish to add the following to automatically restart RabbitMQ

# in the event of a failure. systemd service restarts are not a

# replacement for service monitoring. Please see

# https://www.rabbitmq.com/monitoring.html

#

# Restart=on-failure

# RestartSec=10

WorkingDirectory=/var/lib/rabbitmq

ExecStart=/usr/lib/rabbitmq/bin/rabbitmq-server

ExecStop=/usr/lib/rabbitmq/bin/rabbitmqctl stop

ExecStop=/bin/sh -c "while ps -p $MAINPID >/dev/null 2>&1; do sleep 1; done"

[Install]

WantedBy=multi-user.target

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

А epmd сокет что там?

Всё плохо

[root@controller ~]# systemctl list-units --type=socket --all

UNIT LOAD ACTIVE SUB DESCRIPTION

dbus.socket loaded active running D-Bus System Message Bus Socket

dm-event.socket loaded active listening Device-mapper event daemon FIFOs

● epmd@0.0.0.0.socket bad-setting inactive dead Erlang Port Mapper Daemon Activation Socket

iscsid.socket loaded active listening Open-iSCSI iscsid Socket

iscsiuio.socket loaded active listening Open-iSCSI iscsiuio Socket

lvm2-lvmpolld.socket loaded active listening LVM2 poll daemon socket

multipathd.socket loaded active listening multipathd control socket

rpcbind.socket loaded active running RPCbind Server Activation Socket

sssd-kcm.socket loaded active listening SSSD Kerberos Cache Manager responder socket

syslog.socket loaded inactive dead Syslog Socket

systemd-coredump.socket loaded active listening Process Core Dump Socket

systemd-initctl.socket loaded active listening initctl Compatibility Named Pipe

systemd-journald-audit.socket loaded inactive dead Journal Audit Socket

systemd-journald-dev-log.socket loaded active running Journal Socket (/dev/log)

systemd-journald.socket loaded active running Journal Socket

systemd-udevd-control.socket loaded active running udev Control Socket

systemd-udevd-kernel.socket loaded active running udev Kernel Socket

Maksimus Ulibikus

Maksimus Ulibikus

А dmesg ругается:

3.698403] systemd[1]: /usr/lib/systemd/system/epmd@.socket:5: Failed to parse address value in '0.0.0.0', ignoring: Invalid argument

Maksimus Ulibikus

Maksimus Ulibikus

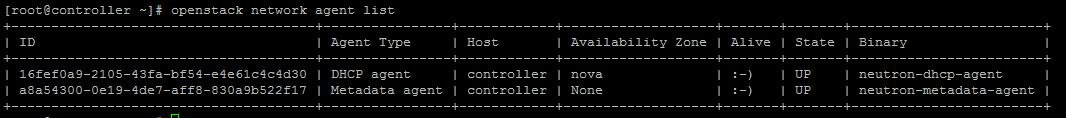

Всем привет.

Не получается настроить Neutron Provider Network, а именно: openstack network agent list не выводит Linux bridge agent ни на controller, ни на compute1

*ПО ДОКЕ НА CONTROLLER*

В /etc/neutron/neutron.conf добавил:

[database]

# ...

connection = mysql+pymysql://neutron:NEUTRON_DBPASS@controller/neutron

[keystone_authtoken]

# ...

www_authenticate_uri = http://controller:5000

auth_url = http://controller:5000

memcached_servers = controller:11211

auth_type = password

project_domain_name = default

user_domain_name = default

project_name = service

username = neutron

password = NEUTRON_PASS

[DEFAULT]

# ...

core_plugin = ml2

service_plugins =

transport_url = rabbit://openstack:RABBIT_PASS@controller

auth_strategy = keystone

notify_nova_on_port_status_changes = true

notify_nova_on_port_data_changes = true

[nova]

# ...

auth_url = http://controller:5000

auth_type = password

project_domain_name = default

user_domain_name = default

region_name = RegionOne

project_name = service

username = nova

password = NOVA_PASS

[oslo_concurrency]

# ...

lock_path = /var/lib/neutron/tmp

В /etc/neutron/plugins/ml2/ml2_conf.ini добавил:

[ml2]

# ...

type_drivers = flat,vlan

tenant_network_types =

mechanism_drivers = linuxbridge

extension_drivers = port_security

[ml2_type_flat]

# ...

flat_networks = provider

[securitygroup]

# ...

enable_ipset = true

В /etc/neutron/plugins/ml2/linuxbridge_agent.ini добавил:

[linux_bridge]

physical_interface_mappings = provider:enp4s0f0

[vxlan]

enable_vxlan = false

[securitygroup]

# ...

enable_security_group = true

firewall_driver = neutron.agent.linux.iptables_firewall.IptablesFirewallDriver

В sysctl добавил:

net.bridge.bridge-nf-call-iptables

net.bridge.bridge-nf-call-ip6tables

В /etc/neutron/dhcp_agent.ini добавил:

interface_driver = linuxbridge

dhcp_driver = neutron.agent.linux.dhcp.Dnsmasq

enable_isolated_metadata = true

В /etc/neutron/metadata_agent.ini добавил:

[DEFAULT]

# ...

nova_metadata_host = controller

metadata_proxy_shared_secret = METADATA_SECRET

В /etc/nova/nova.conf добавил:

[neutron]

# ...

auth_url = http://controller:5000

auth_type = password

project_domain_name = default

user_domain_name = default

region_name = RegionOne

project_name = service

username = neutron

password = NEUTRON_PASS

service_metadata_proxy = true

metadata_proxy_shared_secret = METADATA_SECRET

Добавил символьную ссылку ln -s /etc/neutron/plugins/ml2/ml2_conf.ini /etc/neutron/plugin.ini

Заполнил базу:

su -s /bin/sh -c "neutron-db-manage --config-file /etc/neutron/neutron.conf \

--config-file /etc/neutron/plugins/ml2/ml2_conf.ini upgrade head" neutron

Перезапустил openstack-nova-api.service

Включил остальные:

systemctl start neutron-server.service \

neutron-linuxbridge-agent.service neutron-dhcp-agent.service \

neutron-metadata-agent.service

Maksimus Ulibikus

Maksimus Ulibikus

Вот такая ошибка сыпется в /var/log/neutron/linuxbridge-agent.log https://pastebin.com/89cfAasR

Shokhrukh

Shokhrukh

Вот такая ошибка сыпется в /var/log/neutron/linuxbridge-agent.log https://pastebin.com/89cfAasR

/etc/selinux/config

SELINUX=enforcing - > SELINUX=disabled

Maksimus Ulibikus

Maksimus Ulibikus

Ну и на кой тогда в доке в самом начале предлагают установить selinux компоненты для OS?

Pavel

Pavel

Я про такое: https://bugs.launchpad.net/juniperopenstack/+bug/1689900

Есть более современное, из 8-х версий.

Maksimus Ulibikus

Maksimus Ulibikus

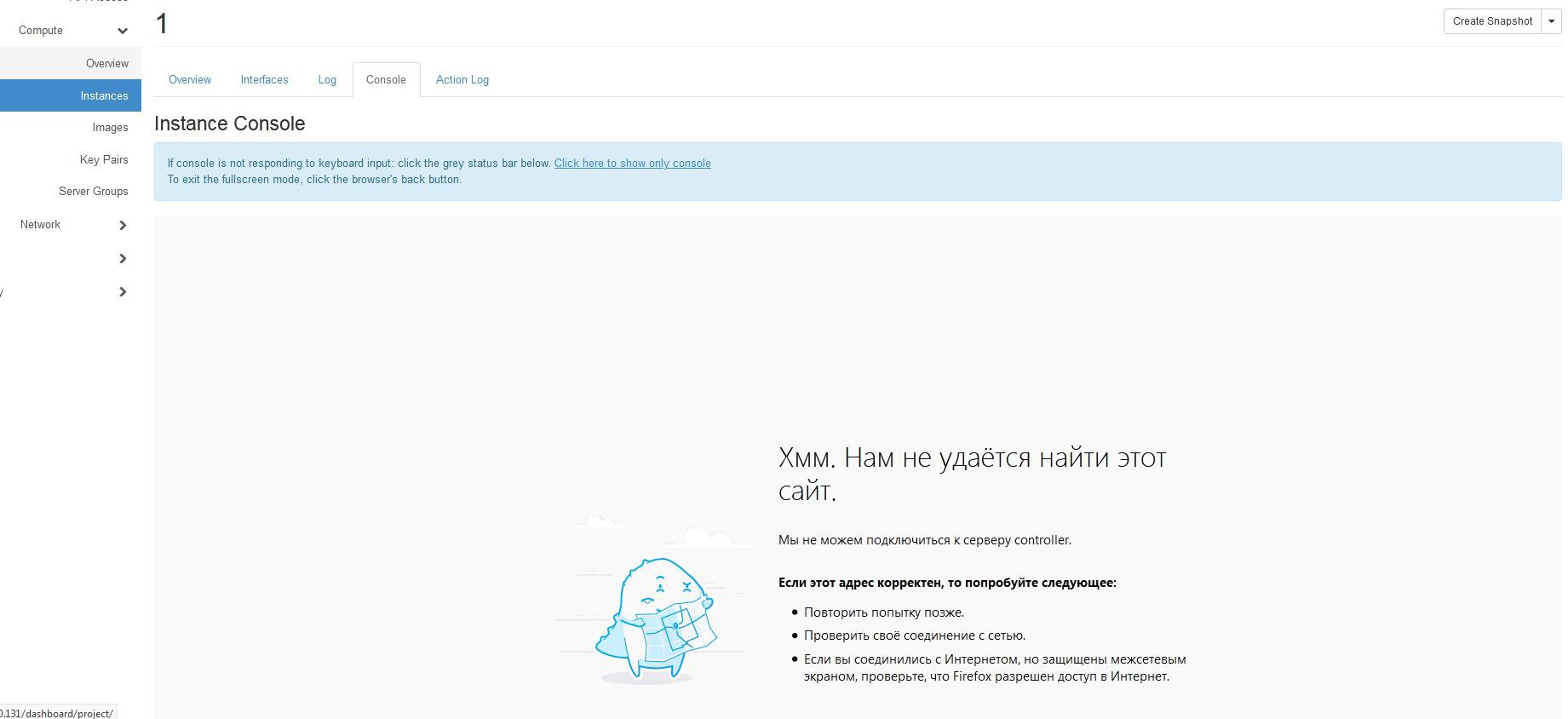

Запустил виртуалку, но консоль не работает. Я так понимаю нужно произвести доп. настройки, чтобы VNC на виртуалке заработал?

Denis

Denis

Не всегда срабатывает.

это включает permissive режим в рантайме. что там в конфиге уже другой вопрос.

Maksimus Ulibikus

Maksimus Ulibikus

Хм... На compute ноде включен VNC. В nova.conf в vnc

[vnc]

enabled = true

server_listen = 0.0.0.0

server_proxyclient_address = $my_ip

novncproxy_base_url = http://controller:6080/vnc_auto.html

В my_ip указал адрес compute ноды

Maksimus Ulibikus

Maksimus Ulibikus

Так. Починил.

В доке явно написано, что надо так novncproxy_base_url = http://controller:6080/vnc_auto.html, но работает только так

novncproxy_base_url = http://ip_address:6080/vnc_auto.html

NS 🇷🇺

NS 🇷🇺

Александр

Александр

Так. Починил.

В доке явно написано, что надо так novncproxy_base_url = http://controller:6080/vnc_auto.html, но работает только так

novncproxy_base_url = http://ip_address:6080/vnc_auto.html

controller это хостнейм. Имеется ввиду что имя свое подставить либо адрес

Artemy

Artemy

Stackoverflow-Driven-Development (*) complete

Stackoverflow-Driven-Deployment <- you are here

StackOverflow-Drive-Usage (???)

Maksimus Ulibikus

Maksimus Ulibikus

или прописать в /etc/hosts и тогда будет работать :)

Это очевидные вещи и все это изначально прописано, но не работает. Где-то все же моя ошибка

Maksimus Ulibikus

Maksimus Ulibikus

что раельно включать голову сейчас не модно?

Не понял. Вы сейчас необоснованно решили, что я голову не включаю, не разобравшись в вопросе. Вы так со всеми общаетесь?

Aleksey

Aleksey

Это очевидные вещи и все это изначально прописано, но не работает. Где-то все же моя ошибка

Т.е. в хостах прописан ip для controller на всех нодах(компьют/контроллеры) и также на клиенте с которого пытаетесь открыть консоль?

Maksimus Ulibikus

Maksimus Ulibikus

Maksimus Ulibikus

Maksimus Ulibikus

Ставлю на то что клиентская тачка ничего не знает про controller

И каким образом на контроллере видна клиентская точка по тому же openstack network agent list ? Тоже наверно по IP?

Aleksey

Aleksey

И каким образом на контроллере видна клиентская точка по тому же openstack network agent list ? Тоже наверно по IP?

у тебя где зfпущен novncproxy?

Александр

Александр

Имелось ввиду что ранее у тебя было вот так

novncproxy_base_url = http://controller:6080/vnc_auto.html тут указано что имя controller. Это же имя будет отличаться и клиенту в вебинтерфейса. Вопрос смог бы клиент резолвить данное имя?

Когда ты изменил имя на адрес

novncproxy_base_url = http://ip_address:6080/vnc_auto.html

То клиенту уже отдается строка с ip адресом и уже ничего резолвить не нужно.

Второе адрес должен быть доступен для клиента.

Я и твой кот

Я и твой кот

Я и твой кот

Я и твой кот

Fedor

Fedor

Нет, вы все токсичные и не разобравшись накинулись)

говорят в ceph_ru очень культурные и отзывчивые люди, не то что здесь

Maksimus Ulibikus

Maksimus Ulibikus

Нет, вы все токсичные и не разобравшись накинулись)

Какое модное слово. А ведь по-русски звучит так: говно 🤣

Maksimus Ulibikus

Maksimus Ulibikus

Ваш комп с браузером не в курсе, какой ip у хоста с именем controller. По-этому такая фигня. В дебаг консоли браузера наверняка видно.

Гм. Я посчитал, что сервер должен резолвить имя, а не мой комп. А тут вон оно как

NS 🇷🇺

NS 🇷🇺

Гм. Я посчитал, что сервер должен резолвить имя, а не мой комп. А тут вон оно как

Это не тут, это везде...

Maksimus Ulibikus

Maksimus Ulibikus

Это не тут, это везде...

Везде это где? Я же писал выше, что обе ноды резолвятся между собой по именам

Aleksey

Aleksey

Везде это где? Я же писал выше, что обе ноды резолвятся между собой по именам

вот как ты в интернет ходишь?

Я и твой кот

Я и твой кот

Я и твой кот

Я и твой кот

К слову, если работать в божественном Safari, то он hostname сайта покажет в тексте ошибки.

Что сделало бы ошибку наглядной и очевидной.

Timur

Timur

Приветствую.

Пытаюсь установить openstack через juju. Затык на настройке vault.

juju run-action vault/leader --wait authorize-charm token=s.2Lwgk3L2IUiiWA5vexDbFUGi

Выдает could not determine leader for "vault". Подскажите что он хочет. В sys/leader значение "leader_address" пустое

Maksimus Ulibikus

Maksimus Ulibikus

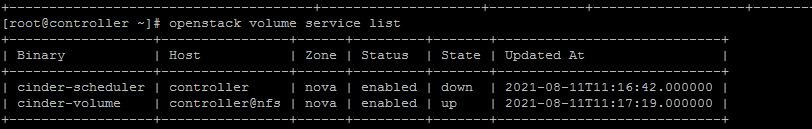

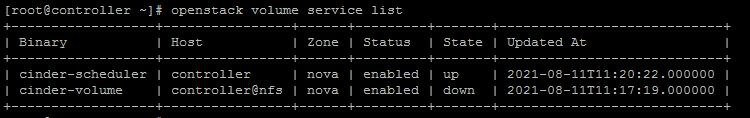

Кто-нибудь может подсказать, почему при openstack volume service list сначала cinder-scheduler down и cinder-volume up, а потом наоборот?

NS 🇷🇺

NS 🇷🇺

NS 🇷🇺

NS 🇷🇺

Дело в том, что Cinder там же где и Controller

да какая разница где …. если у тебя разное время, то сушите весла

Maksimus Ulibikus

Maksimus Ulibikus

да какая разница где …. если у тебя разное время, то сушите весла

Как оно может быть разное в пределах одного хоста?

J

J

Дело в том, что Cinder там же где и Controller

Включи на время настройки хотя бы во всех сервисах debug = True и читай логи побольше.

Глядишь, часть вопросов сам сможешь решить. Щас вот надо логи посмотреть, мне кажется, а не пальцем в небо тыкать.

Илья | 😶☮️🐸

Илья | 😶☮️🐸