greytiger

greytiger

делал

nova image-create instance image-name

потом

glance image-download image-name —file outfile.qcow2

greytiger

greytiger

https://docs.openstack.org/project-deploy-guide/tripleo-docs/latest/post_deployment/vm_snapshot.html

greytiger

greytiger

До этого через веб делал снапшот вмки, дальше из гланса сохранял в qcow2 без каких-либо проблем

greytiger

greytiger

openstack image create --volume fb54fa26-e0f5-4f8d-a6d0-63219eda72a0 image.qcow2

Invalid volume: Volume fb54fa26-e0f5-4f8d-a6d0-63219eda72a0 status must be available (HTTP 400) (Request-ID: req-a49cd667-8683-4a5d-83cb-599b92aca07d)

greytiger

greytiger

Попробовал на деаттачнутом волюме

+---------------------+--------------------------------------+

| Field | Value |

+---------------------+--------------------------------------+

| container_format | bare |

| disk_format | raw |

| display_description | None |

| id | b14c9bd9-0815-4736-a8c7-624eac89651d |

| image_id | 984ce500-6de9-4b60-8ed9-277606bcfebf |

| image_name | /root/image.qcow2 |

| protected | False |

| size | 30 |

| status | uploading |

| updated_at | 2021-08-06T19:56:43.000000 |

| visibility | shared |

| volume_type | DEFAULT |

+---------------------+--------------------------------------+

greytiger

greytiger

Вроде бы нашёл проблему

Failed to upload image data due to HTTP error: webob.exc.HTTPRequestEntityTooLarge: Image storage media is full: There is not enough disk space on the image storage media.

Maksimus Ulibikus

Maksimus Ulibikus

Всем привет.

В OpenNebula на хосте А устанавливаю собственно opennebula с дашбодом, а на хосте Б ставлю только opennebula-kvm.

Затем на хосте А в кластер просто добавляю хост Б и создаю ВМ.

На OS так можно? Я так понимаю достаточно только установить Nova?

Pavel

Pavel

Опенебула это все в одном. Опенстек разделен на компоненты. Как минимум на компьт году Нова-компьют и нейтрон агент который у вас используется

lolwww

lolwww

Всем привет.

В OpenNebula на хосте А устанавливаю собственно opennebula с дашбодом, а на хосте Б ставлю только opennebula-kvm.

Затем на хосте А в кластер просто добавляю хост Б и создаю ВМ.

На OS так можно? Я так понимаю достаточно только установить Nova?

Можно поставить microstack и хост Б добавить как компьюту 😉

Александр

Александр

Понял спасибо

OS состоит из конторл ноды на которой должны быть установлены соответвующие службы и пакеты и есть вычислительные годы на них другие службы. Все отлично описано в документации опенстека

Maksimus Ulibikus

Maksimus Ulibikus

OS состоит из конторл ноды на которой должны быть установлены соответвующие службы и пакеты и есть вычислительные годы на них другие службы. Все отлично описано в документации опенстека

Можете поделиться ссылкой по этой теме на документацию?

Maksimus Ulibikus

Maksimus Ulibikus

https://docs.openstack.org/install-guide/get-started-logical-architecture.html

В очередной раз смотрю на эту схему и тихонько офигеваю 😁

Maksimus Ulibikus

Maksimus Ulibikus

Ребята, прошу помочь. Застрял на шаге установки Keystone https://docs.openstack.org/keystone/victoria/install/keystone-install-obs.html

У меня CentOS 8. В разделе "Install and configure components" пишут:

1. Run the following command to install the packages:

# zypper install openstack-keystone apache2 apache2-mod_wsgi

И ни слова о других ОС. Значит ли это, что в моём случае будет yum install openstack-keystone apache2 apache2-mod_wsgi

Даже если так, то:

[root@openstack1 ~]# yum install apache2

Last metadata expiration check: 0:18:45 ago on Sat 07 Aug 2021 06:08:45 PM MSK.

No match for argument: apache2

Я и твой кот

Я и твой кот

Maksimus Ulibikus

Maksimus Ulibikus

Но вот тут в разделе "Configure the Apache HTTP server" написано:

Edit the /etc/sysconfig/apache2 file and configure the APACHE_SERVERNAME option to reference the controller node:

APACHE_SERVERNAME="controller"

У меня нет пути /etc/sysconfig/apache2 ведь у меня httpd и путь его /etc/httpd.

Где тогда прописать эту строку?

Maksimus Ulibikus

Maksimus Ulibikus

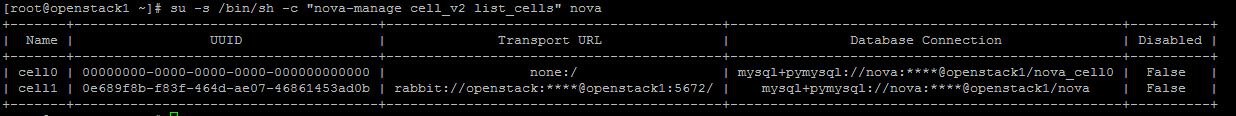

Устанавливаю Nova.

Отредактировал конфиг. Заполнил базу. Создал cell0, а вот при создании cell1 ошибка.

В чём может быть причина?

[root@openstack1 ~]# vi /etc/nova/nova.conf

[root@openstack1 ~]# su -s /bin/sh -c "nova-manage api_db sync" nova

[root@openstack1 ~]# su -s /bin/sh -c "nova-manage cell_v2 map_cell0" nova

[root@openstack1 ~]# su -s /bin/sh -c "nova-manage cell_v2 create_cell --name=cell1 --verbose" nova

--transport-url not provided in the command line, using the value [DEFAULT]/transport_url from the configuration file

--database_connection not provided in the command line, using the value [database]/connection from the configuration file

0e689f8b-f83f-464d-ae07-46861453ad0b

Pavel

Pavel

transport_url кто будет прописывать?

на схеме же ясно написано что все сервисы в рамках одной службы общаются через рабит, за редкими исключениями

Maksimus Ulibikus

Maksimus Ulibikus

transport_url кто будет прописывать?

на схеме же ясно написано что все сервисы в рамках одной службы общаются через рабит, за редкими исключениями

Я понимаю и у меня он прописан в nova.conf

[DEFAULT]

enabled_apis = osapi_compute,metadata

transport_url = rabbit://openstack:qwerty@openstack1:5672/

Maksimus Ulibikus

Maksimus Ulibikus

Хотя стоп а где там ошибка? Там только оповещения что и откуда берет

Хм...

Я воспринял за ошибку от этого слова: not provided

Maksimus Ulibikus

Maksimus Ulibikus

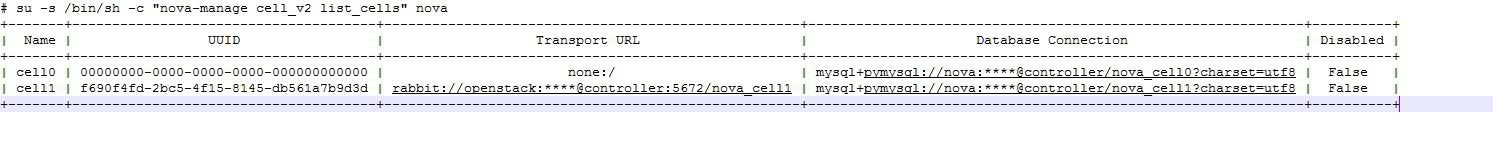

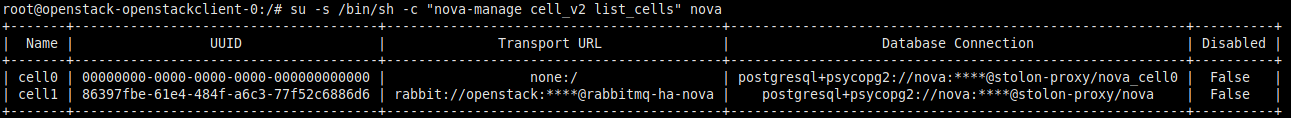

Хорошо. Если это не ошибка, хочу убедиться, что у меня всё ок.

Кто-нибудь может показать вывод команды su -s /bin/sh -c "nova-manage cell_v2 list_cells" nova

Чтобы свериться, полный ли у меня порядок?

Maksimus Ulibikus

Maksimus Ulibikus

А подскажите пожалуйста в чем разница Provider networks от Self-service networks? Прочитал, но всё равно еще не понял в каких случаях использовать Self-service networks.

Ilya

Ilya

А подскажите пожалуйста в чем разница Provider networks от Self-service networks? Прочитал, но всё равно еще не понял в каких случаях использовать Self-service networks.

Provider networks - сети определяемые администратором, с которыми пользователь клауда ничего сделать не может (кроме как использовать если разрешат 😂), self-service сети - сети жизненным циклом которых управляет сам пользователь (создаёт, удаляет, к виртуальным маршрутизаторам подключает…)

Maksimus Ulibikus

Maksimus Ulibikus

Provider networks - сети определяемые администратором, с которыми пользователь клауда ничего сделать не может (кроме как использовать если разрешат 😂), self-service сети - сети жизненным циклом которых управляет сам пользователь (создаёт, удаляет, к виртуальным маршрутизаторам подключает…)

То есть пользователь клауда это не только клиент, но сам админ?

Maksimus Ulibikus

Maksimus Ulibikus

А обязательно разворачивать Nova на второй ноде или можно закончить установку, установив Nova только на controller-ноде?

Anton

Anton

Provider networks - сети определяемые администратором, с которыми пользователь клауда ничего сделать не может (кроме как использовать если разрешат 😂), self-service сети - сети жизненным циклом которых управляет сам пользователь (создаёт, удаляет, к виртуальным маршрутизаторам подключает…)

Надо добавить, что provider networks не просто неуправляемые сети, но и сети с конкретной заточкой под массовый сервис со всеми вытекающими.

Pavel

Pavel

nova-api на второй ноде не нужен (в текущем кейсе)

nova-compute нужен - это проклдака для libvirt

Ilya

Ilya

То есть пользователь клауда это не только клиент, но сам админ?

Есть такая роль. Ещё надо добавить, что provider networks - это как правило mapping на сеть определённую за пределами openstack. Может быть mapping на физическую сеть.

Maksimus Ulibikus

Maksimus Ulibikus

nova-api на второй ноде не нужен (в текущем кейсе)

nova-compute нужен - это проклдака для libvirt

Не понял только про текущий кейс

Maksimus Ulibikus

Maksimus Ulibikus

Вы же сейчас не делаете HA?

Нет. Сейчас все на тестовой среде. OpenNebula развернул, понравилось, можно и в прод отправить. Теперь хочу понять, может стоит остановиться на OS.

Maksimus Ulibikus

Maksimus Ulibikus

OS явно сложнее четм небула но и плюшек больше

Я это уже понял )) Завалил первую попытку установки. Так и не понял, на каком модуле перестал работать httpd. Сейчас попытка №2.

Maksimus Ulibikus

Maksimus Ulibikus

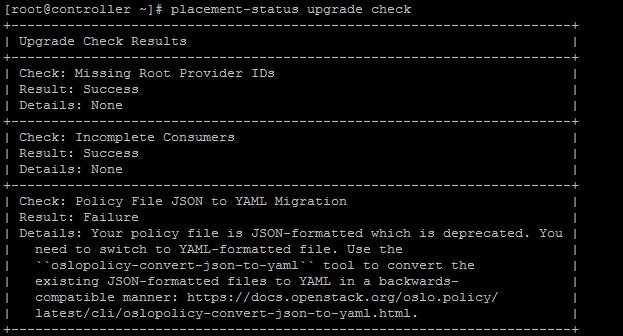

Получил ругань что надо бы конвертировать. По ссылке в доке есть только пример для keystone https://docs.openstack.org/oslo.policy/latest/cli/oslopolicy-convert-json-to-yaml.html

Я так понял мне нужно выполнить конвертацию для placement?

NS 🇷🇺

NS 🇷🇺

пора судя по всему возобновлять дело Радика Юсупова и открвать курсы для тех кто не может в доки =)

Maksimus Ulibikus

Maksimus Ulibikus

пора судя по всему возобновлять дело Радика Юсупова и открвать курсы для тех кто не может в доки =)

Может в доки )

У меня 1:13 ночи просто хочется побыстрее дойти до модуля neutron, а утром уже спокойно в этот модуль вникать

Maksimus Ulibikus

Maksimus Ulibikus

Перезагружаю ноду, смотрю systemctl status rabbitmq-server.service, а там:

[root@controller ~]# systemctl status rabbitmq-server.service

● rabbitmq-server.service - RabbitMQ broker

Loaded: loaded (/usr/lib/systemd/system/rabbitmq-server.service; enabled; vendor preset: disabled)

Active: failed (Result: exit-code) since Mon 2021-08-09 14:40:57 MSK; 17s ago

Process: 1208 ExecStart=/usr/lib/rabbitmq/bin/rabbitmq-server (code=exited, status=1/FAILURE)

Main PID: 1208 (code=exited, status=1/FAILURE)

Aug 09 14:40:56 controller systemd[1]: Starting RabbitMQ broker...

Aug 09 14:40:57 controller rabbitmq-server[1208]: ERROR: epmd error for host controller: address (cannot connect to host/port)

Aug 09 14:40:57 controller systemd[1]: rabbitmq-server.service: Main process exited, code=exited, status=1/FAILURE

Aug 09 14:40:57 controller systemd[1]: rabbitmq-server.service: Failed with result 'exit-code'.

Aug 09 14:40:57 controller systemd[1]: Failed to start RabbitMQ broker.

При этом если выполню systemctl start rabbitmq-server.service, то сервис спокойной запускается.

Понимаю, что там написано epmd error for host controller: address (cannot connect to host/port), но хост и IP не менял.

В чём может быть причина?

Илья | 😶☮️🐸

Илья | 😶☮️🐸

Dmitry

Dmitry

Shokhrukh

Shokhrukh