Sergej

Sergej

а кто каую файловую систему использует под ОС k8. У нас недавно что-то подвисло на тестовом стенде и поды быстро расплодившись исчерпали inode.

Vasily

Vasily

Vasily

Vasily

Vasily

Vasily

Это шоурум. Там однонодовый кластер. Дальше Уже минимум 3 ноды. На проде будет три мастера.

Тогда надо логи курить)

Logan

Logan

а кто каую файловую систему использует под ОС k8. У нас недавно что-то подвисло на тестовом стенде и поды быстро расплодившись исчерпали inode.

ext4 под ОС, xfs под данные. с докером нормально скрещивается только XFS, как я понимаю

Sergej

Sergej

Zon

Zon

Logan

Logan

Как то исторически aufs ставится

я использую overlayfs2, но она по сути - не FS, с голыми дисками работать не может

Sergej

Sergej

Но не стоит так делать.

А почему? У меня как раз были проблемы с оверлей2 даже было время когда мастер kubeadm не хотел активироваться с этой фс.

Sergej

Sergej

Кстати в рекомендации встречал "we will continue to recommend users to use the default storage backend, which is Aufs as of now."

Vladimir

Vladimir

А я вот в первый, и, наверно, последний раз, воспользовался CentOS в качестве ОС для Docker

Anonymous

Anonymous

А я вот в первый, и, наверно, последний раз, воспользовался CentOS в качестве ОС для Docker

В чем проблема? Более года в проде, именно centos 7.x и последний docker 1.13

Vladimir

Vladimir

Так получилось, что нужно было развернуть один сервис, а под рукой была только виртуалка с CentOS. Развертывание нужно было для внутреннего использования, поэтому я решил просто поставить докер и в нем развернуть то, что нужно

Vladimir

Vladimir

И все было прекрасно на протяжении нескольких месяцев. Потом виртуалка стала подвисать, а сегодня контейнеры перестали запускаться

Anonymous

Anonymous

Это потому-что ты использовал devicemapper и старый докер и ядро не более свежее, у нас ядро с elrepo было, потом стали почти ванильное + патч в одну строку

Vladimir

Vladimir

И не просто закончилось, а к херам закончилось - все решения, которые я встретил сводились у тому, что нужно сделать rm -rf /var/lib/docker и начать сначала

Vladimir

Vladimir

Это потому-что ты использовал devicemapper и старый докер и ядро не более свежее, у нас ядро с elrepo было, потом стали почти ванильное + патч в одну строку

Насколько я видел в баг трекер докера, только последней осенью они вылили *воркарунд*! который не дает полностью закончится месту (так, что еще можно реанимировать все это дело)

Vladimir

Vladimir

И я видел предупреждение о том, что device mapper на лупбеке не стоит использовать а проде (и да, я смотрел, что основная причина - это перформанс, мне это было некритично)

Anonymous

Anonymous

Vladimir

Vladimir

Но вот чтобы поведение по умолчанию было "я работаю пока не сдохну без предупреждения" это что то

Anonymous

Anonymous

я для себя решил использовать btrfs результаты отличные

я его тоже юзал продолжительное время, но устал от постоянных глюков

Sn00part

Sn00part

выглядит как permission denied при попытке записать в валидную директорию в многослойный докер

Vladimir

Vladimir

выглядит как permission denied при попытке записать в валидную директорию в многослойный докер

Видел такое в убунте. Но мне наверно повезло, когда я уже понял, что это ядерный баг и хотел было завести баг в трекере, оказалось, что он уже пару дней как known и что уже даже есть фикс в 16.04 proposed - я его поставил и это решило проблему.

Vladimir

Vladimir

"мне наверно повезло" - это к тому, что в моем случае было идеально: проблему зарепортили, пофиксили и зарелизили за несколько дней, что очень крутой user experience

Anonymous

Anonymous

Такие дела :) https://www.nixp.ru/news/13963.html

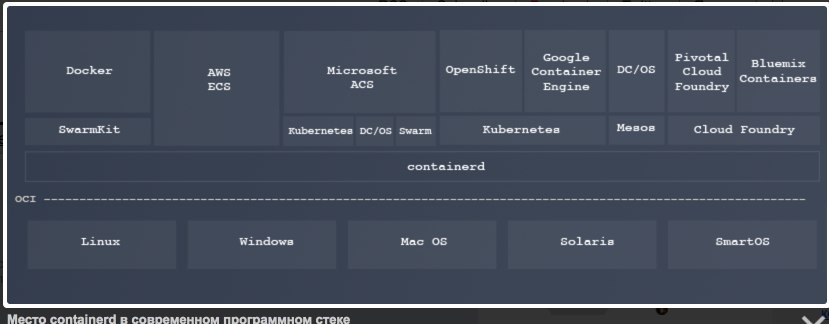

Да, они на прошлой неделе (в среду) презентовали. Причем на том же колле и CoreOS rkt презентовали с той же целью.

Anonymous

Anonymous

а в начале монолитность докера преподносилось как преимущество

только готовые решения от Docker Inc мягко говоря не взлетели, вот и пытаются наверстать где проебали.

Дамир

Дамир

Всем привет. Совсем недавно познакомился с Kubernetes. Не могу понять некоторые моменты.

Допустим, пытаюсь как-то настроить бакэнд на nodejs и mongo rs через statefulSet, которому изначально выделим 3 шарда.

Вопрос в том, как сообщить бакэнду что добавили новые либо удалили шарды и сделать так, чтобы он подцепил изменения?

Etki

Etki

Это уже вопрос взаимодействия приложения и БД, ситуация особо не отличается от аналогичной вне куба. Проще всего пересоздавать клиенты через промежутки времени, если только они не являются умными и не реагируют на изменение топологии сами.

Дамир

Дамир

Благодарю. Как лучше список шардов пасануть приложению, можете подсказать? Вижу два варианта: либо при инициализации пода command и пихать список в envVar, если такое взможно, либо через запрос к apiserver вытаскивать список statefulSet подов и как-то пытаться его загрузить. Со вторым у меня уже произошёл затык, т.к. пока список достаётся, GridFS уже падает иза отсутствия DB)), т.ч. не думаю, что 2й вариант рабочий

Etki

Etki

Боюсь, я недостаточно владею терминологией, но если под шардами подразумеваются отдельные инстансы монги (а это все-таки немного не то), то вам нужен стандартный service куба.

Дамир

Дамир

Возможно я тоже недостаточно ей владею. Делал mongo statefulSet по статье. Там создаётся headless service и описана подача списка из 3х подов в mongo.connect строкой типа "...//mongo-1.mongo,,mongo-2.mongo,mongo-3.mongo:27017..."

И опять к вопросу, как мне динамически эту строку формировать для приложения, может быть будут мысли?

Denis

Denis