Vladimir

Vladimir

Мне вот руками тоже не хочется это дело разворачивать, но при этом "короьочного" функционала нигде не хватает

Logan

Logan

это именно БАГ. У меня такой любимый на убунте есть с weave. если на хосте есть два интерфейса, то адреса нод должны быть строго публичными. Еесли указать приватные - weave будет падать. При этом трафик пойдет строго по приватному интерфейсу

Vladimir

Vladimir

Я поэтому и выбрал kargo как что то с знакомой основой (Ansible), активным сообществом, развивающееся и отчасти unopionated

Vladimir

Vladimir

Logan

Logan

написно что умеет. В результате вся возня с карго для меня вылилась в генерацию конфигов. Как только я пойму, как сгенерить именно то, что мне нужно - решу 90% поставленой задачи. Осталась мелочь

Ivan

Ivan

Hello! Сорри, давно тут не проявлял активность, допиливал вот эту штуку https://github.com/Mirantis/kubeadm-dind-cluster Если у кого есть желание попробовать, то теперь можно запустить тестовый многонодовый k8s кластер, например, вот так:

$ wget https://cdn.rawgit.com/Mirantis/kubeadm-dind-cluster/master/fixed/dind-cluster-v1.5.sh

$ chmod +x dind-cluster-v1.5.sh

$ ./dind-cluster-v1.5.sh up

Нужен свежий докер (1.12+), проверялось на Mac OS X, Ubuntu 16.04, Fedora 25. Может работать с удалённым докером. При необходимости может собирать k8s из исходников, но может работать и без этого. Крайне быстро работает перезапуск кластера. Пока что не работает со storage driver'ом btrfs в докере (баг в cadvisor -> kubelet, проблема с зачисткой volumes).

Knyage

Knyage

а что не так?

Видимо руки не из того места :) Только осваиваю кубер, медленно продвигается освоение.

Artem

Artem

ага, тоже интересно было бы, а то тут такое ощущение, что у всех кубер только на bare metal развернут)

Denis

Denis

Logan

Logan

Ivan

Ivan

я правильно понимаю, что по функционалу это некоторый гибрид minicube и kargo?

это скорее что-то среднее между minikube и local-up-cluster, но только многонодовое

Anonymous

Anonymous

1.6.0 уже почти вот-вот https://github.com/kubernetes/kubernetes/releases/tag/v1.6.0-beta.4

Vladimir

Vladimir

Я вчера beta3 взял, но AzureDisk на нём все равно медленно форматируется/подключается, хотя вроде должны были исправить

Dorian

Dorian

Навеяно неплохой презентацией

https://www.slideshare.net/premsankar/kubernetes-integration-with-odl

Dorian

Dorian

если только сеть брать

Не, калико круто! Только речь про то, чтобы отказаться от OS

Чтобы пускать контейнеры на BM

M

M

all, как удалить podы в unknown status? образовались после пропадания одного из воркеров сильно надолго

M

M

подскажите, у кого бареметалл и натроен мультимастер, у вас корректно происходит ребут одной ноды? у меня через раз при ребуте одной ноды кубер показывает что not ready две ноды, это как то можно разрулить? балансир аписерверов хапрокси

Dmitry

Dmitry

Anonymous

Anonymous

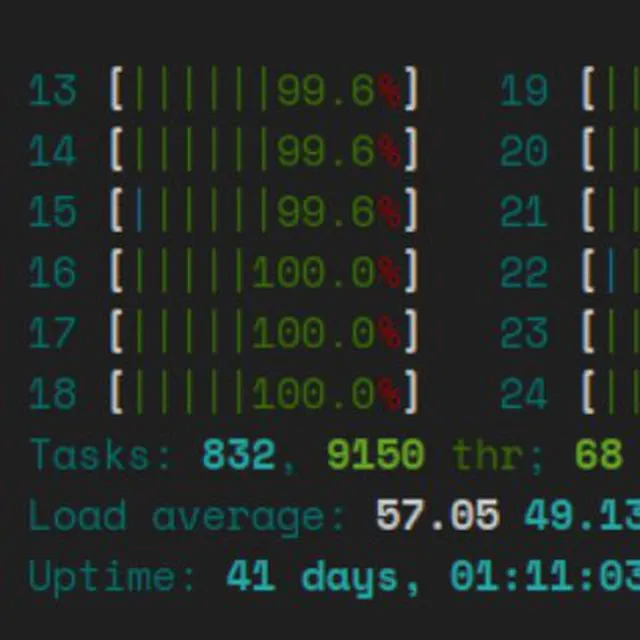

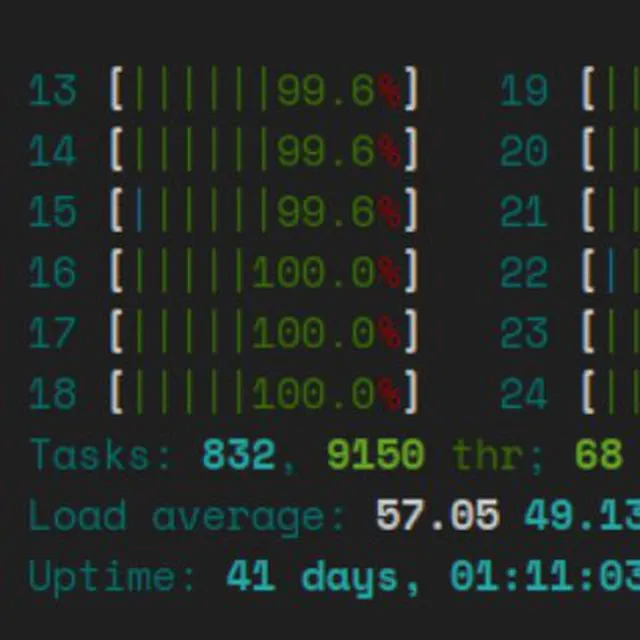

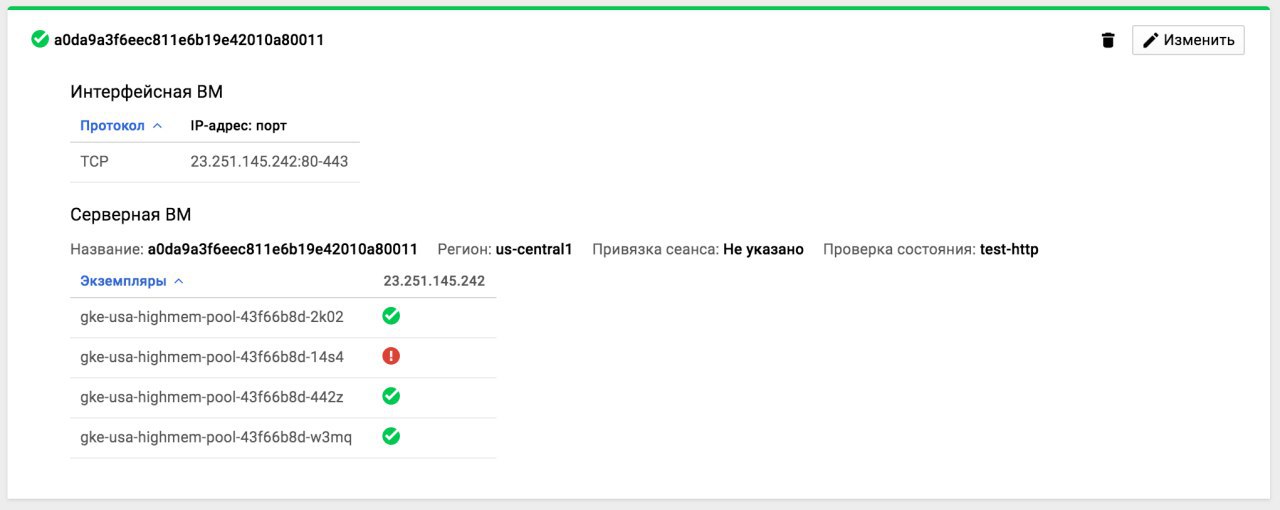

короче какая-то шняга с кластером на гугле: запросы через балансировщик стандартный идут через раз (одна из нод не отвечает)

самое интересное что при удалении ноды зараза эта переходит на другую ноду %)

что посоветуете сделать чтоб с минимальным даунтаймом хрень отдебажить и/или поправить?

Anonymous

Anonymous

хочу попробовать текущие ноды в дрейн, создать пул с новыми, обновить кластер и грохнуть старые

Anonymous

Anonymous

Alex

Alex

Max

Max

Zon

Zon

Kirill

Kirill

🦠

🦠