Denis

Denis

Ну, решайте сами. Эксперименты лишними не бывают. Про удаление, когда удаляется снэпшот, удаляются только уникальные для него данные. Остальное место может ещё долго не очищаться. В вашем случае там их похоже много было и каждый съел место в полном объёме, вот пул и исчерпался. Но что сделать, чтобы починить не могу сказать, тут в чате есть более знающие люди.

Dexex

Dexex

Ну, решайте сами. Эксперименты лишними не бывают. Про удаление, когда удаляется снэпшот, удаляются только уникальные для него данные. Остальное место может ещё долго не очищаться. В вашем случае там их похоже много было и каждый съел место в полном объёме, вот пул и исчерпался. Но что сделать, чтобы починить не могу сказать, тут в чате есть более знающие люди.

Делались бекапы. Ничего особо не писалось в этот момент. Может мегабайты не более.

Denis

Denis

Делались бекапы. Ничего особо не писалось в этот момент. Может мегабайты не более.

Поэксперементируйте всё-таки с тонкими zvol-ами. Они точно лишнего не берут. Ещё им дополнительно trim можно делать.

ztx

ztx

Поэксперементируйте всё-таки с тонкими zvol-ами. Они точно лишнего не берут. Ещё им дополнительно trim можно делать.

Да он уже тыщу раз сказал, что больше "ни грамма zfs", но продолжает здесь срать. Вот ему сказали, что возможно это баг, так вместо того, чтобы сходить этот баг зарепортить он будет здесь, с пеной у рта, рассказывать нам всем какое zfs говно. У человека одна цель - доказать всем, что виноват не он. Проблема только в том, что всем насрать.

Denis

Denis

Да он уже тыщу раз сказал, что больше "ни грамма zfs", но продолжает здесь срать. Вот ему сказали, что возможно это баг, так вместо того, чтобы сходить этот баг зарепортить он будет здесь, с пеной у рта, рассказывать нам всем какое zfs говно. У человека одна цель - доказать всем, что виноват не он. Проблема только в том, что всем насрать.

А я никого и не обвиняю. Что мог, подсказал, дальше он сам решит. Все такие эмоциональные... 😊

ztx

ztx

А я и не говорил, что Вы обвиняли. Просто подсказываю, что зря тратите своё время, человек уже определился, что "zfs не для прода"

Khajiit

Khajiit

Да он уже тыщу раз сказал, что больше "ни грамма zfs", но продолжает здесь срать. Вот ему сказали, что возможно это баг, так вместо того, чтобы сходить этот баг зарепортить он будет здесь, с пеной у рта, рассказывать нам всем какое zfs говно. У человека одна цель - доказать всем, что виноват не он. Проблема только в том, что всем насрать.

Мне больше интересно, почему за систематические нарушения правил — буквально в каждом сообщении — его еще не кикнули

Roman

Roman

Khajiit

Khajiit

Ну да, кто еще расскажет специалистам со стажем эксплуатации в дюжину лет, съевших не одну сотню собак всех пород и калибров, что они все делают неправильно и у них все сломано давно ))

Aleksandr

Aleksandr

Коллеги, Добрый день!

У меня есть пул ~25ТБ (4х14ТБ HDD RAID10) и есть 2 NVME по 400ГБ

Нагрузка Proxmox Backup Server (хуиллиард файлов и директорий)

Нормально ли будет NVME распилить на 2 партиции (и в зеркало), одну под log гигов 16, вторую под special примерно 120 Гигов ?

Ivan

Ivan

Dexex

Dexex

Да он уже тыщу раз сказал, что больше "ни грамма zfs", но продолжает здесь срать. Вот ему сказали, что возможно это баг, так вместо того, чтобы сходить этот баг зарепортить он будет здесь, с пеной у рта, рассказывать нам всем какое zfs говно. У человека одна цель - доказать всем, что виноват не он. Проблема только в том, что всем насрать.

Я его оставлю на бекап серверах. Там тупые винты стоят. На продакшене нет. Больше никогда. Может когда выйдет ZFS v10 разве что. Да и то, вот у меня один раз btrfs подохла тоже со снапшотами и я даже принципиально не вижу смысла о ней думать. Я могу понять, когда у меня диск сдох, еще какая то проблема с оборудованием, но чтобы так - не, мы такое в проде не прощаем.

ztx

ztx

Y

Y

Fedor

Fedor

Если нет выстроенного обслуживания любой инженерной системы с учетом ее особенностей, она со временем приходит в неудобное и неконтролируемое состояние. Хорошим ходом было бы написать постмортем с разбором по фактам того, как это получилось.

Dexex

Dexex

Если нет выстроенного обслуживания любой инженерной системы с учетом ее особенностей, она со временем приходит в неудобное и неконтролируемое состояние. Хорошим ходом было бы написать постмортем с разбором по фактам того, как это получилось.

Я согласен. Вот пытаюсь все команды выстроить что были. Хронологию детальную восстановить. Но пока все абсолютно просто. Наделал снапшотов. Потом почистил старые. Ещё сделал. И на каком то этапе оно все крашнулось

Dexex

Dexex

У меня есть субволимы от контейнеров остались. Zvol я удалить не могу. А если ручками почистить их сами это может помочь?

Ivan

Ivan

ессно чтоб удалить zvol, на нем не должно быть снапов, bookmark, hold и прочего. ваша тула для снапов возможно hold ставит.

Dexex

Dexex

ессно чтоб удалить zvol, на нем не должно быть снапов, bookmark, hold и прочего. ваша тула для снапов возможно hold ставит.

Да, я холды проверил. Резервированные есть, холдов нет

Ivan

Ivan

банально удалив все снапы появилось бы место.

снапы без thin - вообще боль, т.к. много места занимают.

Dexex

Dexex

2025-04-22.12:08:31 zfs snapshot productionz@live_20250422_120830

2025-04-22.12:10:16 zfs snapshot productionz@live_20250422_121016

2025-04-22.12:16:35 zfs destroy productionz/subvol-108-disk-0@backup

2025-04-22.12:16:35 zfs destroy productionz/subvol-111-disk-0@okokokok

2025-04-22.12:16:35 zfs destroy productionz/subvol-111-disk-0@oldv

2025-04-22.12:16:35 zfs destroy productionz/subvol-111-disk-0@ok_night

2025-04-22.12:16:36 zfs destroy productionz/vm-101-disk-0@autosnap_20250302_165844

2025-04-22.12:16:38 zfs destroy productionz/vm-101-disk-0@autosnap_20250325_180501

2025-04-22.12:16:38 zfs destroy productionz/vm-101-disk-0@autosnap_20250326_090001

2025-04-22.12:16:38 zfs destroy productionz/vm-101-disk-0@autosnap_20250326_180501

2025-04-22.12:16:39 zfs destroy productionz/vm-101-disk-0@autosnap_20250327_090001

2025-04-22.12:16:39 zfs destroy productionz/vm-101-disk-0@autosnap_20250327_180501

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250328_090001

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250328_180501

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250329_090001

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250329_180501

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250330_090001

2025-04-22.12:16:40 zfs destroy productionz/vm-101-disk-0@autosnap_20250330_180501

2025-04-22.12:16:42 zfs destroy productionz/vm-101-disk-0@autosnap_20250331_090001

2025-04-22.12:16:44 zfs destroy productionz/vm-101-disk-1@autosnap_20250302_165844

2025-04-22.12:16:46 zfs destroy productionz/vm-101-disk-1@autosnap_20250325_180501

2025-04-22.12:16:46 zfs destroy productionz/vm-101-disk-1@autosnap_20250326_090001

2025-04-22.12:16:47 zfs destroy productionz/vm-101-disk-1@autosnap_20250326_180501

2025-04-22.12:16:48 zfs destroy productionz/vm-101-disk-1@autosnap_20250327_090001

2025-04-22.12:16:49 zfs destroy productionz/vm-101-disk-1@autosnap_20250327_180501

2025-04-22.12:16:49 zfs destroy productionz/vm-101-disk-1@autosnap_20250328_090001

2025-04-22.12:16:50 zfs destroy productionz/vm-101-disk-1@autosnap_20250328_180501

2025-04-22.12:16:51 zfs destroy productionz/vm-101-disk-1@autosnap_20250329_090001

2025-04-22.12:16:51 zfs destroy productionz/vm-101-disk-1@autosnap_20250329_180501

2025-04-22.12:16:51 zfs destroy productionz/vm-101-disk-1@autosnap_20250330_090001

2025-04-22.12:16:51 zfs destroy productionz/vm-101-disk-1@autosnap_20250330_180501

2025-04-22.12:16:52 zfs destroy productionz/vm-101-disk-1@autosnap_20250331_090001

2025-04-22.12:16:54 zfs destroy productionz/vm-106-disk-0@good

2025-04-22.12:16:57 zfs destroy productionz/vm-106-disk-0@WinUEFI

2025-04-22.12:16:58 zfs destroy productionz/vm-106-disk-0@WINUEFI

2025-04-22.12:16:59 zfs destroy productionz/vm-106-disk-2@WinUEFI

2025-04-22.12:16:59 zfs destroy productionz/vm-106-disk-2@WINUEFI

2025-04-22.12:16:59 zfs destroy productionz/vm-107-disk-0@tutrabotaetEDO

2025-04-22.12:17:00 zfs destroy productionz/vm-107-disk-0@Seuchas2

2025-04-22.12:17:19 zfs snapshot -r productionz@liveback_20250422121718

вот фрагмент когда получилась жопа

Dexex

Dexex

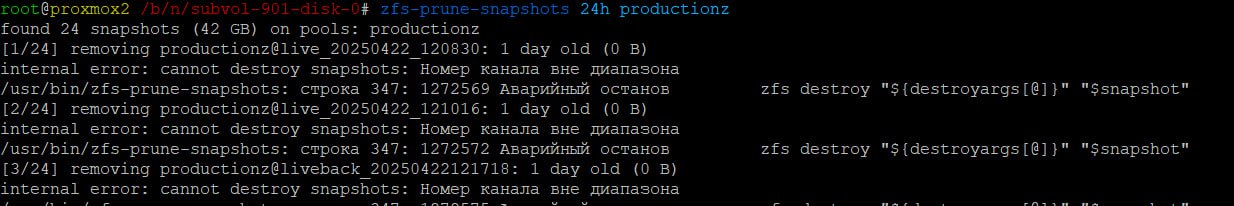

С 12:16 я начал скрипт гонять. Затем в ручную чистил. Пока тупо не перестало чиститься и заполнено стало 100%.

Ivan

Ivan

Dexex

Dexex

какой вообще смысл делать снапы сбоку, не через апи

Хотел делать снапшот пула и отправлять его на второй пул удаленный. В режиме лайва. Задача была - сделать лайв бекапы

Ivan

Ivan

Хотел делать снапшот пула и отправлять его на второй пул удаленный. В режиме лайва. Задача была - сделать лайв бекапы

это все средствами pve делается

Dexex

Dexex

vzdump это не интересно. Кластер тоже. corosync выглядит крайне сомнительно и требует 3 сервера

Dexex

Dexex

Кажется я понял. Снапшоты удалились, но они все также отображаются. Если посмотреть на историю команд

Khajiit

Khajiit

Такого быть тоже не должно

Сервис-то свой снепшотный останолен? Должен был еще вчера, когда рекомендовалось

Dexex

Dexex

Такого быть тоже не должно

Сервис-то свой снепшотный останолен? Должен был еще вчера, когда рекомендовалось

Да я просто в ручную скрипт запускал. Он банальный, просто префикс и дату устанавливал.

Roman

Roman

Да я просто в ручную скрипт запускал. Он банальный, просто префикс и дату устанавливал.

говнокод до добра не доводит, бывает.

Khajiit

Khajiit

Да я просто в ручную скрипт запускал. Он банальный, просто префикс и дату устанавливал.

autosnap говорит применении некоторой autoматизации. Скорее всего через cron, systemd timer или service

Удалять точно нужно точечно, и перед этим надо найти то, удаление чего даст максимальный профит.

И нельзя исключать, что рекурсивный снепшот, в итоге, сделал резервацию большей, чем размер пула вообще — возможно, придется прибить самый большой zvol целиком через zfs destroy -R

Dexex

Dexex

autosnap говорит применении некоторой autoматизации. Скорее всего через cron, systemd timer или service

Удалять точно нужно точечно, и перед этим надо найти то, удаление чего даст максимальный профит.

И нельзя исключать, что рекурсивный снепшот, в итоге, сделал резервацию большей, чем размер пула вообще — возможно, придется прибить самый большой zvol целиком через zfs destroy -R

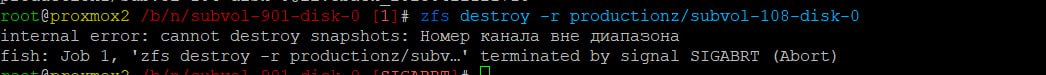

А я их все пробовал удалять. Ничего не удалится.

Dexex

Dexex

Просто интересно. В субботу если хотите поэкспериментируем. Я боюсь данные потерять. их много бекапить придется

Vladislav

Vladislav

А так все, сваливаю на raid6 mdadm +xfs. Скоростью хоть побалуюсь.

Отлично, не нужен Вам ZFS, не стоит Вам его использовать

Khajiit

Khajiit

Khajiit

Khajiit

Dexex

Dexex

Кстати кто смеётся по mdadm пусть тесты сравнения глянет - там просто раз в 5 быстрее. У меня был он ранее. Хорошо работал, снапшоты захотелось просто. У меня было ~5300мбит на массиве ssd на новом файле по записи.

Aleksandr

Aleksandr

А так все, сваливаю на raid6 mdadm +xfs. Скоростью хоть побалуюсь.

У Вас же как я понял proxmox? Выжимка из документации:

Supported Technologies

ZFS

If you want to run a supported configuration, using a proven enterprise storage technology, with data integrity checks and auto-repair capabilities ZFS is the right choice.

Unsupported Technologies

mdraid

mdraid has zero checks for bit-rot, data integrity, and file systems commonly used on top do not provide that either.

That means, if some data gets corrupted, which happens on any long-running system sooner or later, and you normally do not notice until it's too late. So, Proxmox projects do not support this technology to avoid that users that are not aware of this and its implications run into these problems! Its user experience is also less polished than that of ZFS, and while it might provide slightly more performance in some cases, this is only achieved due too not having the safety-guarantees that, e.g. ZFS provides.

https://pve.proxmox.com/wiki/Software_RAID

Askhalion

Askhalion

Кстати кто смеётся по mdadm пусть тесты сравнения глянет - там просто раз в 5 быстрее. У меня был он ранее. Хорошо работал, снапшоты захотелось просто. У меня было ~5300мбит на массиве ssd на новом файле по записи.

Это примерно как поставить V8 на жигуль, оно то будет быстрее ехать, но какой ценой? Ценой того что тормоза откажут при первом тесте😁

Dexex

Dexex

Это примерно как поставить V8 на жигуль, оно то будет быстрее ехать, но какой ценой? Ценой того что тормоза откажут при первом тесте😁

Тогда хрен знает что использовать. Аппаратный рейд чтоле тогда сделать. До этого я пользовался все нормально было.

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

𝚜𝚎𝚗𝚜𝚎𝚖𝚊𝚍

Askhalion

Askhalion

Тогда хрен знает что использовать. Аппаратный рейд чтоле тогда сделать. До этого я пользовался все нормально было.

По моему такому индивиду лучше не трогать raid в принципе

Vladislav

Vladislav

Dexex

Dexex

У Вас же как я понял proxmox? Выжимка из документации:

Supported Technologies

ZFS

If you want to run a supported configuration, using a proven enterprise storage technology, with data integrity checks and auto-repair capabilities ZFS is the right choice.

Unsupported Technologies

mdraid

mdraid has zero checks for bit-rot, data integrity, and file systems commonly used on top do not provide that either.

That means, if some data gets corrupted, which happens on any long-running system sooner or later, and you normally do not notice until it's too late. So, Proxmox projects do not support this technology to avoid that users that are not aware of this and its implications run into these problems! Its user experience is also less polished than that of ZFS, and while it might provide slightly more performance in some cases, this is only achieved due too not having the safety-guarantees that, e.g. ZFS provides.

https://pve.proxmox.com/wiki/Software_RAID

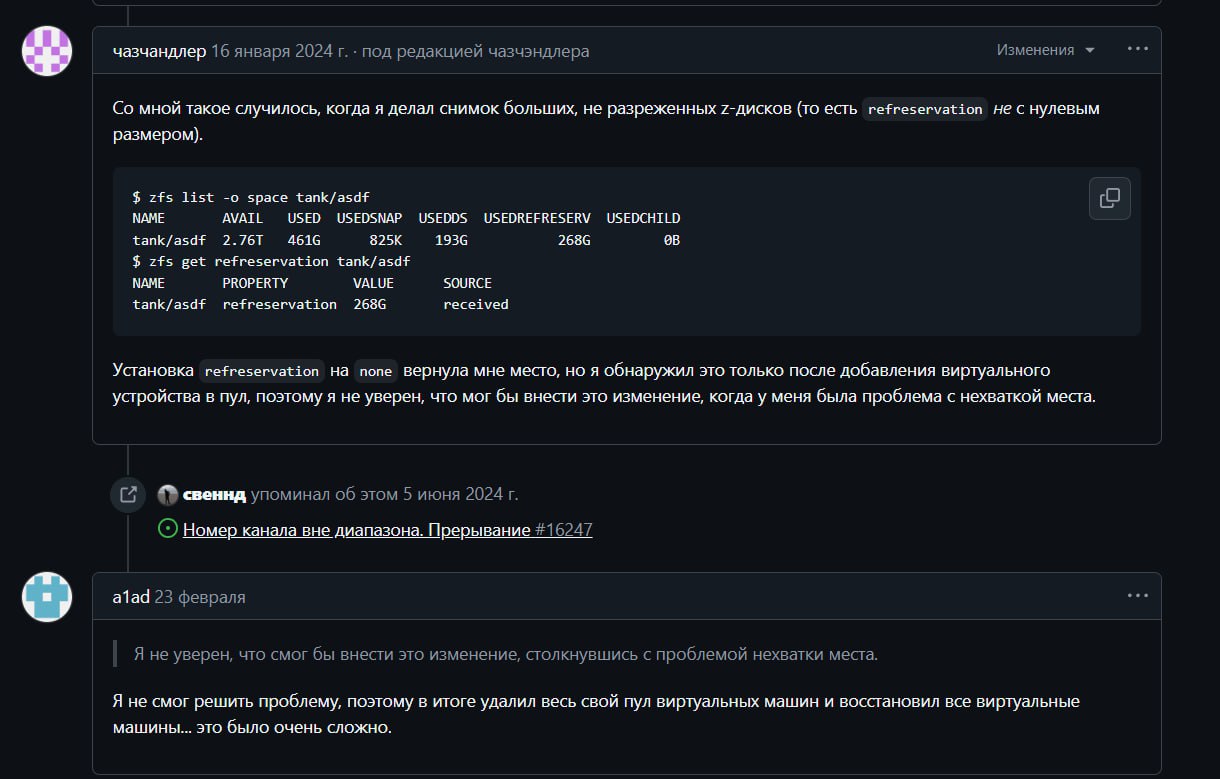

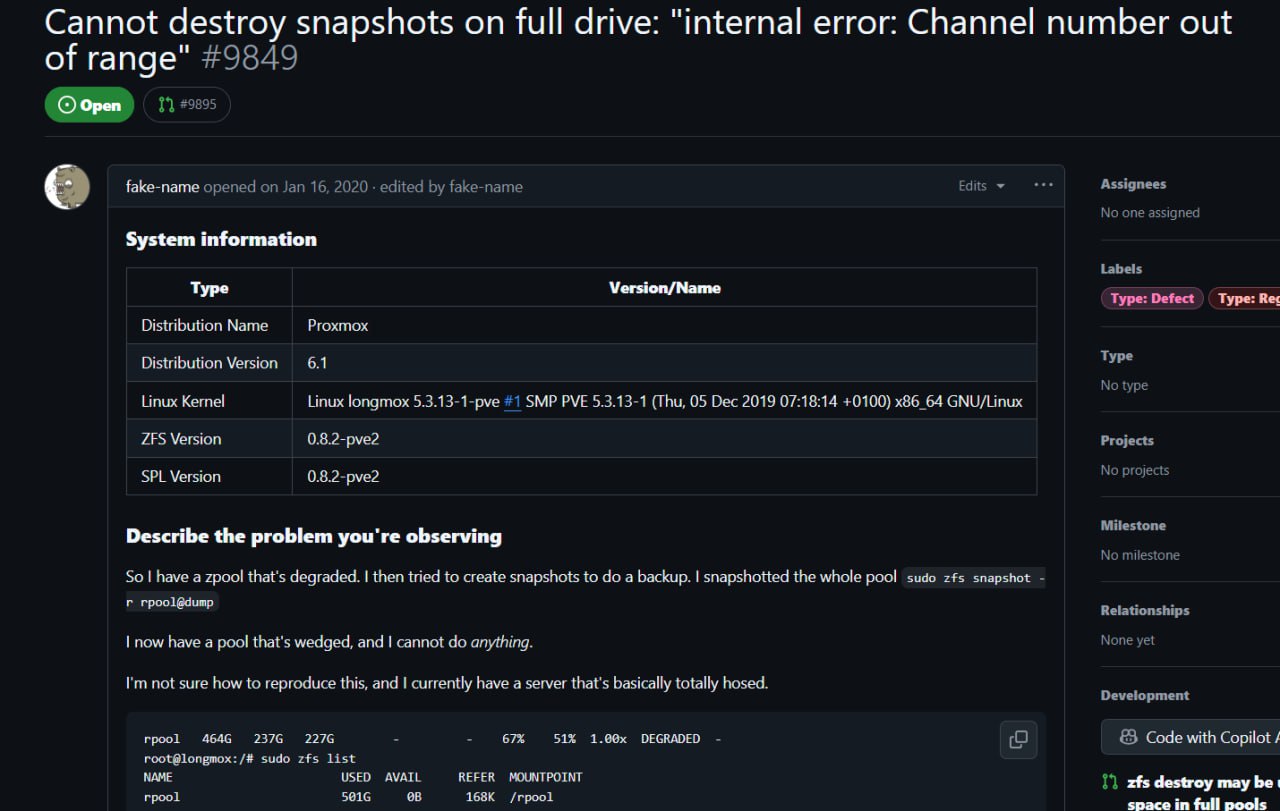

Нормально так. Вот там может быть сбой. А если в zfs сбой происходит к кому вопрос? Ой тут тоже ничего кроме мертвой проблемы на гите. Смешно.

Dexex

Dexex

Все равно короче бекапить буду все подряд. Так что везде есть недостатки, со снапшотами я играться больше не буду. У меня везде аналогичная конфигурация, не хочу еще раз нарваться. Так что еще время есть подумаю, скорее всего mdadm на шестерке остается. Хранилище как директория.

Konstantin

Konstantin

central

central