Pttf8-65

Pttf8-65

Nikita

Nikita

Сначала autoexpand, потом увеличить раздел.

я почему то был уверен, что это не опция, а команда... пруфов, что когда то было иначе не нашел. странно.

Станислав

Станислав

я почему то был уверен, что это не опция, а команда... пруфов, что когда то было иначе не нашел. странно.

Если применить в таком порядке, то потом ещё нужна команда для расширения, то есть авто не сработает. Но она не всегда помогает, приходится перезапускать сервер

Alexander

Alexander

Привет, такой вопрос можно ли добавить в ZFS пулл 2 ssd в raid1?

У меня получается просто добавить 2 диска

pool alloc free read write read write

---------- ----- ----- ----- ----- ----- -----

zroot 5.23G 209G 2 3 59.9K 64.8K

mirror-0 5.23G 209G 2 3 59.9K 64.8K

ada0p4 - - 1 1 29.7K 32.4K

ada1p4 - - 1 1 30.2K 32.4K

cache - - - - - -

nda0 47.1M 27.2G 0 1 739 75.5K

nda1 80.7M 27.2G 0 1 739 127K

---------- ----- ----- ----- ----- ----- -----

zpool add zroot cache mirror nda0 nda1 - такая команда возвращает ошибку

invalid vdev specification: cache requires at least 1 devices

Vladislav

Vladislav

Alexander

Alexander

Зачем тебе кэш на чтение в 1-м рейде?

Я бы начал с этого

Лежали 2 SSD optane и пришла идея как то это использовать, получилось создать пулл в raid1, думал с кешам получиться

Vladislav

Vladislav

Alexander

Alexander

Ну так добавь их два

Да я так и сделал, не знал что не получится в зеркало объединить SSD для кеша

Vladislav

Vladislav

Да я так и сделал, не знал что не получится в зеркало объединить SSD для кеша

Ты так и не ответил, зачем зеркало?

Vladislav

Vladislav

Надежнее и вроде скорость чтения повыше будет

Эрм, нет?

И надёжнее в плане? У тебя L2ARC даже если умирает ты не теряешь ровным счётом ничего

Alexander

Alexander

Эрм, нет?

И надёжнее в плане? У тебя L2ARC даже если умирает ты не теряешь ровным счётом ничего

Да, это я потом понял что смысла небыло, я недавно начал работать с zfs

Rabinovitch

Rabinovitch

Сообщество, почему после команды zpool offline диск остаётся в состоянии FAULTED, хотя по идее должен стать OFFLINE?

Antoniodba

Antoniodba

Привествую, коллеги. Я правильно понимаю что logicalused показывает размер данных без сжатия располагаемых на zfs?

Andrey

Andrey

Free

Free

Что с чатом случилось?

Кроме этого ничего не вижу.

Или меня кто-то забанил, а потом восстановили без истории чата?

PS скриншот не добавляется 😞

Free

Free

регулярно такое у телеги бывает, прокашляется.

либо само, либо после рестарта клиента.

О, так скриншот был (на время?) опубликован???

У меня и его нет в чате...

Alex

Alex

О, так скриншот был (на время?) опубликован???

У меня и его нет в чате...

всё есть, без аномалий.

Free

Free

всё есть, без аномалий.

После рестарта телеги история появилась.

Правда, моего скриншота так и не вижу

Alex

Alex

Что с чатом случилось?

Кроме этого ничего не вижу.

Или меня кто-то забанил, а потом восстановили без истории чата?

PS скриншот не добавляется 😞

щаз лабсы из корзины историю откатят ;)

Dmitry

Dmitry

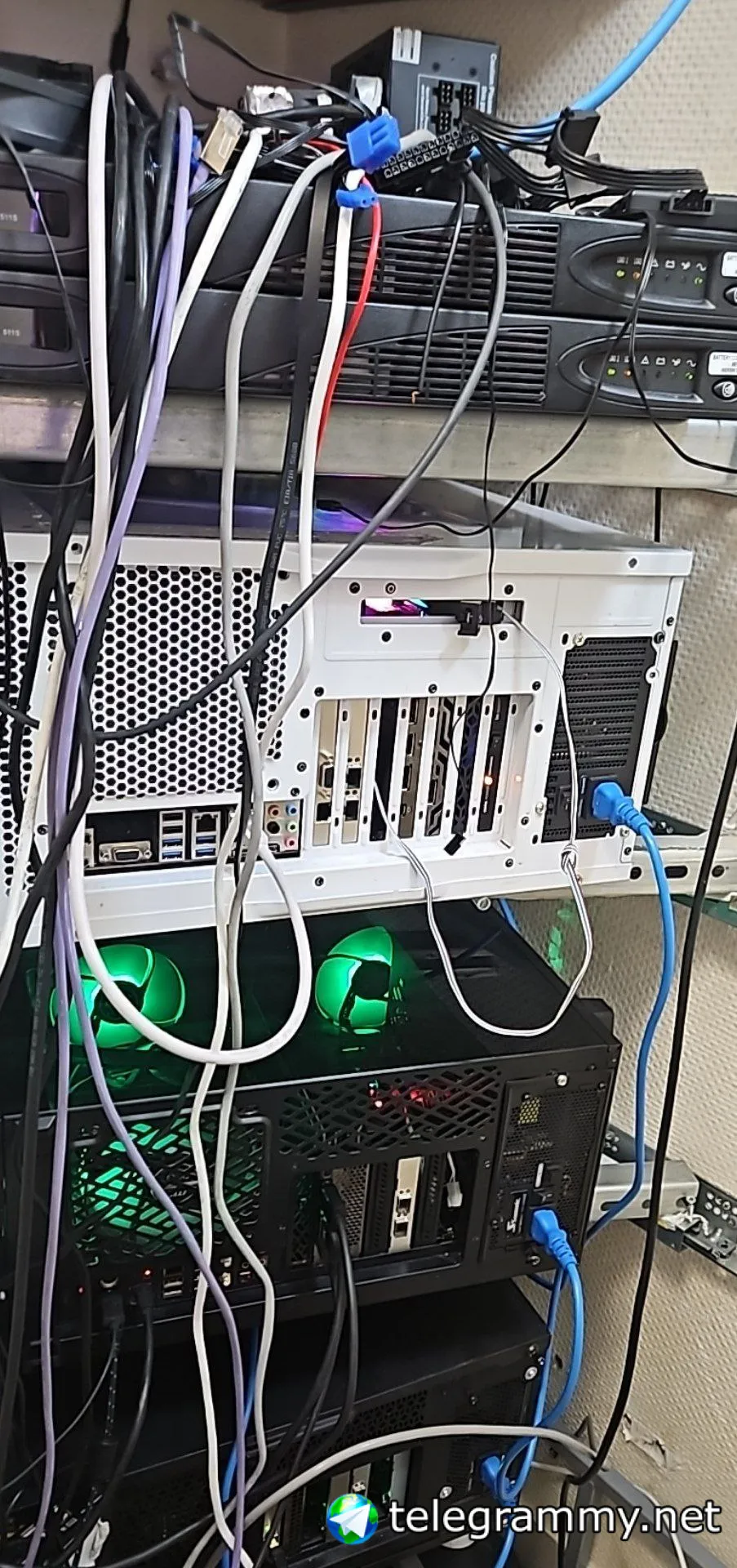

Добрый день! Вопрос по серверу, есть сервер на 2011 сокете с 256 гб ОЗУ, есть 2 u.2 nvme диска на 1.96 гб, есть 6х4tb 870 evo, и есть возможность ещё установить 2х1tb990 pro

Хочется его доработать до нормальной файлохранилки

Планируется докупить 8tb-seagate-barracuda-st8000dm004

И отправить их в raidz3 ну и накатить zfs с дедубликацией(ну и наверное сжатием), посоветуйте как ускорить это все добро до приемлемого уровня производительности?

Куда кинуть l2 кеш zfs и куда кинуть кеш намерений

Так же я что то слышал о zfs dedup disk, но не нашёл инфы

Система уже стоит на одном из дисков, так что под систему ничего не нужно

Станислав

Станислав

Добрый день! Вопрос по серверу, есть сервер на 2011 сокете с 256 гб ОЗУ, есть 2 u.2 nvme диска на 1.96 гб, есть 6х4tb 870 evo, и есть возможность ещё установить 2х1tb990 pro

Хочется его доработать до нормальной файлохранилки

Планируется докупить 8tb-seagate-barracuda-st8000dm004

И отправить их в raidz3 ну и накатить zfs с дедубликацией(ну и наверное сжатием), посоветуйте как ускорить это все добро до приемлемого уровня производительности?

Куда кинуть l2 кеш zfs и куда кинуть кеш намерений

Так же я что то слышал о zfs dedup disk, но не нашёл инфы

Система уже стоит на одном из дисков, так что под систему ничего не нужно

Добрый день. Тут ошибка, должно быть наоборот) Сжатие обязательно, а вот дедуб не нужно

Dmitry

Dmitry

Добрый день. Тут ошибка, должно быть наоборот) Сжатие обязательно, а вот дедуб не нужно

Dedup требуется для сохранения инфраструктуры в 2 тб 3 раза в неделю

Станислав

Станислав

Dedup требуется для сохранения инфраструктуры в 2 тб 3 раза в неделю

Почитайте про ссылке. А на чём хранятся эти 2Тб?

Dmitry

Dmitry

Почитайте про ссылке. А на чём хранятся эти 2Тб?

Raid 6 из 10 дисков по 4 тб с промежуточным хранением на ssd sata для бекаба из nvme ssd со скоростью 10гб сек(фактически 5)

Dmitry

Dmitry

Ну оно работает, так что вопрос до расширения до нормальной структуры

Как я понял l2 кеш может сохранять блоки данных для быстрого доступа к ним и быстрого внесения их в таблицу дедубликации

Dmitry

Dmitry

Пока fast dedup точно не подойдёт, а лучше использовать стандартную архитектуру, не хочу нарваться на детские болячки новой фичи

Dmitry

Dmitry

У вас ксть 2x2Tb nvme ssd и 6x4=24Tb sata ssd (для бекапа?). Зачем вам в такой схеме харды?

Так как ssd используются как кеш не только для бекапа, но и шифрования, и других задач на data сервере, хочу переложить все функции на zfs которые я делаю через скрипты

Artem

Artem

В общем, хочу ёмкость, скорость, надёжность и свалку бекапов, все в одном и подешевле

Тут как всегда - выбрать можно только два из трёх 🤣

Dmitry

Dmitry

Синхронизированный кеш намерений на скорость записи, l2 кеш на скорость дедубликации, ОЗУ в виде 256 гигов на в целом скорость raidz3 отвечает за надёжность как и зрения кодовая база open zfs

Artem

Artem

Синхронизированный кеш намерений на скорость записи, l2 кеш на скорость дедубликации, ОЗУ в виде 256 гигов на в целом скорость raidz3 отвечает за надёжность как и зрения кодовая база open zfs

Я может отстал от жизни, но по моему пониманию дедупу нужна память. Зачем ему l2.

Dmitry

Dmitry

Я может отстал от жизни, но по моему пониманию дедупу нужна память. Зачем ему l2.

Туда записываются самые часто используемые блоки с hdd, dedup будет обращаться к ним, а не к hdd напрямую

Artem

Artem

Туда записываются самые часто используемые блоки с hdd, dedup будет обращаться к ним, а не к hdd напрямую

Мне кажется, вы не очень верно понимаете механизм дедупа

Alexander

Alexander

Dedup требуется для сохранения инфраструктуры в 2 тб 3 раза в неделю

Снепшоты используйте а не дедупликацию

Alexander

Alexander

А как они позволят мне хранить 100 копий 1 тб данных?

А зачем вам изначально хранить 100 копий?

Dmitry

Dmitry

А зачем вам изначально хранить 100 копий?

Что бы получать к ним доступ, а именно к тем данным что уже изменились

Станислав

Станислав

Что бы получать к ним доступ, а именно к тем данным что уже изменились

Клон снимка делаете и вот вам доступ на запись/чтение

Dmitry

Dmitry

Клон снимка делаете и вот вам доступ на запись/чтение

Требования хранение данных за 3 года ежедневного бекапа с произвольным доступом в любую секунду

Alexander

Alexander

Делайте снепшоты и это будет ридонли копия на момент снепшота, надо ее быстро превратить в отдельный датасет для записи и менять то делаете клон

Станислав

Станислав

Alexander

Alexander

Alexander

Alexander

Никакой дежупликацим не надо, но лучше сделать внешний сервер и туда отправлять снепшоты, инкременипльно

Alexander

Alexander

Тогда как их хранить на отдельном устройстве?

Вы не понимаете как работает zfs, вам бы сперва с основах разобраться

Alexey

Alexey