LordMerlin

LordMerlin

На 8ми сата дисках под сторадж проксмоксбэкапсервера что правильнее будет собрать раидз1 или раидз2?

Ivan

Ivan

На 8ми сата дисках под сторадж проксмоксбэкапсервера что правильнее будет собрать раидз1 или раидз2?

одинаково медленно, raidz2 позволяет больше дисков потерять без потери данных.

Dexex

Dexex

А как насчёт видеонаблюдения - есть ли смысл в zfs в сравнении с обычными fs?

Я вот серваки видеонаблюдения начинаю мутить и вот не знаю как оно будет.

Dexex

Dexex

С обычными данными типа документы, архивы и т.д. дедупликация и пожатие очень замечательно. У меня больше места стало. А вот видосы не знаю

Михаил

Михаил

Мне пришлось сделать схему из двух стораджей на pbs: RAID0 из 2хSSD NVME - туда льются непосредственно все бэкапы, которые потом синхронизируются на RAIDZ1 из 5 дисков и там уже ротейтятся с глубиной какой нужно. В итоге получаем достаточно быстрое снятие резервных копий и последняя копия всегда лежит на NVME, а остальное уже на RAID-массиве

Dexex

Dexex

Мне пришлось сделать схему из двух стораджей на pbs: RAID0 из 2хSSD NVME - туда льются непосредственно все бэкапы, которые потом синхронизируются на RAIDZ1 из 5 дисков и там уже ротейтятся с глубиной какой нужно. В итоге получаем достаточно быстрое снятие резервных копий и последняя копия всегда лежит на NVME, а остальное уже на RAID-массиве

У меня также примерно.

Есть страйп тупо для бекапов отдельным пулом из медленных и нормальный продакшен raidz2 с виртуалками

Dexex

Dexex

А просто собирать zfs на хардах это медленно

Тупо для бекапов. Их невозможно юзать. Любая база 1с более или менее нормального объема забивает их полностью. Чё я только не делал. Самое быстрое это была xfs на мдадм.

LordMerlin

LordMerlin

одинаково медленно, raidz2 позволяет больше дисков потерять без потери данных.

Это да, спасибо, это знаю.

А если аппаратным контролером 10й сделать, и поверх zfs пул?

Ivan

Ivan

Это да, спасибо, это знаю.

А если аппаратным контролером 10й сделать, и поверх zfs пул?

худший из вариантов. тогда лучше raid10 средствами zfs сделать.

Georg🎞️🎥

Georg🎞️🎥

Тупо для бекапов. Их невозможно юзать. Любая база 1с более или менее нормального объема забивает их полностью. Чё я только не делал. Самое быстрое это была xfs на мдадм.

У меня тупо на Хардах и все хорошо ) почему это невозможно , интересно ?

LordMerlin

LordMerlin

Тупо для бекапов. Их невозможно юзать. Любая база 1с более или менее нормального объема забивает их полностью. Чё я только не делал. Самое быстрое это была xfs на мдадм.

Вот кстати.

Предстоит делать сервант новый для одной конторы.

Сами понимаете из бытового железа.

И там программа аптечная на мсскл работает.

Сейчас там аппаратный рейд 10 на 6и дисках.

Будет 2шт нвме и отдельно под бэкапы диски.

Вопрос такой.

Хотел все это в проксиокс сделать..

Не знаю как лучше будет эти два диска сделать.

Отдать как железо внутрь виртуальной машины и там средствами винды собрать райд1, или таки сделать мдадм+хфс для скорости?

Боюсь на зфс делать зеркало. Диски косэнсумерские.

Или не ипать судьбу и ставить винсервер бареметал?

Georg🎞️🎥

Georg🎞️🎥

С обычными данными типа документы, архивы и т.д. дедупликация и пожатие очень замечательно. У меня больше места стало. А вот видосы не знаю

Видосы оч плохо жмутся , не советую , я б сказал , совсем даже не жмутся

LordMerlin

LordMerlin

худший из вариантов. тогда лучше raid10 средствами zfs сделать.

Хм, чот про него не подумал совсем.

Скорость будет больше чем райдз1 или 2.

А на сколько меньше надёжность?

LordMerlin

LordMerlin

Видосы оч плохо жмутся , не советую , я б сказал , совсем даже не жмутся

Да, они сейчас уже и так h265 пожаты. Там будут какие-то копейки всего.

Ivan

Ivan

Хм, чот про него не подумал совсем.

Скорость будет больше чем райдз1 или 2.

А на сколько меньше надёжность?

при прокачанном везении можно терять половину дисков. в худшем сценарии терять больше одного диска нельзя. равно как и с обычным рейд10.

LordMerlin

LordMerlin

при прокачанном везении можно терять половину дисков. в худшем сценарии терять больше одного диска нельзя. равно как и с обычным рейд10.

Чтож логично.

Бонусом только снапшоты и чексуммы блоков.

Dexex

Dexex

Вот кстати.

Предстоит делать сервант новый для одной конторы.

Сами понимаете из бытового железа.

И там программа аптечная на мсскл работает.

Сейчас там аппаратный рейд 10 на 6и дисках.

Будет 2шт нвме и отдельно под бэкапы диски.

Вопрос такой.

Хотел все это в проксиокс сделать..

Не знаю как лучше будет эти два диска сделать.

Отдать как железо внутрь виртуальной машины и там средствами винды собрать райд1, или таки сделать мдадм+хфс для скорости?

Боюсь на зфс делать зеркало. Диски косэнсумерские.

Или не ипать судьбу и ставить винсервер бареметал?

Манда с хэфс неплохой вариант. Если не нужны снапшоты и реплика, то это промышленный стандарт. Кто бы что не говорил, но на большинстве дедиков стоит манда из коробки.

Dexex

Dexex

Я мерил скорость заливки образа диска и манда показала себя самой быстрой. Да там кеш страниц фигарит, но больше я не смог выжать. А хэфс из за дедупликация очень помогает экономить пропускную способность

Dexex

Dexex

Raid 10 как раз я и делал. Год сидел на нем. Понадобилась реплика для быстрых бекапов, вот и перелез на zfs

Khajiit

Khajiit

На 8ми сата дисках под сторадж проксмоксбэкапсервера что правильнее будет собрать раидз1 или раидз2?

Чтобы рекорд, который сам степень 2, лег на диски не как попало, дисков с данными должно быть тоже степень 2.

То есть, есть собирать RZ n, то дисков надо 2^k + n

Это же работает и с обычным 5/6 рейдом, принцип там тот же.

Так что из 8 дисков самое оптимальное что можно сделать это RZ2 на 6 дисков и зеркало, но смешивать в одном пуле разные vdev — так себе идея

George

George

Чтобы рекорд, который сам степень 2, лег на диски не как попало, дисков с данными должно быть тоже степень 2.

То есть, есть собирать RZ n, то дисков надо 2^k + n

Это же работает и с обычным 5/6 рейдом, принцип там тот же.

Так что из 8 дисков самое оптимальное что можно сделать это RZ2 на 6 дисков и зеркало, но смешивать в одном пуле разные vdev — так себе идея

У raidz это правило не работает https://www.delphix.com/blog/zfs-raidz-stripe-width-or-how-i-learned-stop-worrying-and-love-raidz

Khajiit

Khajiit

У raidz это правило не работает https://www.delphix.com/blog/zfs-raidz-stripe-width-or-how-i-learned-stop-worrying-and-love-raidz

Спасибо, в этой статье много интересного (для впечатления слабых психикой новичков).

Мне особенно понравился третий абзац:

For best performance on random IOPS, use a small number of disks in each RAID-Z group. E.g, 3-wide RAIDZ1, 6-wide RAIDZ2, or 9-wide RAIDZ3, в котором два массива из трех сформированы как раз по правилу (2^n)+p

Так же впечатлили максимально размытые рекомендации, типа сделай чо-нибудь и оно как-нибудь будет работать

Вопрос производительности БД — единственный который можно считать относящимся к практике хоть как-то.

Особенно понравилось как рассмотрены нагрузки от торрентов, синкфинга, и zvol с большим volblocksize, которые обязательно пойдут по n+1

George

George

Спасибо, в этой статье много интересного (для впечатления слабых психикой новичков).

Мне особенно понравился третий абзац:

For best performance on random IOPS, use a small number of disks in each RAID-Z group. E.g, 3-wide RAIDZ1, 6-wide RAIDZ2, or 9-wide RAIDZ3, в котором два массива из трех сформированы как раз по правилу (2^n)+p

Так же впечатлили максимально размытые рекомендации, типа сделай чо-нибудь и оно как-нибудь будет работать

Вопрос производительности БД — единственный который можно считать относящимся к практике хоть как-то.

Особенно понравилось как рассмотрены нагрузки от торрентов, синкфинга, и zvol с большим volblocksize, которые обязательно пойдут по n+1

Суть в таблице итогового полезного пространства, вот сюда тоже её прикреплял в конце https://openzfs.github.io/openzfs-docs/Basic%20Concepts/RAIDZ.html

Denver

Denver

Там 3 переменных итого: ashift, recordsize, количество дисков в vdev

Получается четность пишется для каждого рекорда на дисках? И чем меньше рекордсайз тем менее эффективно используется пространство?

George

George

Получается четность пишется для каждого рекорда на дисках? И чем меньше рекордсайз тем менее эффективно используется пространство?

Именно, да, по этой причине мелкий рекордсайз в raidz противопоказан

sexst

sexst

И степень сжатия при большем рекордсайзе, заметил, повышается

Чем больше чанк, - тем больше компрессия (не у всех алгоритмов, но у многих). Ваш кэп

Ilya

Ilya

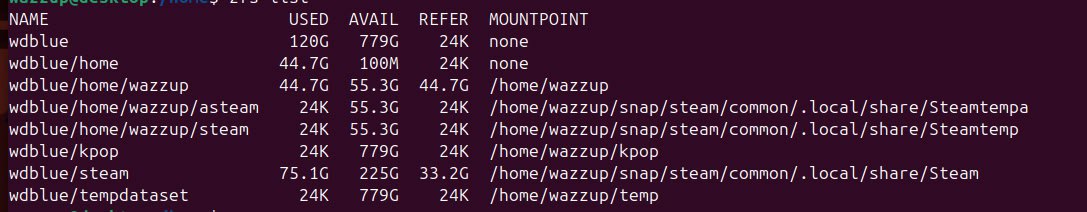

Alisa

Alisa

Ilya

Ilya

Обычно монтирование идет в порядке следования записей в таблице zfs

Это совпадает с порядком в выводе zfs list ?

Если да, то порядок монтирования должен получаться а) алфавитным, б) дочерние после родительского

Alisa

Alisa

George

George

Это совпадает с порядком в выводе zfs list ?

Если да, то порядок монтирования должен получаться а) алфавитным, б) дочерние после родительского

Емнип резолвер вложенности был, но раньше с ним были проблемы. Просто ребутнитесь и убедитесь что все правильно примонтировалось.

Либо просто вложенными датасетами

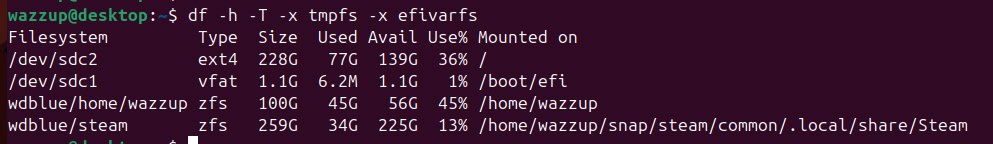

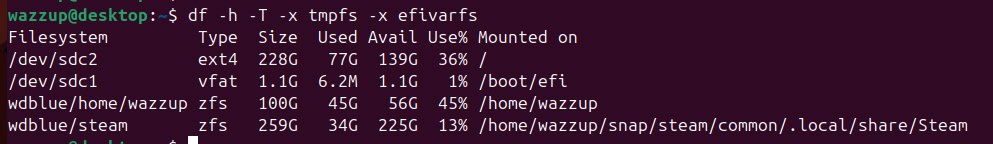

Либо даже проще - симлинками не меняя дефолтного маунтпоинта, тогда вообще на порядок без разницы (у меня в /var/games стим явно настроен идти даже)

Ilya

Ilya

Емнип резолвер вложенности был, но раньше с ним были проблемы. Просто ребутнитесь и убедитесь что все правильно примонтировалось.

Либо просто вложенными датасетами

Либо даже проще - симлинками не меняя дефолтного маунтпоинта, тогда вообще на порядок без разницы (у меня в /var/games стим явно настроен идти даже)

Вот это не прокатило почему-то. Как будто СтимКлиент не может по симлинкам ходить. Либо сломался какой-то симлинк внутри (а там есть симлинки, создаваемые приложением)

Делал ln -s /Steam /home/wazzup/snap/steam/common/.local/share/Steam (содержимое датасета соответствует нужной папке, разумеется. Сейчас смонтировано напрямую и Стим работает как ожидается)

Возможно, нужно было какую-то другую папку сделать симлинком.

Вложенный датасет makes sense, хотел просто убедиться, что он всегда будет монтироваться в нужном порядке без приколов.

George

George

Вот это не прокатило почему-то. Как будто СтимКлиент не может по симлинкам ходить. Либо сломался какой-то симлинк внутри (а там есть симлинки, создаваемые приложением)

Делал ln -s /Steam /home/wazzup/snap/steam/common/.local/share/Steam (содержимое датасета соответствует нужной папке, разумеется. Сейчас смонтировано напрямую и Стим работает как ожидается)

Возможно, нужно было какую-то другую папку сделать симлинком.

Вложенный датасет makes sense, хотел просто убедиться, что он всегда будет монтироваться в нужном порядке без приколов.

Мб снап сендбоксит, не помню точно его поведение, я напрямую стим юзаю

Ilya

Ilya

А мой как раз не даёт из клиента настроить. И, скорее всего, как раз из за снап-версии. Да и так сойдёт

George

George

А мой как раз не даёт из клиента настроить. И, скорее всего, как раз из за снап-версии. Да и так сойдёт

Тогда да, снап и проще монтировать

Dexex

Dexex

Столкнулся с проблемой. При загрузке linux на debian после этапа монтирования корня(xfs) начинается сильная дисковая активность при монтировании pool. И он продолжается до сих пор - 4 часа уже. Что можно сделать?

Fedor

Fedor

Привет! Мы тут не сможем подсказать ничего по XFS. Тут чат про ZFS - это совсем другая файловая система.

Vladislav

Vladislav

Dexex

Dexex

Привет! Мы тут не сможем подсказать ничего по XFS. Тут чат про ZFS - это совсем другая файловая система.

Так я про zfs и говорю. Я просто упомянул что корень на xfs. А пул на zfs.

Vladislav

Vladislav

Так я про zfs и говорю. Я просто упомянул что корень на xfs. А пул на zfs.

А теперь открываем правила

Dexex

Dexex

А теперь открываем правила

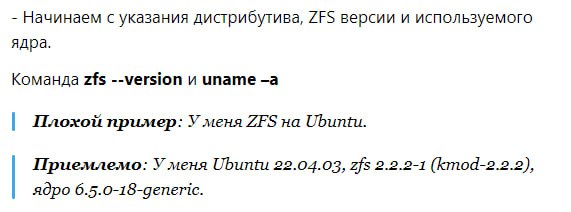

debian 12 6.1.0.28 - все ванильное и обычное. Ничего не предпринимал. Просто перезагрузил после скачка напряжения сервер. И идет такая дисковая активность, лампочка горит, винты что то там делают и все. Перед началом старта всех systemctl демонов - вот на таком этапе.

Dexex

Dexex

Такое впервые. То есть обычно ошибка какая то или что то, все диски на месте - смотрел в bios.

Vladislav

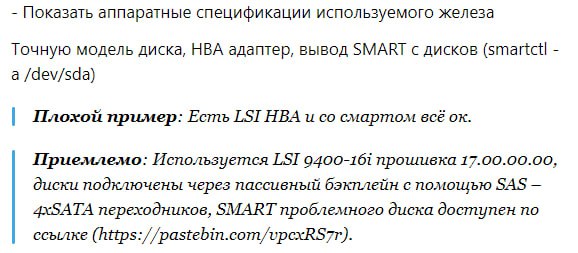

Vladislav

debian 12 6.1.0.28 - все ванильное и обычное. Ничего не предпринимал. Просто перезагрузил после скачка напряжения сервер. И идет такая дисковая активность, лампочка горит, винты что то там делают и все. Перед началом старта всех systemctl демонов - вот на таком этапе.

Vladislav

Vladislav

Vladislav

Vladislav

George

George

debian 12 6.1.0.28 - все ванильное и обычное. Ничего не предпринимал. Просто перезагрузил после скачка напряжения сервер. И идет такая дисковая активность, лампочка горит, винты что то там делают и все. Перед началом старта всех systemctl демонов - вот на таком этапе.

как построен пул, какой массив собран, какой размер? Были кейсы где после очень неудачного стечения обстоятельств импорт может быть долгим, в более свежих версиях openzfs всякое лечили. Минимум стоит dmesg глянуть. Если данные побыстрее нужны - скорее всего импорт в readonly режиме пройдёт быстрее.

Vladislav

Vladislav

debian 12 6.1.0.28 - все ванильное и обычное. Ничего не предпринимал. Просто перезагрузил после скачка напряжения сервер. И идет такая дисковая активность, лампочка горит, винты что то там делают и все. Перед началом старта всех systemctl демонов - вот на таком этапе.

Значит наверно их возможно надо выключить? Там на экране даже обычно может писаться какой демон сейчас "Waiting for start "

Dexex

Dexex

как построен пул, какой массив собран, какой размер? Были кейсы где после очень неудачного стечения обстоятельств импорт может быть долгим, в более свежих версиях openzfs всякое лечили. Минимум стоит dmesg глянуть. Если данные побыстрее нужны - скорее всего импорт в readonly режиме пройдёт быстрее.

Ну версия zfsutils-linux_2.1.11-1 в debian 12 вроде как. Ладно до завтра подождем, завтра поеду опять на место посмотрим, вдруг раздуплится. Но врядли

Dexex

Dexex

Vladislav

Vladislav

Dexex

Dexex

Значит надо отключать их по одному, наверно связанные с ZFS

ZFS то я выключу понятно что все запустится. Только что потом делать не ясно

Vladislav

Vladislav

ZFS то я выключу понятно что все запустится. Только что потом делать не ясно

Для начала сделай это

Vladislav

Vladislav

как построен пул, какой массив собран, какой размер? Были кейсы где после очень неудачного стечения обстоятельств импорт может быть долгим, в более свежих версиях openzfs всякое лечили. Минимум стоит dmesg глянуть. Если данные побыстрее нужны - скорее всего импорт в readonly режиме пройдёт быстрее.

Георгий человек хороший, он сразу дал тебе план что делать

Dexex

Dexex

как построен пул, какой массив собран, какой размер? Были кейсы где после очень неудачного стечения обстоятельств импорт может быть долгим, в более свежих версиях openzfs всякое лечили. Минимум стоит dmesg глянуть. Если данные побыстрее нужны - скорее всего импорт в readonly режиме пройдёт быстрее.

raidz2 на дисках по 2tb объемом 4. 4 диска.

Vladislav

Vladislav