/report

Reported to 1 admin(s)

Никита

Никита

Народ, подскажите пожалуйста, 8 nvme дисков лучше в 4 пары mirror сделать или raidz? для максимального быстродействия, надежность вторична

Fedor

Fedor

можно провести испытания и в той, и другой топологии. по логике - из описанных вариантов миррор будет иметь меньше внутренних переключений.

Илья

Илья

Ivan

Ivan

А можно ли использовать один диск для l2arc и для ZIL?

разбив диск на партиции можно отдавать партиции под что угодно

Roman

Roman

Народ, подскажите пожалуйста, 8 nvme дисков лучше в 4 пары mirror сделать или raidz? для максимального быстродействия, надежность вторична

Ели надёжность вторична, то не используй zfs.

Fedor

Fedor

А можно ли использовать один диск для l2arc и для ZIL?

В случае использования ssd/nvme пропадает потребность в использовании и зил, и л2арк

Vladislav

Vladislav

Roman

Roman

Roman

Roman

Есть подозрение, что там по производительности и одного nvme будет с головой. Если это, конечно, норм nvme, а не домашние.

Станислав

Станислав

Виртуалки с 1с и mssql

Может пора на postgrespro?) Всё таки на нём аккредитацию без проблем можно пройти. А так-то я использую для такого кейса именно страйп из зеркал

Станислав

Станислав

Есть подозрение, что там по производительности и одного nvme будет с головой. Если это, конечно, норм nvme, а не домашние.

Даже на домашнем 980 Pro в PCI-E 3.0 очень бодро работало. Переход на PM1725 никто не заметил из пользователей. При этом документооборот не маленький. Правда оперативной памяти на сервере 128Гб, а БД сейчас около 50Гб

Никита

Никита

Ну и зачем там рейд вообще😜

У меня не один сервер, а 4 штуки, у всех разные разделы по размеру, по этому как то хочется порезать это место на всех

Станислав

Станислав

Есть подозрение, что там по производительности и одного nvme будет с головой. Если это, конечно, норм nvme, а не домашние.

> Хочу 8 нвме для максимальной производительности.

> Есть подозрение, что там по производительности и одного nvme будет с головой. Если это, конечно, норм nvme, а не домашние.

> Даже на домашнем 980 Pro в PCI-E 3.0 очень бодро работало... БД сейчас около 50Гб

Не чувствуете связь? Вы предложили 1 вместо 8ми, я продолжил с домашним вариантом (не предлагал, а вспомнил как было). Если уж о 8ми дисках пишет человек, значит есть что хранить на них и 1 диск тут явно не к месту. Так-то для БД 50Гб и домашних хватало

Станислав

Станислав

У меня не один сервер, а 4 штуки, у всех разные разделы по размеру, по этому как то хочется порезать это место на всех

О каком размере речь? На каком железе будет хранилка?

Никита

Никита

О каком размере речь? На каком железе будет хранилка?

proxmox на борту CPU(s) 160 x Intel(R) Xeon(R) Gold 6230 CPU @ 2.10GHz (4 Sockets) 380GB RAM, nvme-Dell_Ent_NVMe_AGN_RI_U.2_1.92TB 10 штук, но парочку я уже спристроил в другие вм. Баз 1с уже за 30 штук вместе с тестовыми, самая большая база документооборота 250 гб +

Никита

Никита

В общем то nvme сюда ставились под нужды 1с и ничего больше, вот я и хочу понять как их использовать оптимальным образом

Станислав

Станислав

proxmox на борту CPU(s) 160 x Intel(R) Xeon(R) Gold 6230 CPU @ 2.10GHz (4 Sockets) 380GB RAM, nvme-Dell_Ent_NVMe_AGN_RI_U.2_1.92TB 10 штук, но парочку я уже спристроил в другие вм. Баз 1с уже за 30 штук вместе с тестовыми, самая большая база документооборота 250 гб +

Так-то БД не большие, а вот по поводу NUMA... Я избегаю конфигураций на несколько CPU и ZFS, пока есть такая возможность, т.к. доступ процессора к чужой памяти может сыграть злую шутку. И оперативной памяти как-то маловато

Ivan

Ivan

еще один момент - чтобы повесить все nvme на один проц - это надо спец контроллер дорогущщий покупать. в противном случае numa еще медленней рейд сделает.

Станислав

Станислав

еще один момент - чтобы повесить все nvme на один проц - это надо спец контроллер дорогущщий покупать. в противном случае numa еще медленней рейд сделает.

Кстати... Это в кейсе с ZFS или в принципе raid?

Станислав

Станислав

Может есть тут люди, которые пробовали NUMA на intel?

У меня есть сейчас в пользовании Epyc 7F52, на котором дичь твориться с доступом к памяти.

Vladislav

Vladislav

Nikolay

Nikolay

proxmox на борту CPU(s) 160 x Intel(R) Xeon(R) Gold 6230 CPU @ 2.10GHz (4 Sockets) 380GB RAM, nvme-Dell_Ent_NVMe_AGN_RI_U.2_1.92TB 10 штук, но парочку я уже спристроил в другие вм. Баз 1с уже за 30 штук вместе с тестовыми, самая большая база документооборота 250 гб +

https://forum.proxmox.com/threads/how-do-you-squeeze-max-performance-with-software-raid-on-nvme-drives.127869/

Vladislav

Vladislav

Народ, подскажите пожалуйста, 8 nvme дисков лучше в 4 пары mirror сделать или raidz? для максимального быстродействия, надежность вторична

Мне больше интересно другое, надёжность вторичная по причине наличия sql cluster, да ведь?

Ivan

Ivan

еще один момент - чтобы повесить все nvme на один проц - это надо спец контроллер дорогущщий покупать. в противном случае numa еще медленней рейд сделает.

а хотя я затупил. если взять 2 платы х4 nvme, то можно всё на один проц навесить. через два pcie слота ведущих в один проц. это если бифуркация поддерживается.

Konstantin

Konstantin

а хотя я затупил. если взять 2 платы х4 nvme, то можно всё на один проц навесить. через два pcie слота ведущих в один проц. это если бифуркация поддерживается.

Вот на моей матери дичь, два Цпу и все pci только на 1 Цпу ведут

Vladislav

Vladislav

Vladislav

Vladislav

Вот на моей матери дичь, два Цпу и все pci только на 1 Цпу ведут

5 слотов из 6 скорее всего

Станислав

Станислав

В плане

Было интересно сколько сможет ZFS отдать с кэша при 8ми каналах памяти. Отключил сжатие полностью, чтобы не делать лишней работы. Дотягивал что-то до 80+ Гбайт/с. Но это если повезет, т.к. при очередном замере может упасть до 50-и, а иногда и до 30-и. Приходилось удалять датасет, создавать заново и повторять замеры, которые всё-таки чаще упирались в 40-50Г

Vladislav

Vladislav

Станислав

Станислав

Так себе тест....

Почему же? Я правильно понимаю, что membench измерит скорость доступа к памяти по 8ми каналам?

Просто речь же про работу на этом железе ZFS. Суть в том, что, несмотря на общий доступ через Infinity Fabric во втором поколении, твориться ерунда с доступом к областям памяти, которые были выделены другому numa

Vladislav

Vladislav

Vladislav

Vladislav

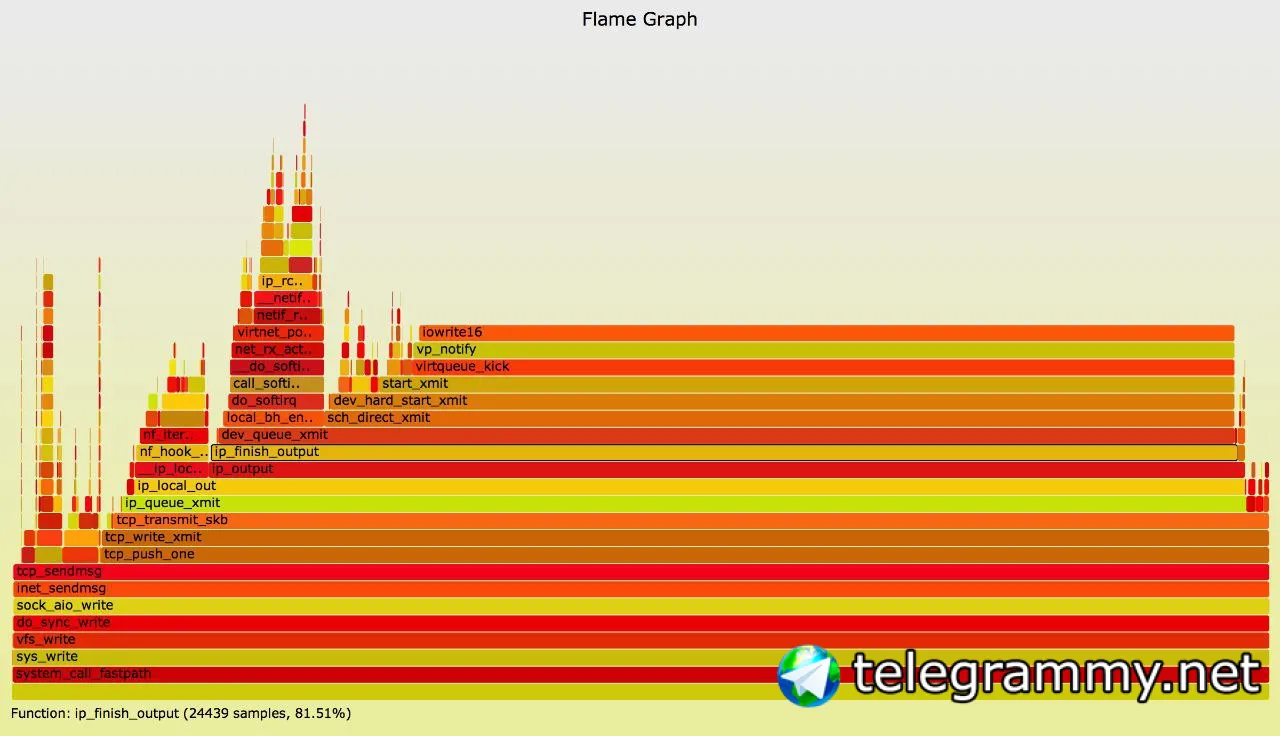

Zfs же показывает это примерно никак, это как смотреть на двойное параметрическое уравнение, где меняются ВСЕ переменные, и делать на основе этого выводы

Ты ведь не делал вот такие графики, чтобы понимать где стопор?

Vladislav

Vladislav

Станислав

Станислав

Zfs же показывает это примерно никак, это как смотреть на двойное параметрическое уравнение, где меняются ВСЕ переменные, и делать на основе этого выводы

Ты ведь не делал вот такие графики, чтобы понимать где стопор?

Так я в поисках стопора. Если есть что подсказать, то пожалуйста. Суть в том, что на 1м процессоре Intel с тем же количеством ядер поведение более предсказуемое и, я бы сказал, абсолютно стабильное

Vladislav

Vladislav

Так я в поисках стопора. Если есть что подсказать, то пожалуйста. Суть в том, что на 1м процессоре Intel с тем же количеством ядер поведение более предсказуемое и, я бы сказал, абсолютно стабильное

Открываем мембенч, смотрим результаты

Открываем fio на raw диск, смотрим результаты

Vladislav

Vladislav

Открываем мембенч, смотрим результаты

Открываем fio на raw диск, смотрим результаты

Открываем схему тестов и смотрим как у Интела и у АМД сделана разводка pcie линий

Vladislav

Vladislav

а хотя я затупил. если взять 2 платы х4 nvme, то можно всё на один проц навесить. через два pcie слота ведущих в один проц. это если бифуркация поддерживается.

Поэтому тут не меняется где какой будет диск, это уже решено

Vladislav

Vladislav

Открываем схему тестов и смотрим как у Интела и у АМД сделана разводка pcie линий

Ну и заодно обновляем все прошивки

Станислав

Станислав

Открываем схему тестов и смотрим как у Интела и у АМД сделана разводка pcie линий

Так в том то и суть, что я из кэша читал, а не с диска. Диск тут лишь для того, чтобы на нём сохранить.

Vladislav

Vladislav

Так в том то и суть, что я из кэша читал, а не с диска. Диск тут лишь для того, чтобы на нём сохранить.

Ты проверял, что ты из кэша читал?

Станислав

Станислав

Станислав

Станислав

Проверь все же

Так скорость в ~92GB/s меня более чем устраивала. А вот то, что при следующем замере она вдруг 50 и так стабильно все следующие 5-10 замеров.... При это памяти свободной за глаза

Vladislav

Vladislav

Станислав

Станислав

Это не показатель....

А при каком сценарии ARC высвободил бы часть? Чтобы потом каждый раз читать с диска какой-то кусок.

Vladislav

Vladislav

Но я прочитал, принял к сведению, попробую membench и построю графики

К примеру, ещё

https://www.intel.com/content/www/us/en/download/736633/intel-memory-latency-checker-intel-mlc.html

https://www.binarytides.com/benchmark-ram-speed-on-linux-with-sysbench/

Ну и mbw

Станислав

Станислав

К примеру, ещё

https://www.intel.com/content/www/us/en/download/736633/intel-memory-latency-checker-intel-mlc.html

https://www.binarytides.com/benchmark-ram-speed-on-linux-with-sysbench/

Ну и mbw

sysbench совершенно не умеет с Epyc работать. Измеряет что-то непонятное. Я с него начал, но хоть в один поток, хоть в 8 результат почти одинаковый — 22-24Гб/с

Vladislav

Vladislav

Vladislav

Vladislav

Oleg

Oleg

Всем привет, подскажите, если достойный ресурс или статья что бы более углубленно изучить zfs, сейчас эксплуатирую ее практически в дефолтных настройках. Хотелось бы получше узнать про варианты более оптимальных настроек, и вообще понять какие опции есть и решить для себя что из этого мне нужно а что оставить в дефолте.

Ivan

Ivan

Всем привет, подскажите, если достойный ресурс или статья что бы более углубленно изучить zfs, сейчас эксплуатирую ее практически в дефолтных настройках. Хотелось бы получше узнать про варианты более оптимальных настроек, и вообще понять какие опции есть и решить для себя что из этого мне нужно а что оставить в дефолте.

банально, но лучше всего с официальной доки начать https://openzfs.github.io/openzfs-docs/

Олег

Олег

Всем привет, подскажите, если достойный ресурс или статья что бы более углубленно изучить zfs, сейчас эксплуатирую ее практически в дефолтных настройках. Хотелось бы получше узнать про варианты более оптимальных настроек, и вообще понять какие опции есть и решить для себя что из этого мне нужно а что оставить в дефолте.

Была оракдовая методичка гдето, но год старый, хотя и поменялось мало чего

Oleg

Oleg

Была оракдовая методичка гдето, но год старый, хотя и поменялось мало чего

Я так понимаю там еще какято тема с совместимостью между версиями есть?

Oleg

Oleg

банально, но лучше всего с официальной доки начать https://openzfs.github.io/openzfs-docs/

Попробую и ее почитать

Олег

Олег

Я так понимаю там еще какято тема с совместимостью между версиями есть?

В первые слышу за 10 лет о таком

Group Butler

Group Butler

Алексей

Алексей