хочу больше)

Чтобы что ? Торент скидывать быстрее или что ?🤔😳

Georg🎞️🎥

Georg🎞️🎥

да

4-5 гиговый файл должен бодро литься так то 😱куда быстрее то , опять таки для просмотра гигабита тоже за глаза , скорость потока у видео подобных дно )

Rufat

Rufat

Ясно , думаю 200MB по сетке - это потолок линейного чтения , побереги премию, дома больше не нужно

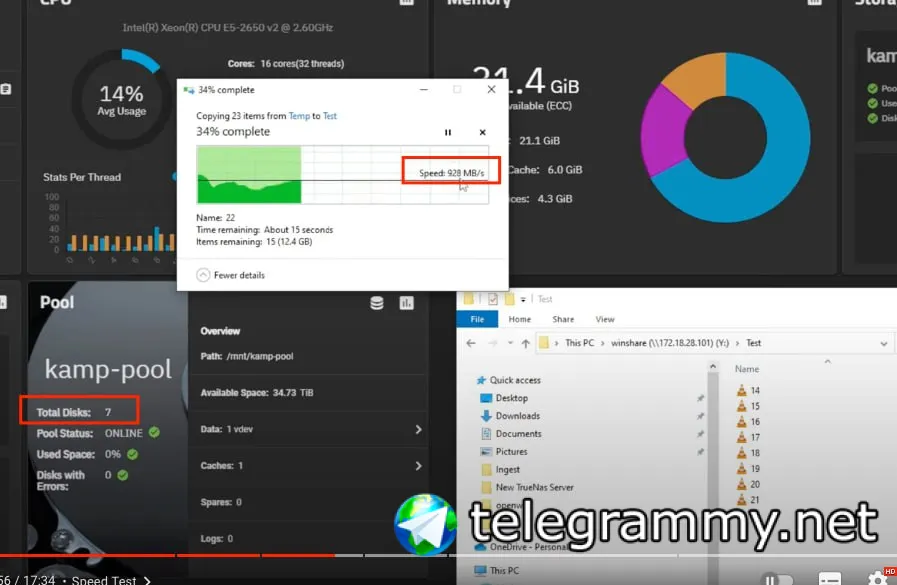

были видосы как по 10-ке гоняли файл.

впечатлило.

Roman

Roman

4 диска hdd такую скорость не выдадут

Просто собирай дома нормальный массив и 10г утилизируешь.

A

A

да хотя бы 110-120

обычную вторую сетевую карту на 1G можно поставить и сделать bonding c round robin и будет 200

Ivan

Ivan

Vladislav

Vladislav

nvme multipath лучше.

Я так и не понял как его делать, ибо в доках нормально только для spdk описано, для модуля ядра нихера нет

Алексей

Алексей

Ребята, всем привет! У меня есть идея создать серию небольших заметок по сравнению zfs c bcachefs чтобы в последствии скомпилировать из них полноценную статью на хабр. С разрешения администрации я выкладываю сюда ссылку на первую в серии заметку, просьба закидать тряпками до публикации полного цикла на хабре.

Жду конструктивную критику/вопросы/ошибки. Спасибо

Δαρθ

Δαρθ

Алексей

Алексей

тогда уж и бтрфс тоже

В моей задаче он аутсайдер, но если у него есть возможность выносить мету, то я добавлю его в сравнение. Но кажется там такого нет ?

Vladislav

Vladislav

Ребята, всем привет! У меня есть идея создать серию небольших заметок по сравнению zfs c bcachefs чтобы в последствии скомпилировать из них полноценную статью на хабр. С разрешения администрации я выкладываю сюда ссылку на первую в серии заметку, просьба закидать тряпками до публикации полного цикла на хабре.

Жду конструктивную критику/вопросы/ошибки. Спасибо

Проблема сравнения с zfs - слишком много параметров

Но рассматриваются же обе ФС чисто с точки зрения дефолта+выноса меты?

Алексей

Алексей

Проблема сравнения с zfs - слишком много параметров

Но рассматриваются же обе ФС чисто с точки зрения дефолта+выноса меты?

Ну типа да, с точки зрения меты

Алексей

Алексей

для ссд еще бы и трим делать вначале, а лучше сразу blkdiscard

Разве это важно при разметке заново?

Δαρθ

Δαρθ

Разве это важно при разметке заново?

ссд ничего про разметку не знает он тупо секторы читает-пишет

Алексей

Алексей

версии ядра почемуто разные ещ

Бкеш компилится в 6.7. Я к стыду своему не умею его скомпилить в другом ядре

Алексей

Алексей

Δαρθ

Δαρθ

Бкеш компилится в 6.7. Я к стыду своему не умею его скомпилить в другом ядре

значит zfs скомпилируй в 6.7 хз умеет ли оно уже

Δαρθ

Δαρθ

Нет. Максимум в 6.6 компилируется

тогда хотя бы 6.6

хтя все равно остается вероятность что чтото вне fs будет поразному влиять в разных ядрах

Алексей

Алексей

Δαρθ

Δαρθ

Вообще всего сообщения не понял про вдрочь фио вначале

зачем сначала фио а потом вычитка под таймер?

Алексей

Алексей

зачем сначала фио а потом вычитка под таймер?

Суть задачи изначально получить максимально быстрый обход файлов

Алексей

Алексей

ну я и говорю если задача с холодными кешами вычитать то их можно тупо сбросить

Каждому тесту предшествовал ремаунт и дроп кешей

Δαρθ

Δαρθ

кроме того фио делался не в зфс -- а значит тут уже есть нечестность

бкашефс юзает общие дисковые кеши линукса а у зфс свой велосипед

Δαρθ

Δαρθ

Каждому тесту предшествовал ремаунт и дроп кешей

тогда тем более смысла в фио невижу. разве что ссду засрать кеши записи?

Δαρθ

Δαρθ

Фио просто показывет общую производительность фс на одиночном диске

после фио делался ремаунт и сброс кешей?

Vladislav

Vladislav

Про параметры

Ещё, можно вот эти приседания повторить

https://www.phoronix.com/review/bcachefs-benchmarks-linux67/2

Андрей

Андрей

Δαρθ

Δαρθ

Каждому тесту предшествовал ремаунт и сброс кешей

тогда смысл делать фио только засрать кеш ССД, который очевидно никак не рулится снаружи

Nikita

Nikita

https://telegra.ph/Vybor-fajlovoj-sistemy-dlya-storj-12-28

Мелочи, но...

"Поэтому при использовании больших составных или raid массивов устройство с метаинформацией должно быть как минимум обладать избыточностью, например, зеркалировано." во первых немного не по-русски, во вторых, я бы уточнил, что "обладать избыточностью, не меньшей, чем у массива".

Алексей

Алексей

Nikita

Nikita

Занятно, попробовал найти хоть какие-то рекомендации по поводу special device в документации, а нашел только форумы и в лучшем случае issue на гите. А был уверен, что там написано то, что я подправил выше. Видимо с ZIL-ом перепутал.

Алексей

Алексей

Занятно, попробовал найти хоть какие-то рекомендации по поводу special device в документации, а нашел только форумы и в лучшем случае issue на гите. А был уверен, что там написано то, что я подправил выше. Видимо с ZIL-ом перепутал.

Настроек как таковых у спешл только одна special_small_blocks. Насколько я понял

Vladislav

Vladislav

Чет там андерграунд какой-то

-l logdev=device,size=size

Это заняло некоторое время...

To mount the XFS file system so that it uses the external journal, specify the -o logdev=device option to the mount command.

Но неудобно пиздец

Алексей

Алексей

George

George

ALLEX

ALLEX

пацаны, можно ли примонтировать сторонний ssd с zfs для доступа к файлам? Потом этот диск отключить.

mikhail

mikhail

пацаны, можно ли примонтировать сторонний ssd с zfs для доступа к файлам? Потом этот диск отключить.

zpool import - покажет имена пулов.

zpool import -f ИмяПула - принудительно импортирует его

Василий

Василий

Вопрос про мету. Есть ли возможность вынести мету и смолблок на разные зеркала? Хочу под мету и смол блок иметь разные диски с разными характеристиками.

Алексей

Алексей

sweetiefox

sweetiefox

Всем доброго времени суток. Ищу помощи специалистов по тюнингу ФС и умению сделать "все хорошо". Из группы Storage Discussions подсказали написать сюда.

Дано сервер - Ubuntu 20.04 LTS, ppc64le 80 x 3.49GHz, 512GB RAM

Диски

2 x 16TB 3.5" HDD SATA WD

1 x 1.6TB AIC SSD NVMe PCIe x8 Samsung

2 x 128GB M.2 SSD NVMe PCI4 x4 Samsung

+ (маленький диск под OS но он не в счет, его не трогаем)

Надо

Собрать дисковую подсистему для 20 контейнеров (это максимум), рабочий объем данных что нужен в горячем пуле не превышает 1TB, скорости All-Flash не ожидаются, по IOPS требования очень низкие. Возможно доустановить несколько NVMe дисков при необходимости. А также полностью затюнить все критические параметры.

Пока в текущем тестовом стенде сделано так, zfs последняя версия из репо. RAID1 из 2 HDD средствами zfs, 1.6TB под L2ARC, 1 диск на 128GB по ZIL SLOG, 1 диск на 128GB под метаданные (special device). Очевидно что нужен глубокий тюнинг всего этого дела.

sweetiefox

sweetiefox

В основном по iostat операции будут 80-90% read / 10-20% write, типовой рабочий датасет примерно 1TB. Просадки из-за промахов кэша не критичны, ситуаций с волнообразным обновлением данных по rand крайне редки, обычно контейнеры по чуть чуть подсасывают нужные данные в свой рабочий датасет +/-, но даже если будет просадка по IOPS - то она не фатальна, ибо SLA на это нету - клиента это не важно.

LordMerlin

LordMerlin

Vladislav

Vladislav