Vladislav

Vladislav

Veeam - ффтопку

Ну не скажи, он точно удобнее чем commvault для малых/средних инфраструктур

Ivan

Ivan

@ialebedev ты в r/w-то стабильный смог примонтироваться ? Чем дело закончилось ?

Кстати, спрошу наперед. Допустим, я смог откатиться на предыдущую версию zfs, и смог смонтировать на rw. Как мне проверить, действительно ли в нем не пострадала инфа и насколько пул в целости?

Станислав

Станислав

Vladislav

Vladislav

Кстати, спрошу наперед. Допустим, я смог откатиться на предыдущую версию zfs, и смог смонтировать на rw. Как мне проверить, действительно ли в нем не пострадала инфа и насколько пул в целости?

Я с некоторых пор строю текстовое древо через ncdu и потом сравниваю после работ

Ivan

Ivan

Я с некоторых пор строю текстовое древо через ncdu и потом сравниваю после работ

А что! Это кстати, вариант!

Ivan

Ivan

Вопрос немного не по теме ZFS, но может кто знает. Есть NFS шары, которые клиенты монтируют как hard, через соответствующий systemd маунт сервис.

Если по каким-то причинам шара уходит в офлайн, то все программы что обращались к шаре фризятся, до момента восстановления шары. А можно как-то заставить сервис останавливаться, если шара какое время недоступна?

Я не единожды пытался это реализовать, но пока так и не получилось. Ман по этому делу перечитал несколько раз, пробовал и LazyUnmount и ForceUnmount включать в сервисе. Но успеха не добился.

В идеале мне нужно, чтобы в случае отваливания шары, чтобы на машине клиента она отмонтровалась, чтобы фриз програм ушел, а когда шара вернётся, она автоматически снова подцеплялась.

Fedor

Fedor

Предлагаю почитать про состояние процесса d-state. При таком способе, насколько помню, при отвале возможен только он.

Можно попробовать поиграть с логикой сервиса в условиях более мягкого монтирования.

Roman

Roman

Ivan

Ivan

что насчёт soft?

Честно сказать принципиально разницы не заметил в тестах с soft и hard. Терминал отваливался в итоге и возвращался к жизни. А например dolphin нет. В случае hard, фризились оба и без намека на анфриз

Roman

Roman

Честно сказать принципиально разницы не заметил в тестах с soft и hard. Терминал отваливался в итоге и возвращался к жизни. А например dolphin нет. В случае hard, фризились оба и без намека на анфриз

Это проблема dolphin.

Для автоматического монтирования есть automount.

Чем принципиален hard?

Ivan

Ivan

Roman

Roman

А вообще

https://access.redhat.com/documentation/en-us/red_hat_enterprise_linux/5/html/deployment_guide/s1-nfs-client-config-options

Ivan

Ivan

А вообще

https://access.redhat.com/documentation/en-us/red_hat_enterprise_linux/5/html/deployment_guide/s1-nfs-client-config-options

Ага, спасибо за ссылку. Пошел читать)

Vladislav

Vladislav

я так понял, при смене recordsize на пуле с данными дефрагментатора не предусмотрено?

придется повторно переливать ?

P.S. этот пул не загрузочный

Fedor

Fedor

Новый рекордсайз будут использовать только новые данные. Старые данные будут читаться со старым рекордсайзом.

Дефрагментации в зфс нет за бессмысленностью.

Vladislav

Vladislav

Новый рекордсайз будут использовать только новые данные. Старые данные будут читаться со старым рекордсайзом.

Дефрагментации в зфс нет за бессмысленностью.

ну, вот в моем случае хотелся бы ручной запуск дефрагментатора

Fedor

Fedor

Его нет :)

Как вариант - заново занести данные, они лягут с новым рекордсайзом, но дефрагментации не будет. Может, будет мнимая дефрагментация, но рандомное чтение так и так сохранится по ряду причин. При записи на пул во время эксплуатации любой мнимый эффект от дефрагментации будет утерян.

Vladislav

Vladislav

Его нет :)

Как вариант - заново занести данные, они лягут с новым рекордсайзом, но дефрагментации не будет. Может, будет мнимая дефрагментация, но рандомное чтение так и так сохранится по ряду причин. При записи на пул во время эксплуатации любой мнимый эффект от дефрагментации будет утерян.

так и понял.

переливаю заново ~800 ГБ

Vladislav

Vladislav

у меня сейчас так с идентичными данными

# zpool list tank2

NAME SIZE ALLOC FREE CKPOINT EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

tank2 5,44T 810G 4,65T - - 31% 14% 1.23x ONLINE -

# zpool list tank3

NAME SIZE ALLOC FREE CKPOINT EXPANDSZ FRAG CAP DEDUP HEALTH ALTROOT

tank3 2,72T 775G 1,96T - - 9% 27% 1.09x ONLINE -

Ivan

Ivan

Fedor

Fedor

в логах будет периодически подобное

WARNING: zfs: adding existent segment to range tree (offset=a18422c6000 size=4a000)

Fedor

Fedor

чтобы при загрузке системы не было ошибки

он же сразу пробует импортнуть

и система не загрузится

Fedor

Fedor

у меня оно просто в логах проскакивает

плюс я не запускаю режимы, которые вызывают core

в остальном работает как работало в rw

Ivan

Ivan

Ivan

Ivan

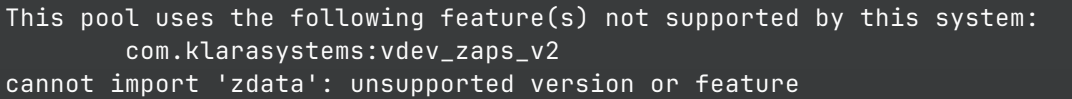

Пока есть проблема. Поскольку я для теста попробовал откатиться на предыдущую версию zfs, но импортнуть не получилось т.к. не было нужных фич. Я вернулся обратно на последнюю версию

Nikita

Nikita

@ialebedev Я может пропустил что-то. Если у вас не стоит цель во что бы то ни стало запустить имеющийся пул и разобраться, в чем дело, то раз уже есть бэкап - может стоит создать новый пул и развернуть туда все фс из бэкапа? Разумеется, сначала стоит это без затирания исходного пула попробовать. Может, какую то часть.

Nikita

Nikita

Ну бэкап сделан через rsync, а не replicate

а повторить при помощи zfs send/recv в другое место? я zxfer пользуюсь, там вся процедура в две команды. но, насколько я помню под linux там надо какие-то пути в скрипте менять. а 20тб потоком относительно быстро должны перелиться, хотя всё от скорости интерфейсов зависит.

Vladislav

Vladislav

а повторить при помощи zfs send/recv в другое место? я zxfer пользуюсь, там вся процедура в две команды. но, насколько я помню под linux там надо какие-то пути в скрипте менять. а 20тб потоком относительно быстро должны перелиться, хотя всё от скорости интерфейсов зависит.

только использовать надстройку sanoid/syncoid

Ivan

Ivan

Други, а подскажите какое-нибудь решение как это лучше реализовать. Есть сервер с nfs шарой, на ней хранятся файлы рабочие для общего доступа и некоторые конфигурационные файлы, которые едины для всех клиентов.

Клиенты при загрузке монтируют nfs шару и работают. А также через символические ссылки с шары клиенты получают общие файлы настроек. Например у всех клиентов .bashrc есть ни что иное как ссылка на .bashrc лежащий на nfs шаре и мне очень удобно вносить в него правки и они сразу появляются у всех пользователей.

Вопрос. А есть ли какое-то решение, при котором можно реализовать то же самое, но без символических ссылок. Т.к. например тот же общий bashrc, который я смогу править и автоматом он будет обновляться у всех клиентов. Но при этом каждый bashrc клиента был ты не ссылкой на общий, а физически отдельным файлом.

Собственно зачем мне это нужно? А нужно мне это за тем, что если по каким-либо причинам nfs шара отключена, клиенты не теряли общие настройки, общие глобальные переменные и т.п. потому что сейчас например, если nfs шара отключена, то у всех клиентов bashrc фактически становится пустой.

Ivan

Ivan

Т.е. если коротко, я хочу реализовать такое решение, при котором я мог бы править конфигурационные файлы в одном месте, и это распространялось бы на все физические клиентские машины

Shaker

Shaker