Ошибка, что я не указал блок 512, признаю

И —bs использовать 4k или 512k?

Ivan

Ivan

Ладно, хер с Вами:

Size=1024gb

bs=1M

Numjobs=1

Iodepth=16

rw=read/write

Спасибо!

Вот что получилось на принимающем хранилище

READ bw=2426 MiB/s (2543 MB/s) IOPs=2425 clat: avg=6.18 ms

RAND READ bw=57.3 MiB/s (60.0 MB/s) IOPs=57 clat: avg=261.58 ms

WRITE bw=1477 MiB/s (1549 MB/s) IOPs=1477 clat: avg=10.16 ms

RAND WRITE bw=1459 MiB/s (1529 MB/s) IOPs=1458 clat: avg=10.29 ms

Ivan

Ivan

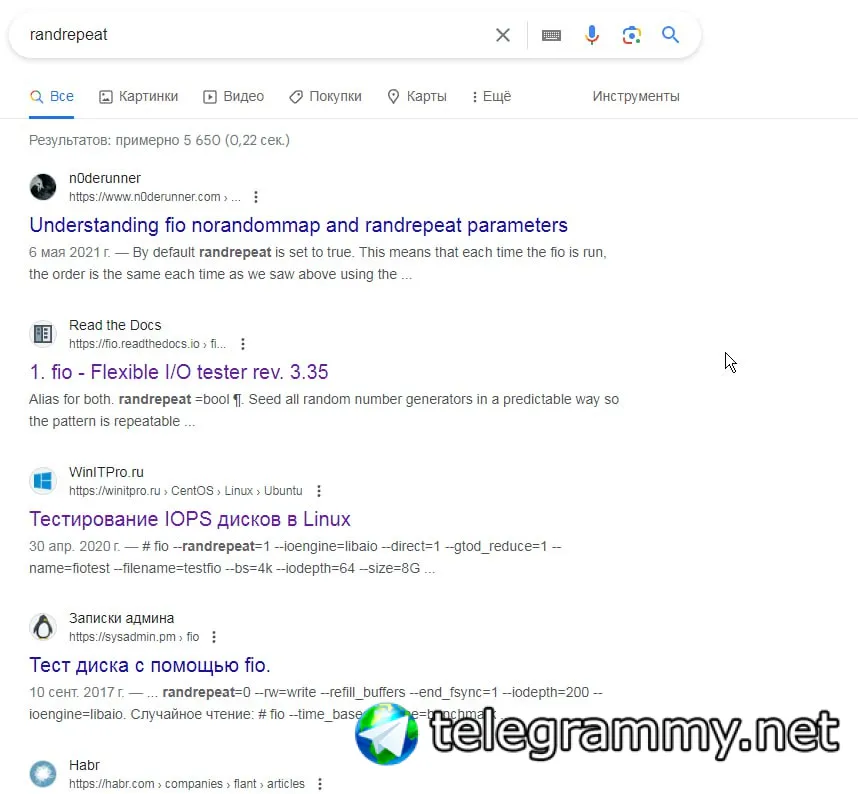

Странно, пытаюсь добавить параметр —randrepeat=false, а она пишет что ошибка парсинга параметра

fio --filename=./test.img --size=50G --direct=1 --rw=read --randrepeat=false --bs=1M --ioengine=libaio --iodepth=16 --runtime=120 --numjobs=1 --time_based --group_reporting --name=test

Ivan

Ivan

Может я куда не туда вписал этот параметр, хотя я попробовал по разному, и пишет что ошибка парсинга randrepeat

Vladislav

Vladislav

Ivan

Ivan

fio --filename=./test.img --size=1024gb --direct=1 --rw=read --randrepeat=false --bs=1M --ioengine=libaio --iodepth=16 --runtime=120 --numjobs=1 --group_reporting --name=iops-test-job

Ivan

Ivan

И timebased уберите

Убрал. Поставил Size=1024gb, как вы сказали. Та же ошибка парсинга —randrepeat=false

Если убрать этот параметр, то команда срабатывает, но она тупо ооочень долго создает файл для чтения, прежде начинает что либо считать.

Зачем такой огромный размер файла? 50Г что у меня разве не достаточно для получения объективных результатов?

Vladislav

Vladislav

Ivan

Ivan

Вы не поверите, я уже очень много и давно читаю. Но возникают вопросы, поэтому и обращаюсь с вопросами, не часто правда.

Vladislav

Vladislav

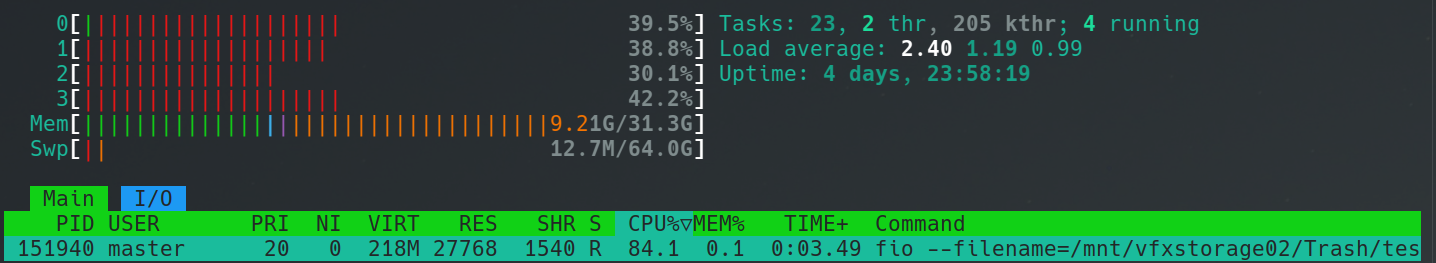

У меня оперативки 32 ГБ, а диск кэша L2arc на 256 гигов.

И чем же сейчас забиты эти 32ГБ при тестах на линейное чтение?

Ivan

Ivan

И чем же сейчас забиты эти 32ГБ при тестах на линейное чтение?

Artem

Artem

без —randrepeat=false, потому что этот параметр не срабатывает, выдается ошибка парсинга

Чтение манов вслух с выражением - от $100 в час...

Бу...

Бу...

Чтение манов вслух с выражением - от $100 в час...

Чтение манов вслух с матерными выражениями - от $200 в час...

Vladislav

Vladislav

Ясно, судя по всему, в этом чате больше флуда чем помощи. Всем спасибо

Вам готовы *помочь*, но мы не в дет саду

А Вы утверждаете что умеете читать

Ivan

Ivan

Вам готовы *помочь*, но мы не в дет саду

А Вы утверждаете что умеете читать

Я понимаю, но я как-то не вижу где я детские вопросы задаю

Ivan

Ivan

Просто если бы статьи в инете писались бы исключительно компетентными людьми и умеющими понятно объяснять, то наверно вопросов меньше было бы

Ivan

Ivan

Ладно, я уже сказал. Спасибо! Разберусь сам, мне не впервой. Тем более что с такой темой я уже приходил некоторое время назад, толку было плюс минус столько же ))

Ivan

Ivan

На этом я точно не готов больше отвечать на Ваши вопросы.

Ну не готовы, я же не заставляю вас ))

Ivan

Ivan

Рекомендую использовать ext4 и LVM вам

Использовал mdadm+ext4 очень долго и продуктивно и что самое интересное это было быстрее, чем щас с ZFS. Но ZFS имеет много всего хорошего, вот и пытаюсь разбираться.

Ivan

Ivan

Да и не верится мне как-то что ZFS будет в разы медленнее, что даже при дефолтных настройках, плюс минус.

Ivan

Ivan

Ну конечно я полагаю, что да может быть где-то он уступать в скорости, но за счет оперативки дополнительной и других его плюшек, можно выжать очень классные скорости и другие вещи. Поэтому и начал копать его уже давно.\

Ivan

Ivan

А самое главное ZFS удобнее в использовании. Но блин, вот со скоростью, пока как-то не то получается. Пытаюсь понять в чем затык

Кот Матроскин

Кот Матроскин

Вот смотрите, немного теории.

Есть RAIDZ1 из 3-ёх дисков WD 4 Tb, тут безоговорочное сохранение данных при потере одного диска, или может случится так, что ZFS потеряет какие то данные?

Настраивается ли как то у ZFS логирование повреждённых данных при обращении без их удаления?

Andrey

Andrey

Вот смотрите, немного теории.

Есть RAIDZ1 из 3-ёх дисков WD 4 Tb, тут безоговорочное сохранение данных при потере одного диска, или может случится так, что ZFS потеряет какие то данные?

Настраивается ли как то у ZFS логирование повреждённых данных при обращении без их удаления?

RAIDZ гарантирует сохранность данных вплоть до потери одного диска

Кот Матроскин

Кот Матроскин

RAIDZ гарантирует сохранность данных вплоть до потери одного диска

Как мы выяснили выше уже, с бэдами можно потерять данные и без отказа целого диска)

Станислав

Станислав

Как мы выяснили выше уже, с бэдами можно потерять данные и без отказа целого диска)

Слышал я как-то историю (раз 5 уже), как дата-центр сгорел. Чтобы не терять данные, нужно хранить бэкап на удалённом севере. Кстати, делая раз или несколько раз в сутки снимок и отправляя его куда-нибудь (да хоть в /dev/null), тем самым инициируете проверку только новых данных. Это та самая проверка, которую вы спрашивали

Кот Матроскин

Кот Матроскин

Слышал я как-то историю (раз 5 уже), как дата-центр сгорел. Чтобы не терять данные, нужно хранить бэкап на удалённом севере. Кстати, делая раз или несколько раз в сутки снимок и отправляя его куда-нибудь (да хоть в /dev/null), тем самым инициируете проверку только новых данных. Это та самая проверка, которую вы спрашивали

Бекапы то понятно...

Но есть массивы данных где бекапы не сделаешь, например массив на 100 Tb очень напряжно бекапить)

Станислав

Станислав

Бекапы то понятно...

Но есть массивы данных где бекапы не сделаешь, например массив на 100 Tb очень напряжно бекапить)

В смысле не сделаешь? Необходимость делать бекап определяется не размером массива, а важностью данных.

Кот Матроскин

Кот Матроскин

В смысле не сделаешь? Необходимость делать бекап определяется не размером массива, а важностью данных.

Еще размером, иногда что бы забекапить массив, нужен другой массив, который жирнее первого)

Станислав

Станислав

Еще размером, иногда что бы забекапить массив, нужен другой массив, который жирнее первого)

Не вижу в этом ни капли разума. Данные либо нужны, либо нет. Сразу вспоминается: "Админы делятся на 2 типа:

1) Которые ещё не делают бекапы

2) которые уже делают"

Кот Матроскин

Кот Матроскин

Не вижу в этом ни капли разума. Данные либо нужны, либо нет. Сразу вспоминается: "Админы делятся на 2 типа:

1) Которые ещё не делают бекапы

2) которые уже делают"

Хорошо, у вас есть сторадж на 300 Tb, куда вы будете его бекапить?

На сторадж в 1200 Tb?

Кот Матроскин

Кот Матроскин

Именно по этому хочется от ZFS потери данных только в ИСКЛЮЧИТЕЛЬНЫХ случаях, а не как в mdadm или ntfs.

Georg🎞️🎥

Georg🎞️🎥

Кот Матроскин

Кот Матроскин

Просто когда данные золотые это одно, а когда данные жирные и не золотые, то при таких объемах очень дорого бекапить)

Ivan

Ivan

Просто когда данные золотые это одно, а когда данные жирные и не золотые, то при таких объемах очень дорого бекапить)

бэкапить важное, неважное не бэкапить. более того, бэкапить можно довольно компактно.