А ну и мейлбоксы по нфс для почтовика

Communigatepro передаёт привет полагаю

Autumn

Autumn

Communigatepro передаёт привет полагаю

да не, просто линуховая почта ручками поднятая, есть просто на ubuntu, есть iredmail, по разному, сама почта виртуалка, а zfs сторадж уже по nfs цепляю

Georg🎞️🎥

Georg🎞️🎥

Сорян, пропустил вопрос. Отвечаю - я не могу точно описать, потому что не занимаюсь ни фото ни видео, но у меня был кейс, была мини-студия и там люди занимались видеомонтажом и фотообработкой. Попросили надежный сторадж для кучи фото/видео итд, что бы реалтайм на нем работать а не тащить данные с него на локальный комп и обратно. Я собрал zfs машинку на 8 шпинделей и слог из двух ссд и раздал по самбе все это дело. Они сказали все оки, но можно быстрее? Я прикрутил трипл спешл девайс на трех мелких samsung pro и вуаля - все стало гораздо лучше и по фото и по видео. Ну раз говорят что видеообработка улучшилась то чего бы не верить. А так я честно хз как эти все адоб премьер и сони вегас с видеофайлами и исходниками работают.

Трипл спешл забрал звук , и еще закэшировалось ))8 шпинделей оч мало иопс для монтажа , в лучшем случае - 1 рабочее место

Vladislav

Vladislav

Трипл спешл забрал звук , и еще закэшировалось ))8 шпинделей оч мало иопс для монтажа , в лучшем случае - 1 рабочее место

Не у всех десятки тэров видео))))

Autumn

Autumn

Трипл спешл забрал звук , и еще закэшировалось ))8 шпинделей оч мало иопс для монтажа , в лучшем случае - 1 рабочее место

в студии было 3 мака для обработки и три криэйтора =) плюс манагер и пара девочек-секретуток и да студия эта не Linus Tech Tips =) короче там меньше 10 компов и из них 3 или 4 активно работали со стораджом

Georg🎞️🎥

Georg🎞️🎥

в студии было 3 мака для обработки и три криэйтора =) плюс манагер и пара девочек-секретуток и да студия эта не Linus Tech Tips =) короче там меньше 10 компов и из них 3 или 4 активно работали со стораджом

Закэшились и спешл помог ))) спешил ж не только под мету ?

Я вот не могу пока остановить работы и обновить версию зфс(((

Autumn

Autumn

Закэшились и спешл помог ))) спешил ж не только под мету ?

Я вот не могу пока остановить работы и обновить версию зфс(((

мета и если указать small_blocks то он всосет все мелкие файлы меньше указанного размера, только не надо small_blocks указывать равным или больше reсordsize, ну и мелкие файл "крадут" место под метаданные, так что надо рассчитать, что бы под метаданные было всегда доступно место

Georg🎞️🎥

Georg🎞️🎥

мета и если указать small_blocks то он всосет все мелкие файлы меньше указанного размера, только не надо small_blocks указывать равным или больше reсordsize, ну и мелкие файл "крадут" место под метаданные, так что надо рассчитать, что бы под метаданные было всегда доступно место

Да, вот звук туда б сгрузить , тока ssd посерезнее взять, с хорошим рандомным чтением 🤔

Georg🎞️🎥

Georg🎞️🎥

Autumn

Autumn

Да, вот звук туда б сгрузить , тока ssd посерезнее взять, с хорошим рандомным чтением 🤔

в зфс чтение предже всего про ARC, так что лучше больше ОЗУ накинуть =) а ссд это про запись прежде всего

Georg🎞️🎥

Georg🎞️🎥

в зфс чтение предже всего про ARC, так что лучше больше ОЗУ накинуть =) а ссд это про запись прежде всего

Arc макс уже

Запись в монтаже - это тока сэйв ))) чтение лютое, оперативы не напасешься

Autumn

Autumn

Сколько тут было памяти ?

там была какая-то старая HP Workstation с Xeon + ECC RAM в которую набил сколько влезло WD Red, ОЗУ вроде 64ГБ

Georg🎞️🎥

Georg🎞️🎥

там была какая-то старая HP Workstation с Xeon + ECC RAM в которую набил сколько влезло WD Red, ОЗУ вроде 64ГБ

У них походу h264 видосики 🤔судя по объемам, но пол спешл мож хорошая идея , спасибо

Vladislav

Vladislav

Тут надо blktrace снимать

Что-то такое

https://vox.veritas.com/t5/Availability/SmartAssist-A-Workload-Analysis-Tool/ba-p/881738

Autumn

Autumn

У них походу h264 видосики 🤔судя по объемам, но пол спешл мож хорошая идея , спасибо

да они там свадьбы/похороны да гулянки снимали, обычная провинциальная студия, было лет 5 назад это, может чутка меньше19-20 год вроде, уже и не припомню, тогда 4к еще не было так распространено, снимали вроде все на кэнон марк 4, короче им хватало, причем изначально я взял за основу Qnap сторадж в который можно поставить спецкарту qnap и в нее от 2 до 4 нвме и они работали как кэш для шпинделей, но оказалось что в природе карты есть а на рынке хер найдешь, а установка обычной pci nvme в кэш не превращалась, а ссдшка была лишь обычным диском, поэтому я выбрал старый хп воркстейшн и зфс, благо с этими ворксейшнами был опыт в связке проксмокс+зфс под виртуализацию для мелкого бизнеса, работали они долго и надежно

Autumn

Autumn

Одна прооблема с этими хп воркстейшн - у них внутри проприетарная мать, иногда в зависимости от модели еще и БП, но в отличии от их серверов, под зфс они хавали диски любого вендора - пихай что хочешь, все заведется

Александр

Александр

Autumn

Autumn

ML тоже жрет любый диски сас.

ну технически да, практичеки есть проблемы, а когда я в DL380 G8 запихал самсунг ссд он жаловался на перегрев, короче проще купить супермикру в таком случае, что я и сделал

Александр

Александр

но можно винты нулевками закинуть и на нуликахх построить массив, а smartmontools нормально читает смарт

Autumn

Autumn

с микрой конечно проще, правда там ipmi....работает, но ява жешь....

ява нужна лишь для пропихивания витуальных дисков при удаленной установке, в остальном там давно HTML5 консоль, ну и на сколько часто мы в этот IPMI лазим? а лицензии на IPMI скриптом генерятся

Александр

Александр

это да, только из необходимости, но первая инсталляция обычно перед физ консолью, а потом очень редко в ipmi

Vladislav

Vladislav

ну технически да, практичеки есть проблемы, а когда я в DL380 G8 запихал самсунг ссд он жаловался на перегрев, короче проще купить супермикру в таком случае, что я и сделал

Потому что нужно другой рейд контроллер использовать

riv

riv

SATA SSD в zfs страйп зашквар?

Для торрентов

Если пох на данные, то не зашквар. Надо понимать, что при отказе любого носителя, все данные точно будут потеряны.

Станислав

Станислав

SATA SSD в zfs страйп зашквар?

Для торрентов

В таком сценарии что угодно зашквар со стороны надежности. А для хранения ненужных данных - очень даже норм.

Rufat

Rufat

Shaker

Shaker

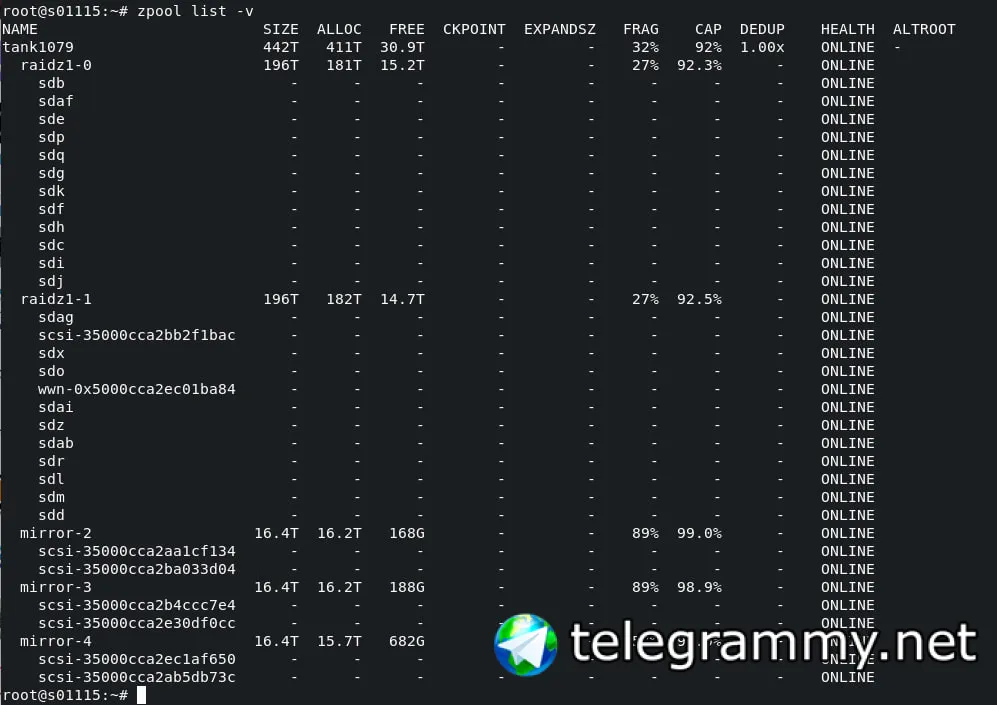

Внимание, вопрос ;)

Есть небольшой массив из 36 дисков WUH721818AL5204 SAS. Пробег дисков 5 тыс часов в среднем.

Ubuntu 22.04, zfs 2.1.5 .

Подключено через 2 полки 3par по sas3 одним линком параллельно к HBA LSI 9400.

Регулярно отваливаются рандомные диски при нагрузке на чтение. Вылетает от 1 до 5 дисков. Вплоть до состояния suspend.

Есть идеи, что может быть ?

* Кабель меняли.

* HBA меняли.

* HBA не перегревается.

* Ошибки на дисках не растут.

* Полку меняли.

* Вылетают в обех полках.

* В линию не упирается ( подключали макс 4 диска в полку), не помогло.

* Диски меняли.

Shaker

Shaker

Как правило, диски в dmesg c такой ошибкой "[151623.965756] zio pool=tank1079 vdev=/dev/sdj error=5 type=1 offset=1986761621504 size=135168 flags=40080c80

[151623.966462] sd 1:0:9:0: attempting task abort!scmd(0x00000000893097c2), outstanding for 31884 ms & timeout 30000 ms

[151623.966467] sd 1:0:9:0: [sdj] tag#6022 CDB: Read(16) 88 00 00 00 00 06 87 e7 a1 68 00 00 02 58 00 00

[151623.966470] scsi target1:0:9: handle(0x0013), sas_address(0x5000cca2b677f5e1), phy(10)

[151623.966476] scsi target1:0:9: enclosure logical id(0x50030480018a1b3f), slot(10)

[151623.966480] scsi target1:0:9: enclosure level(0x0001), connector name( )

[151623.970690] sd 1:0:9:0: task abort: SUCCESS scmd(0x00000000893097c2)

[151623.970705] sd 1:0:9:0: [sdj] tag#6022 FAILED Result: hostbyte=DID_TIME_OUT driverbyte=DRIVER_OK cmd_age=31s

[151623.970710] sd 1:0:9:0: [sdj] tag#6022 CDB: Read(16) 88 00 00 00 00 06 87 e7 a1 68 00 00 02 58 00 00

[151623.970712] blk_update_request: I/O error, dev sdj, sector 28049908072 op 0x0:(READ) flags 0x700 phys_seg 25 prio class 0

[151623.970807] zio pool=tank1079 vdev=/dev/sdj error=5 type=1 offset=14361552932864 size=307200 flags=40080c80

"

Shaker

Shaker

Shaker

Shaker

Таких собрано еще с десяток на подобном железе, от отличается конфигурация ( нет mirror ), и разная степень заполняемости. Проблема только с этим tank1079.

Есть идеи ?

Shaker

Shaker

Но пробовали в разных полках, проблема оставалась. Сомневаюсь, что питание.

Полки HPE 3PAR 8400 в основном. Но пробовали и в супермикро, проблема осталась.

ArtAnt

ArtAnt

Выбор между:

1) snapshot dataset-а и отправка его в zvol (вообще сработает такой подход?)

2) rsync внутри самой виртуалки предварительно подключив ей zvol (dataset отдается ей по NFS)

3) zfs-replicate (никогда не имел дело с этим)

Evgenii

Evgenii

Выбор между:

1) snapshot dataset-а и отправка его в zvol (вообще сработает такой подход?)

2) rsync внутри самой виртуалки предварительно подключив ей zvol (dataset отдается ей по NFS)

3) zfs-replicate (никогда не имел дело с этим)

1) так не бывает

2) Блочные устройства нельзя отдавать по NFS, только папки

3) репликация zfs это всегда отправка разницы между 2 снимками или отправка полного состояния до снимка

#test_gpt

ArtAnt

ArtAnt

1) так не бывает

2) Блочные устройства нельзя отдавать по NFS, только папки

3) репликация zfs это всегда отправка разницы между 2 снимками или отправка полного состояния до снимка

#test_gpt

1) тут я погорячился

2) кто, зачем и как отдавал блочные устройства по NFS?

3) ответ не релевантен для меня, сути вопроса он не раскрыл.

A1EF

A1EF

Думаю, тут только rsync или что-то подобное подойдёт. zvol - просто блочное устройство, там внутри что угодно может быть, своя файловая система.

Evgenii

Evgenii

1) тут я погорячился

2) кто, зачем и как отдавал блочные устройства по NFS?

3) ответ не релевантен для меня, сути вопроса он не раскрыл.

3 вопрос = 1 вопросу

Ответ должен был дать это понять

ArtAnt

ArtAnt

riv

riv

riv

riv

Какой может быть самый короткий путь переноса данных (пару десятков Tb) с Dataset в ZVOL?

zfs snapshot ...; zfs send | ... | zfs receive; zfs bookmark

В ручную или sanoid/syncoid или др способы автоматизации. Прочитайте руководство по zfs от oracle, оно на русском языке.

Autumn

Autumn

Какой может быть самый короткий путь переноса данных (пару десятков Tb) с Dataset в ZVOL?

Смотря где у вас физически "лежат" zvol и dataset и что понаделано внутри zvol. Если это разные узлы связанные по сети - то rsync, если все локально и знаете что внутри zvol, монтируете разделы и сливаете данные прямо в датасет.

ArtAnt

ArtAnt

Смотря где у вас физически "лежат" zvol и dataset и что понаделано внутри zvol. Если это разные узлы связанные по сети - то rsync, если все локально и знаете что внутри zvol, монтируете разделы и сливаете данные прямо в датасет.

Не понял, предлагаете вирткалке отдать zvol, далее в ней на базе этого блочного zvol создать zpool и его dataset, и перекинуть один датасет в другой? Тогда на виртуалке нужно будет поднимать и держать свою zfs, что с точки зрения ресурсов - расточительно.

Autumn

Autumn

Не понял, предлагаете вирткалке отдать zvol, далее в ней на базе этого блочного zvol создать zpool и его dataset, и перекинуть один датасет в другой? Тогда на виртуалке нужно будет поднимать и держать свою zfs, что с точки зрения ресурсов - расточительно.

нет, я хз где там у вас ваши zvol и для чего, но если сделаете:

# ls -l /dev/zvol/...

увидите куда этот zvol линкуется, обычно /dev/zdX

если сделаете

# fdisk -l /dev/zdX

увидите разделы, типа /dev/zd0p1

вот его монтируете куда-нить типа /mnt/temp

и потом забираете все что вам надо

Vladislav

Vladislav

Один совет прекрасней другого....

Для копирования файлов между zfs и zvol у Вас только один способ - rsync/cp/любая другая утилита копирования файлов

Autumn

Autumn

Вот пример с моего проксмокса, диск от виртуалки с бубунтой:

# ls -l /dev/zvol/rpool/data/vm-100-disk-0

lrwxrwxrwx 1 root root 12 Oct 1 17:25 /dev/zvol/rpool/data/vm-100-disk-0 -> ../../../zd0

# fdisk -l /dev/zd0

Disk /dev/zd0: 32 GiB, 34359738368 bytes, 67108864 sectors

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 8192 bytes

I/O size (minimum/optimal): 8192 bytes / 8192 bytes

Disklabel type: gpt

Disk identifier: 5CB85159-B66A-475F-96F6-2833BD43EB88

Device Start End Sectors Size Type

/dev/zd0p1 2048 4095 2048 1M BIOS boot

/dev/zd0p2 4096 67106815 67102720 32G Linux filesystem

# ls /mnt/temp/

# mount /dev/zd0p2 /mnt/temp/

# ls /mnt/temp/

bin boot dev etc home lib lib32 lib64 libx32 lost+found media mnt opt proc root run sbin snap srv swap.img sys tmp usr var

ArtAnt

ArtAnt

нет, я хз где там у вас ваши zvol и для чего, но если сделаете:

# ls -l /dev/zvol/...

увидите куда этот zvol линкуется, обычно /dev/zdX

если сделаете

# fdisk -l /dev/zdX

увидите разделы, типа /dev/zd0p1

вот его монтируете куда-нить типа /mnt/temp

и потом забираете все что вам надо

Опять не понял, куда забираю, мне в другую сторону надо с dataset в zvol и желательно средствами zfs (send|recv) остальное, как монтировать для rsync не принципиально либо на хосте (как вы описали) либо в виртуалке, существенно быстрее это не будет если копировать через rsync.

Autumn

Autumn

ArtAnt

ArtAnt

Один совет прекрасней другого....

Для копирования файлов между zfs и zvol у Вас только один способ - rsync/cp/любая другая утилита копирования файлов

Народ по ходу не читает мой вопрос...

ArtAnt

ArtAnt

Вот пример с моего проксмокса, диск от виртуалки с бубунтой:

# ls -l /dev/zvol/rpool/data/vm-100-disk-0

lrwxrwxrwx 1 root root 12 Oct 1 17:25 /dev/zvol/rpool/data/vm-100-disk-0 -> ../../../zd0

# fdisk -l /dev/zd0

Disk /dev/zd0: 32 GiB, 34359738368 bytes, 67108864 sectors

Units: sectors of 1 * 512 = 512 bytes

Sector size (logical/physical): 512 bytes / 8192 bytes

I/O size (minimum/optimal): 8192 bytes / 8192 bytes

Disklabel type: gpt

Disk identifier: 5CB85159-B66A-475F-96F6-2833BD43EB88

Device Start End Sectors Size Type

/dev/zd0p1 2048 4095 2048 1M BIOS boot

/dev/zd0p2 4096 67106815 67102720 32G Linux filesystem

# ls /mnt/temp/

# mount /dev/zd0p2 /mnt/temp/

# ls /mnt/temp/

bin boot dev etc home lib lib32 lib64 libx32 lost+found media mnt opt proc root run sbin snap srv swap.img sys tmp usr var

Ну и как вы в ваш смонтированный /dev/zd0p2 4096 67106815 67102720 32G Linux filesystem отправите dataset средствами zfs, никак, у вас файловая система не ZFS, значит остается только rsync и ему подобное, по файликам ))

Autumn

Autumn

Ну и как вы в ваш смонтированный /dev/zd0p2 4096 67106815 67102720 32G Linux filesystem отправите dataset средствами zfs, никак, у вас файловая система не ZFS, значит остается только rsync и ему подобное, по файликам ))

Издеваетесь? Вы спросили "Какой может быть самый короткий путь переноса данных (пару десятков Tb) с Dataset в ZVOL?" Вам надо перенести данные. Я вам дал два рабочих способа. Что Вам еще надо?

ArtAnt

ArtAnt

Издеваетесь? Вы спросили "Какой может быть самый короткий путь переноса данных (пару десятков Tb) с Dataset в ZVOL?" Вам надо перенести данные. Я вам дал два рабочих способа. Что Вам еще надо?

Нет вы не дали к сожалению рабочий способ. Передать средствами zfs имеющийся dataset в смонтированный zvol, у которого на разделе не zfs, а ext4, xfs итд, нельзя.

Vladislav

Vladislav

Смотря где у вас физически "лежат" zvol и dataset и что понаделано внутри zvol. Если это разные узлы связанные по сети - то rsync, если все локально и знаете что внутри zvol, монтируете разделы и сливаете данные прямо в датасет.

Честно говоря я не понял разницу в этих способах

В обоих случаях используется rsync для передачи

Autumn

Autumn

ArtAnt

ArtAnt

Vladislav

Vladislav

В одном случае Вы это делаете между zvol? в другом между zvol и датасетом, но вопрос был про

Dataset --> zvol

Vladislav

Vladislav

Выбор между:

1) snapshot dataset-а и отправка его в zvol (вообще сработает такой подход?)

2) rsync внутри самой виртуалки предварительно подключив ей zvol (dataset отдается ей по NFS)

3) zfs-replicate (никогда не имел дело с этим)

Берете сервер где сторадж zfs, создаёте там zvol, монтируете zvol, форматируете его нужным образом, перетаскиваете нужные данные, unmount, подключает по iscsi его к ВМ, монтируете диск

Autumn

Autumn

Честно говоря я не понял разницу в этих способах

В обоих случаях используется rsync для передачи

я же уточнял, где находится датасет и zvol, если на одной машине то зачем rsync? просто cp -R /путь_к_датасету/файло_нужное_перенести /путь_к_примонтированному_разделу_изнутри_zvol/куда_положить_нужное_файло, хотя можно и рсинком локально сделать

ArtAnt

ArtAnt

Делать это через ВМ по nfs накладочно по скорости

По SSH передаю, так или иначе это разные гипервизоры и работать через сеть, и еще, сделал два потока rsync, там данные по годам, каждый год в своей папке, одновременно запустил два разных rsync по двум разным папкам, больше смысла нет, скорость падает из-за механических дисков.

Autumn

Autumn

просто монтировал из zvol нужный раздел виртуалки прямо на хосте куда-нить, потом копировал нужное файло на него, размонтировал, запускал виртуалку

Andrey

Andrey

Aleks

Aleks