А сколько дисков в пуле? Тесты производительности против raidz делали? Что за модель хетцнер выдает, а то у них на аукционе только enterprise написано?

точнее либо зеркало, либо 10

— SAMSUNG MZQL23T8HCLS-00A07

— KIOXIA KCD71RUG3T84

Как повезет, диски зависят от типа сервера. В самые дешевые скорее всего ставят другие, другого размера.

Autumn

Autumn

точнее либо зеркало, либо 10

— SAMSUNG MZQL23T8HCLS-00A07

— KIOXIA KCD71RUG3T84

Как повезет, диски зависят от типа сервера. В самые дешевые скорее всего ставят другие, другого размера.

А сколько дисков в 10-м? Я смотрю хетцнер на их топ делл-ы всего 4 нвме по 7.5ТБ выдает. Мне жалко отдать 2х7ТБ в 10-ку, я в таком случае планирую raidz1 на 4 диска.

Evgenii

Evgenii

А сколько дисков в 10-м? Я смотрю хетцнер на их топ делл-ы всего 4 нвме по 7.5ТБ выдает. Мне жалко отдать 2х7ТБ в 10-ку, я в таком случае планирую raidz1 на 4 диска.

у нас до 4х из-за особенностей шасси, это дефолт там. Но AX161 до 8 вмещает.

— Raid-Z скушает много IOPS, имейте ввиду,

— могут быть серьезные проблемы с перерасходом места при размерах кластера zvol 8-16 кб и 4 дисках. Я толком так и не понял как считать паддинги и прочие штуки, щас пришлю таблицу)

Autumn

Autumn

у нас до 4х из-за особенностей шасси, это дефолт там. Но AX161 до 8 вмещает.

— Raid-Z скушает много IOPS, имейте ввиду,

— могут быть серьезные проблемы с перерасходом места при размерах кластера zvol 8-16 кб и 4 дисках. Я толком так и не понял как считать паддинги и прочие штуки, щас пришлю таблицу)

Вот как раз тесты интересны, сколько же оно скушает. Тесты на сата/сас ссд показали что разница не стоит потеряных 3-7 ТБ.

Autumn

Autumn

Я таблицы видел, открыты у меня, я сейчас активно сам тесты гоняю, но пока нет в доступе системы с нвме.

Алексей

Алексей

Я таблицы видел, открыты у меня, я сейчас активно сам тесты гоняю, но пока нет в доступе системы с нвме.

Если что в хетцнере можно взять в тест драйв любой сервер на две недели бесплатно и сдать его без обьяснения причин. Много раз так уже делал

Autumn

Autumn

Если что в хетцнере можно взять в тест драйв любой сервер на две недели бесплатно и сдать его без обьяснения причин. Много раз так уже делал

О как. А как это сделать? Я только аукцион вижу.

Алексей

Алексей

О как. А как это сделать? Я только аукцион вижу.

Надо брать сервер просто как обычно. У них политика отмены прописана, если в 14 дней уложишься с отменой - денег не возьмут. Но тут еще надо успеть непопасть в инвойс и я брал некастомизированные без сетаппрайса

Autumn

Autumn

у нас до 4х из-за особенностей шасси, это дефолт там. Но AX161 до 8 вмещает.

— Raid-Z скушает много IOPS, имейте ввиду,

— могут быть серьезные проблемы с перерасходом места при размерах кластера zvol 8-16 кб и 4 дисках. Я толком так и не понял как считать паддинги и прочие штуки, щас пришлю таблицу)

Могу ошибаться но таблицы по моему не Меликов делал, а какой-то другой разраб zfs. Фамилию не помню, у него была отличная серия статей которые сейчас только в archive найти можно. Но на его статьях есть неплохие статьи у кларасистемс. Вот например - https://klarasystems.com/articles/choosing-the-right-zfs-pool-layout/

Fedor

Fedor

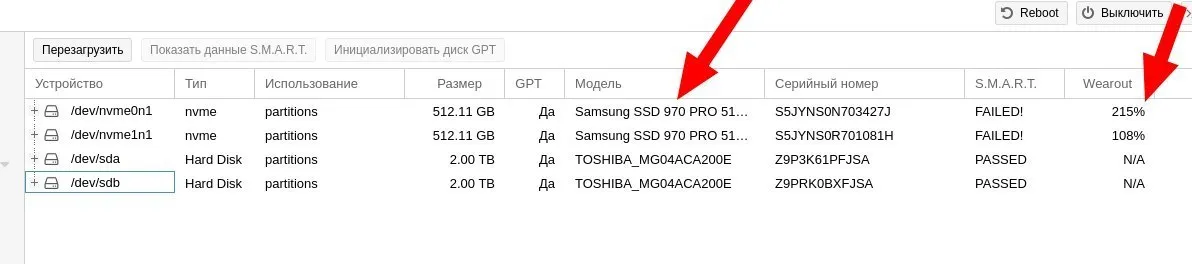

Ну я когда работал с хетцнером лет 5-6 назад они иногда вытворяли типа диски с износом 99% в серваках продавали. Приходилось с сапортом "взаимодействовать" по замене. Но как меня коллеги заверили, сейчас все стало лучше. Я как раз планирую из другого ЦОДа в хетцнер пару клиентов мувнуть ибо ниже хетцнера цены на дедики по рынку не вижу.

они ещё могут самсунги ставить, где износ 120% показывает

Владимир

Владимир

Владимир

Владимир

они ещё могут самсунги ставить, где износ 120% показывает

так что 120% это ещё далеко не всё у самсунгов))

Autumn

Autumn

так что 120% это ещё далеко не всё у самсунгов))

3dnews в бородатые времена лет 5 назад взялся тестировать ссдшки всех цветов на ресурс перезаписи. Там в топе были самсунги evo/pro с ресурсом перезаписи 3000-4000%, 250 гиговые с ресурсом в 150ТБ смогди всосать 5000-7000ТБ до появления проблем с записью. Но все равно не очень хочется на таких ссдшах жить.

Владимир

Владимир

Станислав

Станислав

Autumn

Autumn

Кстати жаль что прекратили. Сейчас ссдшки отнюдь не "качественнее". Если раньше можно было взять бюджеточку и понимать что в ней контроллер потускнее, да буфера поменьше и все, но в общем она стронг, то сейчас такое чувтсво что они все что не топ, паяют по принципу "засунул руку в ящик, какие чипы и контроллер схватил то и впаял". Видел одну и туже модель ссд на разных контроллерах и чипах, с разными итоговыми характеристиками. Я на таких не то что зфс, я на них ext4 для десктопа не буду делать, пусть дальше в куче хлама валяются.

Autumn

Autumn

Помню мой первый прокс 3.х на флеш сторадже я собирал на десктопных kingstone v300 в далеком 2014-м. Так сервер до сих пор работает и эти ссд там под зфс до сих пор живут. Что бы я сейчас бюджетку кингстон в сервер поставил? Чур меня.

Хач

Хач

Позавчера на акционе взял дедик - 2x480gb datacenter ssd, 2x960gb datacenter ssd , диски микрон, wearout 0-1%

Nikita

Nikita

Artem

Artem

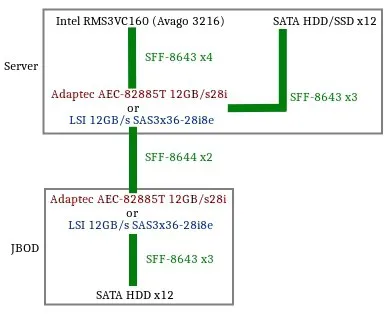

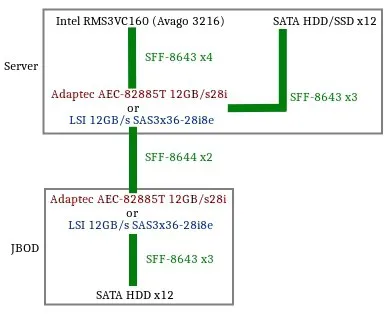

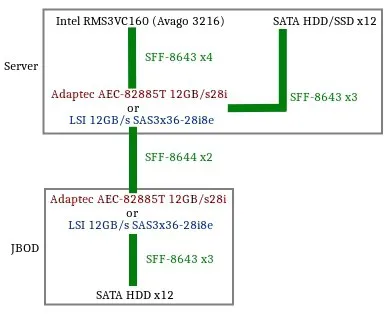

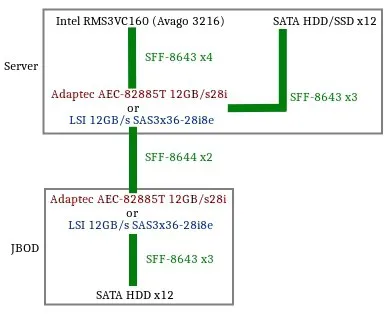

1. Сата будет работать

2. Как по мне - то lsi

3. Вроде ничего не мешает работать

4. Есть экспандеры, которые вообще не от pci питание берут. А так - экспандеру от pci только питание нужно, как его бюджетно сколхозить - вариантов масса

Nikita

Nikita

1. Сата будет работать

2. Как по мне - то lsi

3. Вроде ничего не мешает работать

4. Есть экспандеры, которые вообще не от pci питание берут. А так - экспандеру от pci только питание нужно, как его бюджетно сколхозить - вариантов масса

2. разница в 3 раза... были инциденты?

4. с питанием экспандера и дисков понятно. для меня пока загадкой остаётся - как в отсутствии материнки включать/выключать БП на полке... т.е. как это всё сколхозить я примерно представляю, но здравый смысл подсказывает, что должно быть "заводское" решение.

Илья

Илья

Nikita

Nikita

Поковырялся немного в документации. Прямым текстом этого не говорится, но пока я делаю такой вывод, что раз power board подключен к экспандеру по протоколу SES и отправляет ему информацию о всяких ошибках (типа сбоев в работе вентилятора), то по этому же протоколу полка может включаться и выключаться по сигналу с контроллера. Вот только где это настраивается? Или raid(hba) контроллер при включении по умолчанию команду на включение всем по SES рассылает?

Vladislav

Vladislav

Nikita

Nikita

Nikita

Nikita

А если серьёзно, все сервера intel, хочется некоего единообразия) Ну и требования к полке - 3.5 диски и 2U. Предложения, конечно, есть, но всё каких то сторонних производителей. И если с полкой Intel я был бы более-менее уверен, что всё заработает, то тут нужно понимать как оно всё работает внутри, чтобы решить вопрос совместимости одного производителя с другим)

Vladislav

Vladislav

Но ведь сервер Intel даже не знает про полку Intel....

External Raid Controller знает. Но сервер видит только логический лун, который выдаёт ему контроллер

Nikita

Nikita

Но ведь сервер Intel даже не знает про полку Intel....

External Raid Controller знает. Но сервер видит только логический лун, который выдаёт ему контроллер

но как то же она должна автоматом включаться-выключаться? не верю, что на этот вопрос положили.

Vladislav

Vladislav

но как то же она должна автоматом включаться-выключаться? не верю, что на этот вопрос положили.

Полка работает при подаче питания, если это тупая полка, rак большой HotPlug

А если вендорская, то с подачей ряда команд с контроллера СХД

Vladislav

Vladislav

т.е. выключается она не с сервером, а с ИБП?

Диски выключатся с сервером, потому что команда SpinDown, но полка будет также работать

Nikita

Nikita

Диски выключатся с сервером, потому что команда SpinDown, но полка будет также работать

ага, вот какое-то такое просветление я и ожидал)

Vladislav

Vladislav

То есть если Вы вырубите сервер, дернёте полку по питанию (вытащил\воткнул) - она раскрутит диски, и они будут крутится, пока сами в spindown не уйдут

Nikita

Nikita

Более умные полки имеют контроллеры, которые сами решают такие вещи

предполагаю, что это точно не мой вариант)

Vladislav

Vladislav

Autumn

Autumn

Autumn

Autumn

2. разница в 3 раза... были инциденты?

4. с питанием экспандера и дисков понятно. для меня пока загадкой остаётся - как в отсутствии материнки включать/выключать БП на полке... т.е. как это всё сколхозить я примерно представляю, но здравый смысл подсказывает, что должно быть "заводское" решение.

А зачем ее выключать? Но если уж сильно надо, то в супермикре есть IPMI или можно взять управляемый APC rack PDU которые умеют вырубать нагрузку, но тогда общая стоимость решения круто вырастает.

Autumn

Autumn

А если серьёзно, все сервера intel, хочется некоего единообразия) Ну и требования к полке - 3.5 диски и 2U. Предложения, конечно, есть, но всё каких то сторонних производителей. И если с полкой Intel я был бы более-менее уверен, что всё заработает, то тут нужно понимать как оно всё работает внутри, чтобы решить вопрос совместимости одного производителя с другим)

Какая-то ерунда. А зачем серверу интел знать кто ему кучу дисков отдает? Тот же сас хба тупо отдаст диски да и все, а что там внутри самой полки, это дело полки а не сервера.

Autumn

Autumn

Nikita

Nikita

Nikita

Nikita

Autumn

Autumn

тут я скорее про салазки и БП...

какие такие салзаки =), там про другое, про потроха полки, а какая разница серверу какие в полке потроха, бэкплейн облуживает диски и если их два резервирует, все, затем через хба отдает диски серверу, сервер видит что "в него воткнуто столько то дисков", считает их своими родненькими - делай с ними что хочешь

Autumn

Autumn

начинаю понимать, что, видимо, незачем...

не ну одна причина есть - экономия электричества, но тогда что мы тут обсуждаем =)

Nikita

Nikita

какие такие салзаки =), там про другое, про потроха полки, а какая разница серверу какие в полке потроха, бэкплейн облуживает диски и если их два резервирует, все, затем через хба отдает диски серверу, сервер видит что "в него воткнуто столько то дисков", считает их своими родненькими - делай с ними что хочешь

Теперь понятно. А есть какой-нибудь исходник, типа rfc для SAS3? А то все статьи, которые находил, какой-нибудь нюанс, да пропустят...

Autumn

Autumn

вообще концепция полки - дать серверу кучу дисков которые в него не влезут из-за законов физики (вибрация, нагрев, вес, питание ...), при этом т.к. дисков куча, надо обеспечить их удобную и быструю горячую замену что бы не трогать вычислительный узел, а так же (если речь про sas) обеспечить резервирование бэкплейна на услучай отвала его/линка/хба ... все это внутри обычного сервера сделать сложно ибо там уже набито своего добра

Autumn

Autumn

Теперь понятно. А есть какой-нибудь исходник, типа rfc для SAS3? А то все статьи, которые находил, какой-нибудь нюанс, да пропустят...

эээм зачем? это всего лишь протокол, вы же не разбираете подробно как там тот же sata работает, вам технически лишь нужна спецификция, что бы понимать что вы получите в итоге

Vladislav

Vladislav

Теперь понятно. А есть какой-нибудь исходник, типа rfc для SAS3? А то все статьи, которые находил, какой-нибудь нюанс, да пропустят...

Вам не rfc на сас3 нужен, а подробная дока на полку

Autumn

Autumn

Теперь понятно. А есть какой-нибудь исходник, типа rfc для SAS3? А то все статьи, которые находил, какой-нибудь нюанс, да пропустят...

если сильно надо - ищите ISO/IEC 14776-154:2017

Nikita

Nikita

эээм зачем? это всего лишь протокол, вы же не разбираете подробно как там тот же sata работает, вам технически лишь нужна спецификция, что бы понимать что вы получите в итоге

sata проще, один порт - один диск. И никакой дополнительной информации кроме чтения/записи данных и состояния непосредственно диска.

Nikita

Nikita

У меня в новых областях подход такой -

1. разобраться насколько это возможно в силу моих способностей и сложности предмета,

2. спроектировать на уровне детальной концепции чего бы хотелось,

3. сопоставить стоимость получившегося решения с имеющимися в лёгком доступе и прикинуть, нужно ли оно такой ценой.

Просто, чтобы искать ту же полку, нужно понимать ключевые параметры того, что нужно и что есть, явные и не очень. Вы их знаете, а я пока еще разбираюсь)

Nikita

Nikita

З.Ы, Когда тут писали про 2 бэкплейна, наверное всё же имели в виду 2 экспандера? Бэкплейн - это ж то, куда диски втыкаются, у sas дисков вроде всё еще один разъём или я чего то не знаю?

Autumn

Autumn

Autumn

Autumn

З.Ы, Когда тут писали про 2 бэкплейна, наверное всё же имели в виду 2 экспандера? Бэкплейн - это ж то, куда диски втыкаются, у sas дисков вроде всё еще один разъём или я чего то не знаю?

ну да, точнее Dual Path Expander Backplanes, но мне влом столько букав писать

Autumn

Autumn

У меня в новых областях подход такой -

1. разобраться насколько это возможно в силу моих способностей и сложности предмета,

2. спроектировать на уровне детальной концепции чего бы хотелось,

3. сопоставить стоимость получившегося решения с имеющимися в лёгком доступе и прикинуть, нужно ли оно такой ценой.

Просто, чтобы искать ту же полку, нужно понимать ключевые параметры того, что нужно и что есть, явные и не очень. Вы их знаете, а я пока еще разбираюсь)

нет там ничего особенного в поисках полки, просто берем и учитываем:

1. всегда SAS3 чтобы получит 12 гиг скорости

2. нужное кол-во дисков, с учетом лимита на ссд/хдд (в некоторые можно вставить только ограниченное кол-во ссд, например в hgst 4u60 только 12 ссд, остальные 48 хдд)

3. умеет ли сата/сас (например зфс пофигу, а вот майкрософтовский сторадж спейсес работал только с sas dual path)

4. нужен ли сас дуал паз для отказоустойчивости линков и бэкплейн-экспандеров от сервера к стораджку

5. смотрим список поддерживаемых адаптеров хба (обычно LSI годятся)

6. смотрим список поддерживаемых ссд/хдд (обычно микроны/самсунги годятся)

7. смотрим вес в сборе и габариты (что бы эта дура влезла в стойку и там стойку дешевую не погнула или не превысила суммарный вес оборудования на всю стойку)

вроде все, может что забыл а дальше выбираем что доступно по рынку и цене

Vladislav

Vladislav

Autumn

Autumn

Просто для справки Sas3 не даст вам 12Г без MPIO*

дополню, а MPIO мы получим на sas dual path =) так что надо барать сас с бэкпленами на два экспандера, поэтому выше написал что сата это не про проще а про дешевле

Vladislav

Vladislav

дополню, а MPIO мы получим на sas dual path =) так что надо барать сас с бэкпленами на два экспандера, поэтому выше написал что сата это не про проще а про дешевле

Я скорее про настройку со стороны ОС, которая тоже должна понимать, что у неё два пути и она может работать по обоим

Autumn

Autumn

Я скорее про настройку со стороны ОС, которая тоже должна понимать, что у неё два пути и она может работать по обоим

ну так мультипас и в бой, у меня так строаджи настроены, тоже полки сас два путя, мультипасом собираю и через /dev/mapper/[SSD,HDD] пользуюс под зфс

Autumn

Autumn

Потому что часто бывает active/passive в дефолтной настройке и мы возвращаемся к 6Г

хз, что hgst что supermicto sas3 все в мультипасе актив\актив, уже не помню когда видел актив\пасив

Georg🎞️🎥

Georg🎞️🎥

ну так мультипас и в бой, у меня так строаджи настроены, тоже полки сас два путя, мультипасом собираю и через /dev/mapper/[SSD,HDD] пользуюс под зфс

А сколько дисков висит , что нужен мультипас ? И вы его делаете двумя hba ?👋спасибо

Autumn

Autumn

А сколько дисков висит , что нужен мультипас ? И вы его делаете двумя hba ?👋спасибо

Да, от двух до 6 хба. Где как. Дисков по разному, но максимум 60 в полке.

Georg🎞️🎥

Georg🎞️🎥

Да, от двух до 6 хба. Где как. Дисков по разному, но максимум 60 в полке.

У меня на 15 дисковую полку - одна «дырка» hba внешняя 6gb

Думаю, мульти мне ничего не ускорит ((

Autumn

Autumn

У меня на 15 дисковую полку - одна «дырка» hba внешняя 6gb

Думаю, мульти мне ничего не ускорит ((

Я делал не только для ускорения, прежде всего мне надо была избыточность. Но 12г завсегда приятнее 6г. Ну и иногда я одну полку раздаю на несколько серверов, например 2 железки, полку делю на зоны и каждой железке по изолированной зоне. Так например бью 60 дисков на 2х30. Вот по два хба с каждого сервера к полке и мультипас что бы вдруг не отвалилось.

Autumn

Autumn

Я когда начинал работать с зфс, у меня первая полка была sas2 на одной хба и был кейс, уже не помню из-за чего, но хба отвалилася и в разгар рабочего дня сервера потеряли сторадж. После этого я в сервер две хба ставлю если финансы позволяют.

Georg🎞️🎥

Georg🎞️🎥

Я когда начинал работать с зфс, у меня первая полка была sas2 на одной хба и был кейс, уже не помню из-за чего, но хба отвалилася и в разгар рабочего дня сервера потеряли сторадж. После этого я в сервер две хба ставлю если финансы позволяют.

12g hdd при случайном доступе в жизни не выжмут )) как и 6 думаю ((