А можно создать датасет и хранить там zvol) датасет это скорее для понимания как "папка" если просто сказать. Но в реальности конечно это совсем не так

"Папка", исторически, графическое 📂 обозначение. Так что вы просто другими словами сказали тоже самое

Nick

Nick

Наблюдаю странно большой SUnreclaim (grep SU /proc/meminfo)

zfs, каталог на 5 миллионов файлов - например сессии пхп, ls -1 | wc -l приводит к SUnreclaim на ~20 гигабайт.

ядро последнее 5.15, с zfs 2.1.9 чуть получше, чем с 2.1.5.

Если засунуть тест в lxd и рестартовать потом целиком контейнер - SUnreclaim откатывается до 2-4 гигабайт.

Если не использовать zfs, то SUnreclaim с той же нагрузкой не превышает примерно 1% от количества памяти.

в иссьюсах нашел только https://github.com/openzfs/zfs/issues/3679

Что можно с этим сделать?

central

central

Konstantin

Konstantin

Добрый день.

Никто случайно не пробовал что это за штука? Linux container support (#14070, #14097, #12263) из https://github.com/openzfs/zfs/releases/tag/zfs-2.2.0-rc1

Я правильно понимаю, что управление zfs/zpool будет доступно из lxc/lxd контейнера?

Nick

Nick

> Я правильно понимаю, что управление zfs/zpool будет доступно из lxc/lxd контейнера?

Да. Но надо подождать следущих версий LXD

Но там рядом есть иссью про как играться недожидаясь, из минусов - миграции/бекапы не будут работать и что-то еще.

Nick

Nick

самое главное для чего это нужно - сделать рекордсайз 1М на корень и 16к на мускль, ну и со сжатием для разных каталогов поиграться

Станислав

Станислав

самое главное для чего это нужно - сделать рекордсайз 1М на корень и 16к на мускль, ну и со сжатием для разных каталогов поиграться

Я для этого сам создал датасет и примаунтил его в lxd ( lxc config device add... ), в итоге удобно реплицировать к тому же, не только рекордсайзы менять и сжатие.

Но очень интересно. Может много головняка с правами доступа решит это обновление, так как ремапить большое количество файлов для копии контейнера занимает иногда много времени

Nick

Nick

Наблюдаю странно большой SUnreclaim (grep SU /proc/meminfo)

zfs, каталог на 5 миллионов файлов - например сессии пхп, ls -1 | wc -l приводит к SUnreclaim на ~20 гигабайт.

ядро последнее 5.15, с zfs 2.1.9 чуть получше, чем с 2.1.5.

Если засунуть тест в lxd и рестартовать потом целиком контейнер - SUnreclaim откатывается до 2-4 гигабайт.

Если не использовать zfs, то SUnreclaim с той же нагрузкой не превышает примерно 1% от количества памяти.

в иссьюсах нашел только https://github.com/openzfs/zfs/issues/3679

Что можно с этим сделать?

кстати, SUnreclaim при этом значительно меньше, чем ARC used, т.е. это вряд ли ARC.

Shaker

Shaker

Ну и если их класть в разные каталоги ситуация не меняется

У нас та-же история в zfs, уже смирились. Не нашли как решать, просто перестали делать там ls -1 ;)

George

George

Nick

Nick

мб /proc/slabinfo что подсветит интересное?

пока ничего не подсвечивает. На что именно там посмотреть?

George

George

пока ничего не подсвечивает. На что именно там посмотреть?

До/после, что поменялось, имел в виду

Nick

Nick

я slabtop смотрел, ничего принципиально не поменялось, просто по счётчикам чего-то чуть меньше становится с перходом на 2.1.9

Nick

Nick

реально ситуацию улучшает перестать делать ls кучи файлов (суть, вероятно, stat, потому что для пхп это отключение gc сессий)

George

George

я slabtop смотрел, ничего принципиально не поменялось, просто по счётчикам чего-то чуть меньше становится с перходом на 2.1.9

я скорее предлагал посмотреть какой slab растёт при ls, а не разницу между версиями

Arseniy

Arseniy

Есть dataset1, который использовался как файловое хранилище.

Затем он был отключен, последний его снапшот был развернут в dataset1-auto-date и уже он стал использоваться в качестве хранилища.

В настоящий момент,

dataset1 = 600GiB

dataset1-auto-date=10GiB

Вполне понятно, что развернутый из снапшота весит мало, т.к. его размер обуславливает новые и измененные файлы, относительно dataset1.

Внимание вопрос: если я делаю копирование директорий с файлами из dataset1-auto-date в абсолютно новый датасет, а затем удаляю dataset1, директории и файлы останутся? Он же по идее при копировании из развернутого снапшота будет обращаться к dataset1, с которого снап был снят, верно?

Станислав

Станислав

Есть dataset1, который использовался как файловое хранилище.

Затем он был отключен, последний его снапшот был развернут в dataset1-auto-date и уже он стал использоваться в качестве хранилища.

В настоящий момент,

dataset1 = 600GiB

dataset1-auto-date=10GiB

Вполне понятно, что развернутый из снапшота весит мало, т.к. его размер обуславливает новые и измененные файлы, относительно dataset1.

Внимание вопрос: если я делаю копирование директорий с файлами из dataset1-auto-date в абсолютно новый датасет, а затем удаляю dataset1, директории и файлы останутся? Он же по идее при копировании из развернутого снапшота будет обращаться к dataset1, с которого снап был снят, верно?

Верно. Зачем копировать в новый датасет файлы? Можно zfs send/recv использовать

Arseniy

Arseniy

Верно. Зачем копировать в новый датасет файлы? Можно zfs send/recv использовать

Мне надо не весь датасет, а только 6 директорий из 15

Сергей

Сергей

Возник нубский вопрос на тему датасетов:

при перемещении файлов между датасетами файлы физически "перемещаются", а не просто редактируются метаданные, вроде логично, но так происходит даже если датасеты имеют одинаковые свойства унаследованные от корневого датасета - так всё равно должно быть? Без физического "перемещения" невозможно?

p.s. кавычки потому-что понимаю что там копирование происходит.

Vladislav

Vladislav

Господа, а расширение д-рейда ещё не запилили?

Расширение какого угодно рейда кроме 0-ого не запилили

Vladislav

Vladislav

Я думаю там нужно сначала дефрагментацию и ребалансировку запилить ))

Ребалансировка это в целом должна быть часть любого расширения, но нет, её не будет

Вру будет

https://openzfs.org/w/images/6/68/RAIDZ_Expansion_v2.pdf

The

The

Ситуация, условно, такова, что из-за бага контроллера "моргнул" LUN, и zfs из-за IO errors перевёл его в suspended. При этом сам LUN продолжает работать.

Shaker

Shaker

Ситуация, условно, такова, что из-за бага контроллера "моргнул" LUN, и zfs из-за IO errors перевёл его в suspended. При этом сам LUN продолжает работать.

Мы обычно ребут делаем , и если в целом повезло, потом все стартует без проблем.

Vladislav

Vladislav

Добрый день, чат. Подскажите, как в 2023 дела с unsuspending a pool? Всё так же ребутать ОС?

https://superuser.com/questions/685882/zpool-pool-i-o-is-currently-suspended

George

George

Добрый день, чат. Подскажите, как в 2023 дела с unsuspending a pool? Всё так же ребутать ОС?

pr всё висит) https://github.com/openzfs/zfs/pull/11082

The

The

https://superuser.com/questions/685882/zpool-pool-i-o-is-currently-suspended

Спасибо. Уже пробовал. Но всё тщетно.

The

The

pr всё висит) https://github.com/openzfs/zfs/pull/11082

3 года, норм. "Бумажка должна отлежаться!"

Vladislav

Vladislav

3 года, норм. "Бумажка должна отлежаться!"

Одно дело зарелизить функцию, другое дело поддерживать её в рабочем состоянии

The

The

Одно дело зарелизить функцию, другое дело поддерживать её в рабочем состоянии

Это ж опенсорс, там такого не требуется.

Николай Орлов

Николай Орлов

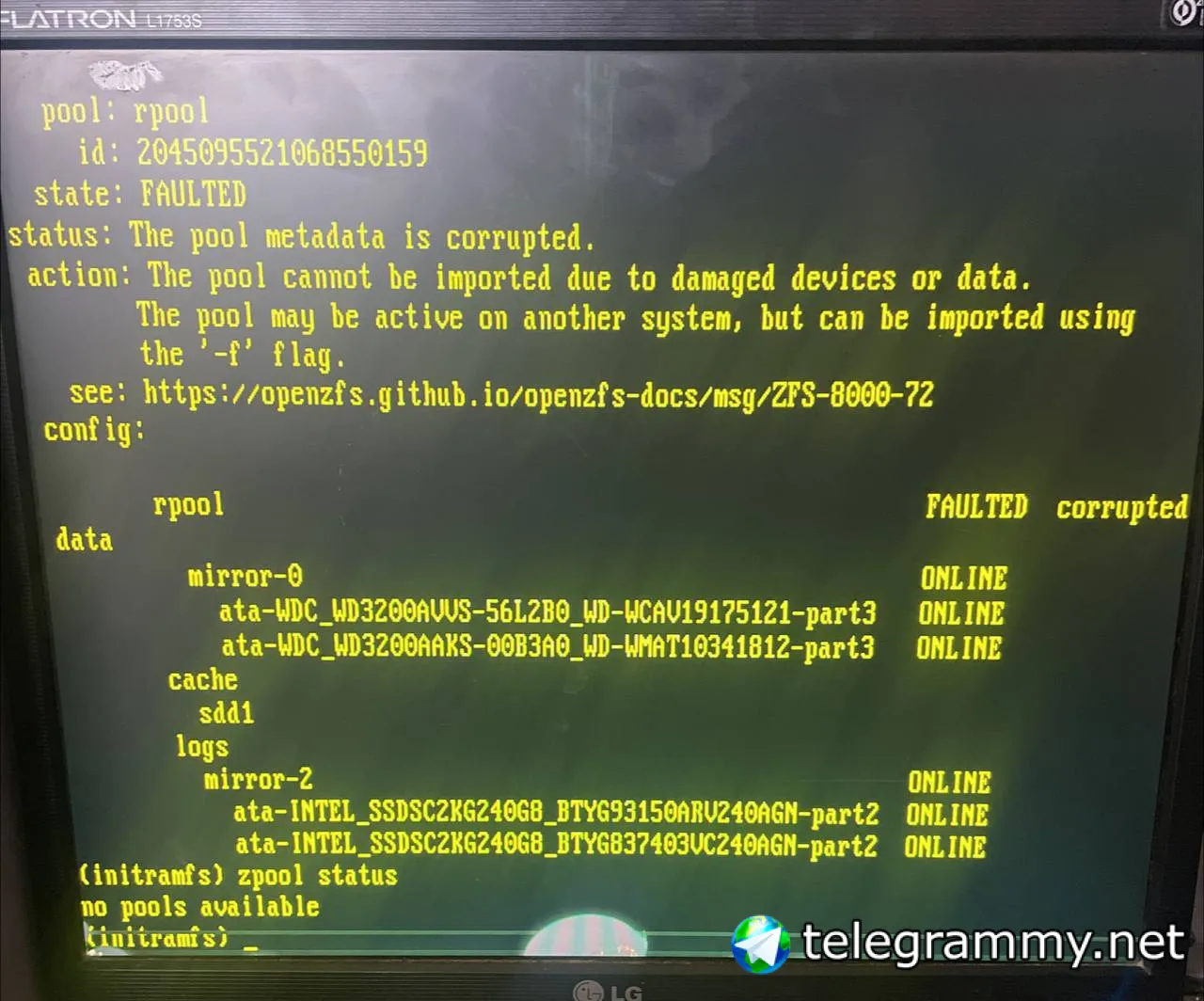

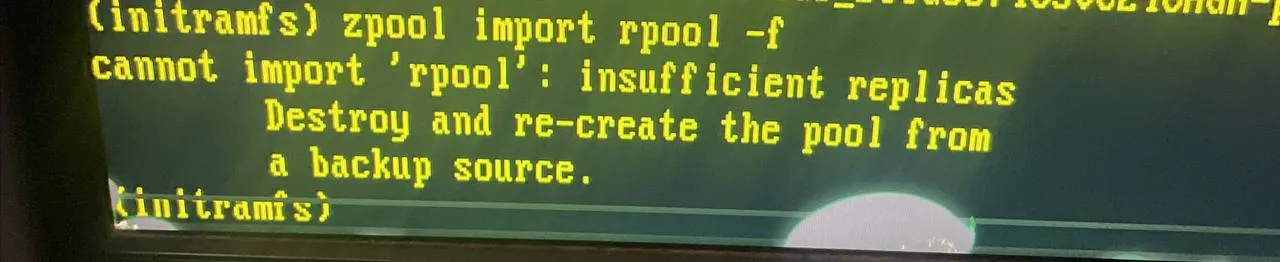

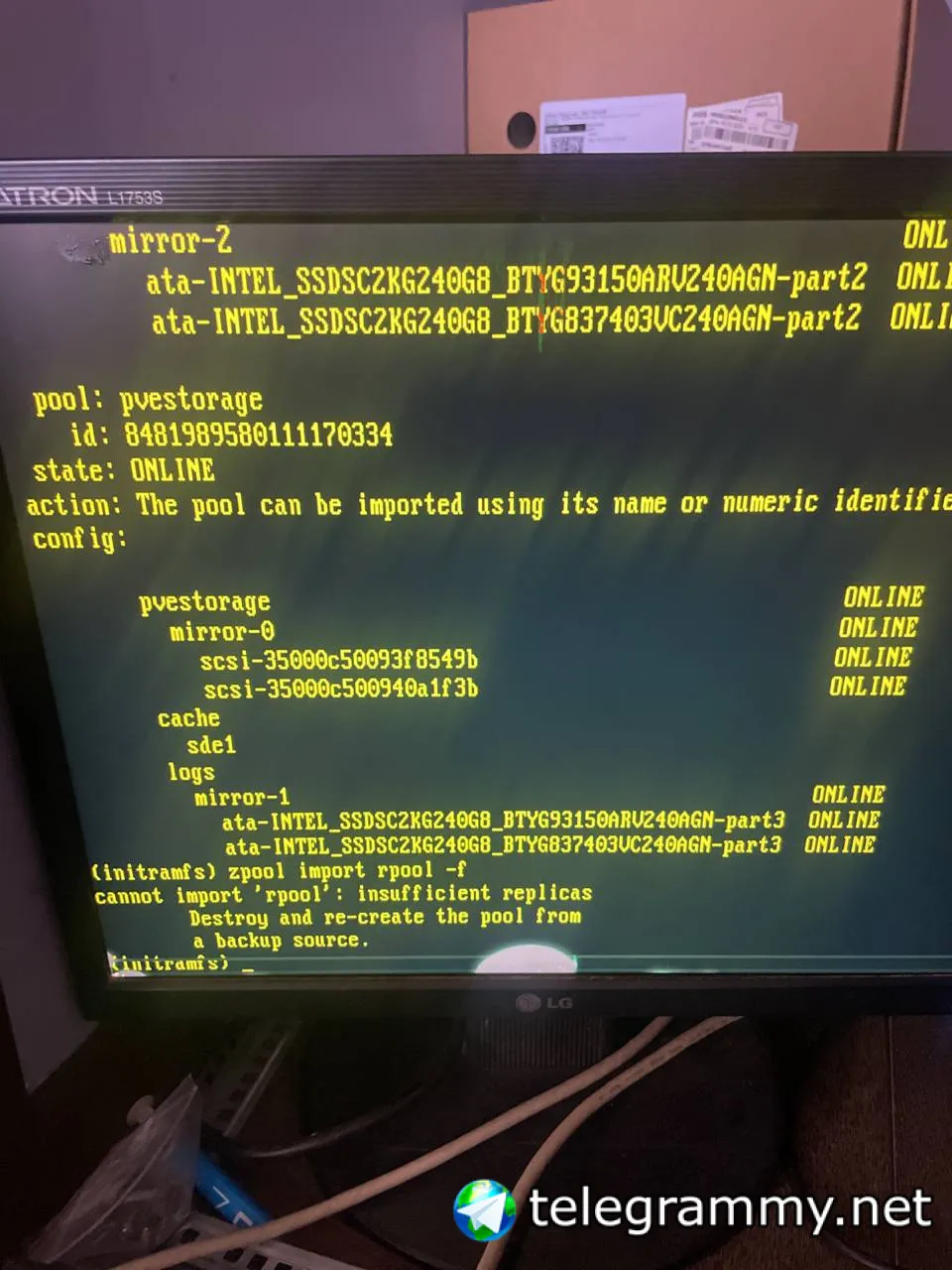

всем привет нужна помощь, не могу стартануть proxmox при загрузке вываливается в initramfs пишет, что не может импортировать rpool при том что все диски online. Статус the pool metadata is corrupted

Ivan

Ivan

Fedor

Fedor