Выступал на питерском хайлоаде про ZFS https://highload.ru/spb/2023/abstracts/10158

Уже видео появилось https://www.youtube.com/watch?v=x2XYOOiyhSc

следом ещё один доклад, только с Сербии на английском https://www.youtube.com/watch?v=g4DwezuyNlI слайды bit.ly/serb_zfs_23

George

George

следом ещё один доклад, только с Сербии на английском https://www.youtube.com/watch?v=g4DwezuyNlI слайды bit.ly/serb_zfs_23

70% отличается от питерского доклада)

George

George

эту ссылку можно публиковать в крупных чатиках ?

да, без ограничений, мне только интересно где оно появится

Ivan

Ivan

да, без ограничений, мне только интересно где оно появится

https://t.me/ru_proxmox/233883

чатик не сильно крупный, но всё же.

George

George

ну стоит почитать чем одна команда от другой отличается. attach это добавление миррора к существующему vdev

Ivan

Ivan

ну стоит почитать чем одна команда от другой отличается. attach это добавление миррора к существующему vdev

чем грозит добавление миррора через add ?

Игорь

Игорь

чем грозит добавление миррора через add ?

Тут два варианта:

- если мысль сформирована верно, то у вас будет страйп из зеркал, т.е. RAID10

- если мысль ошибочна, то через add зеркало не добавляется, а формируется stripe, т.е. RAID0 - суть сложение накопителей, выдерни любой и массив мëртв. Зато это самый производительный массив.

Ivan

Ivan

Тут два варианта:

- если мысль сформирована верно, то у вас будет страйп из зеркал, т.е. RAID10

- если мысль ошибочна, то через add зеркало не добавляется, а формируется stripe, т.е. RAID0 - суть сложение накопителей, выдерни любой и массив мëртв. Зато это самый производительный массив.

допустим есть пул raid10 и к нему нужно добавить один миррор.

Станислав

Станислав

допустим есть пул raid10 и к нему нужно добавить один миррор.

Миррор вы добавляете не к пулу, а к vdev

Станислав

Станислав

всмысле миррор - два диска как один vdev

Верно. А RAID10 - это два vdev+vdev, а каждый vdev - mirror

George

George

чем грозит добавление миррора через add ?

add это ДОБАВЛЕНИЕ нового vdev. По стечению обстоятельств новый вдев может быть сразу миррором, raidz и тд (или просто страйпом)

Игорь

Игорь

Если к пулу RAID10 добавить ещë один mirror, то добавится ëмкость пула, но он по-прежнему будет RAID10. Извлечь потом будет нельзя в текущих версиях, хотя такие доработки есть в планах, вроде, но не знаю, в каком состоянии.

Станислав

Станислав

Если к пулу RAID10 добавить ещë один mirror, то добавится ëмкость пула, но он по-прежнему будет RAID10. Извлечь потом будет нельзя в текущих версиях, хотя такие доработки есть в планах, вроде, но не знаю, в каком состоянии.

Если в пуле только мирроры, то можно извлечь, если места на оставшихся vdev достаточно

George

George

Если в пуле только мирроры, то можно извлечь, если места на оставшихся vdev достаточно

* если только мирроры/страйпы И ashift у всех один и тот же

Игорь

Игорь

Если в пуле только мирроры, то можно извлечь, если места на оставшихся vdev достаточно

А другие типы RAID добавление и удаление накопителей ещë не умеют? Читал, что будет. Так и не понял когда.

Станислав

Станислав

Ivan

Ivan

* если только мирроры/страйпы И ashift у всех один и тот же

зачем позволять ашифт отличный от имеющегося делать ? по хорошему такое надо запретить или через форс.

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

Всем привет.

В рамках знакомства с Talos, пытаюсь собрать модуль ZFS под него.

У меня возникла тупая проблема с зависимостями:

1.913 configure: WARNING: cannot find tirpc via pkg-config or in the standard locations

1.913 configure: error: in `/tmp/build/0':

1.913 configure: error: neither libc sunrpc support nor libtirpc is available, try installing libtirpc-devel

саму libtirpc я нашёл, скачал и распаковал

но вот как передать её ./confiugre скрипту я что-то не пойму

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

талос совсем пустой - там вообще всё надо собирать (

Мне нужен только модуль, там вроде не так много зависимостей, или я ошибаюсь?

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

талос совсем пустой - там вообще всё надо собирать (

В общем кажись получилось

https://github.com/siderolabs/pkgs/pull/763/files

Georg🎞️🎥

Georg🎞️🎥

Подскажите, пожалуйста

А сколько нынче можно выставить

L2arc write max и boost .. чтобы он работал «на все деньги» :)))👋

Aleksandr

Aleksandr

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

В общем кажись получилось

https://github.com/siderolabs/pkgs/pull/763/files

Ачивка затащить ZFS в Talos получена

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

Но зачем

Не стану скрывать основная затея была в том, чтобы разобраться с тем как подпихивать сторонние модули ядра.

Юзкейс пока что могу назвать только один - LINSTOR и другие CSI драйверы, которые могут использовать ZFS как бэкенд хранения

inqfen

inqfen

О кстати, ты у нас линстор мастер же, можно на тебя с несколькими вопросами в лс через пару дней напасть?

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜

О кстати, ты у нас линстор мастер же, можно на тебя с несколькими вопросами в лс через пару дней напасть?

Лучше сразу в @drbd_ru, но можешь меня там тэгать 🙂

inqfen

inqfen

Раньше было пофиг, а сейчас там трафика под гигабит будет наваливаться и по разным сайтам физически

Shaker

Shaker

Не стану скрывать основная затея была в том, чтобы разобраться с тем как подпихивать сторонние модули ядра.

Юзкейс пока что могу назвать только один - LINSTOR и другие CSI драйверы, которые могут использовать ZFS как бэкенд хранения

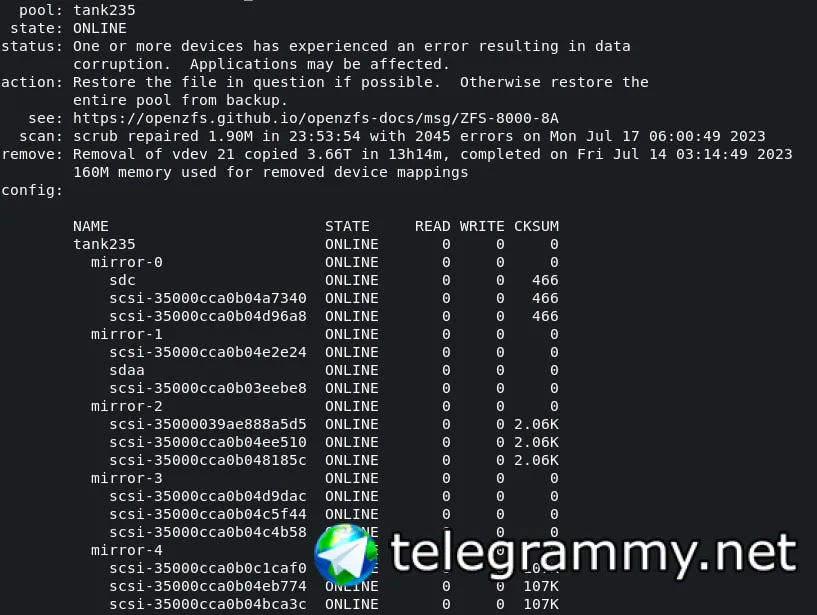

Неплохая затея, наверное. Я часто видел, как данные на zfs умирают из-за разных проблем с памятью/проводами. Далее CKSUM ошибки, и спасает только бэкап. Вопрос как тут поможет drbd конечно, но вдруг ))

Ошибок там великое множество, по разным причинам, можно только удачи пожелать в написании csi.

Georg🎞️🎥

Georg🎞️🎥

Shaker

Shaker

А что рассказывать ) с одними ошибки , с другими нет. Это не самая большая боль, но ведёт к проблемам.

Georg🎞️🎥

Georg🎞️🎥

Shaker

Shaker

Часто бывает ?

В целом, раза 2 в год. А потеря данных из-за софт ошибок с zfs, раз в год. На каком-то из zfs инстансов раз в квартал что-то приходится «чинить». Сейчас в топе перегрузка интерфейсов сас по полосе, из-за чего приходится схд с последовательным подключением подключать параллельно. Иначе в пиковых нагрузках происходит read timeout и zfs выкидывает диски в offline.

Georg🎞️🎥

Georg🎞️🎥

В целом, раза 2 в год. А потеря данных из-за софт ошибок с zfs, раз в год. На каком-то из zfs инстансов раз в квартал что-то приходится «чинить». Сейчас в топе перегрузка интерфейсов сас по полосе, из-за чего приходится схд с последовательным подключением подключать параллельно. Иначе в пиковых нагрузках происходит read timeout и zfs выкидывает диски в offline.

Софт ошибки - это какого рода ?

Перегруз по полосе - это когда на hba к примеру висит много винтов/// полок через чур и контроллер не тянет нагруз ?

Shaker

Shaker

Софт ошибки - это какого рода ?

Перегруз по полосе - это когда на hba к примеру висит много винтов/// полок через чур и контроллер не тянет нагруз ?

Да, у нас до 5 полок на 1 hba с резервированием канала. Но разделено на два сервера-контроллера, multipath не используем. Винты стали делать быстрые ))) И текущих каналов не хватает, мечтаем о 24G.

Shaker

Shaker

Сейчас сокращаем до 2 полок на канал. Увеличиваем контроллеры.

Ощущается небольшой архитектурный тупик )))

Shaker

Shaker

Shaker

Shaker

Это уже не первый случай, я же говорю, со временем память может умирать. И это уносит часть данных ZFS

Shaker

Shaker

Ну, понятно как это работает. Однако защиты от этого не хватает. В этот раз унесло около 12TB.

Fedor

Fedor

можно попробовать прочитать сбойные блоки, там где-то битик один поменялся во всем блоке - и блок считаетс поврежденным

Алексей

Алексей

Ребята, всем привет.

у меня raidz2 из 16 дисков по 16 тб

(если это важно: рекордсайз 1МБ, заполненность 75.2%)

все программы которые могли бы обращаться к пулу выключены.

все диски читают по 250-280 операций в секунду в среднем

скорость ресильвера ~80мб/сек, а это значит что процесс закончится где-то через месяц. слишком долго.

как улучить скорость ресильвера, и/или почему может быть так медленно?

Shaker

Shaker

можно попробовать прочитать сбойные блоки, там где-то битик один поменялся во всем блоке - и блок считаетс поврежденным

Да, пофиг. Мы наученые опытом, храним в разных местах сразу по зонам ))) Это так, к слову о стабильности и мыслях drbd+zfs ))

Shaker

Shaker

Ребята, всем привет.

у меня raidz2 из 16 дисков по 16 тб

(если это важно: рекордсайз 1МБ, заполненность 75.2%)

все программы которые могли бы обращаться к пулу выключены.

все диски читают по 250-280 операций в секунду в среднем

скорость ресильвера ~80мб/сек, а это значит что процесс закончится где-то через месяц. слишком долго.

как улучить скорость ресильвера, и/или почему может быть так медленно?

CPU какой ? Что еще на сервере ? Какие BPN/HBA ?

Алексей

Алексей

CPU какой ? Что еще на сервере ? Какие BPN/HBA ?

Intel(R) Xeon(R) CPU E5-2666 v3 @ 2.90GHz

LSI 9201-16i

Artem

Artem