Станислав

Станислав

Думаю будет норм. У меня есть две виртуалки, в которых всего оперативки гиг, там даже работает прокси на nginx и одна страничка отдается.

Станислав

Станислав

root@b:~# free -h

total used free shared buff/cache available

Mem: 976Mi 531Mi 296Mi 0.0Ki 149Mi 310Mi

Swap: 2.0Gi 26Mi 2.0Gi

root@b:~# uptime -p

up 14 weeks, 3 days, 5 hours, 59 minutes

14 недель потому, что я вовремя не оплатил))

central

central

Aleksandr

Aleksandr

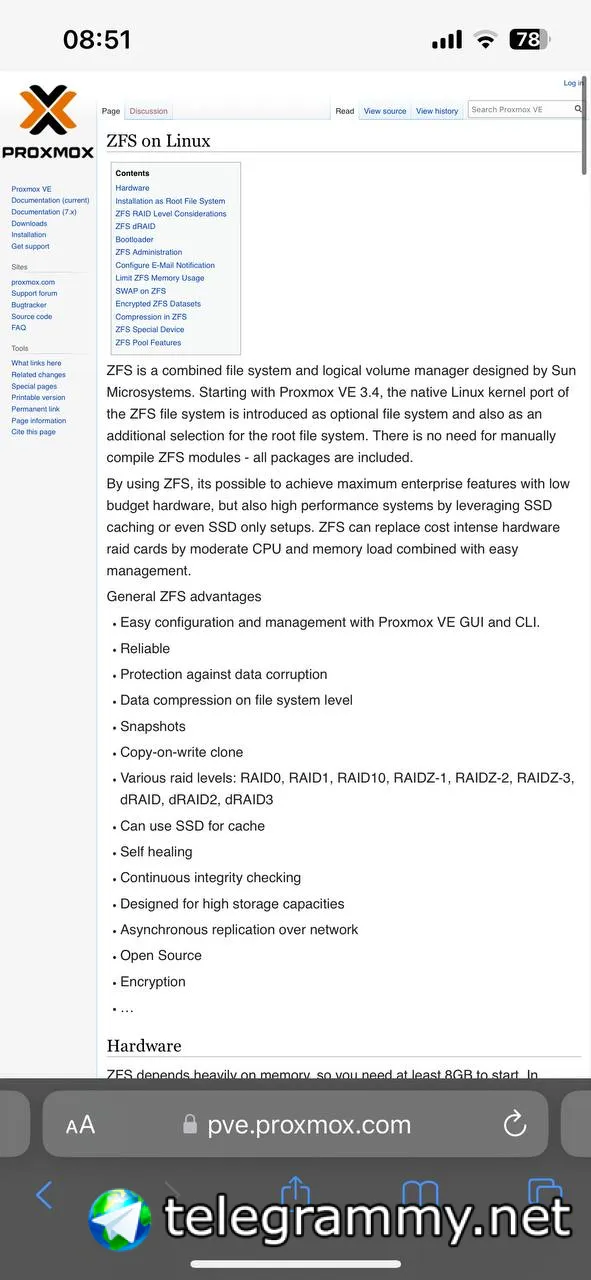

Zfs внутри вм?

тоже поставил zfs на ВМ для деупликации, под nextcloud, 2 года, полёт нормальный. А чо не так то?

Станислав

Станислав

тоже поставил zfs на ВМ для деупликации, под nextcloud, 2 года, полёт нормальный. А чо не так то?

Якобы не рекомендуют, нужен полноценный контроль над железом и всё такое. Это правильно, но смотря какие цели преследовать

Aleksandr

Aleksandr

Якобы не рекомендуют, нужен полноценный контроль над железом и всё такое. Это правильно, но смотря какие цели преследовать

где такое написано? вот правда интересно почитать, кто и почему не реагирует

Pavel

Pavel

где такое написано? вот правда интересно почитать, кто и почему не реагирует

Во всех инструкциях. Но в вашем случае не так критично. Тот же трунас это основное требование к дискам

central

central

central

central

тоже поставил zfs на ВМ для деупликации, под nextcloud, 2 года, полёт нормальный. А чо не так то?

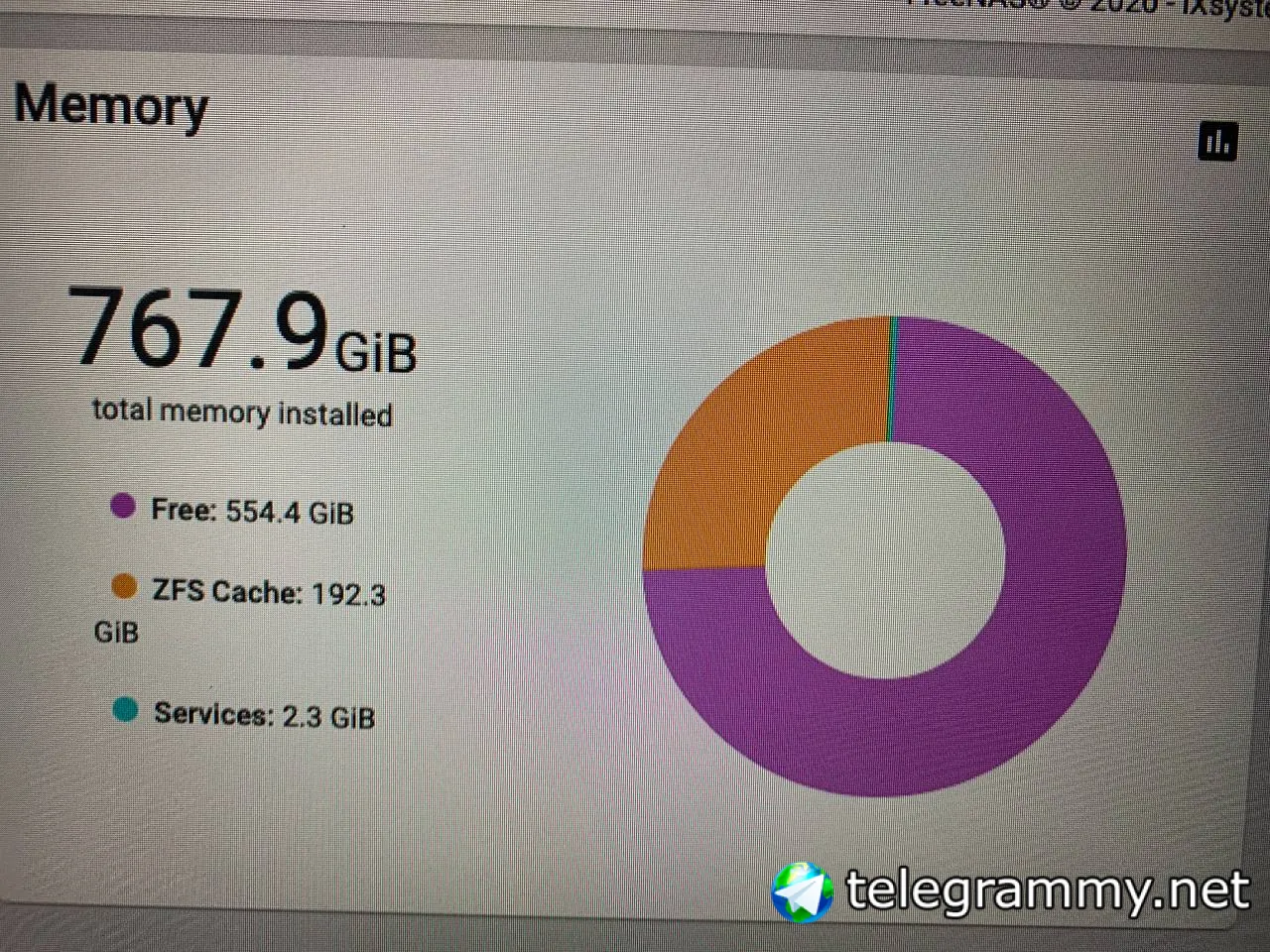

Нерациональное использование оперативной памяти, пару тройку таких вм и вам и 100 гигов окажется мало

central

central

А душит zfs по оперативе штука на любителя если нужна производительность какая никакая производительность

Ivan

Ivan

тоже поставил zfs на ВМ для деупликации, под nextcloud, 2 года, полёт нормальный. А чо не так то?

vdo не рассматривали для такого случая ?

Pavel

Pavel

и? и где тут написано что не рекомендуется ставить внутри ВМ?

There are countless warnings against using hardware RAID cards with TrueNAS. ZFS and TrueNAS provide a built-in RAID that protects your data better than any hardware RAID card. You can use a hardware RAID card if it is all you have, but there are limitations. First and most importantly, do not use their RAID facility if your hardware RAID card supports HBA mode, also known as passthrough or JBOD mode (there is one caveat in the bullets below). When used, it allows it to perform indistinguishably from a standard HBA. If your RAID card does not have this mode, you can configure a RAID0 for every disk in your system. While not the ideal setup, it works in a pinch. If repurposing hardware RAID cards with TrueNAS, be aware that some hardware RAID cards:

• Could mask disk serial number and S.M.A.R.T. health information

• Could perform slower than their HBA equivalents

• Could cause data loss if using a write cache with a dead battery backup unit (BBU))

Pavel

Pavel

и? и где тут написано что не рекомендуется ставить внутри ВМ?

Как писал выше ваш случай не показательный вообще. Многие дистрибутивы предлагают zfs сейчас.

Aleksandr

Aleksandr

central

central

Плевать zfs реальный или виртуальный процессор да хоть картофельный, главное чтобы дисковая подсистема не врала об том что данные записаны. А то гипервизор отчитался о том что данные записаны реально они не записаны и тут у вас все крашнулось и приехали

Aleksandr

Aleksandr

Плевать zfs реальный или виртуальный процессор да хоть картофельный, главное чтобы дисковая подсистема не врала об том что данные записаны. А то гипервизор отчитался о том что данные записаны реально они не записаны и тут у вас все крашнулось и приехали

это утверждение верно для любой фс, гипер отчитался и всё пошло по 3.14зде.

Roman

Roman

Плевать zfs реальный или виртуальный процессор да хоть картофельный, главное чтобы дисковая подсистема не врала об том что данные записаны. А то гипервизор отчитался о том что данные записаны реально они не записаны и тут у вас все крашнулось и приехали

У нормальных гипервизоров есть настройки для дисков вм, как у того же проксмокс. Writeback и т.д.

Roman

Roman

в общем ясно-понятно, что ни у кого нет таких рекомендаций по поводу zfs в ВМ

Используй с учётом рисков и не парься.

Станислав

Станислав

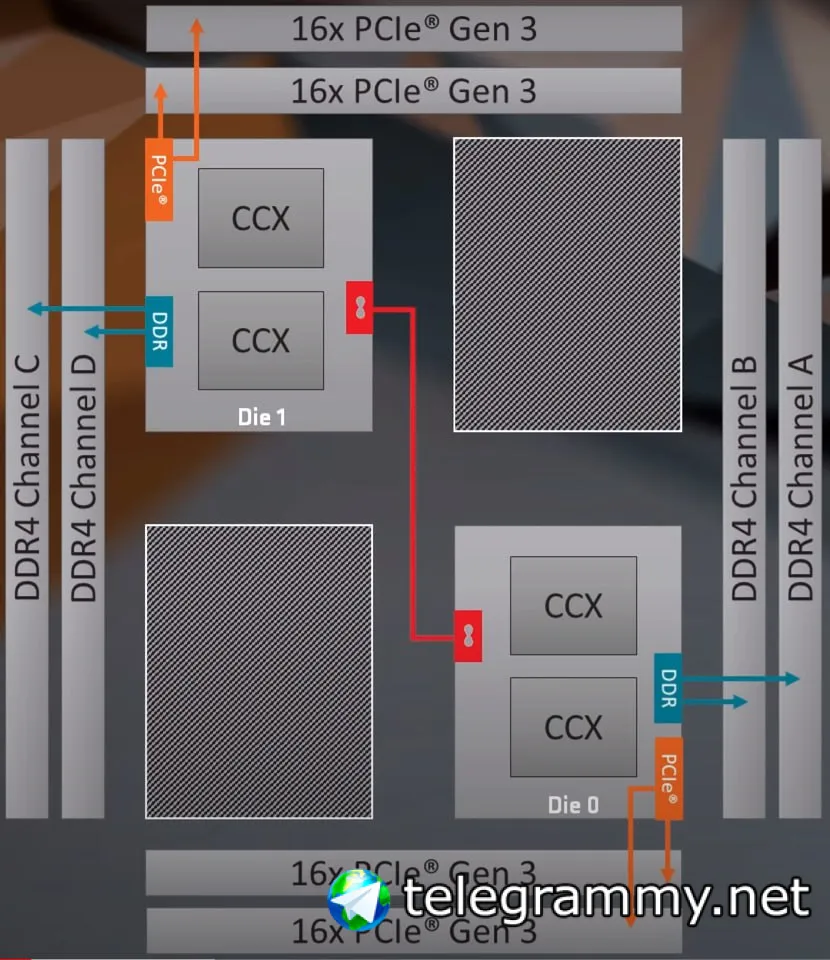

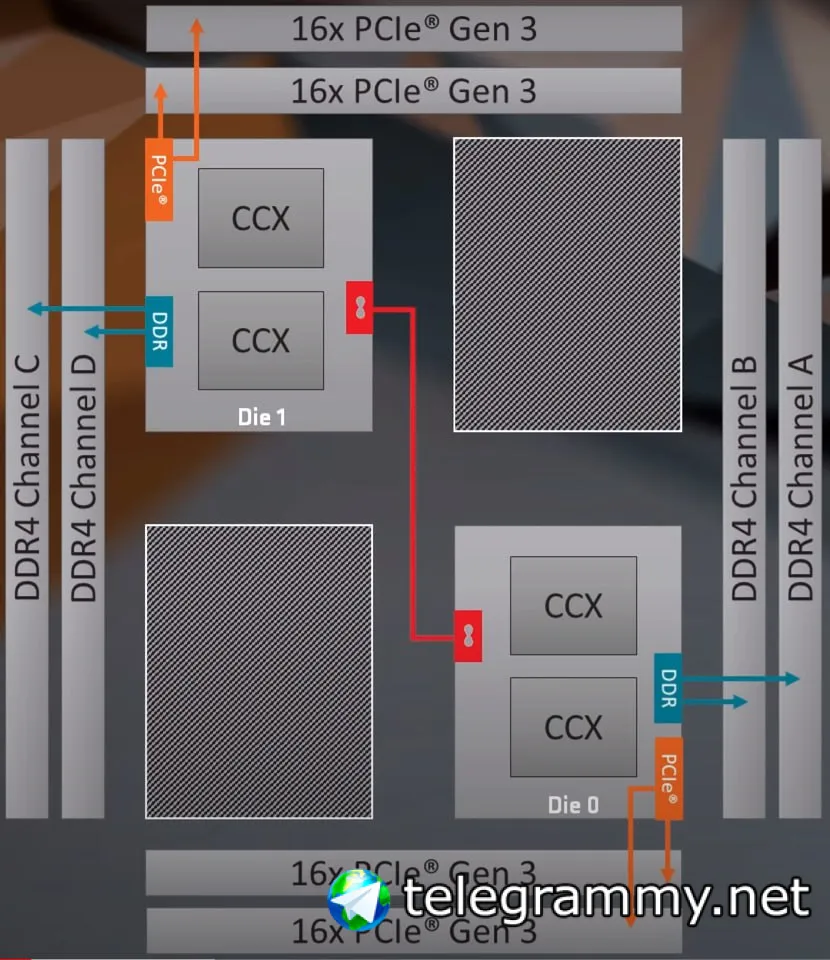

Подскажите, пожалуйста, кто-нибудь пользовался ZFS на Threadripper? Есть ли подводные камни?

Интересует по большей части Threadripper 1950x (16 ядер, 32 потока)

Vladislav

Vladislav

Станислав

Станислав

Я на эпиках его использовал

Какие-то специфические настройки приходилось делать или без заморочек?

ivdok

ivdok

Привет, есть вопрос по релизу 2.2. На похорониксе читаю:

The Linux container support for OpenZFS 2.2 includes IDMAPPED mounts in the user name-space, OverlayFS support, and Linux namespace delegation support.

Но насколько я помню, докер и openebs-zfs и раньше могли нарезать тома для контейнеров. Что этот релиз приносит нового?

Vladislav

Vladislav

тоже поставил zfs на ВМ для деупликации, под nextcloud, 2 года, полёт нормальный. А чо не так то?

Ошибка выжившего.

А вообще, если в ВМ напрямую прокинут HBA то особой разницы нет, другое дело, что описывать как это делать для каждой виртуализации проблемно, поэтому проще не рекомендовать

Vladislav

Vladislav

Какие-то специфические настройки приходилось делать или без заморочек?

Оно само прекрасно работает, вроде есть часть параметров которые можно покрутить, но они не завязаны на АМД

George

George

Привет, есть вопрос по релизу 2.2. На похорониксе читаю:

The Linux container support for OpenZFS 2.2 includes IDMAPPED mounts in the user name-space, OverlayFS support, and Linux namespace delegation support.

Но насколько я помню, докер и openebs-zfs и раньше могли нарезать тома для контейнеров. Что этот релиз приносит нового?

Есть разные варианты работы с фс у контейнеров, например с помощью renameat можно хитрые штуки атомарно проворачивать. Вот тут и добросили вариантов

ivdok

ivdok

Есть разные варианты работы с фс у контейнеров, например с помощью renameat можно хитрые штуки атомарно проворачивать. Вот тут и добросили вариантов

Это можно использовать например с ZFS в юзерспейсе? Допустим, прокинуть с хоста девайс, а маунтить и писать из контейнера? Или требуется модуль ядра?

George

George

Это можно использовать например с ZFS в юзерспейсе? Допустим, прокинуть с хоста девайс, а маунтить и писать из контейнера? Или требуется модуль ядра?

Ну openzfs это модуль ядра. Openebs как раз вроде делал форк юзерспейсный

Georg🎞️🎥

Georg🎞️🎥

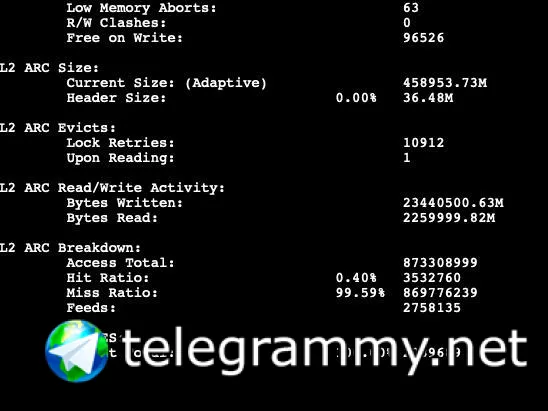

Привет, запамятовал, кэшировать потоковое чтение в принципе , какие команды вбить ? Чтобы он в arc и arc l2 это делал ? Спасибо 👋👋

Vladislav

Vladislav

George

George

George

George

А вот надо что то указывать для arc? Ведь L2 оттуда берет данные ?

Если ничего не меняли с дефолта, то ничего

Georg🎞️🎥

Georg🎞️🎥

Arc по дефолту всё кешит

Отлично … я просто менял значения l2arc и на 0, и на 1 … а что то нифига (((

Станислав

Станислав

Я на эпиках его использовал

Vladislav

Vladislav

Станислав

Станислав

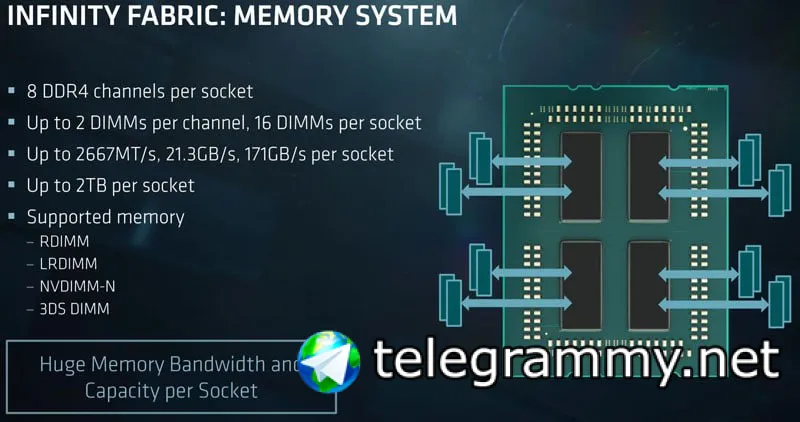

Получается, что у каждого блока по 8 ядер прямой доступ только к двум каналам памяти. Если модуль с 24-32 ядрами, то другие два блока вообще не имеют доступа к памяти.

central

central

Как и у эпиков, как и у ryzen

Опять же, это проблемы ОС будут, а не ZFS

Zfs должен поддерживать нуму чтобы не сливать производительность

Станислав

Станислав

Как и у эпиков, как и у ryzen

Опять же, это проблемы ОС будут, а не ZFS

Вот и нет. У Эпиков реализация всё-таки отличается и прямой доступ к памяти есть. Как я понял

Vladislav

Vladislav

Zfs должен поддерживать нуму чтобы не сливать производительность

Разве за это не будет отвечать планировщик?

Vladislav

Vladislav

Вот и нет. У Эпиков реализация всё-таки отличается и прямой доступ к памяти есть. Как я понял

Как ты реализуешь прямой доступ к памяти у 2-х сокетной конфигурации, к примеру?

Станислав

Станислав

А тут не важно, кто отвечает. Суть в скорости обмена данными - она страдает, если блоку нужен доступ к оперативной памяти, подключенной к другому блоку

Vladislav

Vladislav

У эпиков все ядра через контролёр, там интерНУМА формальная

Не у первого поколения же

https://www.servethehome.com/amd-epyc-7000-series-architecture-overview-non-ce-ee-majors/

Vladislav

Vladislav

"What that essentially means is that there will be different memory latencies depending on which die needs data from memory that can be attached to that die or another die on the fabric."

Egor

Egor

я тут подумал: а что если собрать пул страйп на очень быстрых nvme-накопителях, и чтоб их было очень много (24+)... Там же явно скорость записи и чтения будет выше чем в оперативке, и т.о. она будет таким буфером который будет замедлять работу всего массива... Как интересно такой странный конфиг правильно на zfs делать?

Vladislav

Vladislav

я тут подумал: а что если собрать пул страйп на очень быстрых nvme-накопителях, и чтоб их было очень много (24+)... Там же явно скорость записи и чтения будет выше чем в оперативке, и т.о. она будет таким буфером который будет замедлять работу всего массива... Как интересно такой странный конфиг правильно на zfs делать?

Будет, сейчас никак

Ждать патч на nvme, который убирает буферизацию

Ilia

Ilia

Georg🎞️🎥

Georg🎞️🎥

я тут подумал: а что если собрать пул страйп на очень быстрых nvme-накопителях, и чтоб их было очень много (24+)... Там же явно скорость записи и чтения будет выше чем в оперативке, и т.о. она будет таким буфером который будет замедлять работу всего массива... Как интересно такой странный конфиг правильно на zfs делать?

Нет не будет, оперативка в разы быстрее по случайному доступу , не знаю какая мать столько nvme потянет )))

Самый быстрый Интел оптан раза в три отстает от ram

Vladislav

Vladislav

Нет не будет, оперативка в разы быстрее по случайному доступу , не знаю какая мать столько nvme потянет )))

Самый быстрый Интел оптан раза в три отстает от ram

Да, но нет, лишние буферы в RAM значительно тормозят nvme

Georg🎞️🎥

Georg🎞️🎥

Да, но нет, лишние буферы в RAM значительно тормозят nvme

Zfs как то не шибко весело ворочает ssd 🤷🏻♂️

Georg🎞️🎥

Georg🎞️🎥

Egor

Egor

Под какие задачи такое ?

да это так, теоретические размышления.. Очень быстрый доступ к данным в БД например, или рандомный доступ к файлам

Станислав

Станислав

Georg🎞️🎥

Georg🎞️🎥

да это так, теоретические размышления.. Очень быстрый доступ к данным в БД например, или рандомный доступ к файлам

БД - это мелкие блоки часто … мне кажется кажется куча памяти больше даст профита 🤷🏻♂️типа гиг 700

Dmitry

Dmitry

Всем привет! Собираюсь материнку, проц и загрузочный диск в домашнем сервере с proxmox менять. Есть 2 подключенных zfs пула. Как лучше сделать? Резервные копии данных с пулов - само собой лучший вариант. А как с существующими пулами? zfs import ?

Sergey

Sergey

Посоны, а можно как-то настроить какой-то таймаут, чтобы при засуспенженом (из-за недоступного диска) пуле, процесс, в котором выполняется некоторая операция (например, zfs create testpool/testfs) не повисал в ожидании исправления проблем, а ждал таймаут и выплевывал ошибку? Чесслово, много перекопал, и не вижу решения

Sergey

Sergey

поскольку процесс не повисает намертво, а доводит операцию до конца, как только пул будет починен - можно сделать вывод, что он делает ретраи. но где бы ограничить их количество

Georg🎞️🎥

Georg🎞️🎥

Fedor

Fedor

Artem

Artem

𝚔𝚟𝚊𝚙𝚜

𝚔𝚟𝚊𝚙𝚜