Y

Y

мне доверяешь?))

Счас никому нельзя доверять, даже собственной жопе. Всего то пернуть хотел! (С) 😂

central

central

Y

Y

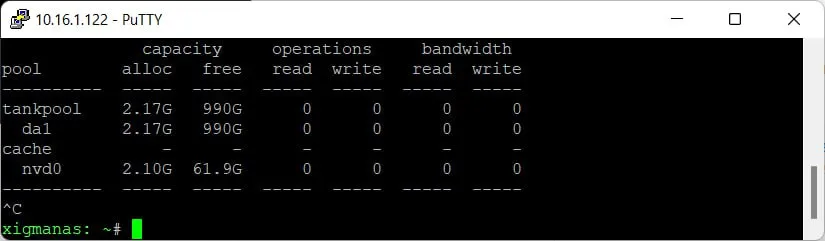

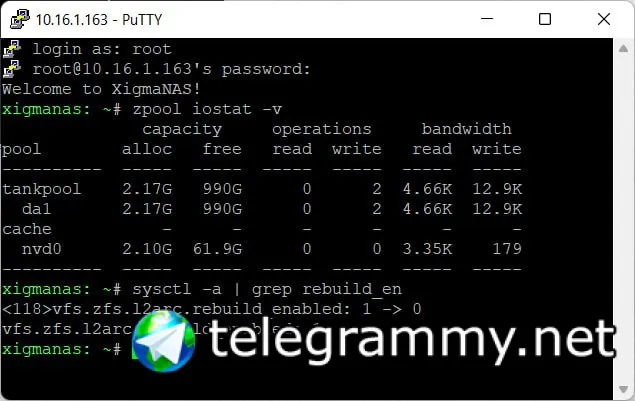

l2arc_rebuild_enabled (int)

Rebuild the L2ARC when importing a pool (persistent L2ARC). This can be

disabled if there are problems importing a pool or attaching an L2ARC device

(e.g. the L2ARC device is slow in reading stored log metadata, or the metadata

has become somehow fragmented/unusable).

Use 1 for yes (default) and 0 for no.

из мана по убунте (https://manpages.ubuntu.com/manpages/impish/man5/zfs-module-parameters.5.html)

то есть кеш при каждом импорте пула (читай перезагрузке) ребилдится, а не просто "включается" с существующими данными на ССД (то есть грубо говоря кеш на 1 тера - будет "долго" заполнятся при загрузке, но не с нуля, а с учетом "веса" кешируемых данных

так получается ?

Andrey

Andrey

Зачем спорить - открываем исходники и читаем

/*10006 * In contrast to l2arc_add_vdev() we do not have to worry about

10007 * l2arc_feed_thread() invalidating previous content when onlining a

10008 * cache device. The device parameters (l2ad*) are not cleared when

10009 * offlining the device and writing new buffers will not invalidate

10010 * all previous content. In worst case only buffers that have not had

10011 * their log block written to the device will be lost.

10012 * When onlining the cache device (ie offline->online without exporting

10013 * the pool in between) this happens:

10014 * vdev_reopen() -> vdev_open() -> l2arc_rebuild_vdev()

10015 * | |

10016 * vdev_is_dead() = B_FALSE l2ad_rebuild = B_TRUE

10017 * During the time where vdev_is_dead = B_FALSE and until l2ad_rebuild

10018 * is set to B_TRUE we might write additional buffers to the device.

Т е, если l2arc persistent данные на диске для l2arc не очищаются

В процессе обращения к данным l2arc если для запрашиваемого блока лог потерян, данные будут считываться с дисков(реальные данные) в arc, а блок в l2arc будет инвалидирован

Т е в целом все будет читаться из l2arc, но иногда на некоторых блоках обращение будет к дискам с данными - это все при условии l2arc_rebuild_enabled=0

Если же l2arc_rebuild_enabled=1, то при persistent l2arc в процессе монтирования будет выполнятся валидация данных на диске l2arc

Andrey

Andrey

т е мы можем либо при монтировании сразу провалидировать все блоки в l2arc , либо в процессе работы они сами провалидируются, если мы наткнемся на блок данных с потерянным логом

первый случай - возможная долгая загрузка при большом кэше, т к требуется провалидировать блоки данных

во втором случае возможные задержки при попадании на инвалидный блок в l2arc

выбирать самому какое поведение устраивает

Andrey

Andrey

/* 9857 * The L2ARC has to hold at least the payload of one log block for

9858 * them to be restored (persistent L2ARC). The payload of a log block

9859 * depends on the amount of its log entries. We always write log blocks

9860 * with 1022 entries. How many of them are committed or restored depends

9861 * on the size of the L2ARC device. Thus the maximum payload of

9862 * one log block is 1022 * SPA_MAXBLOCKSIZE = 16GB. If the L2ARC device

9863 * is less than that, we reduce the amount of committed and restored

9864 * log entries per block so as to enable persistence.

9865 */

т е потерянных данных в l2arc может быть до 16 Гб на 1 блок лога,

поэтому самим выбирать стратегию инвалидации l2arc - в процессе работы или при перезагрузке провалидировать

Nikolay

Nikolay

#Вопрос Подскажите, видел тут в чате давно, как-то смотрят какими блоками чаще всего пишет на диск линукс, чтоб подобрать оптимальный размер блока зфс. Вроде самими средствами зфс даже это делается, там прям выводились размеры блоков и сколько их было записано на диск.

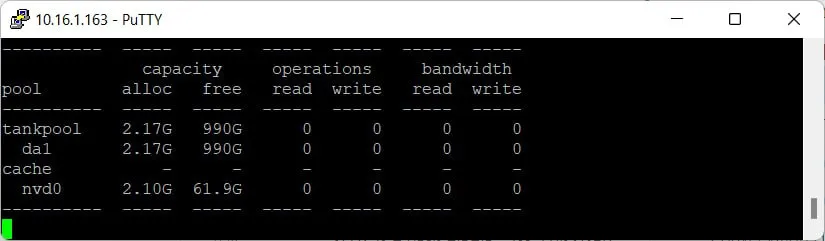

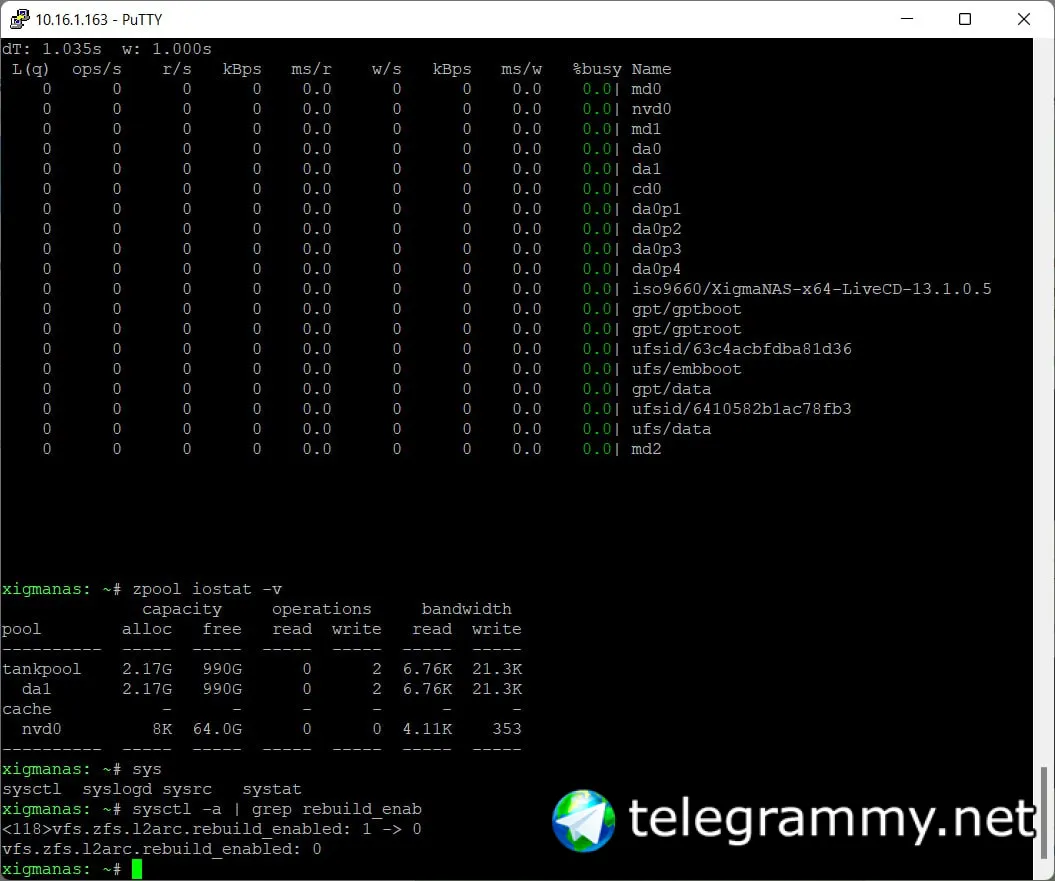

#Ответ: zpool iostat tank -ry 1

Aba

Aba

Y

Y

т е мы можем либо при монтировании сразу провалидировать все блоки в l2arc , либо в процессе работы они сами провалидируются, если мы наткнемся на блок данных с потерянным логом

первый случай - возможная долгая загрузка при большом кэше, т к требуется провалидировать блоки данных

во втором случае возможные задержки при попадании на инвалидный блок в l2arc

выбирать самому какое поведение устраивает

то есть параметр vfs.zfs.l2arc.rebuild_enabled влияет именно на это?, и l2arc при перезагрузке всегда уже заполнен но не валидирован ?

Y

Y

короче надо тестить, просто накопилось много мелких SSD по 64-120 гига , думал штук 8 тыкнуть на l2arc - их иначе только выкидывать - толку от них ноль, а так может профит будет какой - сетка 10 гига , 8 дисков должны ее забить (не в рандоме конечно, но тем не менее)

Y

Y

раньше удерживало то что не было постоянного кеша - и толку от перезагрузки до перезагрузки было мало....

Fedor

Fedor

https://3dnews.ru/1083456/apex-storage-predstavila-x21-kartu-rasshireniya-pcie-dlya-21-nakopitelya-pcie-40-m2-nvme

Shaker

Shaker

Shaker

Shaker

Вопрос какой свич конечно, да и охлаждаться нормально не будет. Проще с U.2/U.3 и большим корпусом.

Vladislav

Vladislav

Вопрос какой свич конечно, да и охлаждаться нормально не будет. Проще с U.2/U.3 и большим корпусом.

Они не настолько нагреваются

Shaker

Shaker

Они не настолько нагреваются

Греются невероятно сильно при длительной нагрузке. Настолько, что если нормально не охлаждать, перестает работать контроллер в nvme.

Shaker

Shaker

Вот проще что-то типа такого:

https://www.servethehome.com/wiwynn-st300-1u-24-bay-u-2-nvme-jbof/

Shaker

Shaker

Или такого:

http://ustorage.com.tw/download/PCIe_Gen4_NVMe_JBOF/Ustorage%20PCIe%20Gen4%20NVMe%20JBOF.pdf

Artem

Artem

Можно хоть целый шкаф nvme забить, и подключить к двум серверам ( если двухканальные )

Ну это же выглядит не как решение для серверов

Y

Y

Тогда не понятно для чего ;)

скорее для "отладки" - когда надо много но пока не понятно сколько много - что бы заказывать полноценные флеш-хранилища... а так по сути воткнул в рабочую станцию любую и вот много

Shaker

Shaker

скорее для "отладки" - когда надо много но пока не понятно сколько много - что бы заказывать полноценные флеш-хранилища... а так по сути воткнул в рабочую станцию любую и вот много

Так это потребительские NVME. У них работа отличается от серверных. То кэш переполнится и скорость упадет, то контроллер перегреется и диск отвалится, то еще что-то. Но может и полезно, хз )

Shaker

Shaker

А про перегрев и отваливается - можно поподробнее? Я что-то думал, что просто тормозить будет

Это индивидуально для каждой модели-производителя, по разному.

samsung 980 гарантированно отваливались после перегрева

Artem

Artem

Это индивидуально для каждой модели-производителя, по разному.

samsung 980 гарантированно отваливались после перегрева

Про или обычные? Правда у меня только один обычный, и тот в десктопе

Vladislav

Vladislav

Vladislav

Vladislav

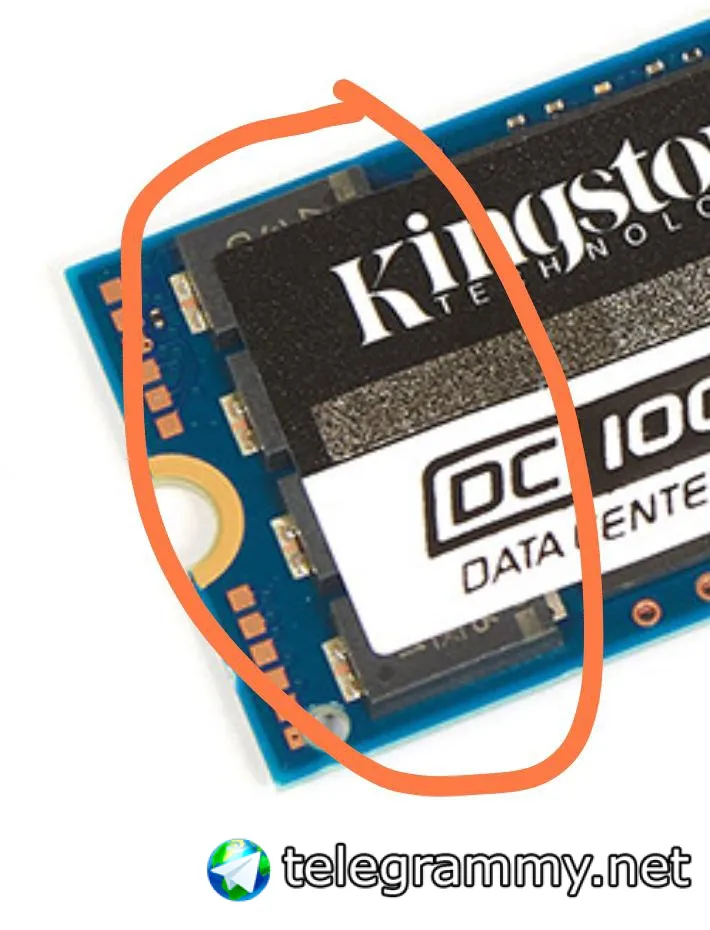

Серверные обычно 22100, покажите мне 2280

https://www.overclockers.ua/storage/kingston-dc1000-960gb/all/

central

central

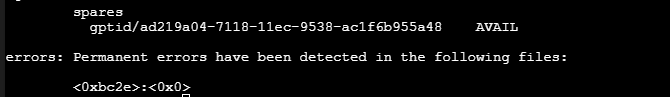

как понять что за файл <0xbc2e>:<0x0>

Это не файл а какой то сектор, что там находится это надо документацию курить

Art

Art

https://3dnews.ru/1083456/apex-storage-predstavila-x21-kartu-rasshireniya-pcie-dlya-21-nakopitelya-pcie-40-m2-nvme

Странный девайс конечно, каждому накопителю достанется лишь 0.7 от положенной пропускной способности

Разве что смысл в том, чтобы иметь возможность утилизировать большое кол-во выгодно купленных или просто завалявшихся m.2 накопителей

Stanislav

Stanislav

Коллеги, добрый день. Подскажите насколько стабильна zfs под Ubuntu. Можно ли её в продакшн использовать? Планирую на раздел из 4х SSD дисков под NextCloud собрать raidz

central

central

Stanislav

Stanislav

ну тут скорее вопрос стабильности под linux, до сего времени у меня была информация что под Lunux zfs не так стабильна как под FreeBSD

Vladislav

Vladislav

при этом там пишут

100 PCIe 4.0 Lanes

и сама плата даже не pci-e 5.0

На самом деле, pcie 4.0 nvme дисков не так много, по сравнению с 3.0

Vladislav

Vladislav

Коллеги, добрый день. Подскажите насколько стабильна zfs под Ubuntu. Можно ли её в продакшн использовать? Планирую на раздел из 4х SSD дисков под NextCloud собрать raidz

Можно, но не ту что в комплекте с ubuntu идёт

Vladislav

Vladislav

ну тут скорее вопрос стабильности под linux, до сего времени у меня была информация что под Lunux zfs не так стабильна как под FreeBSD

Это было, когда у них разная кодовая база была, с того момента они объединились

Fedor

Fedor

На самом деле, pcie 4.0 nvme дисков не так много, по сравнению с 3.0

на самом деле за последнее время довольно много появилось

и всё это надо охлаждать

Vladislav

Vladislav

на самом деле за последнее время довольно много появилось

и всё это надо охлаждать

А 3.0 охлаждать надо меньше, и так как скорость все равно ограничена, то это весьма элегантное применение для старых 3.0

Владимир

Владимир

Shestakow

Shestakow