Maksim

Maksim

root@ah64:~# awk '/^size/ { print $1 " " $3 / 1048576/1024 }' < /proc/spl/kstat/zfs/arcstats

size 124.329

root@ah64:~# cat /sys/module/zfs/parameters/zfs_arc_max

137438953472

root@ah64:~# echo 37438953472 >> /sys/module/zfs/parameters/zfs_arc_max

root@ah64:~# awk '/^size/ { print $1 " " $3 / 1048576/1024 }' < /proc/spl/kstat/zfs/arcstats

size 34.3159

Владимир

Владимир

Я натыкался на форуме каком-то что некоторые у кого нет jbod из каждого диска делают raid0 и юзают zfs)

Слыхал про такие контроллеры, тоже ниразу не попадались

Владимир

Владимир

на удачу - использовать jbod и надеяться что все будет хорошо.

На удачи не читать доки на свой контроллер

Владимир

Владимир

это как с тб. можно ее игнорировать и хвастаться тем что с тобой ничего не случилось. систематическая ошибка выжившего.

Ага и при этом видеть диски и их смарт

Ivan

Ivan

Владимир

Владимир

Владимир

Владимир

это как всякие всратые usb-sata. подключаешь, а диск на пару метров меньше.

Ты это и имел ввиду?

Ivan

Ivan

Ты это и имел ввиду?

я имел ввиду что у меня была разница в размере диска через jbod и через hba.

Владимир

Владимир

я имел ввиду что у меня была разница в размере диска через jbod и через hba.

Тогда надо выражаться точнее)

Aba

Aba

Тогда надо выражаться точнее)

Он достаточно точно выразился, это ты уже сам додумал. "контроллерами, которые на jbod меняют размер диска".

CARA

CARA

Ну всмысле что jbod пишет на диск какие то свои метки и как бы воткнув диск в другой комп он не заведётся)смысл же такой?)

Maksim

Maksim

а можно ли так проверить кошерность джбода - воткнуть в контроллер, создать там фс, вытащить, воткнуть в hba, посмотреть читается ли? или это только необходимое условие, но не достаточное?

upd уже похожее спросили

Ivan

Ivan

вероятнее всего без проблем такой переезд случится.

хотя читал в интернетах что у кого-то возникала проблема.

Ivan

Ivan

не понимаю зачем надеяться и гадать, когда hba на авито от 3к, а бу с гарнтией от 6к можно найти.

Ivan

Ivan

неприятная история с jbod может выстрелить лет через 5-8 когда на дисках начнут выползать бэды. или когда кэш глючить начнет.

Владимир

Владимир

не понимаю зачем надеяться и гадать, когда hba на авито от 3к, а бу с гарнтией от 6к можно найти.

ну ты цены какие-то не реальные называешь мне кажется))

Владимир

Владимир

неприятная история с jbod может выстрелить лет через 5-8 когда на дисках начнут выползать бэды. или когда кэш глючить начнет.

если покупать новое, то конечно HBA, если оно уже есть, то почему бы и не заюзать...

Станислав

Станислав

Привет всем! Подскажите, пожалуйста, что делаю не так.

Есть машина с пулом ZFS, пытаюсь сделать репликацию на удаленную машину под отдельно созданным юзером на обоих машинах.

На источнике выставил права:

---- Permissions on nvpool/so/www -----------------------------------

Local+Descendent permissions:

user zfsreplica send

На получателе:

zfs allow -u zfsreplica -d mountpoint,create,mount,receive rpool/nv

Запускаю на источнике send под пользователем zfsreplica:

zfs send -cvL nvpool/so/www@2023-01-28_10:00:01 | ssh 172.168.2.3 -p 49821 'zfs recv rpool/nv/so/www'

full send of nvpool/so/www@2023-01-28_10:00:01 estimated size is 2.06G

total estimated size is 2.06G

TIME SENT SNAPSHOT nvpool/so/www@2023-01-28_10:00:01

22:06:24 48.9M nvpool/so/www@2023-01-28_10:00:01

22:06:25 161M nvpool/so/www@2023-01-28_10:00:01

22:06:26 274M nvpool/so/www@2023-01-28_10:00:01

22:06:27 386M nvpool/so/www@2023-01-28_10:00:01

22:06:28 499M nvpool/so/www@2023-01-28_10:00:01

22:06:29 611M nvpool/so/www@2023-01-28_10:00:01

22:06:30 722M nvpool/so/www@2023-01-28_10:00:01

22:06:31 834M nvpool/so/www@2023-01-28_10:00:01

22:06:32 947M nvpool/so/www@2023-01-28_10:00:01

22:06:33 1.03G nvpool/so/www@2023-01-28_10:00:01

22:06:34 1.14G nvpool/so/www@2023-01-28_10:00:01

22:06:35 1.25G nvpool/so/www@2023-01-28_10:00:01

22:06:36 1.36G nvpool/so/www@2023-01-28_10:00:01

22:06:37 1.47G nvpool/so/www@2023-01-28_10:00:01

22:06:38 1.58G nvpool/so/www@2023-01-28_10:00:01

22:06:39 1.69G nvpool/so/www@2023-01-28_10:00:01

22:06:40 1.80G nvpool/so/www@2023-01-28_10:00:01

22:06:41 1.91G nvpool/so/www@2023-01-28_10:00:01

22:06:42 2.02G nvpool/so/www@2023-01-28_10:00:01

22:06:43 2.13G nvpool/so/www@2023-01-28_10:00:01

22:06:44 2.23G nvpool/so/www@2023-01-28_10:00:01

cannot mount 'rpool/nv/so/www': Insufficient privileges

Станислав

Станислав

Изначально писало "Отказано в доступе". Вычитал, что нужно ACL права выставить. Сделал:

setfacl -m u:zfsreplica:rwx /mnt/nv/

Также сделал владельцем директории /mnt/nv/ юзера zfsreplica, после этого пишет то, что выше "Insufficient privileges"

Denis

Denis

Коллеги помогите советом:

root@tc-pbs:~# zpool import

pool: mail_data

id: 11180699773431060342

state: FAULTED

status: The pool metadata is corrupted.

action: The pool cannot be imported due to damaged devices or data.

The pool may be active on another system, but can be imported using

the '-f' flag.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-72

config:

mail_data FAULTED corrupted data

mpathb ONLINE

есть шанс данный пул хотя бы для чтения подключить?

Denis

Denis

zpool import -f mail_data

cannot import 'mail_data': one or more devices is currently unavailable

Lone

Lone

Жаль таблички нету где нормальны jbod а где не очень(

Смотрите. У Вас уже есть SAS3 контроллер. Это модно, молодёжно, дорого.

Если у Вас будут крутиться HDD, то SAS2 на 24 диска достаточно.

Если будут SSD - тогда без SAS3 не жить.

SAS3 контроллеры стоят дорого, за SAS3 backplane гоняются и они тоже стоят дорого.

Вы, конечно, можете купить что-то дешевое кетайское, только учтите, что там подделывают всё, что только можно. Так что Ваш SAS3 контроллер с aliexpress скорее всего будет сделан на Малой Арнаутской. Не жалуйтесь потом, что у Вас что-то глючит.

BTW, Adaptec контроллеры греются как хорошая печка.

Если хотите посмотреть видео с объяснялками по контроллерам, то вот этот товарищ очень хорош. Он занимается тем, что на ebay продает эти самые контроллеры.

Vladislav

Vladislav

Sora

Sora

Что-то документация дает туманный ответ, файл zpool_cache должен лежать в корне пула которому принадлежит, или его можно разместить в любое другое место, например в другой пул?

Aba

Aba

Что-то документация дает туманный ответ, файл zpool_cache должен лежать в корне пула которому принадлежит, или его можно разместить в любое другое место, например в другой пул?

У меня на другом пуле лежат все кеш файлы от разных пулов. Коль зашла про них речь: у меня тут другой вопрос, если их вырубить, каковы будут последствия кроме как невозможности последующего автоматического импорта пула?

Sora

Sora

У меня на другом пуле лежат все кеш файлы от разных пулов. Коль зашла про них речь: у меня тут другой вопрос, если их вырубить, каковы будут последствия кроме как невозможности последующего автоматического импорта пула?

По идее никакого, он содержит описание текущего активного пула, поставщиков и нужен для определения списка доступных пулов при импорте.

When a pool is not listed in the cache file it will need to be detected and imported manually.

Sora

Sora

Volodymyr

Volodymyr

Коллеги помогите советом:

root@tc-pbs:~# zpool import

pool: mail_data

id: 11180699773431060342

state: FAULTED

status: The pool metadata is corrupted.

action: The pool cannot be imported due to damaged devices or data.

The pool may be active on another system, but can be imported using

the '-f' flag.

see: https://openzfs.github.io/openzfs-docs/msg/ZFS-8000-72

config:

mail_data FAULTED corrupted data

mpathb ONLINE

есть шанс данный пул хотя бы для чтения подключить?

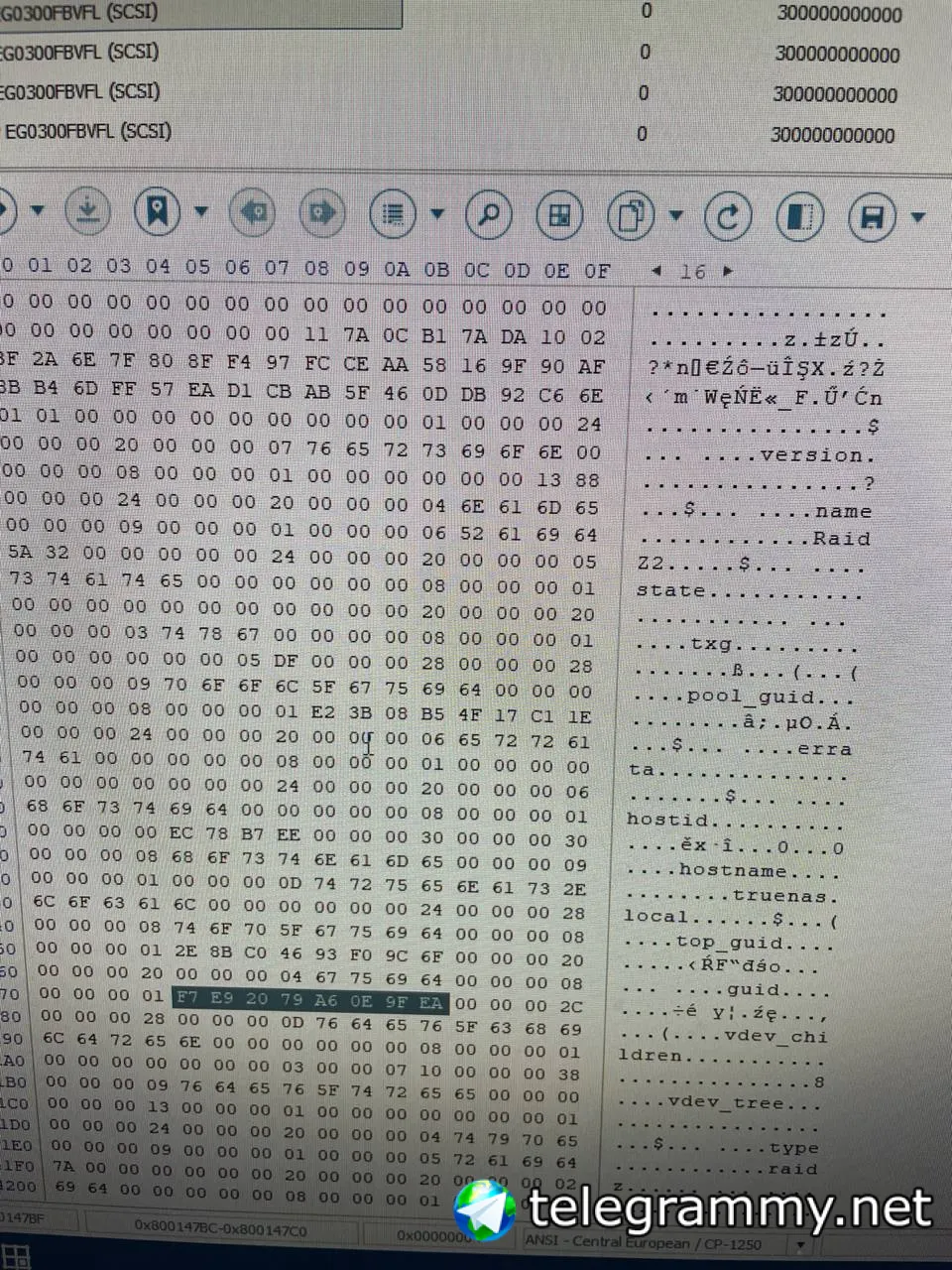

Столкнулись с аналогичной проблемой на ТруНас . После ребута, Pool из 3х vdev поломался . Причина ребута, все зависло при трансфере (бекапе данных) на другой пул. По горячим следам выяснилось что 1н из 3х vdev на всех дисках ерейзнулась (или не была вовсе никогда записана) таблица пулов и gptID дисков. На другом вдеве на 7 ми из 12 дисков таже история. Система работала по конфигурации пула сугубо из кеша, который после ребута слетел. Подключением дисков по ХБА и ручное восстановление таблиц пулов на всех дисках решило ситуацию. Благо один vdev0 был целый и сохранился ID пула. Файловая Zfs не пострадала.

Volodymyr

Volodymyr

Самое сложное было восстановить исходный порядок дисков слетевших вдевов, чтобы указать childrens в правильном порядке в восстанавливаемой таблице Пула

Ivan

Ivan

Ivan

Ivan

ХБА полка на 60 дисков СуперМикро Сас3

>Подключением дисков по ХБА и ручное восстановление таблиц

меня это смутило, будто изначально не hba был.

Volodymyr

Volodymyr

Я из сферы восстановления данных , мы клонили все диски и работали на копиях на своем оборудовании

Volodymyr

Volodymyr

Вопрос куда и как улетел кеш остался загадкой. Клиент после ребута удалил таргет пул на который бекапили данные и когда все зависло. Кеш мог оказаться на том пуле?

Denis

Denis

Столкнулись с аналогичной проблемой на ТруНас . После ребута, Pool из 3х vdev поломался . Причина ребута, все зависло при трансфере (бекапе данных) на другой пул. По горячим следам выяснилось что 1н из 3х vdev на всех дисках ерейзнулась (или не была вовсе никогда записана) таблица пулов и gptID дисков. На другом вдеве на 7 ми из 12 дисков таже история. Система работала по конфигурации пула сугубо из кеша, который после ребута слетел. Подключением дисков по ХБА и ручное восстановление таблиц пулов на всех дисках решило ситуацию. Благо один vdev0 был целый и сохранился ID пула. Файловая Zfs не пострадала.

самое интересное ситуация сегодня повторилась, только если вчера я пул хотя бы видел, сегодня его небыло, как будто совсем, пришлось откатится и пока на ext4 перейти

Volodymyr

Volodymyr

Проблема не в файловой zfs а какие-то баги в концепции хранения кеша у ТруНас/ФриНас . Возможно бутовая ссд или флеш память сбои дает.

Denis

Denis

Проблема не в файловой zfs а какие-то баги в концепции хранения кеша у ТруНас/ФриНас . Возможно бутовая ссд или флеш память сбои дает.

у нас блочка с me dell но судя по всему да проблема где то на стороне схд, т.к. с недавних пор это не единственные баги которые начали всплывать

Rodion

Rodion

Всем привет! Ламерский вопрос: сделал на RockyLinux 9 zfs pool в /opt/datapool, в нём filesystem fs1, экспортировал pool в /etc/export (/opt/datapool 192.168.25.0/24(rw,no_root_squash))

На клиенте монтирую шару mount -t nfs storage:/opt/datapool/fs1 /opt/destdbdata/, копирую туда файл иииии - не вижу его на машине storage

но при этом zfs list показывает, что отожралось место в datapool (?!) но не в datapool/fs1 (!!).

Как на машине-сервере увидеть файлы в пуле или ЧЯДнТ?

Sergey

Sergey

Всем привет! Ламерский вопрос: сделал на RockyLinux 9 zfs pool в /opt/datapool, в нём filesystem fs1, экспортировал pool в /etc/export (/opt/datapool 192.168.25.0/24(rw,no_root_squash))

На клиенте монтирую шару mount -t nfs storage:/opt/datapool/fs1 /opt/destdbdata/, копирую туда файл иииии - не вижу его на машине storage

но при этом zfs list показывает, что отожралось место в datapool (?!) но не в datapool/fs1 (!!).

Как на машине-сервере увидеть файлы в пуле или ЧЯДнТ?

надо смотреть в сторону crossmnt и nohide, т.к. это другой маунтпоинт внутри первого, то клиент nfs должен о нем знать и смаунтить, иначе он обращается к родительскому датасету

Art

Art

Всем привет! Ламерский вопрос: сделал на RockyLinux 9 zfs pool в /opt/datapool, в нём filesystem fs1, экспортировал pool в /etc/export (/opt/datapool 192.168.25.0/24(rw,no_root_squash))

На клиенте монтирую шару mount -t nfs storage:/opt/datapool/fs1 /opt/destdbdata/, копирую туда файл иииии - не вижу его на машине storage

но при этом zfs list показывает, что отожралось место в datapool (?!) но не в datapool/fs1 (!!).

Как на машине-сервере увидеть файлы в пуле или ЧЯДнТ?

Смотри, если у тебя в системе есть пул datapool, то по умолчанию есть и корневая файлосистема datapool

По умолчанию она монтируется как /datapool, но у тебя как я понял в /opt/datapool

И вот каталог /opt/datapool ты и экспортировал через НФС, как я вижу

Соответственно, файлы с клиента туда и попадают

Maksim

Maksim

Всем привет

Знаю что тупой вопрос, но все же, smr диски в зфс рейде на сколько плохая идея?

Какого объема? Каком рейде? Нужна ли производительность? Какие задачи?

Maksim

Maksim

Если условно фпйлопомойка с редкими записями, то smr скажется только когда диск сдохнет и ребилд надо будет делать

Сергей

Сергей

Какого объема? Каком рейде? Нужна ли производительность? Какие задачи?

Диски по 2тб, под файлохранилище и как полка под домашний сервер

Art

Art

Всем привет

Знаю что тупой вопрос, но все же, smr диски в зфс рейде на сколько плохая идея?

SMR-диски от Тошибы и Сигейта - плохая идея

SMR-диски от ВД - ОЧЕНЬ плохая идея

bes

bes

Всем привет! Ламерский вопрос: сделал на RockyLinux 9 zfs pool в /opt/datapool, в нём filesystem fs1, экспортировал pool в /etc/export (/opt/datapool 192.168.25.0/24(rw,no_root_squash))

На клиенте монтирую шару mount -t nfs storage:/opt/datapool/fs1 /opt/destdbdata/, копирую туда файл иииии - не вижу его на машине storage

но при этом zfs list показывает, что отожралось место в datapool (?!) но не в datapool/fs1 (!!).

Как на машине-сервере увидеть файлы в пуле или ЧЯДнТ?

/etc/exports не нужно делать. Zfs сама умеет это. Нужно только погуглить

Сергей

Сергей

Если условно фпйлопомойка с редкими записями, то smr скажется только когда диск сдохнет и ребилд надо будет делать

Вот, могут они выпасть из рейда при ребилде?

Не знаю как называется, нужен аналог рейд 6

Art

Art

Вот, могут они выпасть из рейда при ребилде?

Не знаю как называется, нужен аналог рейд 6

Аналог называется RAID-Z2

Производительность smr от ВД при ребилде (рисилвере в терминологии зфс) падает так, что ребилд оканчивается ошибкой

Сигейтовские и тошибовские smr кое-как, но ресилвер завершают

Это всё инфо на основании анекдотических свидетельств, в том числе и из этого чата

Art

Art

Вот, могут они выпасть из рейда при ребилде?

Не знаю как называется, нужен аналог рейд 6

Возможно, новые smr у ВД уже более лучше стали, но фз🤷🏻

Сергей

Сергей

Denis

Denis

Может кто по draid подсказать? работал работал и вдруг отвалился диск, ребилд проходит, запускаю clear на диске который отвалился уже в самом конце появлялись ошибки на запись, ну думаю ок, поеду заменю сата кабель, заменил кабель, ребилд прошел все отлично, начал работать с массивом теперь вывалились ошибки на чексуммы, снова хотспаре встал на замену того же диска

Собственно вопрос:

если например как закончился resilvering сделать detach диска на котором сейчас проблема с чексуммами, после чего как понимаю нужно сделать zpool labelclear чтоб очистить диск от меток zfs, дальше необходимо сбросить разметку gpt или не обязательно? и нужно ли клонировать разметку диска при его повторном добавлении в пул собственно replace?

Rodion

Rodion

/etc/exports не нужно делать. Zfs сама умеет это. Нужно только погуглить

А что надёжнее: силами zfs или через /etc/export ?

Δαρθ

Δαρθ

Силами зфс, тем более, что это интегрированная история

я например тоже не очень понимаю в чем профит.

например если часть шар силами зфс а часть стандартные (не с зфс)

а чтт будет с зфс-шарами если стандартные перезапустились? (нфс-демон рестартнулся)?

как по мне, в 3 раза больше гемора без видимых преимуществ

Fedor

Fedor

я например тоже не очень понимаю в чем профит.

например если часть шар силами зфс а часть стандартные (не с зфс)

а чтт будет с зфс-шарами если стандартные перезапустились? (нфс-демон рестартнулся)?

как по мне, в 3 раза больше гемора без видимых преимуществ

зфс еще удобна тем, что под каждую шару можно выделить свой датасет без лишних приседаний и специализировать его параметры под нагрузку именно на этой шаре