Алексей

Алексей

Порядок записи среднего слоя не гарантирует что старые данные будут записаны ранее новых

А что здесь средний слой?

Egor

Egor

Вариант отсутствия кеша не рассматривается - слишком медленно

Так он будет, просто его поведение было бы более предсказуемо с т.з. zfs

Fedor

Fedor

Зфс не поможет побороть законы физики.

Если иопсов нехватает, их не будет хватать и со всем остальным.

Lone

Lone

может расскажешь как ты убиваешь пул и что тебе пишет в ответ?)

Я об этом написал в первом сообщении:

```

# zpool destroy -f zroot

cannot unmount '/mnt/var/tmp': no such pool or dataset

could not destroy 'zroot': could not unmount datasets

```

Владимир

Владимир

Lone

Lone

А все датасеты этого пула отмонтированы?

Из документации:

Destroys the given pool, freeing up any devices for other use. This command tries to unmount any active datasets before destroying the pool.

Владимир

Владимир

Если размонтирование невозможно потому что фс чем-то занята оно не делает это принудительно)

Lone

Lone

FS ничего не делает. Это - инсталлятор. Он просто всё создает и монтирует. Я уже об этом писал.

Ругается то что dataset /var/tmp куда-то волшебным образом делся.

Владимир

Владимир

Lone

Lone

Можно вывод команды?

Уже нельзя :)

Это же инсталлятор, который я сам делаю.

Я уже 100500 раз всё переинсталлировал :)

Я нашёл минимальную конфигурацию и последовательность действий, которая не приводит к таким проблемам. Дальше буду пытаться её постепенно усложнять.

Спасибо за желание помочь!

Lone

Lone

This command _tries_ to unmount

Если что-то лишнее замонтировано, то zpool пишет, что пул is busy ...

Arseniy

Arseniy

Или купить батарейку

Есть ещё промежуточные варианты (пардон, если не прав). Серия MG у Тошиба позволяет "успеть" сбросить данные с кэша на диск в случае сбоя питания за счёт энергии, вырабатываемой при остановке шпинделя 😊

Arseniy

Arseniy

Есть ещё промежуточные варианты (пардон, если не прав). Серия MG у Тошиба позволяет "успеть" сбросить данные с кэша на диск в случае сбоя питания за счёт энергии, вырабатываемой при остановке шпинделя 😊

Но тут вопрос другой, интересный. Сам имею такую Тошибу в зеркале, а в зеркале - Хитачи, который этой опции не имеет. И вот тут уже вопрос, как сработает zfs. Номинально, оба контроллера сообщат, что все записано. Но Тошиба реально запишет, а вот Хитачи - нет. И что потому будет при первом же scrub - вопрос. Я планирую в ближайшее время провести такой эксперимент, дополнительно сообщу о результатах

Fedor

Fedor

Nikolay

Nikolay

hi! Делаю сервер под бэкапы(линейная запись и немного чтения). Сейчас в пуле один vdev на 12*14T дисков(ST16000NM001G-2K) RAIDZ2, потом ещё два таких-же vdev`a добавится. Есть в сервере ещё два SSD 1,7Tb(XS1920SE10103). Вот эти ssd как лучше употребить? Под кэш(l2arc) или собрать special vdev? Большинство ФС в пуле будут с recordsize 1M и компрессией, на парочке сделаю мешьший recordsize и дедуп.

Nikolay

Nikolay

в мане про special vdev пишут, что если у меня raidz2, то и special vdev с таким же raidz2 типом собирать. Насколько это не best practice если special vdev из двух дисков в зеркале собрать?

A device dedicated solely for allocating various kinds of internal metadata, and

optionally small file blocks. The redundancy of this device should match the

redundancy of the other normal devices in the pool.

Nikolay

Nikolay

Я думаю что "избыточность" != "тип пула" Всегда в зеркало собираю special, для raidz в том числе.

Nikolay

Nikolay

Я думаю что "избыточность" != "тип пула" Всегда в зеркало собираю special, для raidz в том числе.

при добавлении ругается на это

zpool add ztank special mirror /dev/sda /dev/sdb

invalid vdev specification

use '-f' to override the following errors:

mismatched replication level: pool and new vdev with different redundancy, raidz and mirror vdevs, 2 vs. 1 (2-way)

Nikolay

Nikolay

при добавлении ругается на это

zpool add ztank special mirror /dev/sda /dev/sdb

invalid vdev specification

use '-f' to override the following errors:

mismatched replication level: pool and new vdev with different redundancy, raidz and mirror vdevs, 2 vs. 1 (2-way)

У меня такого не было. Возможно надо три диска в зеркало таком случае (судя по ошибке), тогда будет 2 и 2.

Не думаю что это критично, можно -f использовать.

Алексей

Алексей

Алексей

Алексей

Это я как обладатель аналогичного сетапа с дедупом и вдев под дедуп имеющего ответственно заявляю.

Nikolay

Nikolay

Это я как обладатель аналогичного сетапа с дедупом и вдев под дедуп имеющего ответственно заявляю.

а что с дедупом не так? Медленно работает?

Ivan

Ivan

Очень много. И чем больше данных накоплено тем больше

Интересно, VDO такой проблеме тоже подвержен ?

CARA

CARA

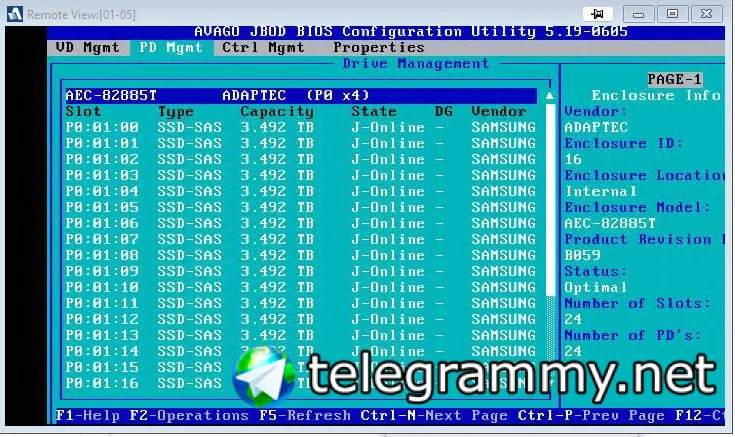

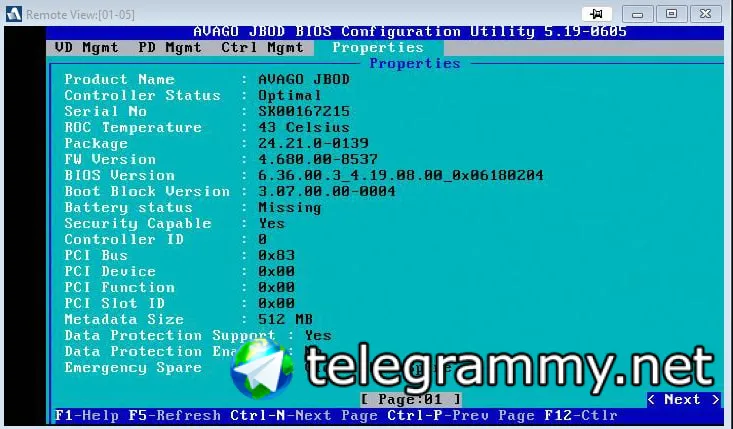

Здравствуйте,скажите пожалуйста Jbod и zfs совместим? Что делать когда у тебя контроллер 9361-4i avago?

ivdok

ivdok

Здравствуйте,скажите пожалуйста Jbod и zfs совместим? Что делать когда у тебя контроллер 9361-4i avago?

Шить в IT mode, это LSI'ный контроллер с другим шильдиком. Но я вижу пока только на 8i прошивки, глубоко в гугле не рылся

CARA

CARA

Шить в IT mode, это LSI'ный контроллер с другим шильдиком. Но я вижу пока только на 8i прошивки, глубоко в гугле не рылся

Тоже не нашёл прошивку(вот и думаю как быть(

Aba

Aba

Тоже не нашёл прошивку(вот и думаю как быть(

На сайте lsi еслиьпорыться - можно найти прошивку, как под i4, так и под i8. Ну или на сайтах аваго, делл и прочей нечисти как вариант. Под i4 я точно видел, а вот под i16 уже не скажу

Art

Art

Здравствуйте,скажите пожалуйста Jbod и zfs совместим? Что делать когда у тебя контроллер 9361-4i avago?

Блинский, на форуме Трунаса был офигенный список апробированных контроллеров, но чёт найти не могу

Отвечая на вопрос, должен сказать, что лично я так и не понял что такое JBOD-режим у рейд-контроллеров

То ли это синоним HBA, то ли не всегда...

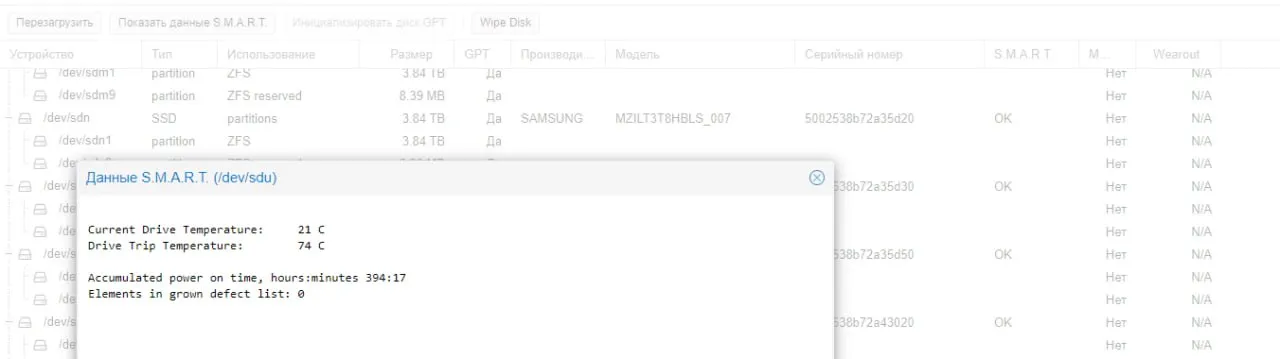

Вот, скажем, в каком виде у тебя система видит диски, подключенные через эту железяку? В /dev/disks/ всм

И получает ли система смарты с дисков?

CARA

CARA

Блинский, на форуме Трунаса был офигенный список апробированных контроллеров, но чёт найти не могу

Отвечая на вопрос, должен сказать, что лично я так и не понял что такое JBOD-режим у рейд-контроллеров

То ли это синоним HBA, то ли не всегда...

Вот, скажем, в каком виде у тебя система видит диски, подключенные через эту железяку? В /dev/disks/ всм

И получает ли система смарты с дисков?

Georg🎞️🎥

Georg🎞️🎥

Блинский, на форуме Трунаса был офигенный список апробированных контроллеров, но чёт найти не могу

Отвечая на вопрос, должен сказать, что лично я так и не понял что такое JBOD-режим у рейд-контроллеров

То ли это синоним HBA, то ли не всегда...

Вот, скажем, в каком виде у тебя система видит диски, подключенные через эту железяку? В /dev/disks/ всм

И получает ли система смарты с дисков?

Я лично предпочитаю купить готовый )) на алике оч дешево, да и в россси тоже . Все продается шитое

CARA

CARA

Я лично предпочитаю купить готовый )) на алике оч дешево, да и в россси тоже . Все продается шитое

Я так понимаю что мне нужен SAS expander обычный ну пойду хоть на авито с озоном поруюсь)От 12к цена вижу только)

Georg🎞️🎥

Georg🎞️🎥

Я так понимаю что мне нужен SAS expander обычный ну пойду хоть на авито с озоном поруюсь)От 12к цена вижу только)

Так стоп

Сколько у вас дисков ?

Где они - в полке или внутри сервера ?

Внутри сервера обычно есть бэкплейн, по которому ясно, как подрубить )

Art

Art

Я так понимаю что мне нужен SAS expander обычный ну пойду хоть на авито с озоном поруюсь)От 12к цена вижу только)

Да не, LSI 9211-8i проверенный вариант, б/у шный 5к с оплатой по безналу, смотри на Авито

CARA

CARA

Georg🎞️🎥

Georg🎞️🎥

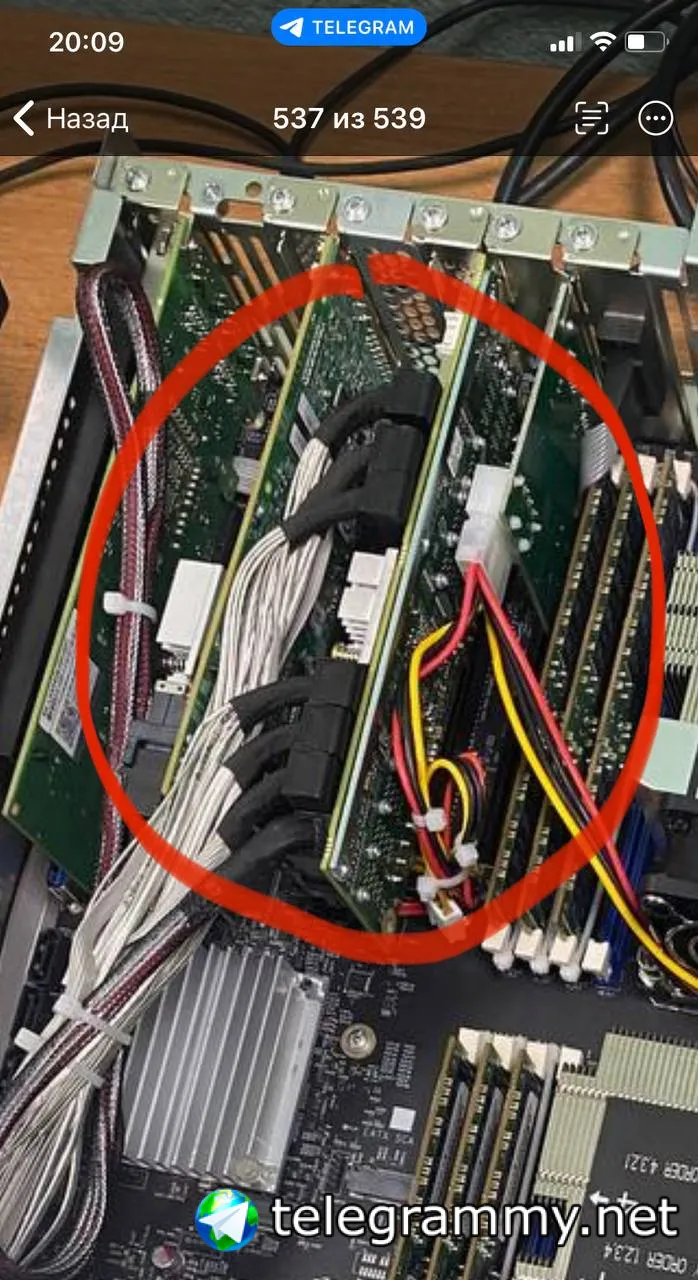

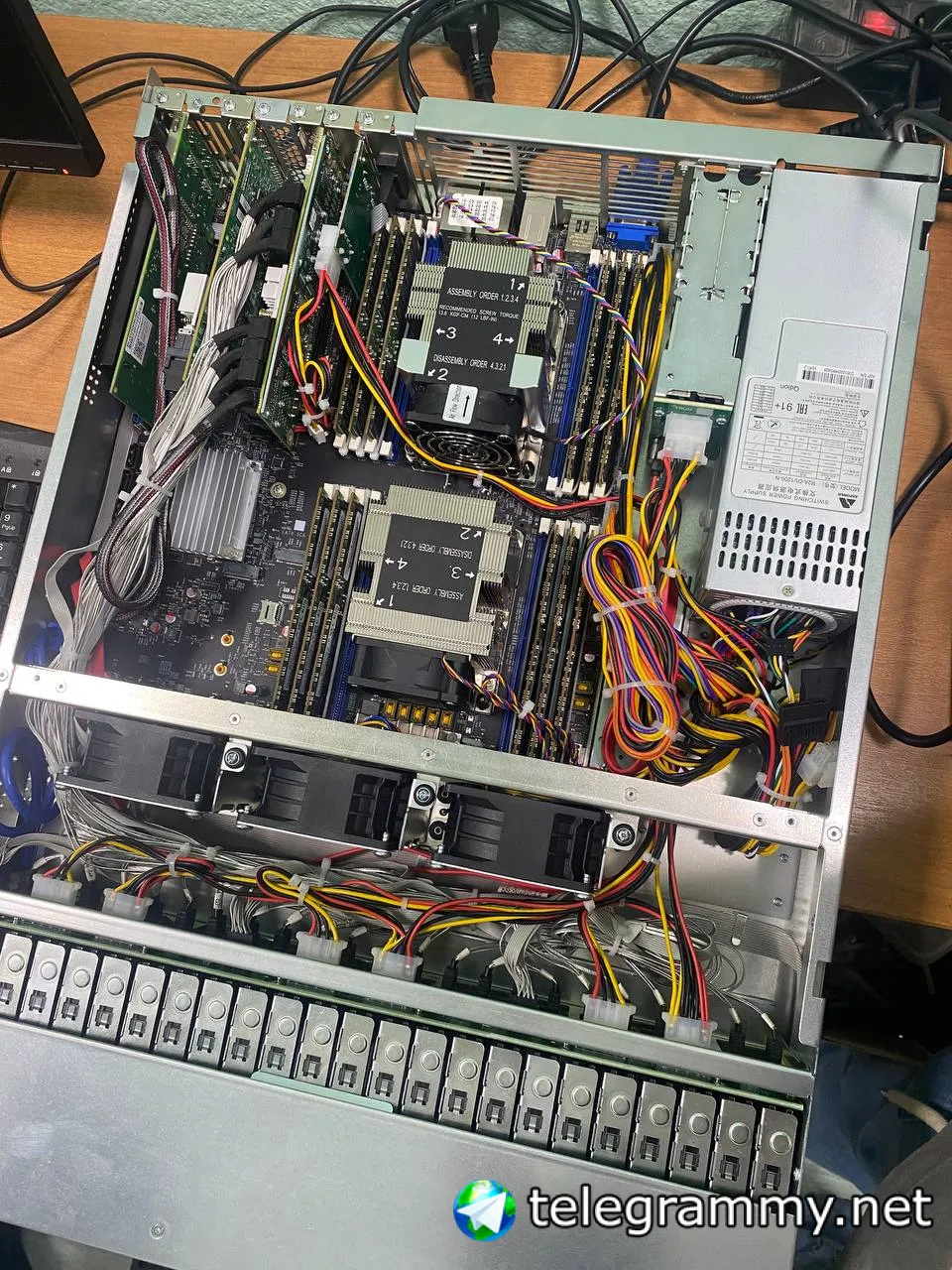

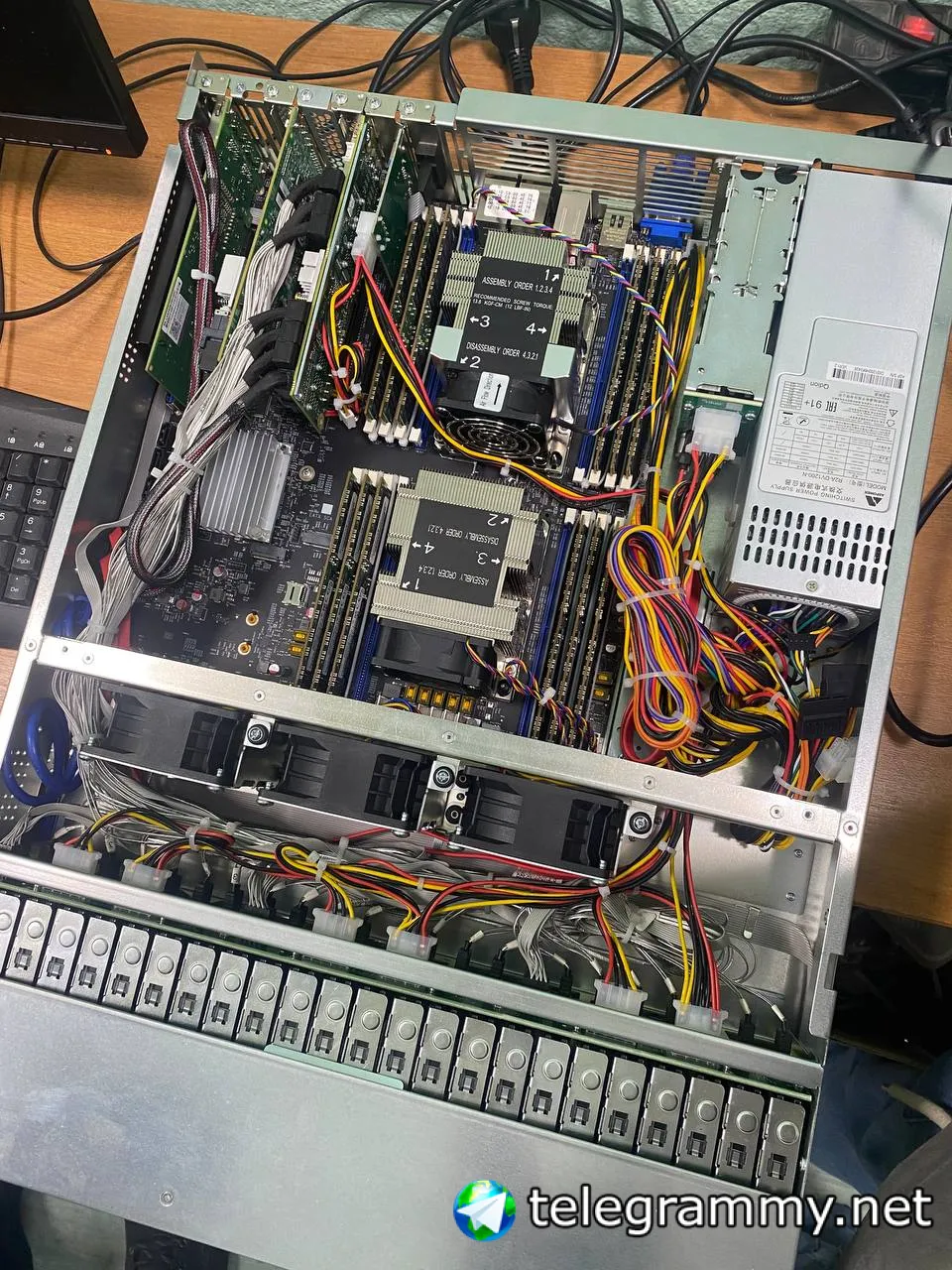

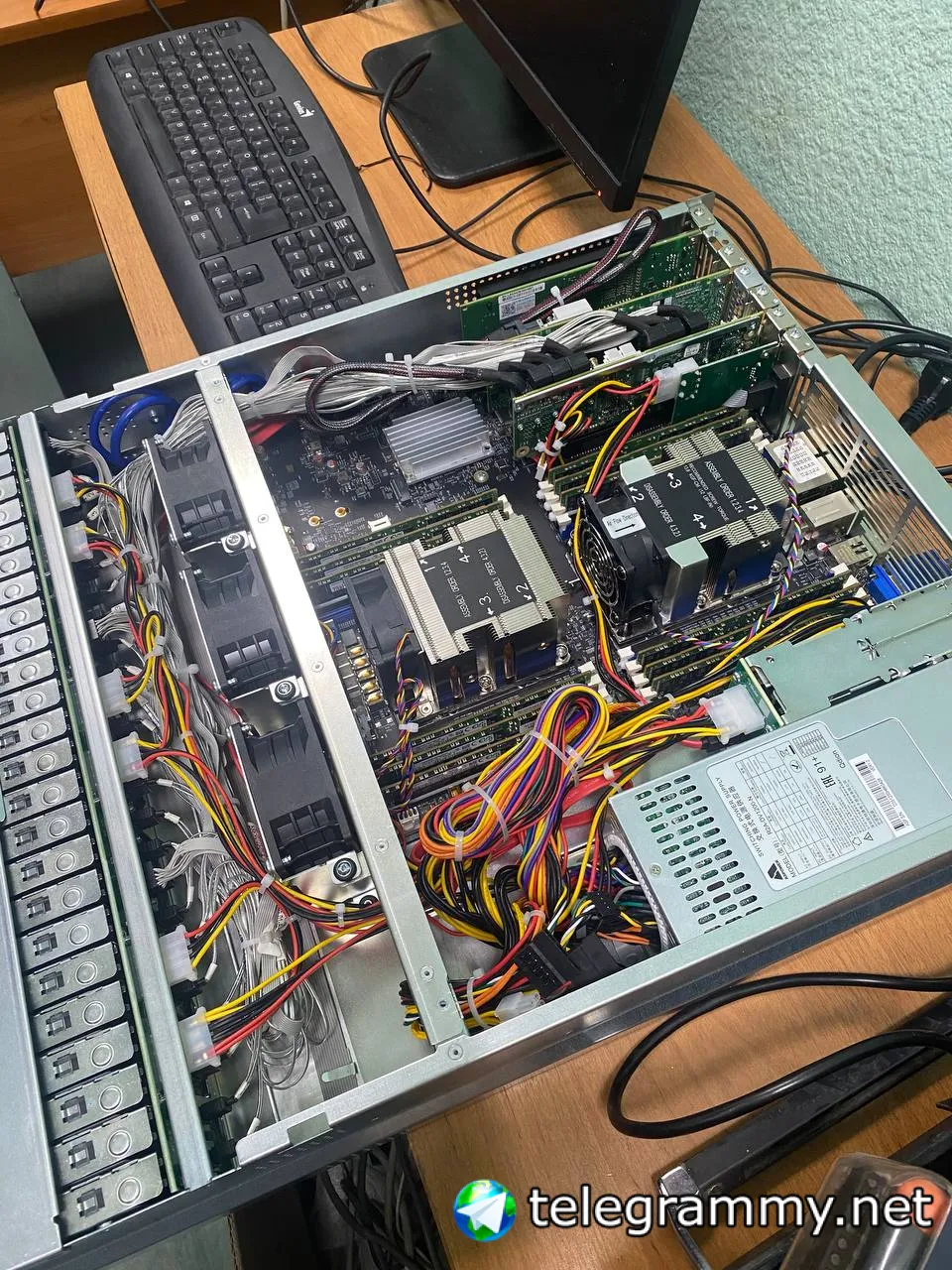

24 внутри сервера

Скорее всего к плате , в которую втыкают диски , идет ну два провода mini sas, а эспандер вшитый . Есть возможность посмотреть ?

Art

Art

Я лично предпочитаю купить готовый )) на алике оч дешево, да и в россси тоже . Все продается шитое

Согласен, я бы тоже не рисковал с непонятным вариантом... HBA один из важнейших элементов хорошей ZFS-хранилки

Georg🎞️🎥

Georg🎞️🎥

Согласен, я бы тоже не рисковал с непонятным вариантом... HBA один из важнейших элементов хорошей ZFS-хранилки

У вас скорее всего 6гигабитный бэкплейн

Может вам и 16i нужен контролер 🤔

На 24 8i маловато

CARA

CARA

Georg🎞️🎥

Georg🎞️🎥

Не это аваго)Мега рейд)Я же захожу настраиваю)Диски же видит к нему подключены)Щас ребутну через квп зайду скрин пришлю)

Одно подключение - это сколько винтов ? 4 ?

Может придется 2 hba ставить )))

CARA

CARA

Одно подключение - это сколько винтов ? 4 ?

Может придется 2 hba ставить )))

А вот тут не скажу(((Вроде 4

Georg🎞️🎥

Georg🎞️🎥

А вот тут не скажу(((Вроде 4

На аваге 8 подключений вроде 🤔и от каждого похоже провод на 4 винта

Это ж 2,5 ?

Georg🎞️🎥

Georg🎞️🎥

Да 2.5

CARA

CARA

Artem

Artem

central

central

Vladislav

Vladislav