Georg🎞️🎥

Georg🎞️🎥

Уже не первый раз спрашиваете) даже отвечал раньше. Протестить проще всего вам будет)

Простите мою невнимательность 👋👋🤦♂️… не могу вспомнить , что в итоге … возьму пару ssd тогда для теста … согласен ..👋

Скажете, а по командам по arc2, ссылки на которые вы дали, требуется ли ребут систем ?👋👋👋

Какой то разницы не увидел в принуждение к заполнению arc2 ))

George

George

Простите мою невнимательность 👋👋🤦♂️… не могу вспомнить , что в итоге … возьму пару ssd тогда для теста … согласен ..👋

Скажете, а по командам по arc2, ссылки на которые вы дали, требуется ли ребут систем ?👋👋👋

Какой то разницы не увидел в принуждение к заполнению arc2 ))

только учтите что именно special vdev просто так нельзя вывести из пула после добавления

George

George

Простите мою невнимательность 👋👋🤦♂️… не могу вспомнить , что в итоге … возьму пару ssd тогда для теста … согласен ..👋

Скажете, а по командам по arc2, ссылки на которые вы дали, требуется ли ребут систем ?👋👋👋

Какой то разницы не увидел в принуждение к заполнению arc2 ))

если вы про noprefetch, то не нужен ребут

Georg🎞️🎥

Georg🎞️🎥

только учтите что именно special vdev просто так нельзя вывести из пула после добавления

У меня тестовый сервер пока , я на нем 13 трунас гоняю, перед переходом основного с 11 на 13👋👋спасибо

George

George

Олег

Олег

У меня тестовый сервер пока , я на нем 13 трунас гоняю, перед переходом основного с 11 на 13👋👋спасибо

трансы, zfs ммммм, не оптимальный выбор если на запись

Georg🎞️🎥

Georg🎞️🎥

если вы про noprefetch, то не нужен ребут

Дада про него

Включил …

Прогнал несколько терабайт рендера видео - пока не увидел разницы 🤔 видать префетч сам хорошо тащит

Georg🎞️🎥

Georg🎞️🎥

трансы, zfs ммммм, не оптимальный выбор если на запись

На чтение 👋на запись просто в него несколько тер сливаем 🤔

George

George

Дада про него

Включил …

Прогнал несколько терабайт рендера видео - пока не увидел разницы 🤔 видать префетч сам хорошо тащит

ну если повторного доступа до тех же блоков данных нет, то разницы не будет

Georg🎞️🎥

Georg🎞️🎥

ну если повторного доступа до тех же блоков данных нет, то разницы не будет

А я отрендерил три раза один и тож же блок данных на полтора тера )))

Олег

Олег

На чтение 👋на запись просто в него несколько тер сливаем 🤔

что чтение что запись.... Для видео смысла в ZFS нет, там нечего сжимать и важна скорость

George

George

А я отрендерил три раза один и тож же блок данных на полтора тера )))

за полтора тера данные могли вымыться просто из кеша, да

Georg🎞️🎥

Georg🎞️🎥

что чтение что запись.... Для видео смысла в ZFS нет, там нечего сжимать и важна скорость

Это вы как установили ?

Можете предложить альтернативу ?

А мне сжимать не надо и часто читаем одни и те же данные - то бишь кэш , не вижу минусов 🤷🏻♂️

George

George

что чтение что запись.... Для видео смысла в ZFS нет, там нечего сжимать и важна скорость

в zfs не только сжатие есть) и часто для видео NAS как раз таки и юзают

Georg🎞️🎥

Georg🎞️🎥

в zfs не только сжатие есть) и часто для видео NAS как раз таки и юзают

Много кто из коллег в видео производстве zfs используют да, не с потолка же я его взял :))))

Georg🎞️🎥

Georg🎞️🎥

в zfs не только сжатие есть) и часто для видео NAS как раз таки и юзают

Жирный нас на пром свичах и оптике )))

Олег

Олег

Ну видать кешь дешов для них или задачи читать одно и тоже))) У меня пишется 50 мбит и вещается 400, на zfs просто загнется на том на чем сейчас работает, пробовал уже

George

George

Жирный нас на пром свичах и оптике )))

ага, именно. бОльшая часть данных обычно лежит потом, ждёт своего часа

Олег

Олег

ага, именно. бОльшая часть данных обычно лежит потом, ждёт своего часа

у меня таких данных уже 150TB, но та такая помойка на ZFS с микрокешем

Georg🎞️🎥

Georg🎞️🎥

Ну видать кешь дешов для них или задачи читать одно и тоже))) У меня пишется 50 мбит и вещается 400, на zfs просто загнется на том на чем сейчас работает, пробовал уже

Georg🎞️🎥

Georg🎞️🎥

Ну видать кешь дешов для них или задачи читать одно и тоже))) У меня пишется 50 мбит и вещается 400, на zfs просто загнется на том на чем сейчас работает, пробовал уже

Я когда закидываю материял - он на все 10 гигабит стабильно пишет 🤷🏻♂️

George

George

Ну видать кешь дешов для них или задачи читать одно и тоже))) У меня пишется 50 мбит и вещается 400, на zfs просто загнется на том на чем сейчас работает, пробовал уже

тут надо смотреть как вещаете. На CDN для вещания обычно есть кеши жирные на горячие вещи, да. Но на ZFS 100 иопсов с блина получить да можно

Georg🎞️🎥

Georg🎞️🎥

на HDD? без ssd кешей?

Да, отключил ssd cash на продакшена - ничего не даёт. Когда пачку дисков пишу - штук пять - он весь канал забивает и стабильно держит сковорость👋

George

George

на hdd zfs как раз на запись кстати может делать mdadm+что-то, рандомная запись примерно в случайную аггрегируется

Georg🎞️🎥

Georg🎞️🎥

на hdd zfs как раз на запись кстати может делать mdadm+что-то, рандомная запись примерно в случайную аггрегируется

Не могли бы это по другому сказать ))) не понял вас )))

George

George

Не могли бы это по другому сказать ))) не понял вас )))

в zfs асинхронная запись пишется одной транзакцией регулярно, любая рандомная запись в ней (в txg) может быть записана разом оптом, примерно последовательно на диск

Georg🎞️🎥

Georg🎞️🎥

с удавольствем узнал бы

У нас видео производство.

Поэтому жирные видео файлы , потоковое чтение, 10gb канал👋

Мне хватает sas2 hba шек

На 16 портовом hba висят 50 Блинов sas в пяти ведевах

1M размер сектора

Никаких сжатий - все отключено нафиг. Aptime и синхронная запись тоже выключены.

Расширено по 10 х2 Intel 520.

Свич промышленный dell, это важно - хорошо прокапчивает наши объемы.🤷🏻♂️ssd кэш пока то не быстрее пула )) не вижу профита в потоковом чтении у нас )) памяти помогает похоже )) стоит 200, на запасном сервере 400 - позже введу в эсксплуатауию

Старых sas2 hba хватает как уже сказал ))

Подробные вопросы можете в личку кидать👋я не глубоко погружён - но для своих потребностей вроде получилось собрать ))

Да, шаримся по smb, Mac OS у нас

Олег

Олег

У нас видео производство.

Поэтому жирные видео файлы , потоковое чтение, 10gb канал👋

Мне хватает sas2 hba шек

На 16 портовом hba висят 50 Блинов sas в пяти ведевах

1M размер сектора

Никаких сжатий - все отключено нафиг. Aptime и синхронная запись тоже выключены.

Расширено по 10 х2 Intel 520.

Свич промышленный dell, это важно - хорошо прокапчивает наши объемы.🤷🏻♂️ssd кэш пока то не быстрее пула )) не вижу профита в потоковом чтении у нас )) памяти помогает похоже )) стоит 200, на запасном сервере 400 - позже введу в эсксплуатауию

Старых sas2 hba хватает как уже сказал ))

Подробные вопросы можете в личку кидать👋я не глубоко погружён - но для своих потребностей вроде получилось собрать ))

Да, шаримся по smb, Mac OS у нас

200-400gb озу на хранилку конечно сильно. Спвсибо за ответы, нужно сильно потестировать многое из вашего, один smb чего стоит. Свитч нексус у нас, диски сата обычные. Вектор тестов понял - Спасибо огромное

Georg🎞️🎥

Georg🎞️🎥

200-400gb озу на хранилку конечно сильно. Спвсибо за ответы, нужно сильно потестировать многое из вашего, один smb чего стоит. Свитч нексус у нас, диски сата обычные. Вектор тестов понял - Спасибо огромное

У меня сас☝🏻он больше команд умеет

Ну да озу много - видео ж, я б 700 воткнул , как осилю 24 плашки по 32)))

Ну смб клёво и просто )))🤷🏻♂️

Олег

Олег

Georg🎞️🎥

Georg🎞️🎥

смб2 да круто, не отваливается?

Ни разу , ещё с 20года и на 11 фринасе. Ну камни два ксенона соответсвенно

Arseniy

Arseniy

George

George

Arseniy

Arseniy

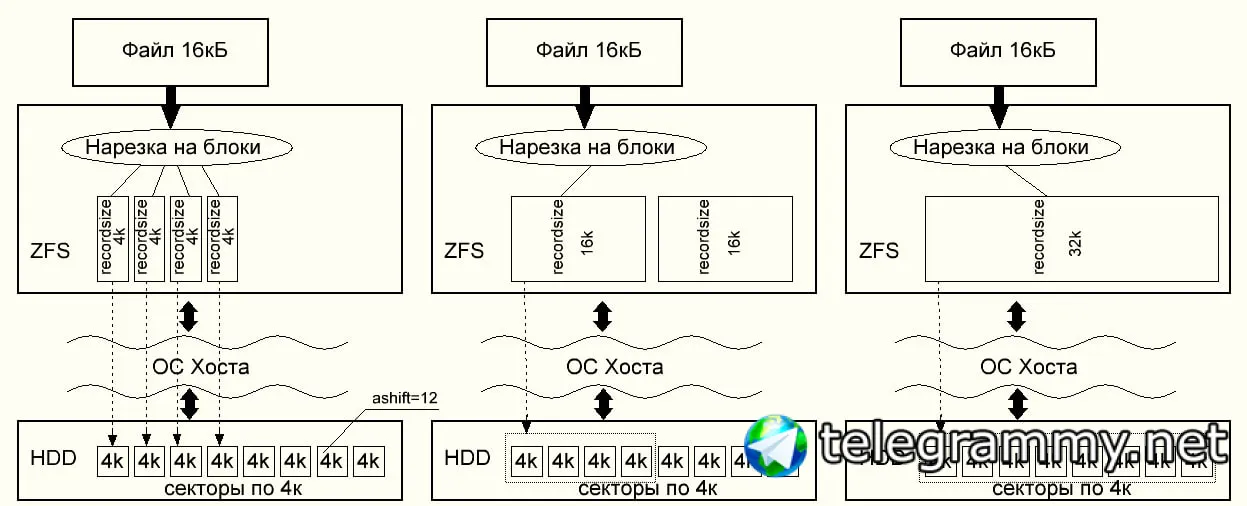

Тогда что мешает по дефолту ставить как можно больший rexordsize, если места он лишнего не сожрёт, а количество операций записи уменьшится?

George

George

Тогда что мешает по дефолту ставить как можно больший rexordsize, если места он лишнего не сожрёт, а количество операций записи уменьшится?

доступ даже к 1 байту требует весь блок

George

George

128к по дефолту норм по причине того, что латенси доступа к 4к и к 128к на HDD отличается всего процентов на 5

Arseniy

Arseniy

Что-то я не пойму тогда, если блок=128кБ, в блоке лежит файл 16кБ, блок реально "весит" 16кБ, но читается всё равно все 128, так выходит?

George

George

Что-то я не пойму тогда, если блок=128кБ, в блоке лежит файл 16кБ, блок реально "весит" 16кБ, но читается всё равно все 128, так выходит?

нет, это частный случай когда файл меньше рекордсайза

Vladislav

Vladislav

Arseniy

Arseniy

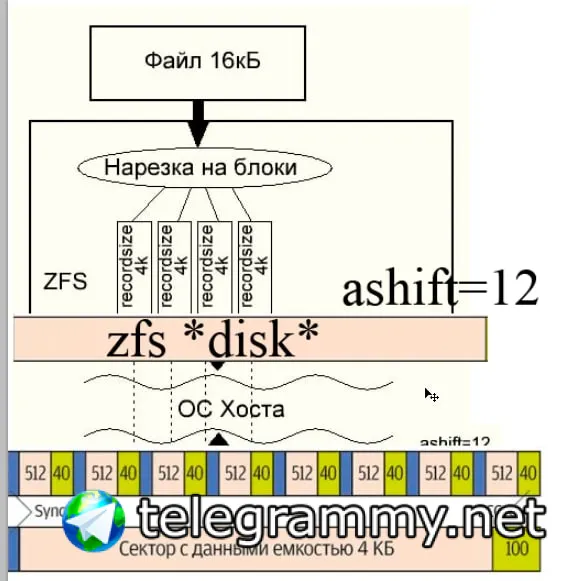

я просто указал, что в данном случае, если диск имеет размер сектора 4кБ, установлен ashift=12. Не более

George

George

Ну, в рамках этого частного случая, так и получается...

нет, я уже несколько раз писал что если файл меньше рекордсайса то он займёт свой размер (16к в данном случае) кратно размеру сектора (4к)

Vladislav

Vladislav

Vladislav

Vladislav

Что-то я не пойму тогда, если блок=128кБ, в блоке лежит файл 16кБ, блок реально "весит" 16кБ, но читается всё равно все 128, так выходит?

При обращении к файлу будет прочитан весь блок с этим файлом, при записи этот блок будет ещё и весь перезаписан

Arseniy

Arseniy

Ок, увеличивая recordsize мы можем оптимизировать работу ФС для работы с большими файлами, но снизить производительность при работе с файлами, размер которых ниже recorsize-блока.

С дисками тягомотина... Физически - 4к, есть некая "прослойка", сообщающая системе, что сектора 512б. И как он запишет физически 512б, если сектор 4к? Записанные 512б займут весь сектор?

Vladislav

Vladislav

Vladislav

Vladislav

Ок, увеличивая recordsize мы можем оптимизировать работу ФС для работы с большими файлами, но снизить производительность при работе с файлами, размер которых ниже recorsize-блока.

С дисками тягомотина... Физически - 4к, есть некая "прослойка", сообщающая системе, что сектора 512б. И как он запишет физически 512б, если сектор 4к? Записанные 512б займут весь сектор?

Нет,точно так как и на ZFS они займут 512

Vladislav

Vladislav

Arseniy

Arseniy

Будет

В чем? Если с точки зрения прослойки, что в лоб, что по лбу - логические 512б, физически 4кб. Работа идёт через сектора 512б. В одном случае, будет вызвано 8 операций на запись/чтение, в другом - 1 операция (которая скрывает в прослойке те же 8 операций))

Vladislav

Vladislav

Контроллер на диске всегда считывает 4к сектор, поэтому если мы со стороны ashift говорим что там тоже 4к, то контроллер считывая весь сектор на 4 (и оставляя его в кэше диска) отдаст в итоге целиком весь сектор на 4к

Arseniy

Arseniy

Контроллер на диске всегда считывает 4к сектор, поэтому если мы со стороны ashift говорим что там тоже 4к, то контроллер считывая весь сектор на 4 (и оставляя его в кэше диска) отдаст в итоге целиком весь сектор на 4к

То бишь, мы перегрузим ОЗУ лишней частью из 7х512б, вместо того, чтобы забрать нужные 1х512б, так?

Vladislav

Vladislav

То бишь, мы перегрузим ОЗУ лишней частью из 7х512б, вместо того, чтобы забрать нужные 1х512б, так?

Это буде так только если мы будем пытаться работать с файлами меньше ashift

Vladislav

Vladislav

То бишь, мы перегрузим ОЗУ лишней частью из 7х512б, вместо того, чтобы забрать нужные 1х512б, так?

К примеру, создав текстовый файлик в ASCII с содержимым 0123456789. Тогда чтобы его считать мы отправим запрос на recordsize (4k), затем на zfs disk, затем 8 секторов по 512, чтобы контроллер диска считал 4к сектор. И контроллер диска считает 4к, отдаст их по 512, нам вернётся сектор 4к с zfs disk, чтобы потом вернуть recordsize, из которого нам нужно будет только 10 байт

Vladislav

Vladislav

То бишь, мы перегрузим ОЗУ лишней частью из 7х512б, вместо того, чтобы забрать нужные 1х512б, так?

P.S. ОЗУ контроллера диска, не ПК*

Georg🎞️🎥

Georg🎞️🎥

Как вычислить размер для спешл ? ))) и я так понимаю , он должен быть максимально быстрый ?👋👋👋

Vladislav

Vladislav