Я не знаю, что это. 😭, какой то сервак мониторинга да ?

Он самый

Sergey

Sergey

@Riv1329 Наблюдаю теперь какие то проблемы с производительностью, при записи скорость скачет от 200мб/с и опускается до нуля... Может есть идеи?

riv

riv

@Riv1329 Наблюдаю теперь какие то проблемы с производительностью, при записи скорость скачет от 200мб/с и опускается до нуля... Может есть идеи?

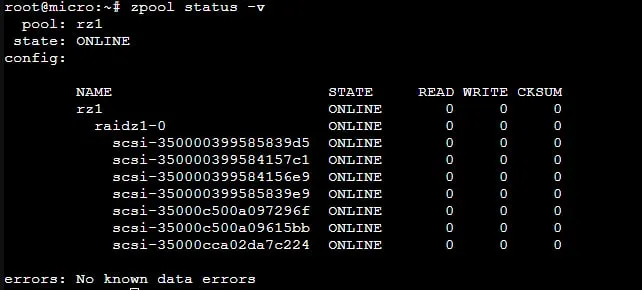

Напомните как устроен пул? zpool status -v

Владимир

Владимир

@Riv1329 Наблюдаю теперь какие то проблемы с производительностью, при записи скорость скачет от 200мб/с и опускается до нуля... Может есть идеи?

ну ты выбрал вычислительный рейд и твой пул состоит из одного vdev, ВНЕЗАПНО для многих, как и для меня когда-то НЕТ никакого параллелизма записи на диски внутри vdev, запись последовательна и число дисков в vdev не увеличивает скорость. У Вас будет скорость самого медленного устройства в vdev

Владимир

Владимир

для сравнения обычный RAID5 mdadm или хардварный при записи распалаллеливат запросы на диски и при этом примерно кратно получается увеличить скорость, в прочем ещё зависит от ряда парметров, но в любом случае прирост там имеется, тут нет))

Sergey

Sergey

ну ты выбрал вычислительный рейд и твой пул состоит из одного vdev, ВНЕЗАПНО для многих, как и для меня когда-то НЕТ никакого параллелизма записи на диски внутри vdev, запись последовательна и число дисков в vdev не увеличивает скорость. У Вас будет скорость самого медленного устройства в vdev

Диски все быстрые... Не до нуля же...

Владимир

Владимир

Диски все быстрые... Не до нуля же...

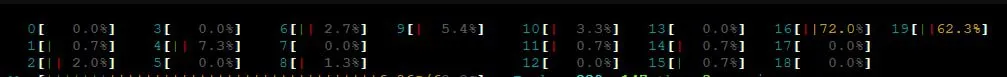

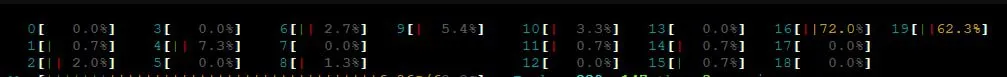

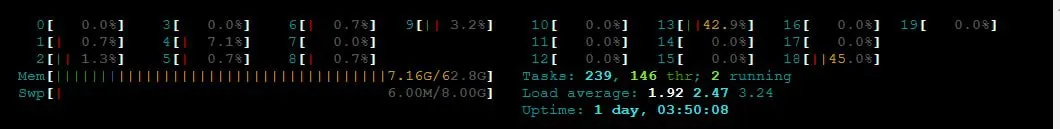

смотри в htop потребляет что-то проц?, у тебя рейд вычислительный, я незнаю какую нагрузку создаёт втой вариант, сколько ему позволено есть потоков и на сколько мощный у тебя проц)

Ну и собственно смотри статистику по IO

Владимир

Владимир

+ ещё бывает что экономные ребята такие как ты)), которые хотят много места)), ставят сжатие на пул такое что проц просто охреневает))

Sergey

Sergey

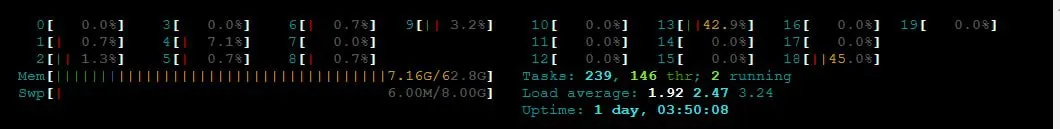

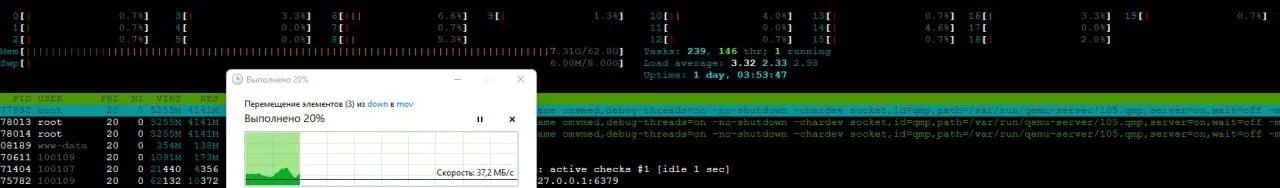

нагрузки на проц вроде не много, сжати lz4. Проц 2690v2, памяти откушал зфс примерно 30гб.... Проц нагружен на 8-10% всего.

Владимир

Владимир

нагрузки на проц вроде не много, сжати lz4. Проц 2690v2, памяти откушал зфс примерно 30гб.... Проц нагружен на 8-10% всего.

проц конечно так себе, но с lz4 должен на ура справиться на мой взгляд,...

А есть в htop процессы выедающие одно ядро целиком?...

Владимир

Владимир

в момент нагрузки и просадки, а ещё какой LA у сервера в этот момент?

Какое колличество запущенных процессов?

Много ли красноты в ядрах?

Ну и вообще какой цвет в ядрах преобладает в момент нагрузки?

Ну или просто скрин htop в момент проблемы

Владимир

Владимир

Проверить режим работы процессора

Debian

cat /sys/devices/system/cpu/cpufreq/policy*/scaling_governor

Centos

cat /sys/devices/system/cpu/cpu*/cpufreq/scaling_governor

#cat

riv

riv

Диски все быстрые... Не до нуля же...

Нужно в проксмокс убрать все виды кэшерования qemu и поставить лимит на iops и на линейную запись чуть меньше, чем может пул.

До нуля падает скорость когда пул не справляется. Из-за особенностей zfs, у вас виртуальная машина в первую секунду забивает writeback-буфер, а потом скорость 0, т.к буфер забит, пока он не сбросится на диск.

Владимир

Владимир

Нужно в проксмокс убрать все виды кэшерования qemu и поставить лимит на iops и на линейную запись чуть меньше, чем может пул.

До нуля падает скорость когда пул не справляется. Из-за особенностей zfs, у вас виртуальная машина в первую секунду забивает writeback-буфер, а потом скорость 0, т.к буфер забит, пока он не сбросится на диск.

вот кстати если дело в буфере, то если я не ошибаюсь в ОЗУ будет синее

Sergey

Sergey

а ещё сколько ядер в htop отображается?

И в каком режиме работает проц?

Владимир

Владимир

Владимир

Владимир

riv

riv

вот кстати если дело в буфере, то если я не ошибаюсь в ОЗУ будет синее

Zfs выглядит в htop как зеленая полоска, к сожалению. Но подчиняется команде очистки буфера.

Но я писал не об этом. Qemu-буфер может усугубить ситуацию но и без него будет падать до нуля. Сама zfs, если нет синхронных вызовов, принимает данные в свой внутрений writeback-буфер с бесконечной скоростью, пока он не заполнится. По этому, его всегда можно прогрузить, достаточно лить данные на диск не останавливаясь.

Владимир

Владимир

Владимир

Владимир

Zfs выглядит в htop как зеленая полоска, к сожалению. Но подчиняется команде очистки буфера.

Но я писал не об этом. Qemu-буфер может усугубить ситуацию но и без него будет падать до нуля. Сама zfs, если нет синхронных вызовов, принимает данные в свой внутрений writeback-буфер с бесконечной скоростью, пока он не заполнится. По этому, его всегда можно прогрузить, достаточно лить данные на диск не останавливаясь.

Zfs выглядит в htop как зеленая полоска, к сожалению. Но подчиняется команде очистки буфера.

абсолютно верно, но когда ты заговорил про буферы, буферы ядра они синие вроде как

riv

riv

вот кстати если дело в буфере, то если я не ошибаюсь в ОЗУ будет синее

Ну а чем мешает падение скорости до 0, вначале то скорость огого, в сумме быстрее выходит, т.к. writeback?

Владимир

Владимир

Zfs выглядит в htop как зеленая полоска, к сожалению. Но подчиняется команде очистки буфера.

Но я писал не об этом. Qemu-буфер может усугубить ситуацию но и без него будет падать до нуля. Сама zfs, если нет синхронных вызовов, принимает данные в свой внутрений writeback-буфер с бесконечной скоростью, пока он не заполнится. По этому, его всегда можно прогрузить, достаточно лить данные на диск не останавливаясь.

и если не хватает скорости записи, то будет много красного в проце, так как будут процессы уровня ядра которые будут медленно писать инфу, но у него нет много красноты

Владимир

Владимир

Ну а чем мешает падение скорости до 0, вначале то скорость огого, в сумме быстрее выходит, т.к. writeback?

мне кажется вы меня не поняли

Sergey

Sergey

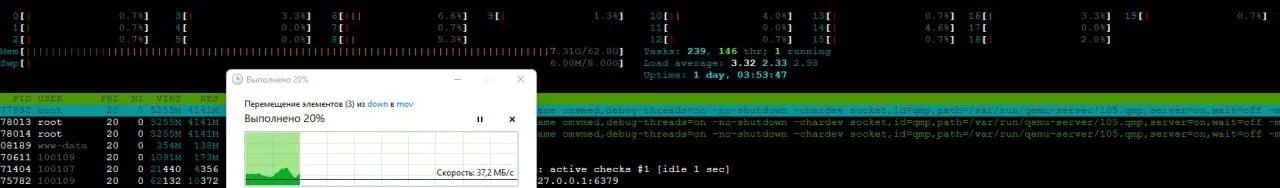

ну и красноты не много, станно, вы уверены что скрин сделан в момент когда тупит и ложится производительность?

Владимир

Владимир

Georg🎞️🎥

Georg🎞️🎥

ну ты выбрал вычислительный рейд и твой пул состоит из одного vdev, ВНЕЗАПНО для многих, как и для меня когда-то НЕТ никакого параллелизма записи на диски внутри vdev, запись последовательна и число дисков в vdev не увеличивает скорость. У Вас будет скорость самого медленного устройства в vdev

Эммм … колличетво дисков увеличивает скорость, у вас будет иопс ведева как у одного диска, а вот скорости всех дисков будут причёсаны под скорость самого медленного

Владимир

Владимир

Эммм … колличетво дисков увеличивает скорость, у вас будет иопс ведева как у одного диска, а вот скорости всех дисков будут причёсаны под скорость самого медленного

... но запись то остаётся последовательной...? разве нет?

Владимир

Владимир

да и я когда-то это тестировал и на сколько помню у меня не было прироста, в прочем это может быть не корректное тестирование, я был тогда слишком молод)

Georg🎞️🎥

Georg🎞️🎥

оно не пишется на все одновременно

Raidz 1-2 из 8 дисков выдаёт 800 мегабайт/ с записи/ чтения линейных 👌то бишь выходит что пишет на все да

Владимир

Владимир

Raidz 1-2 из 8 дисков выдаёт 800 мегабайт/ с записи/ чтения линейных 👌то бишь выходит что пишет на все да

а как ты тестировал?), с синх?))

Владимир

Владимир

Синх эт что ?

если ты делаешь операцию записи без синх, она попадает просто в буфер ядра и пишется на диск не сразу, а ты просто получаешь быструю скорость, но буфер не безграничен, он сгладит скачки, но при интенсивной записи у тебя кончится ОЗУ и всё зависнет)

Georg🎞️🎥

Georg🎞️🎥

если ты делаешь операцию записи без синх, она попадает просто в буфер ядра и пишется на диск не сразу, а ты просто получаешь быструю скорость, но буфер не безграничен, он сгладит скачки, но при интенсивной записи у тебя кончится ОЗУ и всё зависнет)

Ну я кидал терабайты данных )) в озу не влезает стока ))

riv

riv

если ты делаешь операцию записи без синх, она попадает просто в буфер ядра и пишется на диск не сразу, а ты просто получаешь быструю скорость, но буфер не безграничен, он сгладит скачки, но при интенсивной записи у тебя кончится ОЗУ и всё зависнет)

Судя по скрину, речь илет о копировании в windows-виртуалке. А читает он откуда?

Владимир

Владимир

Жирные видеофайлы … все сжатия я отрубаю

а какая номинальная скорость каждого диска была при этом?

Владимир

Владимир

riv

riv

Georg🎞️🎥

Georg🎞️🎥

а какая номинальная скорость каждого диска была при этом?

200. Но ясно что в среднем 100-150 )

Владимир

Владимир

200. Но ясно что в среднем 100-150 )

в общем я учту ваше замечание, на досуге порою документацию

Владимир

Владимир

Georg🎞️🎥

Georg🎞️🎥

в общем я учту ваше замечание, на досуге порою документацию

🤷🏻♂️

Про один диск это речь про iops)))

Когда весь ведев имеет iops одиночного диска )))

Это есть в документациях )

Sergey

Sergey

ясно, похоже zfs не мое... слишком много минусов для меня чем плюсов в сравнение с железным...

riv

riv

Тут много тонкостей:

Больше дисков вraid-zX vdev - больше линейная скорость, но iops чуть хуже чем у одиночного диска. И надо учитывать ashift. При 7 дисках данные распределяются не оптимально и часть пространства у вас не занята, но читается при линейном чтении... Вроде, это обсуждали недавно. При 5 тисках и ashift 12, надо форматировать ntfs с параметром unit 16k

А если сделать больше vdev-ов, то увеличится iops и легче поралелится будет.

riv

riv

ясно, похоже zfs не мое... слишком много минусов для меня чем плюсов в сравнение с железным...

Железный в такой же конфигурации даст результат чуть хуже.

Georg🎞️🎥

Georg🎞️🎥

ясно, похоже zfs не мое... слишком много минусов для меня чем плюсов в сравнение с железным...

На пяток винтов я б не морочился 🤷🏻♂️

riv

riv

ясно, похоже zfs не мое... слишком много минусов для меня чем плюсов в сравнение с железным...

Ashift и другие аспекты так же надо учитывать при настройке аппаратного массива. Только там они называются по другому.

Vladislav

Vladislav