Synology это чисто софт для "хомячков", которые хотят с мобильного телефона управлять

Да все хотят )) ну я вот хочу правда ((( поэтому фринас через гуй(( Уж извините ((( а вот железо хлам за эту цену

Vladislav

Vladislav

Да все хотят )) ну я вот хочу правда ((( поэтому фринас через гуй(( Уж извините ((( а вот железо хлам за эту цену

Да там не ГУИ даже, а отдельное приложение

Vladislav

Vladislav

На уровне "автоматическая синхронизация данных пользователя по одному клику" и т.д.

Georg🎞️🎥

Georg🎞️🎥

Да там не ГУИ даже, а отдельное приложение

Ну как бы конечно хочется удобства - тогда это ребята типа raidix за 15-20к зелени за софт (

Vladislav

Vladislav

Ну как бы конечно хочется удобства - тогда это ребята типа raidix за 15-20к зелени за софт (

Да, но по крайней мере, они есть в реестре и их можно госам продавать

Georg🎞️🎥

Georg🎞️🎥

Да, но по крайней мере, они есть в реестре и их можно госам продавать

Вот кстати не zfs ли у них тоже 🤔

Vladislav

Vladislav

Georg🎞️🎥

Georg🎞️🎥

Ivan

Ivan

Когда диск напрямую подключён в систему видимо

и он существенно быстрее 6 рейда ? чет странна )

Vladislav

Vladislav

и он существенно быстрее 6 рейда ? чет странна )

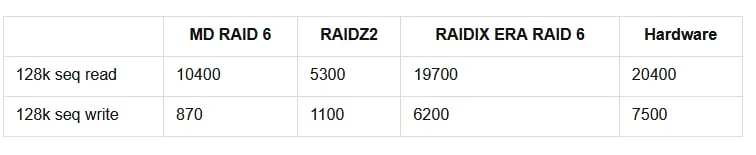

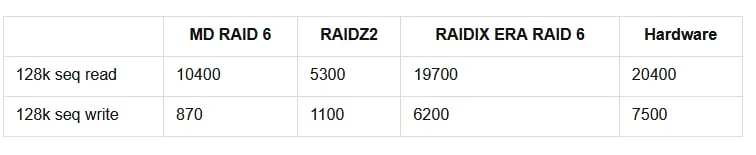

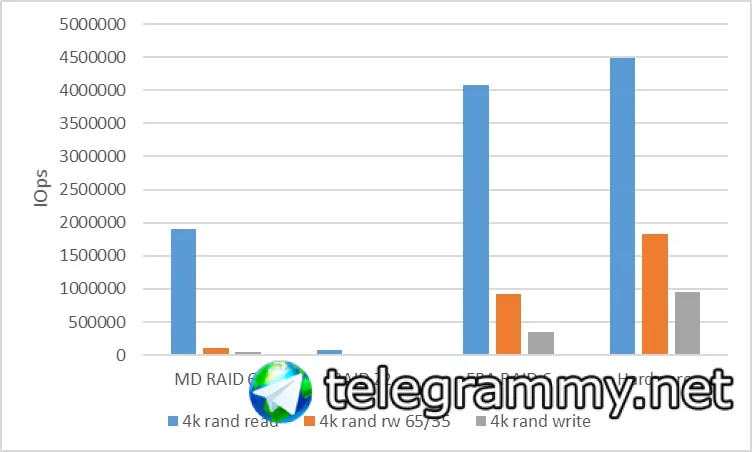

"Была собрана версия 0.79"

2018 год

Vladislav

Vladislav

То есть zfs у них дно 🤷🏻♂️

Они сравнивают своё решение с ZFS не апстрим версии (сравнение было в 2018 году) без доп оптимизаций и без указания размера ARC кэша

Georg🎞️🎥

Georg🎞️🎥

Продавать надо ))) у меня богатые коллеги купили … sas 12 g на hdd🤦♂️🤷🏻♂️

Ivan

Ivan

один тип включил буфер записи в раму на raidx, получил перформанс по ио в разы выше, чем суммарно могут иметь накопители и был счастлив. доводам что это при падении питания плохо кончится не внял.

Georg🎞️🎥

Georg🎞️🎥

один тип включил буфер записи в раму на raidx, получил перформанс по ио в разы выше, чем суммарно могут иметь накопители и был счастлив. доводам что это при падении питания плохо кончится не внял.

Ну в рамках 10-15 рабочих мест не страшно по идее 🤷🏻♂️ибп то стоят

Vladislav

Vladislav

К вопросам по ZFS, их два

1) Можно ли применять к ZFS простую логику тестов (записал 250ГБ рандомных данных, подождал 5 минут, запустил тесты) или нужно использовать другой подход?

2) Где можно человеческим языком почитать про настройки ZFS для volume block size и насколько он критичен? Правильный запрос в гугл с lmgtfy тоже прекрасно подойдёт

Список планируемых тестов:

https://pastebin.com/qmHBV8nv

central

central

Vladislav

Vladislav

2 для волюип нельзя менять блок сайз

Это объясняет почему тут ничего про volume

https://www.usenix.org/system/files/login/articles/login_winter16_09_jude.pdf

riv

riv

представь себе ситуацию, когда у тебя миллиард маленьких файлов на 10 хардах (без избыточности) и выход из строя одного из 10 хардов - не смертельная потеря, а вот потеря спешла это потеря всех 10 дисков, и вот этого хотелось бы избежать

Поставить на спешиал mirror, а милиард файлов на raid-z2 из 10 дисков (ну или z1 если надо сильно экономить из 9 дисков) + сжатие

Vladislav

Vladislav

Так там ещё тест на iSER, где zvol выдаётся во вне

Один ряд тестов на zfs pool

Другой на zfs zvol (iSER)

Алексей

Алексей

Поставить на спешиал mirror, а милиард файлов на raid-z2 из 10 дисков (ну или z1 если надо сильно экономить из 9 дисков) + сжатие

Z1 из 10шт 16тб хардов такая себе идея чтобы потерять сразу всё при очередном ребилде

Vladislav

Vladislav

Не попробуй его сменить для вольюма наши что получилось

Что-нибудь дополнительное к этому может?

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Workload%20Tuning.html

riv

riv

парни, у меня нестандартный кейс и нестандартный к нему подход. прошу не пинать, я отлично понимаю как оно устроено, это как чисто хакерский академический интерес

Ответ по существу. Проблема этого подхода в том, что нужно очень хорошо знать что именно и как делает zfs, чтобы опираться на него.

Вы можете провести эксперемент: возьмите lvm или другой zfs вылелете десяток логических томов lvm или десяток zvol, создайте поверх них пул zfs используя один из логических томов как special. Дайте на пул характерную для вашего случая нагрузку и создавайте снимки. Затем экспортируйте пул, удалите или как-то скройте один из логических томов и попробуйте импортировать пул обратно.

Первое с чем вы столкнетесь, пул не будет импортироваться просто так. Модно попробовать импортировать его через ключ -f или -F, но я думпю, чьо не поможет. Далее надо гуглить рецепты восстановления zfs.

Если пул тем или иным образом удастся импортировать, попробуйте скриптом прочитать файлы. Пусть скрипт посчитает сколько из них прочиталось целиком, сколько частично, а сколько вообще не читаются. Возможно будут ясны какие-то закономерности. Операцию надо повторить и доя снимков. Там тоже могут быть сюрпризы.

Алексей

Алексей

Алексей

Алексей

Я уже понял что идея не взлетит после того как понял что снапшот на датасет распространяется а не на пул

riv

riv

нету, вообще под завязку всё

Один из самых интересных постов, есди читать ответы на него ) ссылку на сплитер сохранил ))

riv

riv

Я уже понял что идея не взлетит после того как понял что снапшот на датасет распространяется а не на пул

На пул тоже есть снепшоты )) я правда ими не пользовался. Служат для отката операций со в ем пулом.

Vladislav

Vladislav

какая версия openzfs уже поддерживает 5.19 ядро?

https://github.com/openzfs/zfs/releases

Видимо ещё никакая

Δαρθ

Δαρθ

короче у меня так:

# ./configure --with-linux=/root/linux/linux-5.19-rc7/ --with-linux-obj=/root/linux/linux-5.19-rc7/

.....

checking kernel source version... Not found

configure: error:

*** Cannot find UTS_RELEASE definition.

Δαρθ

Δαρθ

Δαρθ

Δαρθ

Зато команды можно попробовать

# which make-kpkg

which: no make-kpkg in (/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/opt/bin)

иии?

Art

Art

На пул тоже есть снепшоты )) я правда ими не пользовался. Служат для отката операций со в ем пулом.

Воу-воу, на пул целиком можно делать снапшоты?..

Владимир

Владимир

Воу-воу, на пул целиком можно делать снапшоты?..

а почему нет), если весь пул это тоже датасет)

Vladislav

Vladislav

# which make-kpkg

which: no make-kpkg in (/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/opt/bin)

иии?

apt-get install kernel-package

Art

Art

а почему нет), если весь пул это тоже датасет)

Аа, в таком смысле(

Ну нет, снапшот корневого датасета и снапшот пула, если бы таковой был возможен, это всё-таки две большие разницы...

Владимир

Владимир

Art

Art

а в чём разница?

Ну, в моём представлении снппшот пула сохранял бы состояние всех вдевов и девайсов

Соответственно в случае смерти любого вдева или спешл-девайса (и как следствие смерти пула) можно было бы заменить сбойные диски, и потом оживить пул путём отката на снапшот

Владимир

Владимир

Art

Art

то что ты описал возможно реализовать только через бекап пула

Таки да, потому я и удивился и обрадовался, прочитав про снапшот пула

Но такового не существует, следовательно и сам термин не должен существовать. Согласись!

Владимир

Владимир

Δαρθ

Δαρθ

apt-get install kernel-package

в генте? )

на самом деле оказалось что надо сначала ведро подсобрать. тогда конфигур все находит

Vladislav

Vladislav

в генте? )

на самом деле оказалось что надо сначала ведро подсобрать. тогда конфигур все находит

А я знаю что у вас Гент?)

Δαρθ

Δαρθ

А я знаю что у вас Гент?)

а какая разница-то, я собираю ядро в сторонке и независимо от того что там в дистрибе творится

Vladislav

Vladislav

Δαρθ

Δαρθ

ну если конфигур лезет если может в конкретные механизмы конкретного дистриба -- то отсюда не следует что конкретная ошибка характерна только для того дистриба

Vladislav

Vladislav

Vladislav

Vladislav

Вы дали информацию "ошибка Х".

У "Ошибки Х" есть такое решение из множества других.

Я не знаю как остальные, но я не телепат, чтобы знать, что и в чем Вы делаете.

riv

riv

Воу-воу, на пул целиком можно делать снапшоты?..

Я только читал об этом. Сейчас глянул, там есть команда zpool checkpoint

Art

Art

Я только читал об этом. Сейчас глянул, там есть команда zpool checkpoint

ого, а это интересное

zpool-checkpoint — check-point current ZFS storage pool state

Checkpoints the current state of pool , which can be later restored by zpool import --rewind-to-checkpoint. The existence of a checkpoint in a pool prohibits the following zpool subcommands: remove, attach, detach, split, and reguid. In addition, it may break reservation boundaries if the pool lacks free space. The zpool status command indicates the existence of a checkpoint or the progress of discarding a checkpoint from a pool. zpool list can be used to check how much space the checkpoint takes from the pool.

zpool checkpoint [-d [-w]] pool

-d, --discard

Discards an existing checkpoint from pool.

-w, --wait

Waits until the checkpoint has finished being discarded before returning.

Катя

Катя