Получается, надо сначала уменьшить раздел самый большой. Потом уменьшить размер пула, чтобы в общем было чуть меньше чем размер Сигейт, и только потом пробовать замену?

Пулы с raidz сейчас уменьшить нельзя

LordMerlin

LordMerlin

Диски САС. Так бы бэды заремапить и дальше бы полетел. А так он сука все время с ошибкой чтения в дегрейдел вываливается.

Vladislav

Vladislav

А вариант взять 2тб диск 7200 сата, перегнать на него пул и просто пересоздать пул рассматривали как выход из ситуации?

Δαρθ

Δαρθ

А вариант взять 2тб диск 7200 сата, перегнать на него пул и просто пересоздать пул рассматривали как выход из ситуации?

в это-то время 2тб и сдохнет )

Vladislav

Vladislav

в это-то время 2тб и сдохнет )

Зеркало, к тому же, очень сомневаюсь, что новый 2тб сдохнет за 3-5 часов

Shaker

Shaker

Всем доброго вечера. Что вы обычно ожидаете от команды "zpool remove tank mirror-1", зная, что зеркал там еще штук 20, диски все одинаковые, и пул на половину свободен ? Я верно понял, что оно должно эвакуировать данные с этого зеркала на свободное место, и по завершении удалить mirror-1 ?

Shaker

Shaker

Команда вызвала "VERIFY(list_is_empty(&lwb->lwb_itxs)) failed, PANIC at zil.c:585:zil_free_lwb()", и остановку работы пула.

Vladislav

Vladislav

Всем доброго вечера. Что вы обычно ожидаете от команды "zpool remove tank mirror-1", зная, что зеркал там еще штук 20, диски все одинаковые, и пул на половину свободен ? Я верно понял, что оно должно эвакуировать данные с этого зеркала на свободное место, и по завершении удалить mirror-1 ?

Оно должно удалить пул tank со всем что внутри

Shaker

Shaker

Оно должно удалить пул tank со всем что внутри

Я был уверен, что это zpool destroy делает. Судя по zpool-remove пул должен выжить )

Fedor

Fedor

Команда вызвала "VERIFY(list_is_empty(&lwb->lwb_itxs)) failed, PANIC at zil.c:585:zil_free_lwb()", и остановку работы пула.

Привет!

Напиши в ЛС линк, переправляю сюда

Vladislav

Vladislav

Shaker

Shaker

Привет!

Напиши в ЛС линк, переправляю сюда

Да там ссылка на ман с openzfs github, думаю его тут и так все знают)

Shaker

Shaker

Команда вызвала "VERIFY(list_is_empty(&lwb->lwb_itxs)) failed, PANIC at zil.c:585:zil_free_lwb()", и остановку работы пула.

Все-же это нестандартное поведение для zpool remove, нет ? Кто встречался ?

Vladislav

Vladislav

А, прочитал destroy, сори

Но в любом случае, данные с зеркала Вам никто не эвакуирует сам. Если это cache\log vdev то он просто исчезнет

Если это mirror в пуле с данными - welp, это закончится остановкой массива

George

George

Команда вызвала "VERIFY(list_is_empty(&lwb->lwb_itxs)) failed, PANIC at zil.c:585:zil_free_lwb()", и остановку работы пула.

конечно ответ нештатный, пул после ребута хотябы импортируется?

по багам искать надо

Shaker

Shaker

конечно ответ нештатный, пул после ребута хотябы импортируется?

по багам искать надо

Нет, как живой, только не живой. mirror-1 impacted. Надежда на import -F.

Shaker

Shaker

Но в любом случае, данные с зеркала Вам никто не эвакуирует сам. Если это cache\log vdev то он просто исчезнет

Если это mirror в пуле с данными - welp, это закончится остановкой массива

Тогда понятно. Вот это только смущает:

Removing a top-level vdev reduces the total amount of space in the storage pool. The specified device will be evacuated by copying all allocated space from it to the other devices in the pool. In this case, the zpool remove command initiates the removal and returns, while the evacuation continues in the

George

George

Но в любом случае, данные с зеркала Вам никто не эвакуирует сам. Если это cache\log vdev то он просто исчезнет

Если это mirror в пуле с данными - welp, это закончится остановкой массива

zpool remove не должен приводить к не рабочему пулу, либо должен штатно эвакуировать данные на соседние (это через фиктивный vdev сделано), либо отказ

Vladislav

Vladislav

Тогда понятно. Вот это только смущает:

Removing a top-level vdev reduces the total amount of space in the storage pool. The specified device will be evacuated by copying all allocated space from it to the other devices in the pool. In this case, the zpool remove command initiates the removal and returns, while the evacuation continues in the

Хорошо, у Вас ZFS как файловая система или как блочка отдаётся выше уровнем?

Shaker

Shaker

Т е судя по доке данные-таки эвакуируются. Похоже баг.

module v0.8.3-1ubuntu12.14, ZFS pool version 5000, ZFS filesystem version 5

George

George

Vladislav

Vladislav

Т е судя по доке данные-таки эвакуируются. Похоже баг.

module v0.8.3-1ubuntu12.14, ZFS pool version 5000, ZFS filesystem version 5

стоп. А когда Вы ставили систему?

Shaker

Shaker

Хорошо, у Вас ZFS как файловая система или как блочка отдаётся выше уровнем?

Как фс. ZIL на mirror nvme

Vladislav

Vladislav

Как фс. ZIL на mirror nvme

Тогда уберём мою фразу про эвакуацию данных, я слишком привык к выдаче zfs тома наверх

Vladislav

Vladislav

Тогда понятно. Вот это только смущает:

Removing a top-level vdev reduces the total amount of space in the storage pool. The specified device will be evacuated by copying all allocated space from it to the other devices in the pool. In this case, the zpool remove command initiates the removal and returns, while the evacuation continues in the

"So, only use the zpool remove command to recover a pool when you have added another device to the pool accidentally."

"consider creating a new pool and then using the zfs send and zfs recv commands to migrate the data to the new pool."

Shaker

Shaker

Shaker

Shaker

Но там явно видно, что при удалении запускается resilver, и все живо. В общем, баг есть. Это в ubuntu какая-то тестовая альфа zfs версия, и есть реализация более стабильная, или оно просто так работает ?

Vladislav

Vladislav

Но там явно видно, что при удалении запускается resilver, и все живо. В общем, баг есть. Это в ubuntu какая-то тестовая альфа zfs версия, и есть реализация более стабильная, или оно просто так работает ?

А ещё там написано, что это сделано на зеркале которое убирается почти сразу как добавлено и добавлено оно было случайно

Vladislav

Vladislav

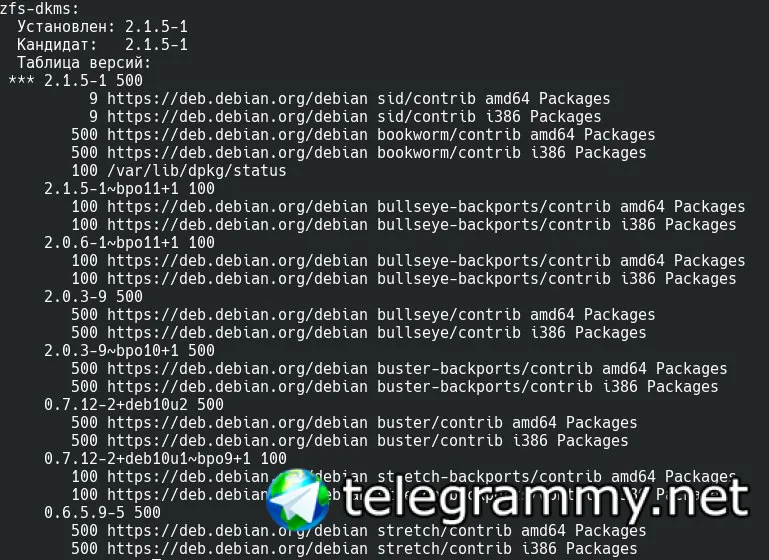

Когда есть прекрасный репозиторий jonathonf?

Я вообще отсюда ставлю, самое свежее что может быть

https://launchpad.net/~jonathonf/+archive/ubuntu/zfs

George

George

Но там явно видно, что при удалении запускается resilver, и все живо. В общем, баг есть. Это в ubuntu какая-то тестовая альфа zfs версия, и есть реализация более стабильная, или оно просто так работает ?

у убунты очень странная ситуация последние пару лет, zfs как бы в штатной поставке но они нормально версию не обновляют и страдают расхождением версии в ядре и в юзерспейсе

George

George

Но там явно видно, что при удалении запускается resilver, и все живо. В общем, баг есть. Это в ubuntu какая-то тестовая альфа zfs версия, и есть реализация более стабильная, или оно просто так работает ?

если данные не потеряли - отлично. Но 0.8 уже не поддерживается, свежий стейбл - 2.1

George

George

так что даже если баг есть, то его стоит воспроизвести на 2.1 если репортить созреете и репро будет

Shaker

Shaker

у убунты очень странная ситуация последние пару лет, zfs как бы в штатной поставке но они нормально версию не обновляют и страдают расхождением версии в ядре и в юзерспейсе

Понятно, спасибо. Прийдется переделывать, видимо.

Shaker

Shaker

Это уже второй неприятный баг с этой версией. До этого была боль с динамическим размером ARC. Он внезапно решает уменьшиться, не успевает, и массив замирает на более 2 минут. Потом приходит в чувства. При статичном, все ок.

George

George

LordMerlin

LordMerlin

А вариант взять 2тб диск 7200 сата, перегнать на него пул и просто пересоздать пул рассматривали как выход из ситуации?

Рассматривал, как крайний случай.

И диска такого нет за просто так, и мало ли что сбойнет в процессе.

Вот как ниже написали.

Georg🎞️🎥

Georg🎞️🎥

Рассматривал, как крайний случай.

И диска такого нет за просто так, и мало ли что сбойнет в процессе.

Вот как ниже написали.

2-3к рублей цена вопроса 🤔

Roman

Roman

у убунты очень странная ситуация последние пару лет, zfs как бы в штатной поставке но они нормально версию не обновляют и страдают расхождением версии в ядре и в юзерспейсе

Версия 0.8.3 - это 20.04 убунта. Зачем её ставить, когда есть 22.04 с свежим zfs?

И каноникал, как минимум в 0.8.3, много чего бэкпортировали из версии 2

Vladislav

Vladislav

Версия 0.8.3 - это 20.04 убунта. Зачем её ставить, когда есть 22.04 с свежим zfs?

И каноникал, как минимум в 0.8.3, много чего бэкпортировали из версии 2

0.8.3 всё равно от 2020 года версия, смысл вообще её использовать, если можно поставить 2.1.5

P.S. 22.04 ещё не совсем поддерживается многим софтом не из репо Ubuntu

Shaker

Shaker

Я вообще отсюда ставлю, самое свежее что может быть

https://launchpad.net/~jonathonf/+archive/ubuntu/zfs

В общем ставиться отсюда в ubuntu 20.04 это нормальная практика, максимально приближенная к стабильной ?

Ivan

Ivan

В общем ставиться отсюда в ubuntu 20.04 это нормальная практика, максимально приближенная к стабильной ?

кмк лучше дебиан поставить

Δαρθ

Δαρθ

Да, так точно. Поэтому мы на 22.04 и не переходим

а можно подробнее что не поддерживает 2204?

так для общего развития спрашиваю

Δαρθ

Δαρθ

В общем ставиться отсюда в ubuntu 20.04 это нормальная практика, максимально приближенная к стабильной ?

кстати из опыта зфс идеально собирается из сорцов прям в .deb

Ivan

Ivan

Чем лучше ? 11 ?

Shaker

Shaker

а можно подробнее что не поддерживает 2204?

так для общего развития спрашиваю

А не я за это отвечаю, у нас много админов, и пока все косо смотрят на 22.4 . Подробностей не знаю. У нас много завязано на cuda / rdma / kubernetes, может с этим связано. Так-то сервисы все в контейнерах, но что-то ключевое еще не понятно.

Shaker

Shaker

Я бэкапами занимаюсь ) Часть в ceph, часть в zfs, часть на ленте. Пока что лента - самое стабильное, что есть )

Vladislav

Vladislav

а можно подробнее что не поддерживает 2204?

так для общего развития спрашиваю

У меня это система тех пода Zammad

Vladislav

Vladislav

В общем ставиться отсюда в ubuntu 20.04 это нормальная практика, максимально приближенная к стабильной ?

Это буквально собранный пакет из репозитория ZoL

Nick

Nick

Nick

Nick

https://aliexpress.ru/item/1005001344675103.html?gatewayAdapt=glo2rus&sku_id=12000015763998421&spm=a2g0s.12269583.0.0.5c417190XdCjqE

А есть аналогичные PCIe4.0 ? Можно даже на два диска, но на 110

Vladislav

Vladislav

А есть аналогичные PCIe4.0 ? Можно даже на два диска, но на 110

Для 4.0 обычно бифуркация есть на консьюмерских материнках, а тут и asus hyper за 4к поддерживает 4.0

Спросил у продавца, но, учитывая, что Broadcom только в 20-м году релизнул чип для этого, а в Китае жёсткие меры по ковиду были - сомнительно, что плата уже есть

central

central