Станислав

Станислав

И? Когда к тебе жёсткий диск попадает или весь комп с зашифрованными данные, ты ведь тоже имеешь прямой доступ)

Vladislav

Vladislav

И? Когда к тебе жёсткий диск попадает или весь комп с зашифрованными данные, ты ведь тоже имеешь прямой доступ)

https://www.rapid7.com/blog/post/2013/07/02/a-penetration-testers-guide-to-ipmi/

ArtAnt

ArtAnt

IPMI имеет _прямой_ доступ к железу

IPMI имеет доступ к i2C шине, взаимодействовать с диском оно никак не может. А вот Intel ME это совсем другая петрушка

Станислав

Станислав

https://www.rapid7.com/blog/post/2013/07/02/a-penetration-testers-guide-to-ipmi/

Спасибо. Почитаю, может м правда там жопа)

ArtAnt

ArtAnt

И? Когда к тебе жёсткий диск попадает или весь комп с зашифрованными данные, ты ведь тоже имеешь прямой доступ)

Intel ME имеет доступ к содержимому оперативной памяти, а значит к той области где данные могут быть уже в расшифрованном виде, ну и так же как и IPMI может скрыто делать скриншоты и помогать установлению демократии на планете.

Vladislav

Vladislav

Безопасники сразу просят модель угроз.

Zfs для защиты файловой системы не от всего защищает

Станислав

Станислав

IPMI имеет доступ к i2C шине, взаимодействовать с диском оно никак не может. А вот Intel ME это совсем другая петрушка

Я об этом же. Понятно, что, например, оперативную память можно анализировать на какие-то данные и так далее, имея доступ к железу с запущенной ОС. Но это уже из разряда аппаратных дыр, как Сноуден раскрыл

Станислав

Станислав

Intel ME имеет доступ к содержимому оперативной памяти, а значит к той области где данные могут быть уже в расшифрованном виде, ну и так же как и IPMI может скрыто делать скриншоты и помогать установлению демократии на планете.

Не увидел сообщение это, пока своё не отправил)) можно было бы самому не писать😄

ArtAnt

ArtAnt

Не увидел сообщение это, пока своё не отправил)) можно было бы самому не писать😄

Пиши, никто тебе не может этого запретить )

ArtAnt

ArtAnt

Безопасники сразу просят модель угроз.

Zfs для защиты файловой системы не от всего защищает

Озвучь безопаснику про Intel ME, он должен быть в курсе, что в том же Континент АПКШ да и вообще практически везде на железе используемом под так называемые отечественные штучки дрючки за десять раз оверпрайснутую цену, он присутствует.

Fedor

Fedor

Безопасники сразу просят модель угроз.

Zfs для защиты файловой системы не от всего защищает

Модель угроз это их дело вообще-то)

Станислав

Станислав

https://www.rapid7.com/blog/post/2013/07/02/a-penetration-testers-guide-to-ipmi/

Тут, кстати, брехня по поводу стандартного пароля для supermicro. Логин действительно ADMIN, а вот пароль рандомный, точно не помню, но не меньше 10 символов. Они его сейчас пишут на крышке, закрывающей сокет.

Ivan

Ivan

Vladislav

Vladislav

статья мохнатого года, многое вендоры чуть подтянули в плане безопасности

Не совсем по своему желанию впрочем

Станислав

Станислав

статья мохнатого года, многое вендоры чуть подтянули в плане безопасности

Да, статья старая, но полезная. Ещё раз спасибо.

Хорошо, что у меня IPMI в закрытой сети.

Но в ней пишут об уязвимости доступа в ОС только на не зашифрованные диски

Oracle DBA

Oracle DBA

Тут, кстати, брехня по поводу стандартного пароля для supermicro. Логин действительно ADMIN, а вот пароль рандомный, точно не помню, но не меньше 10 символов. Они его сейчас пишут на крышке, закрывающей сокет.

Пароль админа наклеен на метеринке и его ты можешь сменить.

Георгий

Георгий

Пароль админа наклеен на метеринке и его ты можешь сменить.

С помощью ipmitool можно менять любые параметры, в том числе и пароль

Станислав

Станислав

Пароль админа наклеен на метеринке и его ты можешь сменить.

Я так и написал. Только последний раз он был только на крышке сокета наклеен

Станислав

Станислав

С помощью ipmitool можно менять любые параметры, в том числе и пароль

Можно было. Сейчас стоит проверить, немало времени прошло)

Николай Орлов

Николай Орлов

Друзья подскажите если кто сталкивался. Поставил на Debian 10 proxmox , все вроде ничего, но периодически сервак жестко подвисает. Что может быть не так?

central

central

central

central

George

George

при 80-90% занятости места на пуле, zfs только на запись просаживается или на чтение тоже ?

на чтение только косвенно увеличением фрагментации данных, может требоваться немного больше иопсов прочитать более фрагментированное

George

George

Добрый день можно вас озадачить одним вопросом, да я совершил глупость но тут уже ничего не подпишешь, нужно исправлять ситуацию

George

George

Была у меня система на zfs debian10, черт меня дёрнул установить проксмос, после установки система предложила обновить несколько пакетов в том числе связанных с zfs

George

George

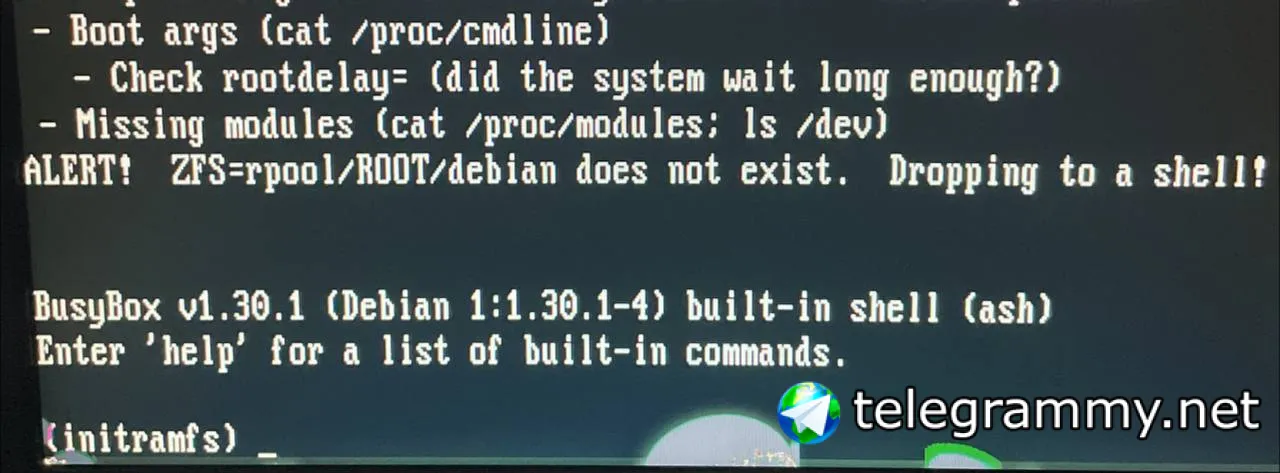

Ну и конечно ума не хватило , не останавливать систему, я ее перезагрузил и вот теперь она не грузится

George

George

@orlov_nv на примере https://openzfs.github.io/openzfs-docs/Getting%20Started/Debian/Debian%20Bullseye%20Root%20on%20ZFS.html можно глянуть как chroot для рекавера можно юзать

Николай Орлов

Николай Орлов

Но я не помню завязки на zfs-utils и мб проблема в другом, надо смотреть что падает

После обновления проксмос исчезли все пулы, на zfs list отвечало что нет такой команды

Николай Орлов

Николай Орлов

Загрузился с предыдущего ядра и все переустановил как надо, но с ядра прохвоста так и не грузится

Николай Орлов

Николай Орлов

Воспользуйтесь LiveCD который выше давали

Так я могу запустить систему на ядре до проксмос

Николай Орлов

Николай Орлов

Так я же говорю я все переустановил все пакеты zfsutils в том числе , не пойму почему ядро проксмос не видит rpool

Art

Art

Так я же говорю я все переустановил все пакеты zfsutils в том числе , не пойму почему ядро проксмос не видит rpool

А zfs import что показывает?

George

George

Проблема решена не был установлен пакет zfs-initramfs

как раз хотел предложить initramfs пересобрать)

Evgenii

Evgenii

https://rabota.dev/forum/threads/%D0%A3%D1%81%D1%82%D0%B0%D0%BD%D0%BE%D0%B2%D0%BA%D0%B0-proxmox-ve-%D0%BD%D0%B0-dedicated-server-hetzner-%D1%87%D0%B5%D1%80%D0%B5%D0%B7-rescue-mode.6956/

Я последние несколько раз вот так ставил. (ссылка на оригинальную статью выше)

- подключаемся по SSH к rescue

- Качаем ISO

- Запускаем VM с пробросом физических дисков и ISO

- через VNC консоль устанавливаем Proxmox в VM

- Внутри VM останется только поменять имя сетевого интерфейса на тот, что установлен на физическом сервере

- Выключаем VM, на дисках при этом установлен проксмокс и нужные загрузчики.

- Перезагружаем сервер, если не накосячили с сетевым интерфейсом, то сразу будет доступен веб интерфейс.

blkmrkt

blkmrkt

Ребят, подскажите полному нубу насчет ZFS. Нужно как можно скорее всосать 900М мелких файлов из Backblaze чтоб долго их потом хранить. Есть вот такое железо:

- HPE Apollo XL450, 512GB RAM, NixOS с последним кекстом и утилитами

- 40 х 4TB дисков, некоторые вероятно SMR

- 2 х 4TB NVMe диска (есть еще много, но не нашел достаточно короткого PCIe адаптера к ним)

Уже создал пул вот таким образом, но в другом чате меня накормили говном, мол все неправильно сделал: sudo zpool create black raidz2 sdb sdc sdd sde sdf sdg sdh sdi sdj sdk sdl sdm sdn sdq sdr sds sdt sdu sdv sdw sdx sdy sdz sdaa sdab sdac sdad sdae sdaf sdag log mirror nvme0n1 nvme1n1

Art

Art

https://rabota.dev/forum/threads/%D0%A3%D1%81%D1%82%D0%B0%D0%BD%D0%BE%D0%B2%D0%BA%D0%B0-proxmox-ve-%D0%BD%D0%B0-dedicated-server-hetzner-%D1%87%D0%B5%D1%80%D0%B5%D0%B7-rescue-mode.6956/

Я последние несколько раз вот так ставил. (ссылка на оригинальную статью выше)

- подключаемся по SSH к rescue

- Качаем ISO

- Запускаем VM с пробросом физических дисков и ISO

- через VNC консоль устанавливаем Proxmox в VM

- Внутри VM останется только поменять имя сетевого интерфейса на тот, что установлен на физическом сервере

- Выключаем VM, на дисках при этом установлен проксмокс и нужные загрузчики.

- Перезагружаем сервер, если не накосячили с сетевым интерфейсом, то сразу будет доступен веб интерфейс.

Ужс, это всё из-за того, что Хетцнер не предоставляет нормальную ipmi консоль к своим дедикам?

Иначе я не понимаю, зачем всё это😟

central

central

Ужс, это всё из-за того, что Хетцнер не предоставляет нормальную ipmi консоль к своим дедикам?

Иначе я не понимаю, зачем всё это😟

у него там далеко не факт что сервер такое поддерживает

central

central

где то в интернете был отличный способ установки через виртуалку и подкидывание реальных дисков

Станислав

Станислав

Ужс, это всё из-за того, что Хетцнер не предоставляет нормальную ipmi консоль к своим дедикам?

Иначе я не понимаю, зачем всё это😟

Они предоставляют KVM-over-IP, не знаю чего мучается человек...

Станислав

Станислав

у него там далеко не факт что сервер такое поддерживает

KVM этот - внешняя железяка, никаких проблем. По ощущениям медленнее чем IPMI, но более чем рабочая штука

Станислав

Станислав

Более того, я просил воткнуть флешку с линухой, они любезно со второй попытки смогли записать образ)))

Art

Art

Ребят, подскажите полному нубу насчет ZFS. Нужно как можно скорее всосать 900М мелких файлов из Backblaze чтоб долго их потом хранить. Есть вот такое железо:

- HPE Apollo XL450, 512GB RAM, NixOS с последним кекстом и утилитами

- 40 х 4TB дисков, некоторые вероятно SMR

- 2 х 4TB NVMe диска (есть еще много, но не нашел достаточно короткого PCIe адаптера к ним)

Уже создал пул вот таким образом, но в другом чате меня накормили говном, мол все неправильно сделал: sudo zpool create black raidz2 sdb sdc sdd sde sdf sdg sdh sdi sdj sdk sdl sdm sdn sdq sdr sds sdt sdu sdv sdw sdx sdy sdz sdaa sdab sdac sdad sdae sdaf sdag log mirror nvme0n1 nvme1n1

А в чём вопрос?

Так, если пробежаться:

1) А в каком виде Backblaze отдает данные?

2) NixOS - я щас погуглил, вроде всё порядочно, опензфс впилена в дистрибутив, и есть документация... Но я бы все равно использовал что-нибудь более популярное. Траблшутинг может оказаться очень болезненным. Почему НиксОС? Ты хорошо в ней шаришь?

3) SMR-диски - это плохо. Я бы грепнул из hwinfo названия моделей и погуглил, может там всё-таки нет их.

Если есть... То фз, может вообще их в пул не включать, или как spare включить. Надо подумать.

4) Пул - посмотри zpool poolname status

Если там диски добавились по uuid то все ровно, а если по буквам (sda, sdb, и тд). То лучше переделать.

5) Планировщики - ну ЗФС сама это должна была сделать для отданных ей дисков

6) Учитывая, что дисков много, я бы обязательно приделал мониторинг, хотя бы емейлы по состоянию от smartctl

Ivan

Ivan

Они предоставляют KVM-over-IP, не знаю чего мучается человек...

проблема в том, что он доступен не постоянно. его не подают мгновенно, доступен ненадолго

Станислав

Станислав

проблема в том, что он доступен не постоянно. его не подают мгновенно, доступен ненадолго

Да, не мгновенно. Но его на 3 часа дают, более чем достаточно. Тем более я подробно порядок действий написал, его можно применить и без rescue

blkmrkt

blkmrkt

А в чём вопрос?

Так, если пробежаться:

1) А в каком виде Backblaze отдает данные?

2) NixOS - я щас погуглил, вроде всё порядочно, опензфс впилена в дистрибутив, и есть документация... Но я бы все равно использовал что-нибудь более популярное. Траблшутинг может оказаться очень болезненным. Почему НиксОС? Ты хорошо в ней шаришь?

3) SMR-диски - это плохо. Я бы грепнул из hwinfo названия моделей и погуглил, может там всё-таки нет их.

Если есть... То фз, может вообще их в пул не включать, или как spare включить. Надо подумать.

4) Пул - посмотри zpool poolname status

Если там диски добавились по uuid то все ровно, а если по буквам (sda, sdb, и тд). То лучше переделать.

5) Планировщики - ну ЗФС сама это должна была сделать для отданных ей дисков

6) Учитывая, что дисков много, я бы обязательно приделал мониторинг, хотя бы емейлы по состоянию от smartctl

>1) А в каком виде Backblaze отдает данные?

S3 API, но про Бекблейз я упомянул больше так к слову, чтоб была понятнее задача. Питоном беру блоб из сети и пишу в файл.

>2) NixOS - я щас погуглил, вроде всё порядочно, опензфс впилена в дистрибутив, и есть документация... Но я бы все равно использовал что-нибудь более популярное. Траблшутинг может оказаться очень болезненным. Почему НиксОС? Ты хорошо в ней шаришь?

Полгода назад мы все серверы на нее перевели, очень удобно деплоить код и меня все там в принципе устраивает. Даже Цеф на ней завел на прошлой неделе.

>3) SMR-диски - это плохо. Я бы грепнул из hwinfo названия моделей и погуглил, может там всё-таки нет их. Если есть... То фз, может вообще их в пул не включать, или как spare включить. Надо подумать.

Уже дисков закупил, поэтому никуда не деться, придется страдать. Со временем надеюсь я их поменяю.

>4) Пул - посмотри zpool poolname status Если там диски добавились по uuid то все ровно, а если по буквам (sda, sdb, и тд). То лучше переделать.

А на лету это нельзя переделать, обязательно все пересоздавать?

>5) Планировщики - ну ЗФС сама это должна была сделать для отданных ей дисках,

Супер!

>6) Учитывая, что дисков много, я бы обязательно приделал мониторинг, хотя бы емейлы по состоянию от smartctl

Угу, это уже завтра сделаю, там экспортер в influxdb есть.

Art

Art

>1) А в каком виде Backblaze отдает данные?

S3 API, но про Бекблейз я упомянул больше так к слову, чтоб была понятнее задача. Питоном беру блоб из сети и пишу в файл.

>2) NixOS - я щас погуглил, вроде всё порядочно, опензфс впилена в дистрибутив, и есть документация... Но я бы все равно использовал что-нибудь более популярное. Траблшутинг может оказаться очень болезненным. Почему НиксОС? Ты хорошо в ней шаришь?

Полгода назад мы все серверы на нее перевели, очень удобно деплоить код и меня все там в принципе устраивает. Даже Цеф на ней завел на прошлой неделе.

>3) SMR-диски - это плохо. Я бы грепнул из hwinfo названия моделей и погуглил, может там всё-таки нет их. Если есть... То фз, может вообще их в пул не включать, или как spare включить. Надо подумать.

Уже дисков закупил, поэтому никуда не деться, придется страдать. Со временем надеюсь я их поменяю.

>4) Пул - посмотри zpool poolname status Если там диски добавились по uuid то все ровно, а если по буквам (sda, sdb, и тд). То лучше переделать.

А на лету это нельзя переделать, обязательно все пересоздавать?

>5) Планировщики - ну ЗФС сама это должна была сделать для отданных ей дисках,

Супер!

>6) Учитывая, что дисков много, я бы обязательно приделал мониторинг, хотя бы емейлы по состоянию от smartctl

Угу, это уже завтра сделаю, там экспортер в influxdb есть.

1) Afaik у тебя по большому счёту две опции: рсинк или zfs send, но второе отпадает так как на той стороне нет зфс.

А рсинк тупит жестко когда файлов много, а у тебя их почти лярд. Надо смотреть в сторону мультипотока у рсинка, видел есть решения. Либо попадались какие-то оптимизированные форки рсинка под эту задачу, но я не запомнил как они назывались...

4) Можна)

zpool export <name of pool>

zpool import -d /dev/disk/by-id <name of pool>

Только это уместно, если пул не системный, конечно)

blkmrkt

blkmrkt

1) Afaik у тебя по большому счёту две опции: рсинк или zfs send, но второе отпадает так как на той стороне нет зфс.

А рсинк тупит жестко когда файлов много, а у тебя их почти лярд. Надо смотреть в сторону мультипотока у рсинка, видел есть решения. Либо попадались какие-то оптимизированные форки рсинка под эту задачу, но я не запомнил как они назывались...

4) Можна)

zpool export <name of pool>

zpool import -d /dev/disk/by-id <name of pool>

Только это уместно, если пул не системный, конечно)

воу супер, сейчас переделаю! А насчет 1) то скорость меня сейчас устраивает, если конечно оно не загнется с увеличением кол-ва файлов в папке

Art

Art

воу супер, сейчас переделаю! А насчет 1) то скорость меня сейчас устраивает, если конечно оно не загнется с увеличением кол-ва файлов в папке

1) У рсинка именно инкрементальные синхронизации начинают тупить, ему же там сверять всё надо...

А первичная-то заливка норм проходит. Ну да, посмотри в общем как оно там пойдёт.

blkmrkt

blkmrkt

1) У рсинка именно инкрементальные синхронизации начинают тупить, ему же там сверять всё надо...

А первичная-то заливка норм проходит. Ну да, посмотри в общем как оно там пойдёт.

У меня вся мета в постгресе, поэтому проблемы с остановкой-продолжением нет, я параллельно просто все выкачиваю, таким образом не приходится делать листинги.

George

George

Ребят, подскажите полному нубу насчет ZFS. Нужно как можно скорее всосать 900М мелких файлов из Backblaze чтоб долго их потом хранить. Есть вот такое железо:

- HPE Apollo XL450, 512GB RAM, NixOS с последним кекстом и утилитами

- 40 х 4TB дисков, некоторые вероятно SMR

- 2 х 4TB NVMe диска (есть еще много, но не нашел достаточно короткого PCIe адаптера к ним)

Уже создал пул вот таким образом, но в другом чате меня накормили говном, мол все неправильно сделал: sudo zpool create black raidz2 sdb sdc sdd sde sdf sdg sdh sdi sdj sdk sdl sdm sdn sdq sdr sds sdt sdu sdv sdw sdx sdy sdz sdaa sdab sdac sdad sdae sdaf sdag log mirror nvme0n1 nvme1n1

Полезное читать тут для начала (можно выборочно) https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/index.html

raidz2 конечно очень широкий, стоит несколько vdevs использовать, либо сразу draid https://openzfs.github.io/openzfs-docs/Basic%20Concepts/dRAID%20Howto.html

а так ещё из базового - xattr=sa,atime=off, мб при желании sync=disabled т.к. бекапы (обязательно прочесть в доке про каждую пропертю перед применением)

дедуп рассматривать только после понимания, что такое синхронный дедуп, что такое DDT и почему он должен помещаться в ОЗУ

ну и recordsize ещё глянуть, и учесть что recordsize<32k даёт плохую утилизацию по месту для raidz

blkmrkt

blkmrkt

Полезное читать тут для начала (можно выборочно) https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/index.html

raidz2 конечно очень широкий, стоит несколько vdevs использовать, либо сразу draid https://openzfs.github.io/openzfs-docs/Basic%20Concepts/dRAID%20Howto.html

а так ещё из базового - xattr=sa,atime=off, мб при желании sync=disabled т.к. бекапы (обязательно прочесть в доке про каждую пропертю перед применением)

дедуп рассматривать только после понимания, что такое синхронный дедуп, что такое DDT и почему он должен помещаться в ОЗУ

ну и recordsize ещё глянуть, и учесть что recordsize<32k даёт плохую утилизацию по месту для raidz

Благодарю, сейчас импортирую этот же пул с новыми опциями:

sudo zpool import -d /dev/disk/by-id/... -d /dev/disk/by-id/etc... ... -o xattr=sa -o atime=off -o sync=disabled -o redundant_metadata=most

Но получаю property 'xattr' is not a valid pool property. Пробовал и через запятую вместо того чтоб каждую опцию индивидуальным флагом ставить, не признает он почему-то.

George

George

Nikolay

Nikolay

Δαρθ

Δαρθ