central

central

central

central

бл*ть, фс то выжила а насколько у вас там фраш из данных это уже слегка более глубокий вопрос

Станислав

Станислав

Станислав

Станислав

данные могут повреждаться еще до вычисления чексуммы

Просто разговор был про то, что умирает ФС от выключения электричества. То, что они некорректные могли поступить, то понятно

Станислав

Станислав

вспоминаются истории с электричеством у нежурналируемой фат и нтфс - вот там даааа

Не, такие ФС не вспоминали, основной упор был, что EXT4 стабильная и проверенная

Δαρθ

Δαρθ

Станислав

Станислав

При том, что чуть ли не каждый день где-то в обслуживаемой сети падал этот ext4 прямиком в initramfs или вообще в полный отказ

Fedor

Fedor

ext4 выключением электричество довольно легко повреждается

там скорее из-за грязных незаписанных страниц

Александр

Александр

Просто разговор был про то, что умирает ФС от выключения электричества. То, что они некорректные могли поступить, то понятно

... ну вообще тут явный намек на профнепригодность

Evgenii

Evgenii

У меня на 3х машинах без видимых проблем со swap разделом в самом zfs. Ладно на одной 128Гб оперативы и свободной много, а на двух по гигу оперативы, своп временами юзается, но не активно

как создавали? напишите какие свойства у тома. Я вчера тестировал, у меня нода падала.

zfs create -V 64G -b $(getconf PAGESIZE) -o compression=zle \

-o primarycache=metadata -o secondarycache=none \

-o sync=always -o logbias=throughput \

-o com.sun:auto-snapshot=false rpool/swap

Ivan

Ivan

А ещё говорят, что ZFS при аварийном отключении обязательно падает

это один болезный в квм чатике носится с этой идеей

central

central

Evgenii

Evgenii

Тестировал так: на ноде 128 gb ram, как только в SWAP залазит, все зависает.

stress --vm 1 --vm-bytes 140000000000

При этом если swap на отдельном SSD, то отлично работает даже когда в SWAP падает 50-60 гб

Еще тестировал zram, если немного и "не быстро" в него залазить, то все работает, но если резко, то сервер надолго может застрять в 100% загрузке CPU по все 32 ядрам процессом z_wr_iss. Этим же тестом можно проверить. Сервер конечно не падает, но все что на нем запущено почти замирает. (routerOS может даже на пинги перестать успевать отвечать)

Александр

Александр

если планируется активная запись в него

То-то у меня за последние, хм, лет пять ни разу не слетало...

Станислав

Станислав

как создавали? напишите какие свойства у тома. Я вчера тестировал, у меня нода падала.

zfs create -V 64G -b $(getconf PAGESIZE) -o compression=zle \

-o primarycache=metadata -o secondarycache=none \

-o sync=always -o logbias=throughput \

-o com.sun:auto-snapshot=false rpool/swap

Один в один, не считая размера. У меня ядро 5.4, zfs 2.1.2

George

George

BSD

жалобы про линь в основном. В общем разрабы не упарывались пока в свап, гарантий нет но и сказать что у всех моментально разваливается

Владимир

Владимир

George

George

George

George

не каждый день нужно, поставить в дебиане пакет и дождаться сборки - пара минут. Не отговариваю иметь готовый образ, просто под рукой обычно уже есть исошник системы

Art

Art

я даже не думал что существует специальный лайвсиди)

Есть сборка SystemResque с зфс 2.0 на борту

Nikolay

Nikolay

не каждый день нужно, поставить в дебиане пакет и дождаться сборки - пара минут. Не отговариваю иметь готовый образ, просто под рукой обычно уже есть исошник системы

не всегда на лайв сиди есть возможность инет настроить. А нужно загрузиться и что-то сделать.

Sergey

Sergey

собственно, вот: https://github.com/nchevsky/systemrescue-zfs

Последний коммит 15 декабря 2020

Art

Art

собственно, вот: https://github.com/nchevsky/systemrescue-zfs

Последний коммит 15 декабря 2020

Оо, да, вот она, точно. Блин, жаль что не развивается. Ванильный-то дистрибутив ведь уже 9 версию перешагнул

Aleksey

Aleksey

собственно, вот: https://github.com/nchevsky/systemrescue-zfs

Последний коммит 15 декабря 2020

Проверил в grml линуксе (для сисадминов лайв)тоже нет поддержки zfs из коробки.

Владимир

Владимир

не всегда на лайв сиди есть возможность инет настроить. А нужно загрузиться и что-то сделать.

Ну у меня не было такого

Владимир

Владимир

Есть сборка SystemResque с зфс 2.0 на борту

Я недавно пользовался, переливал данные с lxc на qemu, делал из контейнера виртуалку

Nikolay

Nikolay

Я недавно пользовался, переливал данные с lxc на qemu, делал из контейнера виртуалку

могли бы составить мануальчик ?)

Владимир

Владимир

могли бы составить мануальчик ?)

Делаем раздел, к примеру ext4, синхроним туда все файлы с lxc за исключением сис прок и дев, цхрутимся туда, ставим ядро и граб, инстал им граб. Всё

Δαρθ

Δαρθ

подскажите, что даёт zfs redact?

ну например делают снапшот, потом клон, потом из него удаляю ненужное, потом шлю получившееся на удаленную локацию. где тут zfs redact может помочь и в чем его плюшки?

Николай

Николай

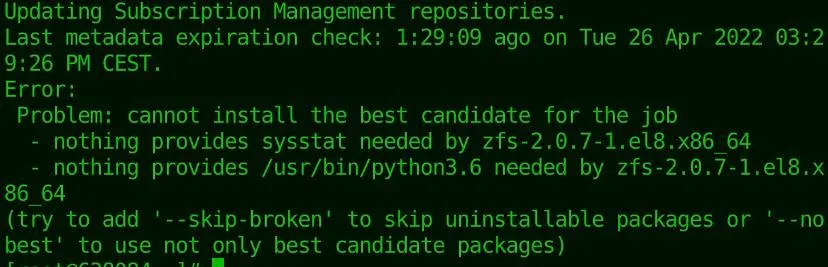

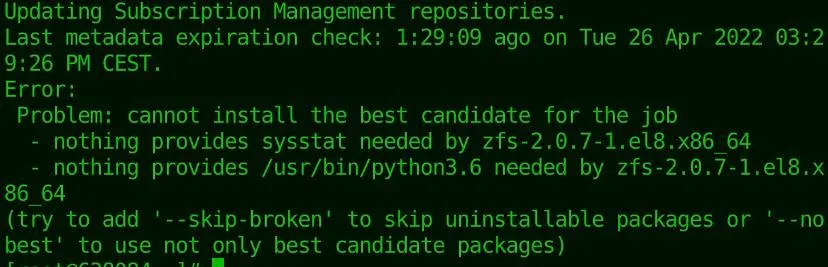

Ivan

Ivan

Николай

Николай

сначала надо найти и подключить репу, которая питон 3.6 пердоставляет

Не подскажите как это сделать?

George

George

подскажите, что даёт zfs redact?

ну например делают снапшот, потом клон, потом из него удаляю ненужное, потом шлю получившееся на удаленную локацию. где тут zfs redact может помочь и в чем его плюшки?

возможность отправить zfs send stream без каких-то данных, например sensitive инфы (пароли, персоналка)

Δαρθ

Δαρθ

возможность отправить zfs send stream без каких-то данных, например sensitive инфы (пароли, персоналка)

а как это делать? доку читал, дочитал до 'example', суть повествования потерял

Ivan

Ivan

А почему не правильно?

у rhel свои репы и экосистема, а подключение сторонней репы может снизить безопасность например

George

George

а как это делать? доку читал, дочитал до 'example', суть повествования потерял

вот большой кусок инфы https://openzfs.github.io/openzfs-docs/man/8/zfs-redact.8.html#Redaction

Δαρθ

Δαρθ

вот большой кусок инфы https://openzfs.github.io/openzfs-docs/man/8/zfs-redact.8.html#Redaction

я про него и говорю. там нет реальных примеров и потому вощем-то неясно, что делать

George

George

я про него и говорю. там нет реальных примеров и потому вощем-то неясно, что делать

ну там пример что делать, но да, без команд)

Δαρθ

Δαρθ

я вполне понимаю как такие доки пишут — у разрабов и так всё в голове, и они пишут что-то для того, у кого тоже всё в голове :)

Ivan

Ivan

Не подскажите как это сделать?

subscription-manager repos --enable rhel-8-server-optional-rpms --enable rhel-server-rhscl-8-rpms

возможно это поможет (по аналогии с rhel7)

Николай

Николай

Nick

Nick

Господа, в догонку, а что делать, когда бд лежит не на голом zfs, а поверх файловой системы? Будь то, например, lxc-контейнер c mysql, вм с NTFS-томом и т.п.?

Как-то на уровне zfs или и на уровне zfs + файловой системы поверх можно улучшить взаимодействие бд со стораджем?

на LXD отлично работает, хотя все не доходят руки проверить как это работает при миграции контейнеров

Nick

Nick

Я понимаю, но всё же, когда поверх вольюма есть ещё какая-то гостевая фс (NTFS или EXT4) - что можно сделать?

И дают ли стандартные рекомендации по тюнингу в таком сценарии какой-то эффект?

в случае с ext4 лучшая рекомендация - вынести её журнал на отдельный диск. Подробности с тестами были в блоге перконы

Nick

Nick

LXC-контейнер как раз и не использует свою ФС, а получает в пользование ZFS-датасет, то есть типа "папку"

Что касается случаев, когда используется именно полноценная ВМ, то есть у нас ФС типа NTFS или ext4 поверх тома ZFS, то имеются свои рекомендации по тюнингу конечно. Например, желательно выровнять volblocksize под БД

не обязательно ZFS, там можно и ext4 использовать отлично. будет на 3% быстрее в среднем на сценариях около шаред хостинга

Nick

Nick

Потому, порядок действий такой:

1) Создаём zvol с нужным volblocksize

2) Создаём ФС, для многих из них есть параметры для тюнинга под размер блока данных, чтобы ФС их складировала не разрозненно.

Например, в ext4 stride указывает, сколько кластеров должны формировать блок данных. Так как этот тюнинг рассчитан был на корректное размещение данных для raid в stripe, то, желательно, указать stripe-width. В случае с ZFS, он всегда равен stride.

3) Я отключал журналирование данных в ext4, так как у нас эту функцию выполняет zfs. Оставлял только метаданные.

4) Монтирование в виртуальной машине. К сожалению, не записал нигде. Насколько помню: data=ordered,noatime,nobarrier

не надо zvol, достаточно просто датасет. В случае с LXD/докер и подобным если хочется заморачиваться тюнингом можно для конкретно мускля сделать датасет с 16к и кеш=метадата. Отлично всё работает

Nikita

Nikita

Благодарю, но вопрос скорее касался оптимизаций ввиду наличия дополнительных слоёв абстракций в сценариях, когда используются сторонние файловые системы поверх zfs.

Вынос журналов и т.п. характерен для по сути любых инсталляций.

Nick

Nick

Потому, порядок действий такой:

1) Создаём zvol с нужным volblocksize

2) Создаём ФС, для многих из них есть параметры для тюнинга под размер блока данных, чтобы ФС их складировала не разрозненно.

Например, в ext4 stride указывает, сколько кластеров должны формировать блок данных. Так как этот тюнинг рассчитан был на корректное размещение данных для raid в stripe, то, желательно, указать stripe-width. В случае с ZFS, он всегда равен stride.

3) Я отключал журналирование данных в ext4, так как у нас эту функцию выполняет zfs. Оставлял только метаданные.

4) Монтирование в виртуальной машине. К сожалению, не записал нигде. Насколько помню: data=ordered,noatime,nobarrier

отключать журналирование в ext4, который поверх zfs плохая идея в ряде ситуаций, и особенно в дефолтных настройках ext4 - с очень большой гарантией можно получить поврежденные таблицы.

Кроме того, мускль на ехт4 на зфс заведомо медленнее, чем нативно на любом из, а write amplification зашкаливает

Vladislav

Vladislav