вот пример автобенча для флетчера

# cat /proc/spl/kstat/zfs/fletcher_4_bench

0 0 0x01 -1 0 26858661902 945001505309971

implementation native byteswap

scalar 8334384494 5671699473

superscalar 8544267464 6845412445

superscalar4 11575709515 8684296724

sse2 13669017997 8638081554

ssse3 13407335780 13777191269

avx2 22366778267 22693584864

fastest avx2 avx2

вот вам бенч с ryzen 3950x

ivdok

ivdok

Привет, у меня есть вопрос по поводу ремаунта пула и всех его датасетов, но в другой корень. Есть такая структура:

root@archiso ~ # zfs list

NAME USED AVAIL REFER MOUNTPOINT

rpool 2.17G 858G 96K /mnt

rpool/k8s 2.17G 858G 192K none

rpool/k8s/DATA 26.5M 858G 192K none

rpool/k8s/DATA/default 26.3M 858G 192K /

rpool/k8s/DATA/default/home 192K 858G 192K /home

rpool/k8s/DATA/default/root 23.1M 858G 23.1M /root

rpool/k8s/DATA/default/srv 208K 858G 208K /srv

rpool/k8s/DATA/default/usr 456K 858G 192K /usr

rpool/k8s/DATA/default/usr/local 264K 858G 264K /usr/local

rpool/k8s/DATA/default/var 2.22M 858G 192K /var

rpool/k8s/DATA/default/var/lib 1.50M 858G 192K /var/lib

rpool/k8s/DATA/default/var/lib/containerd 192K 858G 192K /var/lib/containerd

rpool/k8s/DATA/default/var/lib/libvirt 192K 858G 192K /var/lib/libvirt

rpool/k8s/DATA/default/var/lib/lxc 192K 858G 192K /var/lib/lxc

rpool/k8s/DATA/default/var/log 348K 858G 340K /var/log

rpool/k8s/DATA/default/var/spool 200K 858G 200K /var/spool

rpool/k8s/ROOT 2.14G 858G 192K none

rpool/k8s/ROOT/default 2.14G 858G 2.14G /

Она настроена на маунт в корень, мне надо вместо этого примонтировать в /mnt вместе со всеми датасетами внутри, чтобы чрутнуться, но я в упор не могу понять, который из датасетов надо править через zfs set mountpoint=/mnt. Наследуются они все от rpool/k8s/DATA/default, но у него пропертя canmount=off.

ivdok

ivdok

Делал по гайду с openzfs орг, Там где /Getting Started/Arch Linux/Root on ZFS/2-system-installation

ivdok

ivdok

Суть - я запутался в этом сраном гайде, и в rootfs лежит какой-то неправильный zpool.cache, который из-за chattr +i не может быть перезаписан, и система падает с кёрнелом

George

George

George

George

George

George

Арч честно говоря не тестил, там китаец его пушил, он вроде проверял, если косяк нашёл - пиши, залью

ivdok

ivdok

Арч честно говоря не тестил, там китаец его пушил, он вроде проверял, если косяк нашёл - пиши, залью

Да чтобы найти косяк, надо сначала найти его, а я как-то закрутил лихо с самого начала (без бут пула и граба)

ivdok

ivdok

Zpool import -R

Получилось вроде, но для рекурсивного маунта пришлось взять хак в виде zfs list -rH -o name rpool | xargs -L 1 zfs mount

George

George

Получилось вроде, но для рекурсивного маунта пришлось взять хак в виде zfs list -rH -o name rpool | xargs -L 1 zfs mount

zfs mount -a если датасеты монтируемые поможет тоже

ivdok

ivdok

А как вот такое дебажить? В консоли постоянно сыпется "invalid or missing cache file", потом ругается, что не может найти пул мой, потом kernel паник из-за отсутствующего rootfs

George

George

George

George

systemd-boot, но хотел efistub или refind

хм, ну они должны без boot пула работать. В общем либо cache file должен присутствовать в initramfs, либо руками ядру сказать загружаться с конкретного пула

по аналогии с грабом

GRUB_CMDLINE_LINUX="root=ZFS=rpool/ROOT" или вместо имени пула можно ещё auto чтоли, но тут как повезёт

Δαρθ

Δαρθ

Добрый вечер!

Что скажете про ZFS в raid для сервера бэкапов?

Спасибо!😊☺️😊

сильно лучше чем mdraid :)

Ķ₳ℝḾ₳

Ķ₳ℝḾ₳

сильно лучше чем mdraid :)

Вот просто сейчас он, но развалился, хочу пересобрать на ZFS...😊😅😊

Δαρθ

Δαρθ

Вот просто сейчас он, но развалился, хочу пересобрать на ZFS...😊😅😊

как именно развалился?

Ķ₳ℝḾ₳

Ķ₳ℝḾ₳

как именно развалился?

Ой, я пока хз...

Завтра забирать буду этот PC и смотреть, отвалился он...

Олег

Олег

Есть желание раширить пул с помощью дисков MG09ACA18TE. Там технология MAMR , наксколько она жива с zfs? Ну и отговорите от диска)

Art

Art

Есть желание раширить пул с помощью дисков MG09ACA18TE. Там технология MAMR , наксколько она жива с zfs? Ну и отговорите от диска)

диск дрянь!

на самом деле нет, энтерпрайзные диски Тошибы очень хороши👍, у меня много их в 12 ТБ версии, нареканий нет. Юзаю в ZFS как раз.

Но вот как сочетаются ZFS и MAMR вообще непонятно! Инфы ноль. Это же первый диск вообще вроде с MAMR

Δαρθ

Δαρθ

Олег

Олег

Art

Art

Отговорили)) возьму 10TB тогда, которые проверены

12 тоже точно норм) Да и любой диск с PMR\СMR

Но блин, 18-то прикольнее... А напиши запрос в Тошибу) Может подскажут, если там вопрос дойдёт до инженера настоящего

George

George

George

George

почему кстати? лагать будет или из массива выпадать?

работать будет, с известными проблемами по перформансу

Art

Art

SMR nooooo

ох, блин, что я написал... CMR конечно! Как русское эс! Не как доллар!

Простите, народ

Δαρθ

Δαρθ

работать будет, с известными проблемами по перформансу

ок. значит мне для бекапов на 4мб/с канале сойдет )))

George

George

ок. значит мне для бекапов на 4мб/с канале сойдет )))

просто часто можно найти cmr за ту же цену

Δαρθ

Δαρθ

[возвращаясь к тебе бенчмарка чексуммов]

правильно ли я вижу что edonr работает в 512битовом режиме?

module/zfs/edonr_zfs.c:#define EDONR_MODE 512

module/zfs/edonr_zfs.c: EdonRInit(ctx, EDONR_MODE);

Ķ₳ℝḾ₳

Ķ₳ℝḾ₳

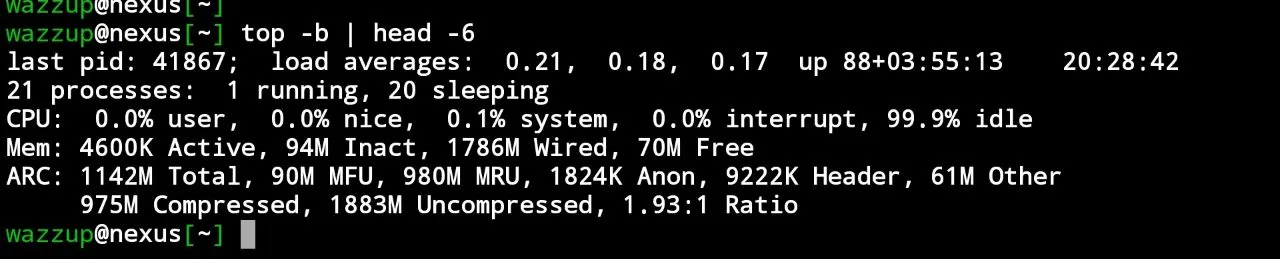

А подскажите насколько критично надобность SSD для кэша?

Сейчас стоит парочка HDD WD Red;

Хочется ZFS RAID 1 будут сливаться бэкапы раз в день, там в сумме 30Gb,где-то выходит, из Proxmox...

Спасибо!

Ķ₳ℝḾ₳

Ķ₳ℝḾ₳

а насколько вам там вообще нужен кеш?

Вот и я думаю, может он там вообще не нужен...

И ОЗУ тоже не нужен в больших количествах!

DOK ꧁꧂

DOK ꧁꧂

Привет всем! такая проблема: пишет что снапшотами все забито. как удалить снапшоты которые убунта зачемто понаделала?

Ilya

Ilya

Вот и я думаю, может он там вообще не нужен...

И ОЗУ тоже не нужен в больших количествах!

Ни то ни другое тебе толку не даст.

f1gar0

f1gar0

Добрый день у нас холивар есть 12 sas 15k дисков raid контроллер не умеет HBA / JBOD что будет если сделать raid 0 и развернуть на нем zfs?

f1gar0

f1gar0

ок спасибо за развернутый ответ а то начали холиварить что HHHL 1735 от самсунг по сути тоже раид только там прямой доступ к ячейкам идет

central

central

Добрый день у нас холивар есть 12 sas 15k дисков raid контроллер не умеет HBA / JBOD что будет если сделать raid 0 и развернуть на нем zfs?

Подсунуть zfs вместо физического диска raid 0? И в прод?

Anonymous

Anonymous

Подскажите, пожалуйста, как загуглить проблему. Есть пул stor1 (raidz2) в нём датасет /bact на нем квота 10TB . Записываю туда много мелких файлов, общим объемом где то 5 ТБ, записалось 1.7 ТБ данных, а потом собственно ошибка - кончилось место. В случае всяких там ext4 я бы посмотрел что по inode, на что мне смотреть в ZFS ?

Ilya

Ilya

А в пуле-то место есть свободное?

И ты смотри на той машине, где экспорт, а не той, куда он смонтирован

Anonymous

Anonymous

место есть

root@es:/# zfs list

NAME USED AVAIL REFER MOUNTPOINT

stor1 2.91T 30.2T 238K /stor1

stor1/bacteria 1.28T 8.72T 1.28T /stor1/bacteria

stor1/plants 1.63T 1.37T 1.63T /stor1/plants

Fedor

Fedor

Aleksei

Aleksei

Egor V

Egor V