f1gar0

f1gar0

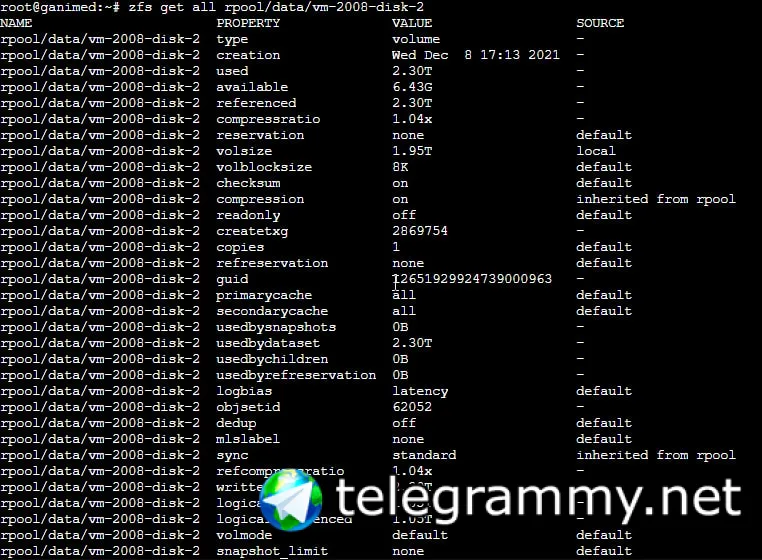

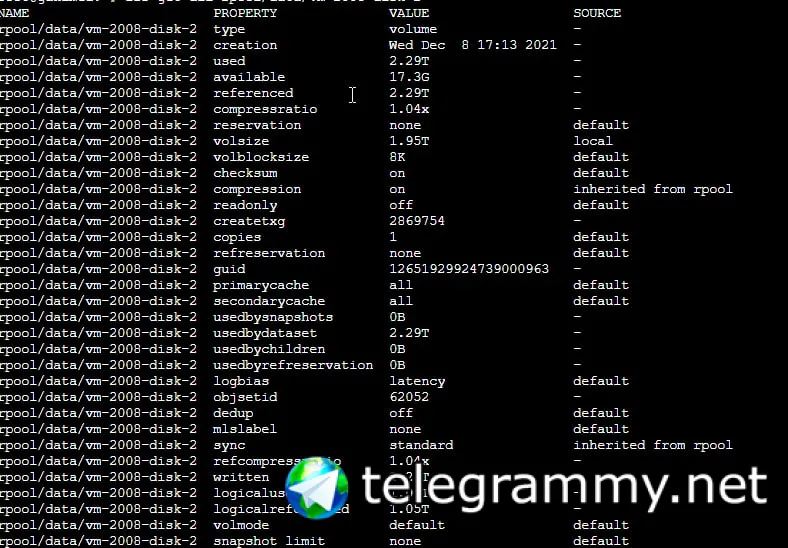

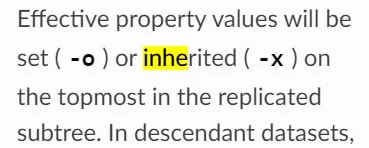

NAME PROPERTY VALUE SOURCE

rpool/data/vm-2008-disk-2 type volume -

rpool/data/vm-2008-disk-2 creation Wed Dec 8 17:13 2021 -

rpool/data/vm-2008-disk-2 used 2.29T -

rpool/data/vm-2008-disk-2 available 17.3G -

rpool/data/vm-2008-disk-2 referenced 2.29T -

rpool/data/vm-2008-disk-2 compressratio 1.04x -

rpool/data/vm-2008-disk-2 reservation none default

rpool/data/vm-2008-disk-2 volsize 1.95T local

rpool/data/vm-2008-disk-2 volblocksize 8K default

rpool/data/vm-2008-disk-2 checksum on default

rpool/data/vm-2008-disk-2 compression on inherited from rpool

rpool/data/vm-2008-disk-2 readonly off default

rpool/data/vm-2008-disk-2 createtxg 2869754 -

rpool/data/vm-2008-disk-2 copies 1 default

rpool/data/vm-2008-disk-2 refreservation none default

rpool/data/vm-2008-disk-2 guid 12651929924739000963 -

rpool/data/vm-2008-disk-2 primarycache all default

rpool/data/vm-2008-disk-2 secondarycache all default

rpool/data/vm-2008-disk-2 usedbysnapshots 0B -

rpool/data/vm-2008-disk-2 usedbydataset 2.29T -

rpool/data/vm-2008-disk-2 usedbychildren 0B -

rpool/data/vm-2008-disk-2 usedbyrefreservation 0B -

rpool/data/vm-2008-disk-2 logbias latency default

rpool/data/vm-2008-disk-2 objsetid 62052 -

rpool/data/vm-2008-disk-2 dedup off default

rpool/data/vm-2008-disk-2 mlslabel none default

rpool/data/vm-2008-disk-2 sync standard inherited from rpool

rpool/data/vm-2008-disk-2 refcompressratio 1.04x -

rpool/data/vm-2008-disk-2 written 2.29T -

rpool/data/vm-2008-disk-2 logicalused 1.05T -

rpool/data/vm-2008-disk-2 logicalreferenced 1.05T -

rpool/data/vm-2008-disk-2 volmode default default

rpool/data/vm-2008-disk-2 snapshot_limit none default

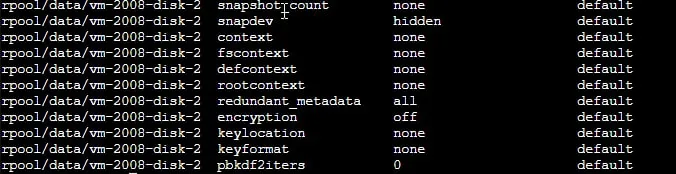

rpool/data/vm-2008-disk-2 snapshot_count none default

rpool/data/vm-2008-disk-2 snapdev hidden default

rpool/data/vm-2008-disk-2 context none default

rpool/data/vm-2008-disk-2 fscontext none default

rpool/data/vm-2008-disk-2 defcontext none default

rpool/data/vm-2008-disk-2 rootcontext none default

rpool/data/vm-2008-disk-2 redundant_metadata all default

rpool/data/vm-2008-disk-2 encryption off default

rpool/data/vm-2008-disk-2 keylocation none default

rpool/data/vm-2008-disk-2 keyformat none default

rpool/data/vm-2008-disk-2 pbkdf2iters 0 default

Art

Art

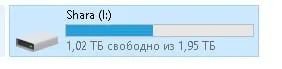

я понимаю о чем речь но избежать то как?) к херам убрать эти ssd&

у меня только плохие новости... Избежать уже никак.

У тебя один путь: пересоздать пул. Причём есть два варианта как:

1) Создать пул типа зеркало. С ним всё будет спокойно, быстро, надёжно и незаморочно. Никакой амплификации. Быстрая запись. Легкая расширяемость. Сплошные плюсы, кроме одного понятно жирного минуса. Я лично только зеркала и использую.

2) Создать снова пул типа raidz , но уже вдумчиво подобрать параметры ashift и volblocksize так, чтобы этот самый write ampflication был поменьше. Приёдтся пошерстить гугл, форумы и потестить прежде чем запускать прод. Возможно, это стоит того, тут всё индивидуально.

f1gar0

f1gar0

f1gar0

f1gar0

Art

Art

zpool trim [-d] [-c | -s] pool [device...] это не спаесет?

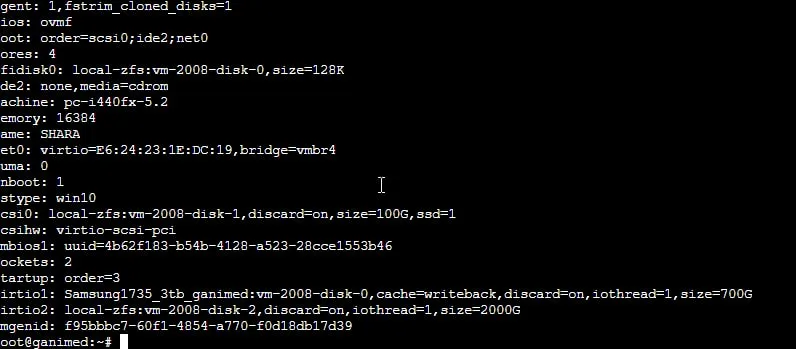

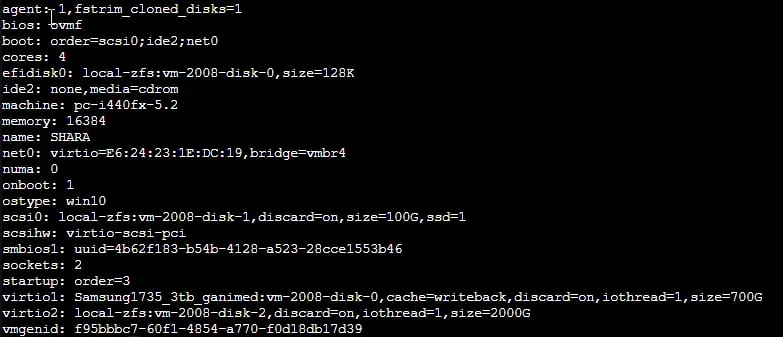

покажи конфиг ВМ

cat /etc/pve/qemu-server/100.conf

Art

Art

Δαρθ

Δαρθ

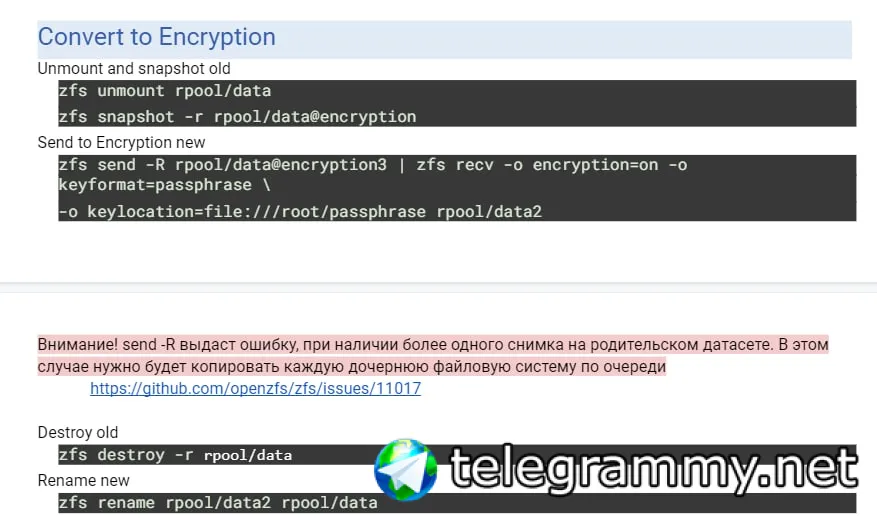

Есть 2 способа

1) отправлять в датасет, родитель которого защифрован, свойство будет унаследовано

2) изменить свойство во время приема

Send to Encryption new zfs send -R rpool/data@encryption3 | zfs recv -o encryption=on -o keyformat=passphrase \

-o keylocation=file:///root/passphrase rpool/data2

2ым способом вышло создать, но вот инкрементально уже не принимает:

# zfs send store_pool/store_set/Test@first | pv | ssh -p 33333 root@localhost "zfs recv -o encryption=on -o keyformat=passphrase -o keylocation=file:///root/pass -o checksum=sha256 test_pool/test_set/Test_enc"

## всё ок

# zfs send -i store_pool/store_set/Test@first store_pool/store_set/Test@second | pv | ssh -p 33333 root@localhost "zfs recv test_pool/test_set/Test_enc"

cannot receive incremental stream: destination test_pool/test_set/Test_enc has been modified ]

ЧЯДНТ?

Δαρθ

Δαρθ

на приёмнике вот такое

# zfs list -t all

NAME USED AVAIL REFER MOUNTPOINT

test_pool 139G 713G 96K none

test_pool/test_set 139G 713G 112K /test

test_pool/test_set/Data 102G 713G 102G /test/Data

test_pool/test_set/Maps 331M 713G 330M /test/Maps

test_pool/test_set/Maps@test1 912K - 330M -

test_pool/test_set/Music 34.2G 713G 34.2G /test/Music

test_pool/test_set/Test_enc 2.88G 713G 2.88G /test/Test_enc

test_pool/test_set/Test_enc@first 1.11M - 2.88G -

т..е первый приняло

Evgenii

Evgenii

Δαρθ

Δαρθ

Evgenii

Evgenii

https://github.com/openzfs/zfs/issues/11017

видимо ждать пока починят

поищу по открытым багам здесь.

Evgenii

Evgenii

Δαρθ

Δαρθ

дочерние датасеты будут наследовать тип ключа и путь к ключу

не прокатило. та же самая ошибка.

писал zfs recv test_pool/test_set/Test_enc/Test

т.е. внутри шифровавнного Test_enc создал приёмом Test

а потом в него точно так же попытался залить дифф

Δαρθ

Δαρθ

zfs send store_pool/store_set/Test@first | pv | ssh -p 33333 root@localhost "zfs recv test_pool/test_set/Test_enc/Test"

zfs send -i store_pool/store_set/Test@first store_pool/store_set/Test@second | pv | ssh -p 33333 root@localhost "zfs recv test_pool/test_set/Test_enc/Test"

2ое точно так же обломалось

Evgenii

Evgenii

zfs send -R rpool/test@2 | zfs recv -x encryption rpool/data/test

zfs get encryption,encryptionroot,keystatus rpool/test rpool/data/test

NAME PROPERTY VALUE SOURCE

rpool/data/test encryption aes-256-gcm -

rpool/data/test encryptionroot rpool/data -

rpool/data/test keystatus available -

rpool/test encryption off default

rpool/test encryptionroot - -

rpool/test keystatus - -

zfs list -t snapshot rpool/data/test

NAME USED AVAIL REFER MOUNTPOINT

rpool/data/test@1 0B - 168K -

rpool/data/test@2 0B - 168K -

Evgenii

Evgenii

У этого свойства проблема с установкой для снимков... Не меняйте потом поля, которые отвечают за шифрование.. это может плохо закончиться (скорее всего из за этой проблемы).

Δαρθ

Δαρθ

У этого свойства проблема с установкой для снимков... Не меняйте потом поля, которые отвечают за шифрование.. это может плохо закончиться (скорее всего из за этой проблемы).

мне надо было первый снапшот вливать с -x encryption или что? Не соображу чото

Evgenii

Evgenii

Δαρθ

Δαρθ

вливайте через R, как привыкли, у команды recv вызывайте -x - наследование свойтва

я пока ещё никак не привык... Можно пояснить, что делает -R? Ну кроме того, что все под-датасеты датасета тоже шлёт

Evgenii

Evgenii

свойства тоже шлет с источника, по моему.

то есть без явного наследования на приемнике (-x), шифрование не будет, несмотря на то что родитель зашифрован

Δαρθ

Δαρθ

свойства тоже шлет с источника, по моему.

то есть без явного наследования на приемнике (-x), шифрование не будет, несмотря на то что родитель зашифрован

не соглашусь. Вот так вот:

`zfs send store_pool/store_set/Test@first | pv | ssh -p 33333 root@localhost "zfs recv test_pool/test_set/Test_enc/Test"`

где Test_enc был ранее зашифрованным, Test отнаследовал шифрование у него

Δαρθ

Δαρθ

# zfs get all test_pool/test_set/Test_enc/Test | grep encryption

test_pool/test_set/Test_enc/Test encryption aes-256-gcm -

test_pool/test_set/Test_enc/Test encryptionroot test_pool/test_set/Test_enc -

Evgenii

Evgenii

Δαρθ

Δαρθ

# zfs send -R store_pool/store_set/Test@first | pv | ssh -p 33333 root@localhost "zfs recv -x encryption test_pool/test_set/Test_enc/Test2"

root@localhost's password:

3,07GiB 0:00:33 [92,8MiB/s] [ <=> ]

# zfs send -R -i @first store_pool/store_set/Test@second | pv | ssh -p 33333 root@localhost "zfs recv -x encryption test_pool/test_set/Test_enc/Test2"

root@localhost's password:

cannot receive incremental stream: destination test_pool/test_set/Test_enc/Test2 has been modified ]

since most recent snapshot

Ровно та же ошибка