nikolay

nikolay

остальную емкость отдам на l2arc )

может лучше special vdev сделать? особенно если много записи

nikolay

nikolay

туда пишутся метаданные и ряд операций небольшим блоком, в моем случае это достаточно полезно когда много записи в базе данных

nikolay

nikolay

Просто я не понимаю, в чем функции special устройства. На Хабре тоже смысл этого не раскрыт)

ну можно сходить в гугл)

nikolay

nikolay

Понятно) а размерность этого устройства какой сделать? Чем больше тем лучше?

3-5% от размера пула вроде рекомендуют.

Andrey

Andrey

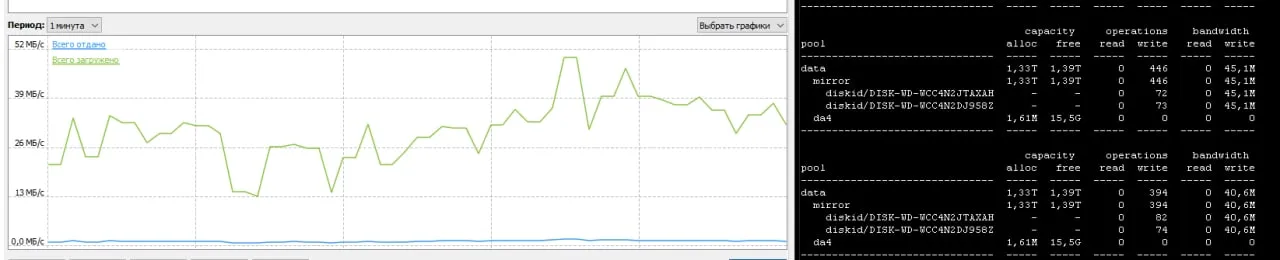

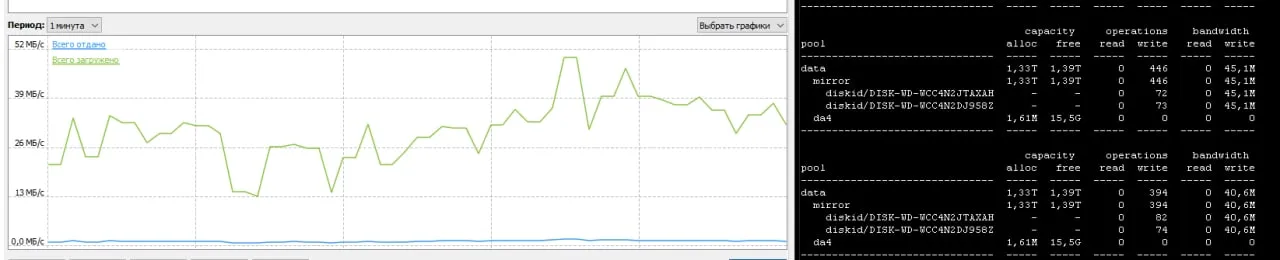

т. е. выигрыша от l2arc у меня почти никакого, а special vdev реально ускоряет

l2arc, как и arc, не для записи, а для чтения

Anonymous

Anonymous

l2arc, как и arc, не для записи, а для чтения

а для записи сильно поможет SSD ?

это так, для домашнего NAS Freenas интересуюст

Ilya

Ilya

а для записи сильно поможет SSD ?

это так, для домашнего NAS Freenas интересуюст

Зависит от характера нагрузки.

Во FreeNAS используется та же OpenZFS.

Если простая SMB-шара под фоточки, то если только все vdev на SSD будут.

Ilya

Ilya

log vdev не поможет.

Special - да, но его следует создавать с тем же уровнем отказоустойчивости, как и основной пул - в твоём случае - тоже зеркало.

Anonymous

Anonymous

log vdev не поможет.

Special - да, но его следует создавать с тем же уровнем отказоустойчивости, как и основной пул - в твоём случае - тоже зеркало.

Понял. Тогда оставлю эта затею.

Стоит один ссд в l2arc

Ilya

Ilya

кстати на торрентах зфс себя хорошо ведет?

Δαρθ

Δαρθ

А с чего бы ему себя плохо вести?

при скачке данные в файл пишутся рандомно причем не по границам блоков

Ilya

Ilya

при скачке данные в файл пишутся рандомно причем не по границам блоков

а в zfs они пишутся последовательно же

Δαρθ

Δαρθ

а в zfs они пишутся последовательно же

в смысле последовательно в порядке скачки но файл получается фрагментированным вхлам?

Ilya

Ilya

Мне казалось что так. txg пишутся целиком в блоки из того, что набралось в RAM. А уж насколько это фрагментированный файл - другое дело. Но тут могу заблуждаться

Ilya

Ilya

Δαρθ

Δαρθ

Мне казалось что так. txg пишутся целиком в блоки из того, что набралось в RAM. А уж насколько это фрагментированный файл - другое дело. Но тут могу заблуждаться

а если клиент перед отписью делает на файл fallocate, это както помогает zfs? или ей пох?

Δαρθ

Δαρθ

btrfs например выделяет место заранее. если блоки торрента ложатся по блокам диска, файл получается нефрагментированным. иначе (раздача из неск файлов) -- вхлам

Ilya

Ilya

по скорости преимущества не увижу, так как на зеркале из 2х5400 ТБ и так упираюсь в тариф при скачивании/записи.

А тестировать степень фрагментации не умею/не хочу

Иван

Иван

кстати на торрентах зфс себя хорошо ведет?

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Workload%20Tuning.html#bit-torrent

central

central

в смысле последовательно в порядке скачки но файл получается фрагментированным вхлам?

Скачал 100 Гб на 500 Гб диск, фрагментация 2%

Δαρθ

Δαρθ

https://openzfs.github.io/openzfs-docs/Performance%20and%20Tuning/Workload%20Tuning.html#bit-torrent

прям первое предложение неверно.

Bit torrent performs 16KB random reads/writes

я наблюдал размеры блоков от 256кб до 16мб

Δαρθ

Δαρθ

и кажется во многих клиентах есть создание файла перед записью в него

вот я и спрашиваю, помогает ли это хоть как-то zfs

Ivan

Ivan

вот я и спрашиваю, помогает ли это хоть как-то zfs

кмк ей это не тяжело, но если экономить на спичках, объединение операций записи будет полезным и не на zfs тоже.

Ivan

Ivan

если качать например 100гб, не пообъединяешь особо, рамы не хватит )

не. размер буфера тоже настраивается. в итоге часто пишешь вместо множества операций мелкими блоков будет меньше операций, но большими блоками.

central

central

блин ну это же CoW, если есть возможность писать последовательно будет, иначе уже никакого выбора нету, будет писать как сможет

Ilya

Ilya

и кажется во многих клиентах есть создание файла перед записью в него

Так изменённые блоки (перезапись нулей на актуальные) приведет к почтой записи новых блоков с последующим выбрасыванием ненужных pre-allocated блоков же

Δαρθ

Δαρθ

если так за фрагментацию боишься, то лучше cow не пользовать )

я не то чтобы боюсь, просто интересуюсь

Δαρθ

Δαρθ

а вообще да, лет 10 назад наблюдал дичайшую фрагментацию ехт3 от торрентов. замедление всего io с диском раз в 5 было

Владимир

Владимир

Всем привет, кто подскажет как принудительно отмонтировать?

# zfs unmount -f HDD/media-staging

cannot unmount '/mnt/nfs/staging-dmz/media': unmount failed

Так не прокатывает)

George

George

а если клиент перед отписью делает на файл fallocate, это както помогает zfs? или ей пох?

Преаллокацию отключить, остальное по дефолту на hdd норм

Δαρθ

Δαρθ

Преаллокацию отключить, остальное по дефолту на hdd норм

преаллокация пустого файла как-то меняет поведение ZFS при последующей записи в него?

George

George

преаллокация пустого файла как-то меняет поведение ZFS при последующей записи в него?

Ну если приложение решает прям нулями предзабить то лишние действия просто

Δαρθ

Δαρθ

Ну если приложение решает прям нулями предзабить то лишние действия просто

нет, не нулями. а пустым местом. преаллокация не в смысле нули вписать, а заявить оси что мол пусть-ка в тэтом файле будет 100гб пустоты.

Δαρθ

Δαρθ

На zfs честная преаллокация бессмысленна

честная - это которая с пустотой? Я так и подозревал, спасибо!

George

George

нет, не нулями. а пустым местом. преаллокация не в смысле нули вписать, а заявить оси что мол пусть-ка в тэтом файле будет 100гб пустоты.

В рамках файла заранее выделить емнип нельзя, после обсуждений fallocate частично имплементировали https://github.com/openzfs/zfs/pull/10408

Только проверка по месту в момент создания да sparse.

Владимир

Владимир

Владимир

Владимир

А что скажите про аукцион серверов HETZNER? норм можно брать?

ну только помнить что оно подержанное

central

central

в смысле речь про замену диска потом?

замену диска через DD, иначе какие вообще проблемы могут быть?

Владимир

Владимир

замену диска через DD, иначе какие вообще проблемы могут быть?

воу, кто меняет диски через dd?))

Vladislav

Vladislav

A1EF

A1EF