Ivan

Ivan

Alexander

Alexander

Так и знал, что шарпы- скриптовый язык

Смотря как применять, но дрова на нем наврядли часто пишут.

nikolay

nikolay

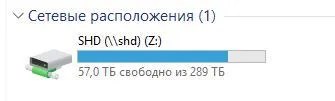

Например у меня был пул из одного vdev на 80 тб, я добавляю ещё один vdev и расширяю пул до 160 тб, в два раза

Fedor

Fedor

Не должно.

В любом случае, надо обкатывать на тесте, хоть операция и простая.

А что это за такие вдевы на 80ТБ?

nikolay

nikolay

Не видел устройств такого размера..

Гм, всего 10 дисков по 12 тб в raidz2 - это 80 тб, по нынешним временам совсем немного

Fedor

Fedor

Fedor

Fedor

По поводу количества дисков в райдз вроде бы были какие-то циферки рекомендуемые. Не вспомню только, это к райдз относится либо к количеству вдевов.

Рекомендую посмотреть поискать.

nikolay

nikolay

Циферки из серии «не более чем»

Точно такого не видел. Кол-во дисков в vdev определяет оверхед по объёму, всем известная табличка это показывает, в случае с raidz оверхед может быть немалым..

Fedor

Fedor

Ivan

Ivan

nikolay

nikolay

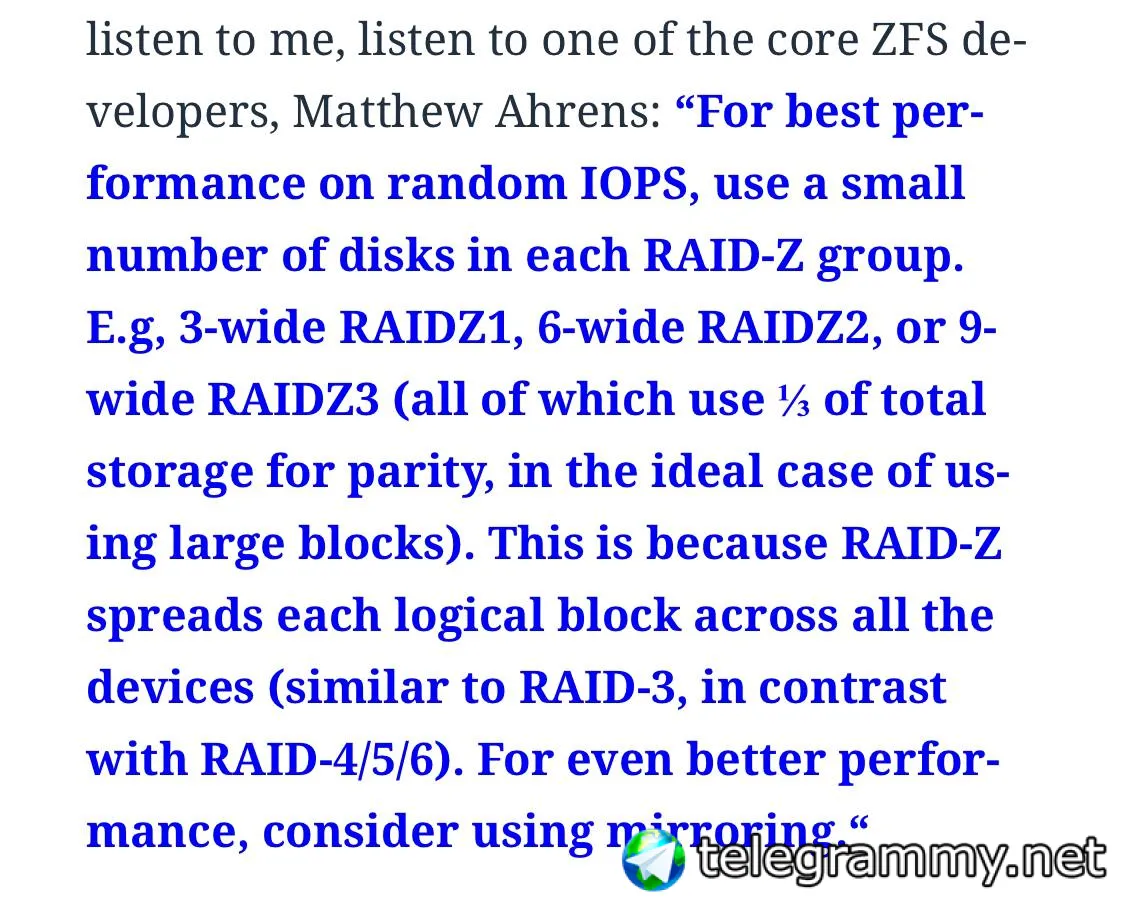

https://jrs-s.net/2015/02/06/zfs-you-should-use-mirror-vdevs-not-raidz/

это я читал, это 2015 год, а рекомендации Арена еще старше. как это соотносится с новыми версиями ZOL? вроде писали что много оптимизаций. я бы хотел увидеть рекомендации из доки по ZOL к конкретной версии

nikolay

nikolay

@gmelikov Георгий, может вы подскажете про ограничение кол-ва дисков на vdev и производительность с этим связанную, а конкретно iops?

George

George

@gmelikov Георгий, может вы подскажете про ограничение кол-ва дисков на vdev и производительность с этим связанную, а конкретно iops?

ограничение верхнее технически конечно есть, 240 чтоли :)

про иопсы не совсем понимаю что хочется узнать, есть базовые вещи про конкретные типы vdevs, иопсы зависят от характера нагрузки, про особенности raidz и выше комментили уже.

По моим личным тестам смысла больше 30 дисков на одном raidz очень мало в плане общего решения, о чём везде, опять же, говорят. Но если нужна поточка, эффективность утилизации сырого пространства и перформансом готовы рисковать, а также потеря пула не очень страшна, то до верхнего предела в около 240 дисков на vdev далеко)

nikolay

nikolay

В общем с иопсами сложно будет.

я вот про это и про статью из блога. мне кажется что информация как минимум устарела. не видел разницы по iops в тестах на пуле из одного vdev например из 6 дисков в raidz2 или из 11 дисков - цифры в рамках 3-5% погрешности.

nikolay

nikolay

ограничение верхнее технически конечно есть, 240 чтоли :)

про иопсы не совсем понимаю что хочется узнать, есть базовые вещи про конкретные типы vdevs, иопсы зависят от характера нагрузки, про особенности raidz и выше комментили уже.

По моим личным тестам смысла больше 30 дисков на одном raidz очень мало в плане общего решения, о чём везде, опять же, говорят. Но если нужна поточка, эффективность утилизации сырого пространства и перформансом готовы рисковать, а также потеря пула не очень страшна, то до верхнего предела в около 240 дисков на vdev далеко)

а так да, согласен что iops зависят в первую очередь от шаблона нагрузки и конфигурации пула - slog, special vdev в определенных случаях очень помогают

nikolay

nikolay

Может быть устарела. Я не использую райдзы вообще, подтвердить или опровергнуть не смогу

ну а я только их и использую)

George

George

я вот про это и про статью из блога. мне кажется что информация как минимум устарела. не видел разницы по iops в тестах на пуле из одного vdev например из 6 дисков в raidz2 или из 11 дисков - цифры в рамках 3-5% погрешности.

на пуле из одного raidz vdev количество дисков на random io мало влиять будет, в том и цимес

George

George

это я читал, это 2015 год, а рекомендации Арена еще старше. как это соотносится с новыми версиями ZOL? вроде писали что много оптимизаций. я бы хотел увидеть рекомендации из доки по ZOL к конкретной версии

raidz принципиально сделан так, чтобы исключить raid write hole, рандомные иопсы на запись всегда будут примерно как у самого медленного диска

nikolay

nikolay

на пуле из одного raidz vdev количество дисков на random io мало влиять будет, в том и цимес

в блоге человек пишет "for best performance on random iops use a small number of disks in each raidz group". про один vdev понятно, как определить зависимость кол-ва iops от кол-ва дисков в, например, 3-х vdev?

Fedor

Fedor

Видимо, в статье шла речь о максимальном распараллеливании нагрузки, чтобы побольше иопс на гигабайт отдавалось

George

George

George

George

в блоге человек пишет "for best performance on random iops use a small number of disks in each raidz group". про один vdev понятно, как определить зависимость кол-ва iops от кол-ва дисков в, например, 3-х vdev?

так примерно просто, в лучшем случае - ДО 3х раз для 3х vdevs же)

Ivan

Ivan

Fedor

Fedor

т.е. для raidz количество дисков не влияет на iops считай

А между вдев нагрузка параллелится же?

George

George

А между вдев нагрузка параллелится же?

да, если потоков больше одного. Запись одного блока всегда приедет на один vdev, а вот запись 2 блоков параллельно может использовать уже 2 vdevs

Fedor

Fedor

George

George

вообще это ж и есть фишка zfs, он скейлится как раз на количество параллельных потоков, и делает тут другие решения

George

George

Может это имелось ввиду?

я не знаю про что вы конкретно с Николаем тут говорите, если честно)

nikolay

nikolay

Может это имелось ввиду?

в статье тема iops раскрыта в сравнении raidz и raid10 - автор прямо рекомендует использовать raid10 для большей производительности и не гридится по поводу потери места))) так что я думаю что в моих конфигурациях иногда можно делать raidz2 даже на 15 дисках, имея при этом, например, 5 vdev в пуле. производительность с учетом использования slog и special vdev приемлемая под размещение баз постгреса..

nikolay

nikolay

Salter в блоге постоянно пишет - it depends. так что предлагаю не создавать очередной миф про zfs, а то народ в чате в основном неокрепший духовно, может и поверить)

Fedor

Fedor

👍👍

Я вот все как-нибудь хотел бы погонять высоконагруженную Постгрес на зфс, посмотреть, потюнить

Василий

Василий

nikolay

nikolay

👍👍

Я вот все как-нибудь хотел бы погонять высоконагруженную Постгрес на зфс, посмотреть, потюнить

смотря что считать высоконагруженной базой. у меня если 10к iops снимают - это уже очень неплохо..

nikolay

nikolay

смотря что считать высоконагруженной базой. у меня если 10к iops снимают - это уже очень неплохо..

операции почти всегда большим блоком и очень много записи, так что мой случай я полагаю не типовой

nikolay

nikolay

Dell вообще считает 5й и аналогии не прод

будете смеяться, у dell emc есть схд которая поддерживает только один тип raid - raid5)))

Fedor

Fedor

смотря что считать высоконагруженной базой. у меня если 10к iops снимают - это уже очень неплохо..

До 30-50 иопс, куча запросов, плюс вкряченный сбоку биай 😁😁😁

Не спрашивай, как так получилось

Василий

Василий

будете смеяться, у dell emc есть схд которая поддерживает только один тип raid - raid5)))

Они ее как домашнюю схд двигают наверное

nikolay

nikolay

Они ее как домашнюю схд двигают наверное

почитайте про dell powerstor, я сильно сомневаюсь что кто-то будет покупать себе домой схд по цене сравнимой с ценой машины среднего уровня в рф.. причем это стартовая цена

nikolay

nikolay

не суть - мой пример про то, что dell некоторое время продавал по своим каналам схд, которая поддерживала только одну конфигурацию - raid5.. а вы говорите 80 тБ на raid5 не делали бы))

nikolay

nikolay

почитайте спеку - для всего оно было и есть - и для виртуализации и для баз и для контейнеров..

nikolay

nikolay

Vladimir

Vladimir

Доброго вечера коллеги, я редко работаю с zfs , но года 2,5 назад собрал на freenas массив raidz3 , на нем работают, все хорошо, сегодня я с него черех smb на винде удалил файл в 40ТБ, но как то объем свободного пространства не увеличился, что может быть? корзины у smb - нет

Ivan

Ivan

Andrew

Andrew