George

George

Такое работает.

Я так один раз серверу под нагрузкой менял директории.

да-да, просто время более реалистичное подсказываю

Vladimir

Vladimir

ммм, секунда в лучшем случае, я бы на полминуты минимум закладывался

ну я имею ввиду меньше минуты, это норм

Alexander

Alexander

Сань, как в опенсорсе посмотреть кто на зфс файл мучает?

Может быть в QPS?

https://blog.desdelinux.net/en/qps-monitor-sistema-qt/

Alexander

Alexander

Он показывает real time для каждого процесса, сколько всего итого байт прочитано и записано, можно отсортировать по колонке и найти, кто больше всех.

Alexander

Alexander

При чем тут RaidZ к RaidD?

https://klarasystems.com/articles/openzfs-draid-finally/

-dRAID[<parity>][:<data>d][:<children>c][:<spares>s]

-[s] spares: The number of disk areas to mix in as distributed spares. No spares are created by default, a maximum of four are welcome. Each spare will remove a fraction of space from every disk.

Alexander

Alexander

Я пока нуб в dRAID, в нем разве нельзя автоматически добавлять новые диски при выходе из строя старых?

Alexander

Alexander

Вчера установил ZFS 0.8.6 на аналог Debian v9 из пакетов бэкпортов v11 для Debian v10, даже не из сорцов.

Mission possible :)

Теперь можно оставаться на девятке еще достаточно долго.

Devuan v2 ASCII - аналог Debian v9 Stretch, очень стабильная сборка. На managed Кубер воркерах Linode еще пару месяцев назад использовал Debian v9, возможно и сейчас все еще его. Серверный дистрибутив, проверенный электроникой, в котором ничего не ломается само по себе.

Объясните мне, зачем вообще нужен RedHat кроме как в качестве запускалки проприетарных монстров типа Oracle Database с бумажками юридического характера для защиты своей филейной части при общении с начальством?

Δαρθ

Δαρθ

Δαρθ

Δαρθ

ну и вообще, zfs это же ядро + утилитки, утилитки можно свежие собрать, ядро тоже, а дистриб оставить старый

Alexander

Alexander

А чо не beowulf уже?

А зачем на хосте? В виртуалках у меня есть и Chimaera и Alpine:latest.

George

George

ну и вообще, zfs это же ядро + утилитки, утилитки можно свежие собрать, ядро тоже, а дистриб оставить старый

Модуль под конкретное ядро легко собираетсо

Alexander

Alexander

ну и вообще, zfs это же ядро + утилитки, утилитки можно свежие собрать, ядро тоже, а дистриб оставить старый

Проблема в том, что libc6 дистра устаревает для утилиток.

Приходится заменять его из более нового (а это целый вечер приключений с зависимостями), - это если ставить из пакетов. Собрать userspace из сорцов наверно можно и на старом libc6.

Василий

Василий

Может быть в QPS?

https://blog.desdelinux.net/en/qps-monitor-sistema-qt/

Не нашёл где оно умеет файлы мониторить

Alexander

Alexander

Не нашёл где оно умеет файлы мониторить

Не отдельные файлы, но хотя бы можно увидеть какой процесс накопительно много читает и пишет или это тоже самое, что iotop, тогда sorry :)

Sergey

Sergey

Всем доброго времени суток.

Подскажите пож. еще такой вопрос. Хотим triple mirror на 20 дисков 8тб sas 7200, без отдельных дисков под метаданные.

Сейчас в наличии 4ре. Можно ли прямо сейчас собирать пул, а новые диски добавлять по мере поступления?

При добавлении нового диска в такой сетап, блоки данных со старых дисков будут перемещены на новые или останутся как есть?

Василий

Василий

Не отдельные файлы, но хотя бы можно увидеть какой процесс накопительно много читает и пишет или это тоже самое, что iotop, тогда sorry :)

Блин. Мне же не надо что попало. Мне надо именно файлы. Бывают непонятные нагрузки, которых в сфере не видн

Василий

Василий

George

George

10й рейд у зфс не честный, поэтому балансировки того что есть не будет

Что такое "не честный рейд"? и при чём тут балансировка?

George

George

Всем доброго времени суток.

Подскажите пож. еще такой вопрос. Хотим triple mirror на 20 дисков 8тб sas 7200, без отдельных дисков под метаданные.

Сейчас в наличии 4ре. Можно ли прямо сейчас собирать пул, а новые диски добавлять по мере поступления?

При добавлении нового диска в такой сетап, блоки данных со старых дисков будут перемещены на новые или останутся как есть?

Можете собрать 2 миррора по 2 диска пока, потом добавить по диску в эти мирроры и новые мирроры

Autumn

Autumn

10й рейд у зфс не честный, поэтому балансировки того что есть не будет

Ну вот да, что такое "нечестный", ну и если под балансировкой подразумевается равномерное распределение данных по рейду, то почему не будет? Вот пример с ребалансировкой на страйпед миррорах:

https://jrs-s.net/2020/03/10/rebalancing-data-on-zfs-mirrors/

George

George

Всем доброго времени суток.

Подскажите пож. еще такой вопрос. Хотим triple mirror на 20 дисков 8тб sas 7200, без отдельных дисков под метаданные.

Сейчас в наличии 4ре. Можно ли прямо сейчас собирать пул, а новые диски добавлять по мере поступления?

При добавлении нового диска в такой сетап, блоки данных со старых дисков будут перемещены на новые или останутся как есть?

При перезаписи старых данных они равномерно размажутся, фоновых механизмов изменения уже записанных данных нет

Василий

Василий

При перезаписи старых данных они равномерно размажутся, фоновых механизмов изменения уже записанных данных нет

Не. Пропорционально свободному месту

Autumn

Autumn

Не. Пропорционально свободному месту

пропорционально размеру дисков, если один диск 8 ТБ второй 4 ТБ, но 2 части будут записаны на первый и одна на второй, на сколько я знаю.

riv

riv

ZOL не поддерживает удаление/выталкивание из пула raidz vdev.

Уточню, речь идет про top-level vdev. Т.е. если первый vdev mirror, остальные могут быть любые. но я не проверял, так в доках написано.

Василий

Василий

nikolay

nikolay

Нет. Свободному месту

в случае расширения пула через добавление новых vdev новая запись пойдет только на новые vdev, возможностей для ребаланса, как написал Георгий, нет. аллокатор работает по свободному месту в этом случае. а вот если добавлять диск в vdev - тут надо читать комментарии к исходникам openzfs, у меня не было таких кейсов и я не изучал работу механизма аллокации в этом случае

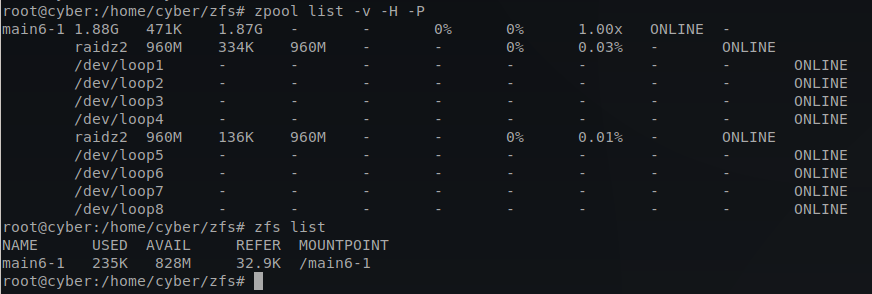

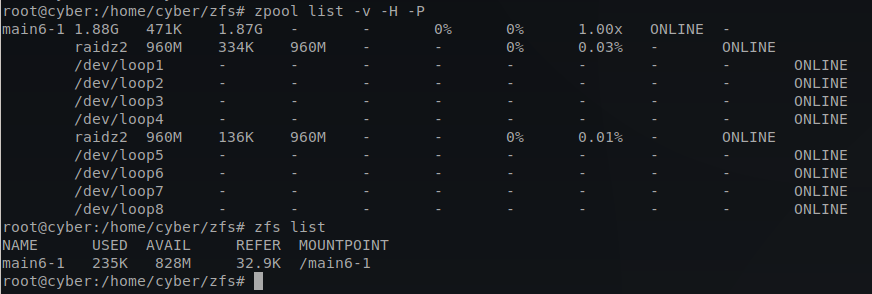

Sergey

Sergey

George

George

nikolay

nikolay

да, страйп, zfs list показывает примерный объём с учётом parity, а zpool list - общий raw размер (без parity)

мне кажется что нужна доп. команда zpool что-то, чтобы использовался весь объем после добавления

George

George

мне кажется что нужна доп. команда zpool что-то, чтобы использовался весь объем после добавления

Не, после добавления нового vdev пространство сразу доступно

Василий

Василий

мне кажется что нужна доп. команда zpool что-то, чтобы использовался весь объем после добавления

Это и есть весь объем минус 4 диска

Sergey

Sergey

Там за счёт 256мб "дисков" могут быть спецэффекты, если это именно мегабайты

именно мегабайты. Сoзданые через dd и превращенные в /dev/loop

George

George

именно мегабайты. Сoзданые через dd и превращенные в /dev/loop

ну всё верно, -4 диска на parity и другие резервирования, итого чуть меньше 50% от объёма, всё ок. На дисках нормального размера будет ещё ближе к 50%

Δαρθ

Δαρθ

именно мегабайты. Сoзданые через dd и превращенные в /dev/loop

вроде можно без лупов, сразу файлы добавлять

Δαρθ

Δαρθ

в линухе тоже. я так raidz2 делал сначала из 2 дисков и 2 образов, потом образы нах и в degraded режиме

Алексей

Алексей

Ребята всем привет.

у меня в зфс постоянно пишет со скоростью 600мб/сек не прекращаясь ни на секунду

заметно отжирают проца 30% процессы txg_sync txg_sync kthreadd

и еще много маленьких процессов z_wr_iss по 6-8% жрут

у меня виртуальный пул в виде файла размером 100гб который лежит на обычном nvme форматированном в ext4

настройки зфс следущие:

zfs set sync=disabled containers

zfs set atime=off containers

zfs set compression=lz4 containers

zfs set dedup=on containers

zfs set primarycache=none containers

zfs set secondarycache=none containers

zfs set recordsize=128K containers

виртуальные машины использующеие датасет выключены, скраб не запущен. (да и в любом случае он должен был завершиться за несколько секунд)

а у меня константно жрёт тбв...

чем может быть вызывано такое поведение?

куда копнуть?

Sergey

Sergey

Ivan

Ivan

George

George

Ребята всем привет.

у меня в зфс постоянно пишет со скоростью 600мб/сек не прекращаясь ни на секунду

заметно отжирают проца 30% процессы txg_sync txg_sync kthreadd

и еще много маленьких процессов z_wr_iss по 6-8% жрут

у меня виртуальный пул в виде файла размером 100гб который лежит на обычном nvme форматированном в ext4

настройки зфс следущие:

zfs set sync=disabled containers

zfs set atime=off containers

zfs set compression=lz4 containers

zfs set dedup=on containers

zfs set primarycache=none containers

zfs set secondarycache=none containers

zfs set recordsize=128K containers

виртуальные машины использующеие датасет выключены, скраб не запущен. (да и в любом случае он должен был завершиться за несколько секунд)

а у меня константно жрёт тбв...

чем может быть вызывано такое поведение?

куда копнуть?

Я бы проверил freeing или примерно так называющийся параметр у zpool get, мб вы что-то в большом количестве удаляли а он это асинхронно на фоне делает

Алексей

Алексей

Я бы проверил freeing или примерно так называющийся параметр у zpool get, мб вы что-то в большом количестве удаляли а он это асинхронно на фоне делает

нет, весь пул обьемомо 100 гиг. занято 18, а пишет он несколько часов уже

George

George

нет, весь пул обьемомо 100 гиг. занято 18, а пишет он несколько часов уже

посмотрели zpool get freeing , он нулевой?

Fedor

Fedor

Nick

Nick

Владимир

Владимир