какая разница диску какой там пул. он получил команду прочитать. он десктопный и не знает что там еще пачка копий, он пытается читать и не переходит дальше

гм. ладно, я видимо потерял нить вашего диалога с ivan

Ivan

Ivan

какая разница диску какой там пул. он получил команду прочитать. он десктопный и не знает что там еще пачка копий, он пытается читать и не переходит дальше

ну потупит пару раз на битых блоках, zfs больше туда лезть не будет. это же лучше, чем полный стоп и поход в серверную за выемкой диска.

Alexander

Alexander

lsi 9305

Какой конфиг вы делаете на случай глючного контроллера?

Разные контроллеры в разные части зеркал?

Василий

Василий

гм. ладно, я видимо потерял нить вашего диалога с ivan

зфс не шлет на два винта: прочитайте мне этот блок. а шлет на каждый свое чтение. если веник вернул ошибку - читает с другого.

десктопный, вернет ошибку сильно не сразу

nikolay

nikolay

ну потупит пару раз на битых блоках, zfs больше туда лезть не будет. это же лучше, чем полный стоп и поход в серверную за выемкой диска.

гм.. zfs может тупо выкинуть этот диск из пула, zfs slow read disk в гугле полно примеров. причем это не зависит от того что используется - hba или jbod raid

Василий

Василий

ну потупит пару раз на битых блоках, zfs больше туда лезть не будет. это же лучше, чем полный стоп и поход в серверную за выемкой диска.

просто контроллеры расчитаны как правило на энтерпрайзные диски. а там не так

Alexander

Alexander

гм.. zfs может тупо выкинуть этот диск из пула, zfs slow read disk в гугле полно примеров. причем это не зависит от того что используется - hba или jbod raid

Наверно можно установить таймауты в ZFS либо Linux ядре?

nikolay

nikolay

Ivan

Ivan

просто контроллеры расчитаны как правило на энтерпрайзные диски. а там не так

в том сервере диски ентерпрайзные, кстати. ну во всяком случае тошиба их таковыми считает.

Alexander

Alexander

все решает бюджет)

У меня был случай, взял недорогой 4портовый марвел с AliExpress. Он проработал пару месяцев, а потом начал глючить под настроение. Утащил у меня на тот свет часть зеркал, слава Богу не весь пул.

Причем эти зеркала даже потом не могли пройти Resilvering на другом исправном контроллере.

С тех пор я ставлю только разные контроллеры в разные части зеркал :)

Притом что бюджет у меня нищебродско-самозанятый ...

И вообще IMHO в идеале надо зеркала из 3х частей на 3х разных контроллерах

и пару дополнительных реплик на отдельных серверах с со своим железом, особенно RAM.

, тогда можно немного расслабить булки .

nikolay

nikolay

Наверно можно установить таймауты в ZFS либо Linux ядре?

это тюнится, да.. просто надо понимать что со стороны zfs требования к диску более жесткие, чем со стороны железа. из пула может быть выкинут вполне рабочий диск..

Василий

Василий

в том сервере диски ентерпрайзные, кстати. ну во всяком случае тошиба их таковыми считает.

странно. энтерпрайз должен очень быстро вернуть ошибку

Ivan

Ivan

странно. энтерпрайз должен очень быстро вернуть ошибку

я ж пишу, что контроллер завис и всё тут. потому я и пишу, что jbod не стоит юзать. я юзал, в целях тестирования, пока hba ехал.

nikolay

nikolay

я ж пишу, что контроллер завис и всё тут. потому я и пишу, что jbod не стоит юзать. я юзал, в целях тестирования, пока hba ехал.

вот тут я не могу сказать ни да, ни нет. у меня есть конфигурации когда пул на несколько десятков ТБ работает на таком jbod raid и все нормально. опять же недавно был случай когда дешманская ssd померла в полке и система не могла загрузиться)) до тех пор пока эту ssd не вытащили. полка подключена через hba. при подаче питания этот какашечный ssd вешал к херам всю sas шину..

nikolay

nikolay

вообще есть рекомендации от производителей ентерпрайз массивов - вытаскивайте сбойный диск из полки as soon as possible. как-то так..

Василий

Василий

nikolay

nikolay

э... не видел таких

ну я работаю (работал) плотно с netapp, huawei, hpe. все они рекомендуют именно это. во избежание ненужных проблем. от типов дисков это не зависит.

Alexander

Alexander

вообще есть рекомендации от производителей ентерпрайз массивов - вытаскивайте сбойный диск из полки as soon as possible. как-то так..

Так ведь оно может и ночью крякнуть, заменится на hotspare.

nikolay

nikolay

Так ведь оно может и ночью крякнуть, заменится на hotspare.

может. и потом ловишь на аггрегате/дисковом пуле латенси до 1.5 сек. мало приятного.. а вендор руками разводит и говорит эти самые рекомендации.

Ivan

Ivan

может. и потом ловишь на аггрегате/дисковом пуле латенси до 1.5 сек. мало приятного.. а вендор руками разводит и говорит эти самые рекомендации.

странно что вендоры не реализовали в своих хранилках отключение от шины или от питания сбойного диска.

nikolay

nikolay

как например? у дисков есть механизмы управления питанием, но если контролллер диска не принимает команды из вне, что с ним можно сделать? гасить питание в конкретном слоте - наверное да, но я таких полок пока не встречал.

Ivan

Ivan

как например? у дисков есть механизмы управления питанием, но если контролллер диска не принимает команды из вне, что с ним можно сделать? гасить питание в конкретном слоте - наверное да, но я таких полок пока не встречал.

ну я не знаю, можно же на контроллере игнорировать данные с диска, если там не используются экспандеры.

nikolay

nikolay

мм.. так забивается то сама шина, контроллер ни при чем. про экспандеры не очень понял, но если брать какой-нибудь нетапп, то там все диски только через них подключаются.

Ivan

Ivan

мм.. так забивается то сама шина, контроллер ни при чем. про экспандеры не очень понял, но если брать какой-нибудь нетапп, то там все диски только через них подключаются.

ну в том смысле, если каждый диск напрямую подключен, то можно грубо говоря порт отрубить, а если диски через экспандеры сидят, то порт на контроллере не отрубить получается.

это я теоретизирую, не представляю на самом деле что можно сделать, какие ограничения могут быть.

nikolay

nikolay

ну в том смысле, если каждый диск напрямую подключен, то можно грубо говоря порт отрубить, а если диски через экспандеры сидят, то порт на контроллере не отрубить получается.

это я теоретизирую, не представляю на самом деле что можно сделать, какие ограничения могут быть.

я думаю что если бы за разумные деньги такой механизм можно было реализовать - его бы использовали все. но очевидно проще дать рекомендации)

Василий

Василий

я думаю что если бы за разумные деньги такой механизм можно было реализовать - его бы использовали все. но очевидно проще дать рекомендации)

Вы бы уже ссылку на рекомендации сбросили. Потому что о таком не разу не слышал

Евгений

Евгений

Преобразование подача электро из подъезда -> электродвигатель -> электрогенератор -> квартира

наверно тоже рабочий вариант?

Именно так строят большие ИБП только там ещё дизель генератор через электромагнитную муфту ( которая умеет менять число оборотов) и многотонный маховик как накопитель

Alexander

Alexander

Занятные вы тут вещи обсуждали, поизучайте новые горизонты нашего прекрасного времени

И что там на горизонте?

Евгений

Евгений

Только в случае, если набор горячих данных в этот кеш помещается.

У меня нет кейса в котором данные в кэш не попадут, оперативки много не бывает, и даже если 80-90% будут из кэша, то 10% будут браться из медленного стора и это профит, потому как эти мультики 10% считаются с 100% скоростью пула

Александр

Александр

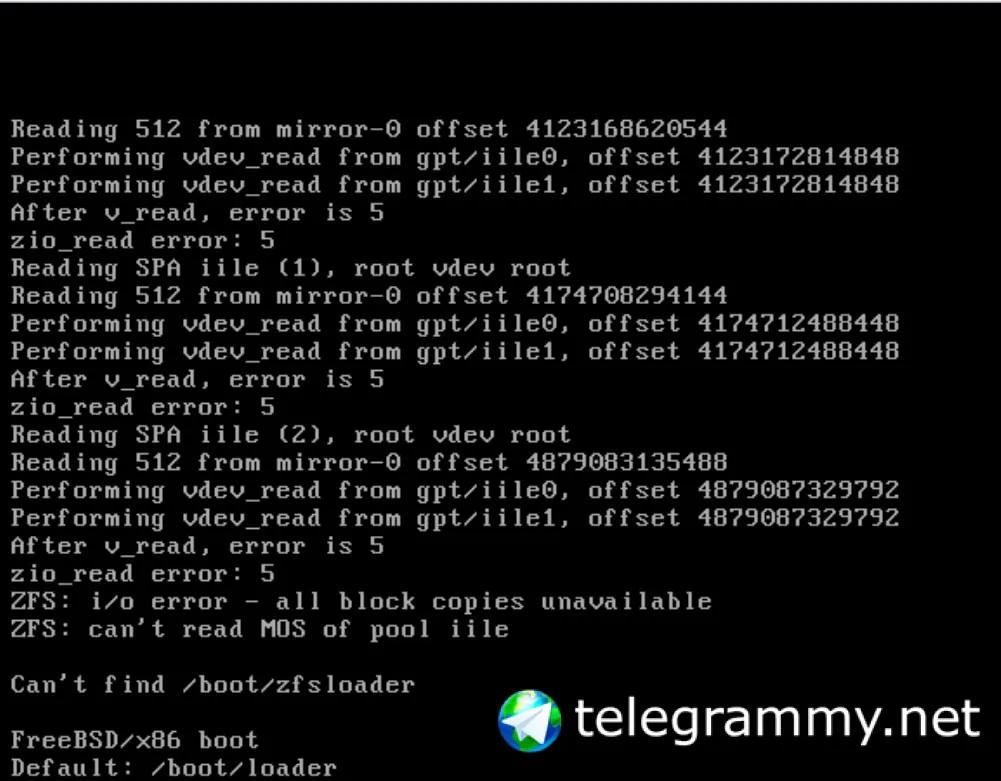

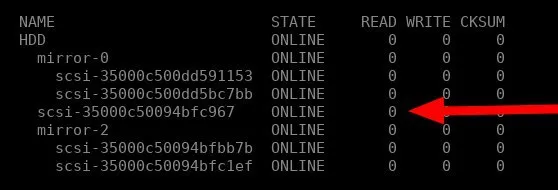

Господа товарищи, у меня тут внезапно странное. Делловский сервер (извините, без меня взяли), 5-тб диски. Время от времени загрузка с zpool уходит в себя. Я подправил gptzfsboot, чтобы он давал подробности, и вот что получил

Александр

Александр

Вот. Ощущение такое, что не получается прочитать данные с конца диска (оффсет где-то за четвертым терабайтом). К сожалению, историю сохранить некуда, он там много, что пишет.

Гуглил все варианты, связанные с этой проблемой. Ничего разумного не нашел

Δαρθ

Δαρθ

Murmuring

Murmuring

Добрый день! Кто-нибудь сталкивался с тем, что ZFS не дружит с HBA адаптером HP H220?

Конкретно у меня, собран raid1 на zfs, на raid установлена система, и она не грузиться ..

Олег

Олег

Добрый день! Кто-нибудь сталкивался с тем, что ZFS не дружит с HBA адаптером HP H220?

Конкретно у меня, собран raid1 на zfs, на raid установлена система, и она не грузиться ..

тут скорее нужно понимать как ставили, UEFI?

Евгений

Евгений

Murmuring

Murmuring

Настройках самого адаптера и видит ли их биос доступными для загрузки?

да, всё видит, в биосе всё ок. Ради интереса переткнули на обычный десктоп, там всё загрузилось нормально

Евгений

Евгений

есть предположение, что какой-то апдейт сломал совместимость между zfs и адаптером

или какой ни будь НР сломал совместимость нормального адаптера своей прошивкой

Murmuring

Murmuring

или какой ни будь НР сломал совместимость нормального адаптера своей прошивкой

я прошивку не трогал, может быть только после апдейта ос прилетела прошивка и всё сломалось.. Debian 10 Proxmox сервер

Murmuring

Murmuring

это же НР

The drivers for certain disk controllers (e.g. some HP SmartArray models) in GRUB can only read the first 2TB of the disk - combined with the nature of ZFS Copy-on-Write, this means that the system can become unbootable simply by installing a new kernel-image (which ends up after 2TB on disk).

Кажется нашёл в чем трабла

https://pve.proxmox.com/wiki/ZFS:_Switch_Legacy-Boot_to_Proxmox_Boot_Tool

Евгений

Евгений

Murmuring

Murmuring

старые контроллеры действительно имеют грабли с объёмами больше 2ТБ

нет, тут причина в том, что из легаси биоса невозможно загрузить систему, если она стоит на zfs raid

Евгений

Евгений

нет, тут причина в том, что из легаси биоса невозможно загрузить систему, если она стоит на zfs raid

ну из того, что ты скинул, что легаси больше 2ТБ не может, а загрузчик в конце диска сидит =)

Murmuring

Murmuring

ну из того, что ты скинул, что легаси больше 2ТБ не может, а загрузчик в конце диска сидит =)

да, и у меня как раз 2тб диски в рейде)

Murmuring

Murmuring

да, и у меня как раз 2тб диски в рейде)

я 8 часов потратил на то, чтобы потом прочитать вики

Владимир

Владимир

Доброго дня. У меня подвисла операция удаления субволюма. мне можно её как-то кикнуть, отменить? или это только рестарт?

Alexander

Alexander

Можно ли заставить работать ZFS в режиме ядра

lockdown=confidentiality ?

Т.е. как-то самостоятельно подписать модули или скомпилить ядро монолитом вместе с ZFS и т.п.?

Alexander

Alexander

Alexander

Alexander

Доброго дня. У меня подвисла операция удаления субволюма. мне можно её как-то кикнуть, отменить? или это только рестарт?

Отвисшие receive иногда удается - кильнуть их ssh сессию, но невсегда, в том смысле, что dataset иногда все равно остается busy, rollback тоже не работает.

IMHO такого рода подвисания - самая большая засада ZOL на сегодняшний день. Потому что это сильно портит uptime.

Только в такие моменты времени начинаешь думать о Solaris, других причин никогда у меня еще не было.

Владимир

Владимир

Отвисшие receive иногда удается - кильнуть их ssh сессию, но невсегда, в том смысле, что dataset иногда все равно остается busy, rollback тоже не работает.

IMHO такого рода подвисания - самая большая засада ZOL на сегодняшний день. Потому что это сильно портит uptime.

Только в такие моменты времени начинаешь думать о Solaris, других причин никогда у меня еще не было.

Я пробовал кликать, нифига. Да и проблема вот выросла недавно, раньше норм было

Владимир

Владимир

А что значит зависло? Как ты определяешь зависание?

Так что команда удаления выполняется несколько дней

Alexander

Alexander

Нет конечно, упаси бог)

C дедупликацией ZOL может удалять неделями, если не месяцами и в конечном итоге повиснуть. Лучший способ чистки дедуплицированных dataset - zpool destroy ибо zfs destroy может отвиснуть.

Ilya

Ilya