Сергей

Сергей

чуда по IOPS там не будет, ессно с recsize=1M. Но для данного кейса, повторюсь - это и не нужно

Alexander

Alexander

чуда по IOPS там не будет, ессно с recsize=1M. Но для данного кейса, повторюсь - это и не нужно

это ясно))ну очень поражают цифры))

Сергей

Сергей

перезапустил тест на raidz1 с файлом 100. Скоро будут результаты

а ashift при создании сделали 13 или оставили 12?

nikolay

nikolay

это ясно))ну очень поражают цифры))

https://jrs-s.net/2019/07/20/zfs-set-syncdisabled/ - вот тут например. выше я помню меняли настройки для тестов async, synс и fsync

Сергей

Сергей

https://jrs-s.net/2019/07/20/zfs-set-syncdisabled/ - вот тут например. выше я помню меняли настройки для тестов async, synс и fsync

нее, там везде sync=standard стоит.

nikolay

nikolay

нее, там везде sync=standard стоит.

тогда смысл в изменении настроек fio?) так, риторический вопрос.

Сергей

Сергей

nikolay

nikolay

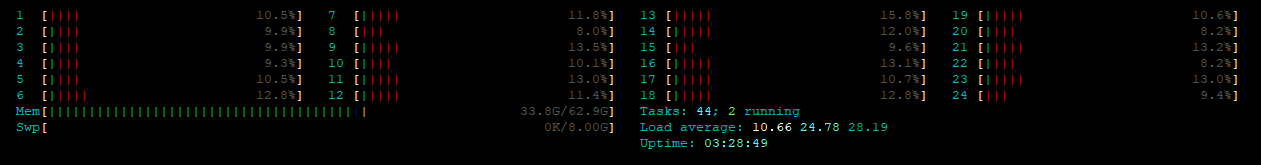

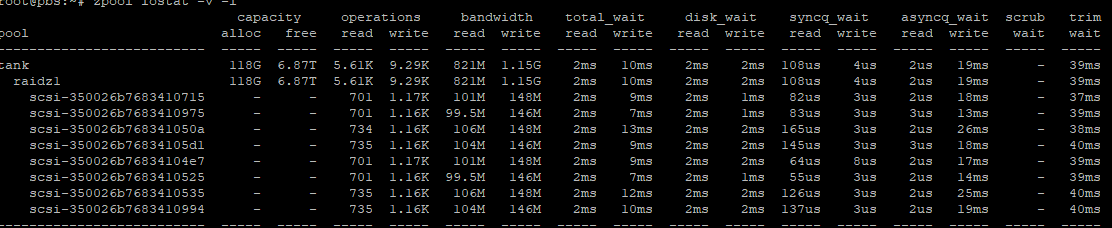

это на скольких джобах и глубине? ЦПУ в полку не ложаться?

да, что htop и zpool iostat -v -l показывают?

Сергей

Сергей

тогда смысл в изменении настроек fio?) так, риторический вопрос.

почему в изменении? На пуле могут выполняться разные операции, верно? Соответственно тестируется асинхронная запись, синхронная и fsync=1. Но пул при этом один и тот же

nikolay

nikolay

Сергей

Сергей

немного не про это спрашвал, но не суть.

возможно и я что-то не так понял). Но я вооще НЕ сторонник отключать sync на пуле. Если это не tmp диск конечно

Сергей

Сергей

нет, 64/8 сейчас

а подключить его к кластеру прокса и попробовать сделать реальный бэкап есть возможность? Там конечно сеть появится в качестве составляющей

Alexander

Alexander

nikolay

nikolay

как обычно, галочка поставленная в нужном месте, решает всё )

но будьте готовы при заполнении пула больше чем на 50-60% латенси для вас могут стать критичными. на свободном пуле аллокатору одно удовольствие работать, даже с большим recordsize

nikolay

nikolay

ну и если у вас в реальности блок будет меньшего размера, даже 256к например.. компрессию тоже не помешало бы включить для реальных данных..

Владимир

Владимир

а подключить его к кластеру прокса и попробовать сделать реальный бэкап есть возможность? Там конечно сеть появится в качестве составляющей

сделаю, нужно ещё в кластер проксмокса его добавить. как закончу с тестами, займусь добавлением в кластер

nikolay

nikolay

иначе потеря в объемах будет прям приличная при мелких блоках до 256к включительно. проверяйте на реальных данных в общем..

nikolay

nikolay

прокс будет на него складывать архивы по 20-30 гигов

архивы в формате zip/tar/gzip? или бэкапы?

tmf

tmf

никто не сталкивался?...

виснут процессы с D state-ом на zfs 2.0.4 (pve6.4-6):

2265 D Fri May 14 09:46:44 2021 [z_zvol]

2443 D Fri May 14 09:46:44 2021 [txg_sync]

2447 D Fri May 14 09:46:44 2021 [z_livelist_cond]

5856 D Mon May 17 16:49:57 2021 zfs destroy -r zpl2/pve/vm-2008-disk-0

21453 D Mon May 17 16:20:11 2021 [kworker/u129:0+events_freezable_power_]

55067 D Sun May 16 13:12:08 2021 /usr/bin/kvm -id 2008 -name edu-black -no-shutdown -chardev socket,id=qmp,path=/var/run/qemu-server/2008.qmp,server,nowait -mon chardev=qmp,mode=control -chardev socket,id=qmp-event,path=/var/run/qmeventd.sock,reconnect=5 -mon chardev=qmp-event,mode=control -pidfile /var/run/qemu-server/2008.pid -daemonize -smbios type=1,uuid=1517806a-0326-41d6-9e54-1047f00710d9 -smp 4,sockets=2,cores=2,maxcpus=4 -nodefaults -boot menu=on,strict=on,reboot-timeout=1000,splash=/usr/share/qemu-server/bootsplash.jpg -vnc unix:/var/run/qemu-server/2008.vnc,password -cpu kvm64,enforce,+kvm_pv_eoi,+kvm_pv_unhalt,+lahf_lm,+sep -m 6144 -device pci-bridge,id=pci.1,chassis_nr=1,bus=pci.0,addr=0x1e -device pci-bridge,id=pci.2,chassis_nr=2,bus=pci.0,addr=0x1f -device vmgenid,guid=54cac3fe-bd0f-45d9-93d5-b84bc21a0cb5 -device piix3-usb-uhci,id=uhci,bus=pci.0,addr=0x1.0x2 -device usb-tablet,id=tablet,bus=uhci.0,port=1 -device VGA,id=vga,bus=pci.0,addr=0x2 -iscsi initiator-name=iqn.1993-08.org.debian:01:153a90ce5aa3 -device virtio-scsi-pci,id=scsihw0,bus=pci.0,addr=0x5 -drive file=/dev/zvol/zpl2/pve/vm-2008-disk-0,if=none,id=drive-scsi0,format=raw,cache=none,aio=native,detect-zeroes=on -device scsi-hd,bus=scsihw0.0,channel=0,scsi-id=0,lun=0,drive=drive-scsi0,id=scsi0,bootindex=100 -netdev type=tap,id=net0,ifname=tap2008i0,script=/var/lib/qemu-server/pve-bridge,downscript=/var/lib/qemu-server/pve-bridgedown,vhost=on -device virtio-net-pci,mac=EE:4F:AB:D7:28:F9,netdev=net0,bus=pci.0,addr=0x12,id=net0,bootindex=300 -machine type=pc+pve0

Сергей

Сергей

Сергей

Сергей

добавлять диск под лог смысла нет ?

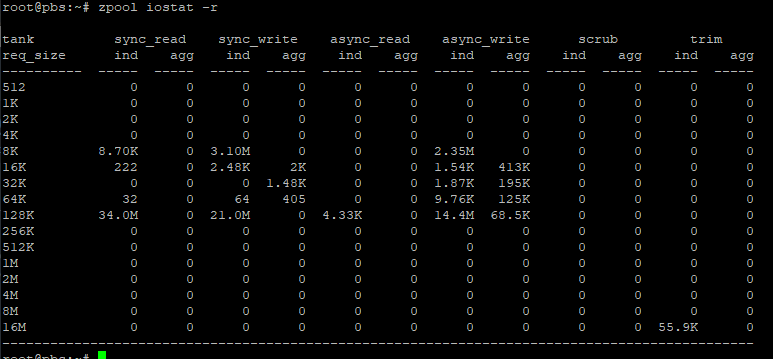

это будет понятно после того как начнут писаться бэкапы. можно будет проанализировать профиль записи (zpool iostat -r) и если кол-во синхронных операций большое - можно подумать и про SLOG

Сергей

Сергей

Владимир

Владимир

мелковатыми блоками пишет, более 128к ни разу не было. А скорость показывает какую-то записи?

INFO: 39% (126.4 GiB of 324.0 GiB) in 19m 46s, read: 102.9 MiB/s, write: 99.4 MiB/s

Fedor

Fedor

дедупом не пользуюсь вообще.

да и хост на солярке у меня на Т2 - версия 10.3 только, там уже ничего нового не заедет.

Сергей

Сергей

INFO: 39% (126.4 GiB of 324.0 GiB) in 19m 46s, read: 102.9 MiB/s, write: 99.4 MiB/s

да, не ахти. А может у клиента pbs есть настройка для увеличения размера блока?

Василий

Василий

Владимир

Владимир

tmf

tmf

что-нибудь можно сделать с зависающим импортом zpool-а?

D 23:48 0:02 \_ zpool import -d /dev/disk/by-id/ -o cachefile=none zpl2

Fedor

Fedor

А попадает процесс туда в случае, если он обратился к вводу-выводу, а тот по каким-то причинам залип

tmf

tmf

перезагрузка не проблема чтобы D state пропал

сейчас pvestatd отключу и попробую руками с strace-ом import сделать

Василий

Василий

что-нибудь можно сделать с зависающим импортом zpool-а?

D 23:48 0:02 \_ zpool import -d /dev/disk/by-id/ -o cachefile=none zpl2

я в свое время, плюнул на фрю/линух и поставил соряс, она подмаунтила тот пул, что вис, молча. но это было до того как они пошли разными путями

tmf

tmf

openat(AT_FDCWD, "/usr/share/locale/locale.alias", O_RDONLY|O_CLOEXEC) = 6

fstat(6, {st_mode=S_IFREG|0644, st_size=2995, ...}) = 0

read(6, "# Locale name alias data base.\n#"..., 3072) = 2995

read(6, "", 3072) = 0

close(6) = 0

openat(AT_FDCWD, "/usr/share/locale/en_US.UTF-8/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

openat(AT_FDCWD, "/usr/share/locale/en_US.utf8/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

openat(AT_FDCWD, "/usr/share/locale/en_US/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

openat(AT_FDCWD, "/usr/share/locale/en.UTF-8/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

openat(AT_FDCWD, "/usr/share/locale/en.utf8/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

openat(AT_FDCWD, "/usr/share/locale/en/LC_MESSAGES/zfs-linux-user.mo", O_RDONLY) = -1 ENOENT (No such file or directory)

brk(0x55560c507000) = 0x55560c507000

ioctl(3, _IOC(_IOC_NONE, 0x5a, 0x2, 0)

George

George

не не. в rz емнип пр-сть одного девайса

В raidz иопсы самого медленного диска, а вот пропускная способность до всех дисков минус parity диски

Δαρθ

Δαρθ

Владимир

Владимир