что значит из коробки?

ну чтоб в инсталлере на рут поставить можно было, наверно )

Alexander

Alexander

то есть тебя не смущает что обнов не будет со следующего года?))

Он же тебе ответил)) вот ты пристал к ос)! Вопрос про зфс, вроде был

nikolay

nikolay

доброе утро, возник вопрос по добавлению дисков в пул. есть сервер с подключенной к нему дисковой полкой через HBA. в полке 33 диска NL-SAS по 8 Тб. настроен multipath, каждый диск представлен как dm-name устройство. когда был собран пул на базе этой полки (4 vdev по 8 дисков) то zol разбил диски на две партиции и пул у меня собрался на базе партиций dm-name-*1. сейчас при добавлении новой полки, делаю процедуру расширения пула. добавляю vdev через команду zpool add и вижу что диски при добавлении не делятся на партиции. не совсем понятно почему при создании пула диски были разделены на партиции, а при добавлении партиции не создаются..

и все же я попытаюсь вернуться к сути вопроса - есть кто-то кто настраивал пулы на mpath девайсах?

nikolay

nikolay

замена mpath устройства в пуле отличается от замены обычного диска. может и при добавлении есть какие-то нюансы..

Alexander

Alexander

замена mpath устройства в пуле отличается от замены обычного диска. может и при добавлении есть какие-то нюансы..

тут мое предположение, только нужно быть уверенным , что это нужный девайс. и доступный. других подводных камней , вроде, как не должно быть, видимо только тестировать

nikolay

nikolay

тут мое предположение, только нужно быть уверенным , что это нужный девайс. и доступный. других подводных камней , вроде, как не должно быть, видимо только тестировать

вроде как все девайсы с новой полки по физике видны, dmsetup выдает о них информацию..

Alexander

Alexander

вроде как все девайсы с новой полки по физике видны, dmsetup выдает о них информацию..

отключить один линк предлагаю и посмотреть, не выпадет ли из пула

nikolay

nikolay

я же правильно понимаю что разбивка на партиции при создании или добавлении устрйств в пул нужна только для того, чтобы в пуле все диски были строго одинакового размера. партиция с номером 9 именно для этого и создается. и если у меня ее для дисков из которых собран отдельный vdev нет, то могут быть неприятные последствия. или не могут быть..

nikolay

nikolay

отключить один линк предлагаю и посмотреть, не выпадет ли из пула

мм.. HBA то один в сервере. тут mpath на уровне sas портов в каждом диске же. разве что extender в полке отключить..

Alexander

Alexander

я же правильно понимаю что разбивка на партиции при создании или добавлении устрйств в пул нужна только для того, чтобы в пуле все диски были строго одинакового размера. партиция с номером 9 именно для этого и создается. и если у меня ее для дисков из которых собран отдельный vdev нет, то могут быть неприятные последствия. или не могут быть..

думаю без разницы номера партиций, можно же вроде и с разными размерами vdev создавать

George

George

raidz2-6 - это vdev, который я добавил сегодня. не возникнет ли у меня проблем с тем, что на дисках не созданы партиции *1 и *9?

для самого пула не страшно, хотя похоже на багу. Минуса только два - некуда efi записать на этих дисках плюс размер диска под замену должен быть ни на байт меньше (а 9я партиция 8МБ дала бы дополнительные)

nikolay

nikolay

думаю без разницы номера партиций, можно же вроде и с разными размерами vdev создавать

да, можно диски с разными размерами использовать это понятно. я когда-то читал что служебная таблица разделов на whole диске нужна именно для того, чтобы диски одинакового размера но разных партий или даже производителей можно было без проблем добавлять в пул.

nikolay

nikolay

для самого пула не страшно, хотя похоже на багу. Минуса только два - некуда efi записать на этих дисках плюс размер диска под замену должен быть ни на байт меньше (а 9я партиция 8МБ дала бы дополнительные)

да, Георгий, я тоже самое пытаюсь сказать, только более путанно)

nikolay

nikolay

для самого пула не страшно, хотя похоже на багу. Минуса только два - некуда efi записать на этих дисках плюс размер диска под замену должен быть ни на байт меньше (а 9я партиция 8МБ дала бы дополнительные)

ну efi на дисках которые не имеют отношение к загрузке системы мне вроде как и не нужен..

nikolay

nikolay

для самого пула не страшно, хотя похоже на багу. Минуса только два - некуда efi записать на этих дисках плюс размер диска под замену должен быть ни на байт меньше (а 9я партиция 8МБ дала бы дополнительные)

А можно еще вот такой момент уточнить. Когда я собирал пул, я взял указатели на dm устройства вида dm-name-mpathv (когда подавал команду zpool create). точно помню что zpool status выдавал именования устройств в пуле без номера раздела. потом на сервере переставляли систему и я делал импорт пула. вероятнее всего именно в этот момент указатели на устройства в пуле перескочили на dm-name-mpath*1. я же могу вернуться к прежним ссылкам? или более правильно перейти на именования устройств с wwn как рекомендовано в некоторых гайдах?

nikolay

nikolay

чтобы было понятнее сейчас у меня 4-е указателя на одно dm устройство. какой из них правильнее использовать?

nikolay

nikolay

[root@ ~]# ls -l /dev/disk/by-id/ | grep dm-114

lrwxrwxrwx. 1 root root 12 мая 17 09:58 dm-name-mpathal -> ../../dm-114

lrwxrwxrwx. 1 root root 12 мая 17 09:58 dm-uuid-mpath-35000c500ca5a05eb -> ../../dm-114

lrwxrwxrwx. 1 root root 12 мая 17 12:10 scsi-35000c500ca5a05eb -> ../../dm-114

lrwxrwxrwx. 1 root root 12 мая 17 12:10 wwn-0x5000c500ca5a05eb -> ../../dm-114

George

George

А можно еще вот такой момент уточнить. Когда я собирал пул, я взял указатели на dm устройства вида dm-name-mpathv (когда подавал команду zpool create). точно помню что zpool status выдавал именования устройств в пуле без номера раздела. потом на сервере переставляли систему и я делал импорт пула. вероятнее всего именно в этот момент указатели на устройства в пуле перескочили на dm-name-mpath*1. я же могу вернуться к прежним ссылкам? или более правильно перейти на именования устройств с wwn как рекомендовано в некоторых гайдах?

https://openzfs.github.io/openzfs-docs/Project%20and%20Community/FAQ.html#selecting-dev-names-when-creating-a-pool-linux + ниже vdev_id.conf стоит смотреть

George

George

если хочется поменять путь который zfs использует - просто эскпорт и импорт с явным указанием директории через -d откуда импорт делать

nikolay

nikolay

если хочется поменять путь который zfs использует - просто эскпорт и импорт с явным указанием директории через -d откуда импорт делать

да, это я помню. уже приходилось менять пути. спасибо за ссылку

nikolay

nikolay

просто ситуация не однозначная возникла и не хочется получить неработающий пул из которого уже не вытащить добавленный сегодня vdev..

nAHKPATOB

nAHKPATOB

Вот новая загадка:

После обновления FreeBSD с 12.2 на 13.0 через пару месяцев появилось вот это

"ZFS: out of temporary space"

хотя до этого перезагружался несколько раз и проблем не было.

Чем лечить такое?

Владимир

Владимир

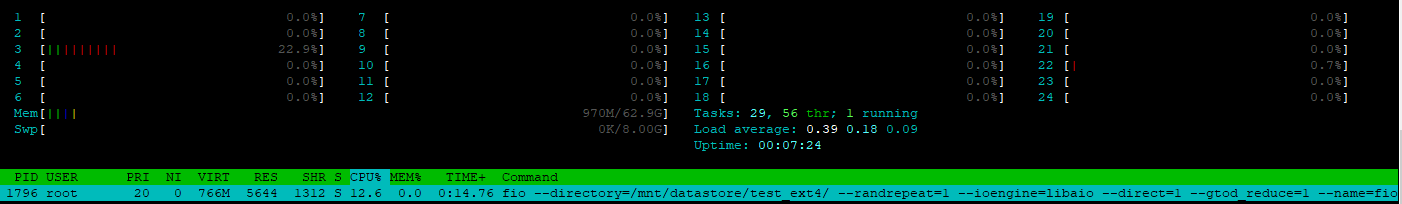

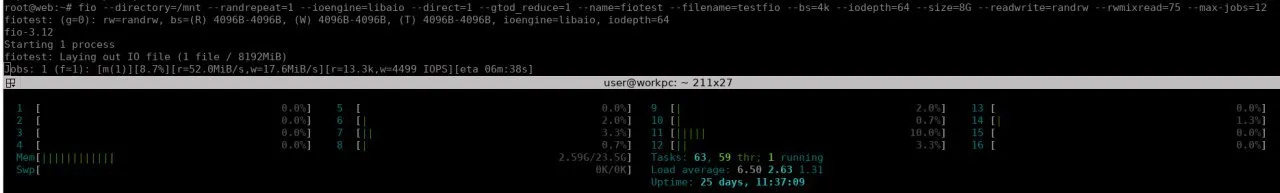

провёл ряд тестов, тестировал fio.

fio --randrepeat=1 --ioengine=libaio --direct=1 --gtod_reduce=1 --name=fiotest --filename=testfio --bs=4k --iodepth=64 --size=8G --readwrite=randrw --rwmixread=75

Владимир

Владимир

raidz2

Run status group 0 (all jobs):

READ: bw=45.4MiB/s (47.6MB/s), 45.4MiB/s-45.4MiB/s (47.6MB/s-47.6MB/s), io=6141MiB (6440MB), run=135415-135415msec

WRITE: bw=15.1MiB/s (15.9MB/s), 15.1MiB/s-15.1MiB/s (15.9MB/s-15.9MB/s), io=2051MiB (2150MB), run=135415-135415msec

raidz1

Run status group 0 (all jobs):

READ: bw=49.1MiB/s (51.5MB/s), 49.1MiB/s-49.1MiB/s (51.5MB/s-51.5MB/s), io=6141MiB (6440MB), run=125108-125108msec

WRITE: bw=16.4MiB/s (17.2MB/s), 16.4MiB/s-16.4MiB/s (17.2MB/s-17.2MB/s), io=2051MiB (2150MB), run=125108-125108msec

raid10

Run status group 0 (all jobs):

READ: bw=49.2MiB/s (51.6MB/s), 49.2MiB/s-49.2MiB/s (51.6MB/s-51.6MB/s), io=6141MiB (6440MB), run=124904-124904msec

WRITE: bw=16.4MiB/s (17.2MB/s), 16.4MiB/s-16.4MiB/s (17.2MB/s-17.2MB/s), io=2051MiB (2150MB), run=124904-124904msec

один диск ext4

Run status group 0 (all jobs):

READ: bw=44.0MiB/s (46.2MB/s), 44.0MiB/s-44.0MiB/s (46.2MB/s-46.2MB/s), io=6141MiB (6440MB), run=139455-139455msec

WRITE: bw=14.7MiB/s (15.4MB/s), 14.7MiB/s-14.7MiB/s (15.4MB/s-15.4MB/s), io=2051MiB (2150MB), run=139455-139455msec

Disk stats (read/write):

sdi: ios=1568152/527084, merge=2436/284, ticks=7199412/1691648, in_queue=4581688, util=99.99%

Ivan

Ivan

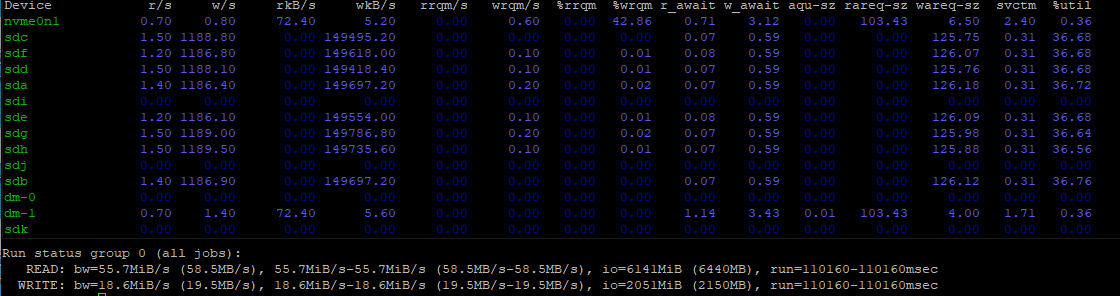

выходит, что упираемся или в контроллер(p420i) или в процессор(2xE5-2620v2, MEM 64 GB)

htop смотрите во время тестов

Владимир

Владимир

config:

NAME STATE READ WRITE CKSUM

tank ONLINE 0 0 0

mirror-0 ONLINE 0 0 0

sda ONLINE 0 0 0

sdb ONLINE 0 0 0

mirror-1 ONLINE 0 0 0

sdc ONLINE 0 0 0

sdd ONLINE 0 0 0

mirror-2 ONLINE 0 0 0

sde ONLINE 0 0 0

sdf ONLINE 0 0 0

mirror-3 ONLINE 0 0 0

sdg ONLINE 0 0 0

sdh ONLINE 0 0 0

errors: No known data errors

Fedor

Fedor

Владимир

Владимир

Run status group 0 (all jobs):

READ: bw=53.1MiB/s (55.6MB/s), 53.1MiB/s-53.1MiB/s (55.6MB/s-55.6MB/s), io=6141MiB (6440MB), run=115759-115759msec

WRITE: bw=17.7MiB/s (18.6MB/s), 17.7MiB/s-17.7MiB/s (18.6MB/s-18.6MB/s), io=2051MiB (2150MB), run=115759-115759msec

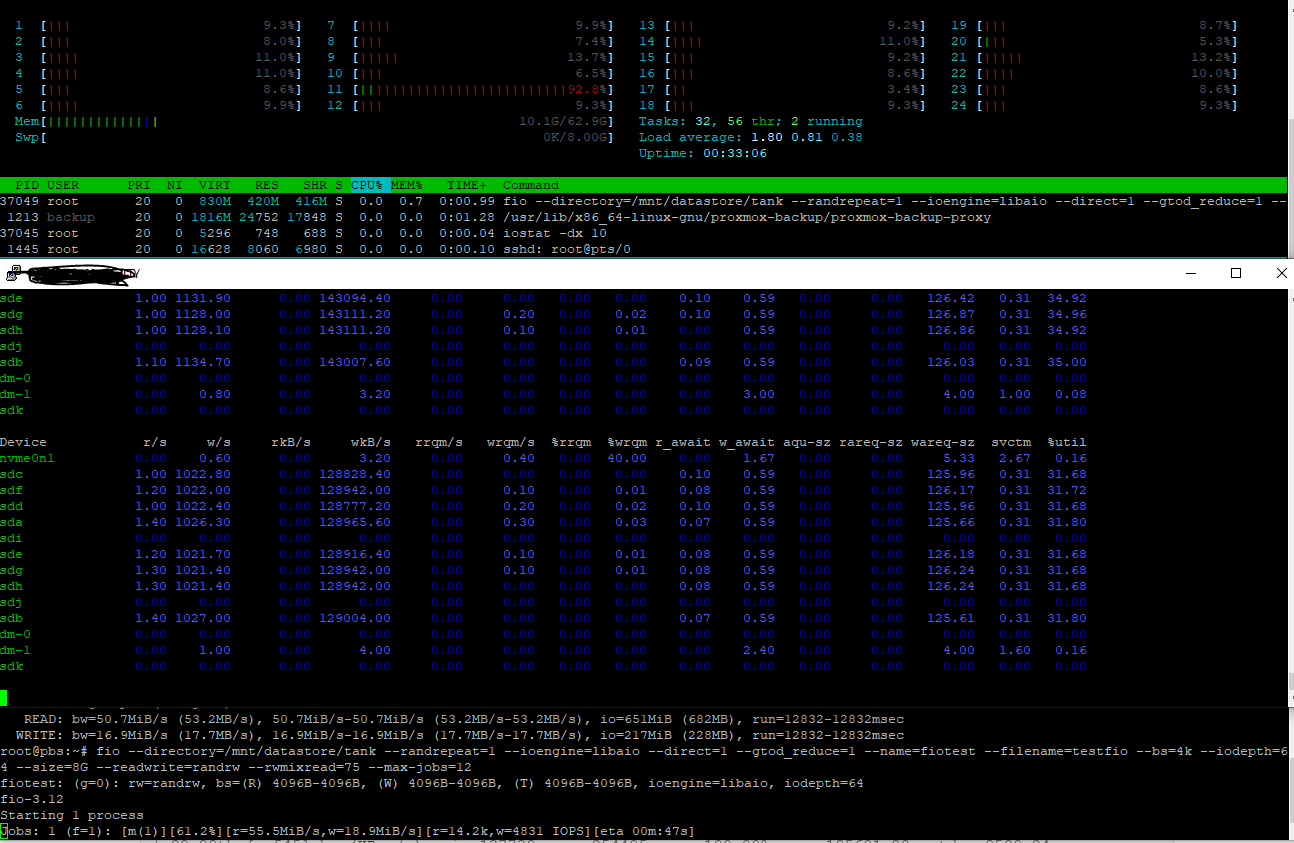

Владимир

Владимир

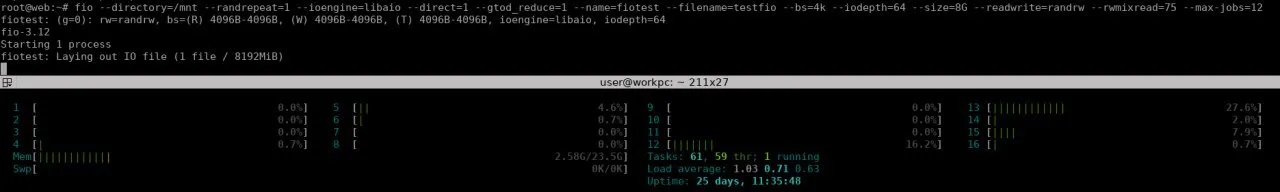

ничего кроме

fio --directory=/mnt/datastore/tank --randrepeat=1 --ioengine=libaio --direct=1 --gtod_reduce=1 --name=fiotest --filename=testfio --bs=4k --iodepth=64 --size=8G --readwrite=randrw --rwmixread=75 --max-jobs=12

Владимир

Владимир

Владимир

Владимир

я на память уже не помню, но у меня был аткой прикол и я что-то с ядром мутил), давно было, честно вообще нифига не помню что там было

Владимир

Владимир

Alexander

Alexander

Владимир

Владимир

Очень сильно смутило, особенно то что скорость на одном винте такая же как на 10 raid.

Пока есть только одно предположение. Суммарная скорость доступа к контроллеру примерно ровна скорости доступа к одному диску.

Alexander

Alexander

Очень сильно смутило, особенно то что скорость на одном винте такая же как на 10 raid.

Пока есть только одно предположение. Суммарная скорость доступа к контроллеру примерно ровна скорости доступа к одному диску.

У меня другое предположение)) настройки fio🤷♂️

Alexander

Alexander

Alexander

Alexander

Владимир

Владимир

8 гиг? Чет быстро я его не загуглил

Да,

https://s4u.com.ua/hp-p420-controller-osobennosti.html